python 爬取豆瓣的美剧

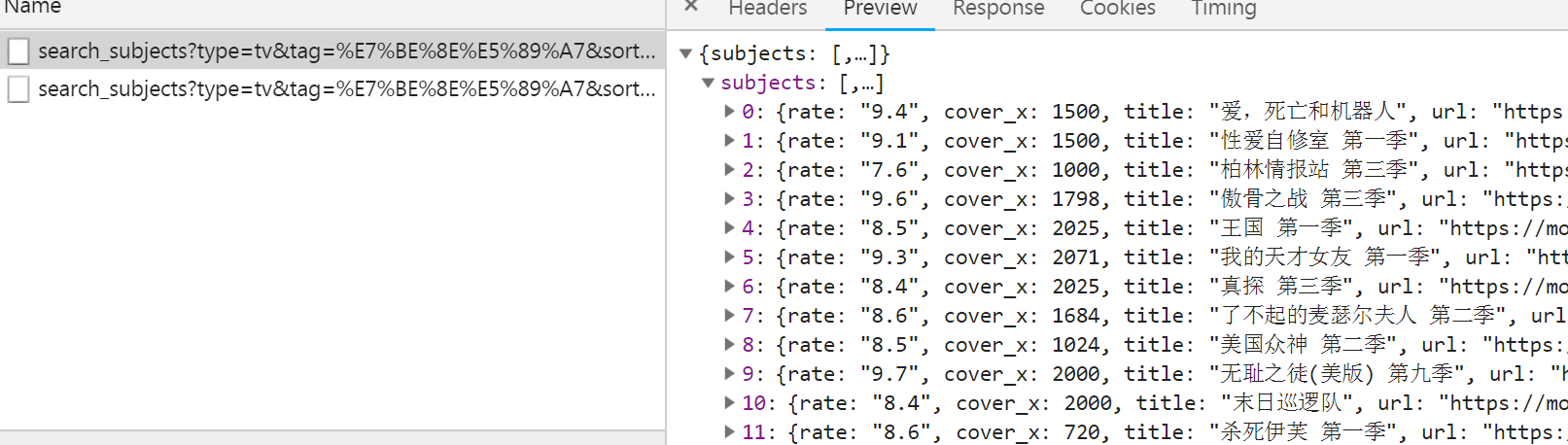

pc版大概有500条记录,mobile大概是50部,只有热门的,所以少一点

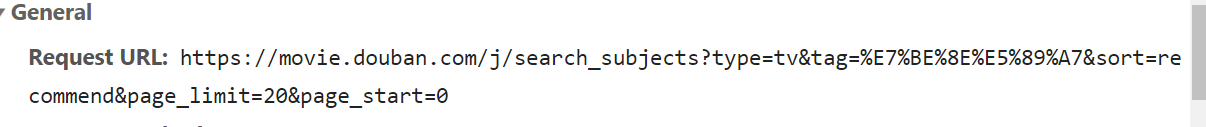

url构造很简单,主要参数就是page_limit与page_start,每翻一页,start+=20即可,tag是"美剧"编码后的结果,直接带着也可以,用unquote解码也可以,注意headers中一定要带上refer

import json

import requests

import math

import os

import shutil

from pprint import pprint

from urllib import parse class DoubanSpliderPC:

def __init__(self):

self.url = parse.unquote(

"https://movie.douban.com/j/search_subjects?type=tv&tag=%E7%BE%8E%E5%89%A7&sort=recommend&page_limit=20&page_start={}") self.headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/68.0.3440.106 Safari/537.36",

"Referer": "https://movie.douban.com/tv/"

}

self.file_dir = "./douban_american_pc.txt" def parse_url(self):

number = 0

while True:

url = self.url.format(number)

print(url)

response = requests.get(url, headers=self.headers)

response_dict = json.loads(response.content.decode())

subjects_list = response_dict["subjects"]

with open(self.file_dir, "a", encoding="utf-8") as file:

for subject in subjects_list:

file.write(json.dumps(subject, ensure_ascii=False))

file.write("\r\n")

if len(subjects_list) < 20:

break

number += 20 def run(self):

# 删除之前保存的数据

if os.path.exists(self.file_dir):

os.remove(self.file_dir)

print("文件已清空")

self.parse_url() def main():

splider = DoubanSpliderPC()

splider.run() if __name__ == '__main__':

main()

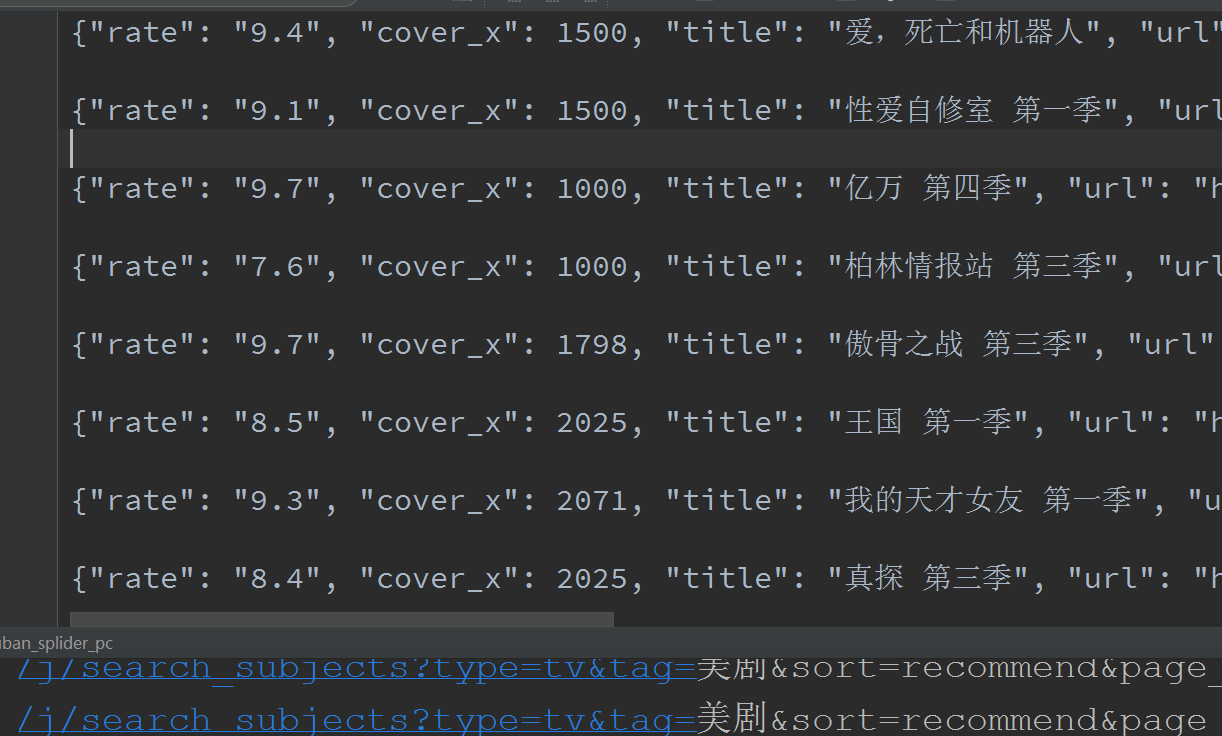

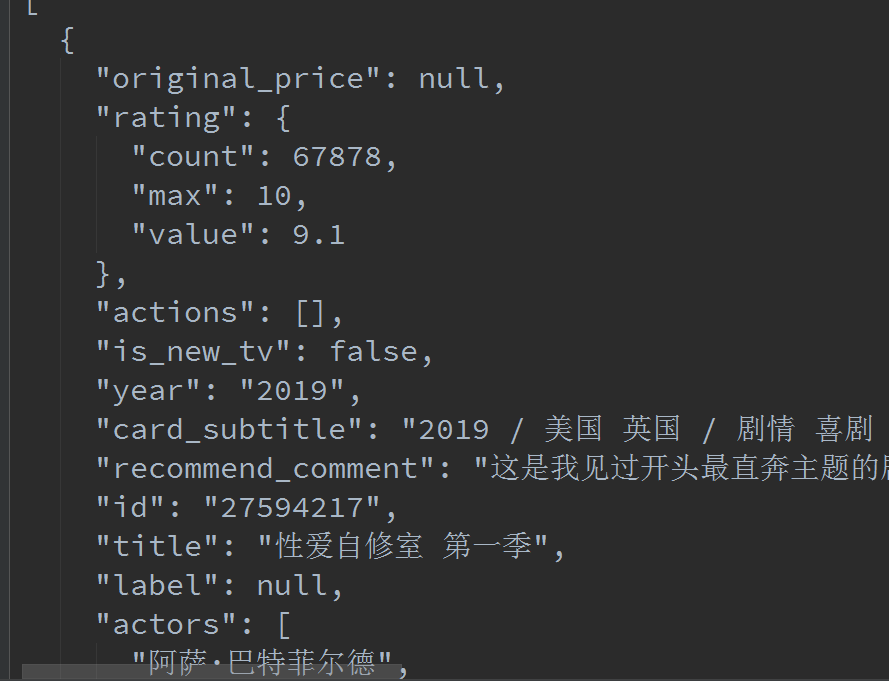

moblie类似,不过抓包的时候找那个Item就可以了

import json

import requests

import math

import os

import shutil

from pprint import pprint # 爬取豆瓣的美剧页面(手机版只有50条)

class DouBanSpliderMobile:

pageCount = 18

total = None def __init__(self):

self.first_url = "https://m.douban.com/rexxar/api/v2/subject_collection/tv_american/items?os=ios&for_mobile=1&start={}&count=18&loc_id=108288&_=1552995446961"

self.headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/68.0.3440.106 Safari/537.36",

"Referer": "https://m.douban.com/tv/american"

}

self.file_dir = "./douban_american_mobile.txt" def get_url_list(self):

url_list = []

for i in range(math.ceil(DouBanSpliderMobile.total / DouBanSpliderMobile.pageCount)):

url = self.first_url.format(i * 18)

url_list.append(url)

return url_list def parse_url(self, url):

response = requests.get(url, headers=self.headers)

response_dict = json.loads(response.content.decode())

DouBanSpliderMobile.total = int(response_dict["total"])

with open(self.file_dir, "a", encoding="utf-8") as file:

json.dump(response_dict["subject_collection_items"], file, ensure_ascii=False, indent=2) def run(self):

# 解析第一个url,获取total

self.parse_url(self.first_url.format(0))

url_list = self.get_url_list() # 删除之前保存的文件

if os.path.exists(self.file_dir):

os.remove(self.file_dir) for url in url_list:

self.parse_url(url) def main():

douban_splider = DouBanSpliderMobile()

douban_splider.run() if __name__ == '__main__':

main()

python 爬取豆瓣的美剧的更多相关文章

- Python爬取豆瓣指定书籍的短评

Python爬取豆瓣指定书籍的短评 #!/usr/bin/python # coding=utf-8 import re import sys import time import random im ...

- 利用Python爬取豆瓣电影

目标:使用Python爬取豆瓣电影并保存MongoDB数据库中 我们先来看一下通过浏览器的方式来筛选某些特定的电影: 我们把URL来复制出来分析分析: https://movie.douban.com ...

- Python爬取豆瓣《复仇者联盟3》评论并生成乖萌的格鲁特

代码地址如下:http://www.demodashi.com/demo/13257.html 1. 需求说明 本项目基于Python爬虫,爬取豆瓣电影上关于复仇者联盟3的所有影评,并保存至本地文件. ...

- Python爬取豆瓣电影top

Python爬取豆瓣电影top250 下面以四种方法去解析数据,前面三种以插件库来解析,第四种以正则表达式去解析. xpath pyquery beaufifulsoup re 爬取信息:名称 评分 ...

- python爬取豆瓣电影信息数据

题外话+ 大家好啊,最近自己在做一个属于自己的博客网站(准备辞职回家养老了,明年再战)在家里 琐事也很多, 加上自己 一回到家就懒了(主要是家里冷啊! 广东十几度,老家几度,躲在被窝瑟瑟发抖,) 由于 ...

- Python爬取豆瓣音乐存储MongoDB数据库(Python爬虫实战1)

1. 爬虫设计的技术 1)数据获取,通过http获取网站的数据,如urllib,urllib2,requests等模块: 2)数据提取,将web站点所获取的数据进行处理,获取所需要的数据,常使用的技 ...

- 零基础爬虫----python爬取豆瓣电影top250的信息(转)

今天利用xpath写了一个小爬虫,比较适合一些爬虫新手来学习.话不多说,开始今天的正题,我会利用一个案例来介绍下xpath如何对网页进行解析的,以及如何对信息进行提取的. python环境:pytho ...

- python爬取豆瓣小组700+话题加回复啦啦啦python open file with a variable name

需求:爬取豆瓣小组所有话题(话题title,内容,作者,发布时间),及回复(最佳回复,普通回复,回复_回复,翻页回复,0回复) 解决:1. 先爬取小组下,所有的主题链接,通过定位nextpage翻页获 ...

- python 爬取豆瓣电影评论,并进行词云展示及出现的问题解决办法

本文旨在提供爬取豆瓣电影<我不是药神>评论和词云展示的代码样例 1.分析URL 2.爬取前10页评论 3.进行词云展示 1.分析URL 我不是药神 短评 第一页url https://mo ...

随机推荐

- AndroidStudio 内存泄漏分析 Memory Monitor

ok.写一段内存泄漏的code private TextView txt; @Override protected void onCreate(Bundle savedInstanceState) { ...

- .v 和 .sdf

DC输出的.v(网表?)和.sdf(储存的是延时的信息) 用于后仿真

- 洛谷 P2368 EXCEEDED WARNING B

P2368 EXCEEDED WARNING B 题目背景 SGU 107 题目描述 求有多少个平方后末尾为987654321的n位数 输入输出格式 输入格式: 整数n 输出格式: 答案,即[b]“平 ...

- [C/C++]_[0基础]_[static_cast,reinterpret_cast,dynimic_cast的使用场景和差别]

场景: 1. C++的对象差别于C的原因是他们能够有继承关系, 方法有重载, 覆盖关系等, 他们的对象内存数据结构因此也比較复杂. 2. 非常多情况下我们须要一个父类来存储子类的指针对象进行通用方法的 ...

- amazeui学习笔记--css(布局相关3)--辅助类Utility

amazeui学习笔记--css(布局相关3)--辅助类Utility 一.总结 1.元素清除浮动: 添加 am-cf 这个 class 即可 2.水平滚动: .am-scrollable-horiz ...

- 微信支付v2开发(6) 发货通知

本文介绍微信支付中发货通知功能的实现. 一.发货通知 为了更好地跟踪订单的情况,需要第三方在收到最终支付通知之后,调用发货通知API告知微信后台该订单的发货状态. 发货时间限制:虚拟.服务类24小时内 ...

- Android 快速下载 Android framework 源码

官网 Android framework源码git地址 github: https://github.com/android/platform_frameworks_base google 官方: h ...

- MWPhotoBrowser 属性详解 和代理解释

--------0.MWPhoto简单属性解释---------------- MWPhoto *photo = [MWPhoto photoWithURL:[NSURL URLWithString: ...

- 【CS Round #48 (Div. 2 only)】Dominant Free Sets

[链接]h在这里写链接 [题意] 让你在n个点组成的集合里面选取不为空的集合s. 使得这里面的点没有出现某个点a和b,ax>=bx且ay>=by; 问你s的个数. [题解] 我们把这些点按 ...

- Android 调用系统邮件,发送邮件到指定邮箱

在项目中,最后有一个联络我们,要求是点击号码还有邮箱地址能够发送邮件,这时候解决的方案其实有两种,一种是调用系统发邮件的软件,可以添加邮箱账号就可以发送邮件:第二种是使用javamail来发送邮件.在 ...