Python爬虫教程-33-scrapy shell 的使用

本篇详细介绍 scrapy shell 的使用,也介绍了使用 xpath 进行精确查找

Python爬虫教程-33-scrapy shell 的使用

- scrapy shell 的使用

- 条件:我们需要先在环境中,安装 scrapy 包,如果还没有安装,请参照:Python爬虫教程-30-Scrapy 爬虫框架介绍

- 为什么要使用 scrapy shell?

- 当我们需要爬取智联招聘,某一个岗位的信息的时候,如果我们当然不能简单的把整个页面的 HTML 都作为返回的结果吧,这时候我们需要提取数据,我们可以使用正则,但是呢使用正则由很容易出问题,也就需要我们不断地去调试,如果说对于一个较大的 Scrapy 项目去测试正则的结果是否正确,就过于麻烦了,这时候,我们要使用 scrapy shell 去调试,测试成功后,在拷贝到我们的项目中就可以了

- 怎么打开 scrapy shell?

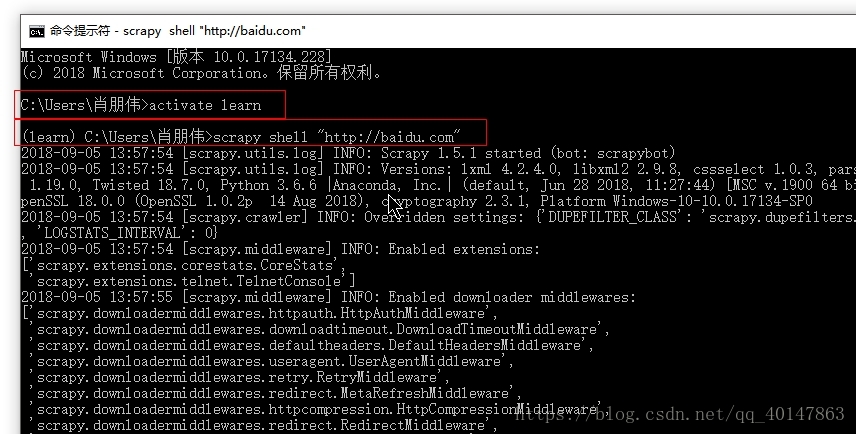

- 1.打开【cmd】

- 2.进入需要的 Anaconda 环境

- 例如:

我的环境名为:learn

activate learn

- 3.使用命令进入 scrapy shell "需要访问的地址"

例如:

scrapy shell "http://baidu.com"

- 4.操作截图:

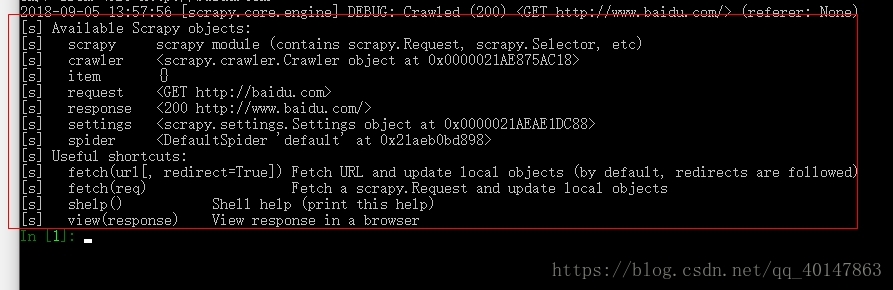

这里会出现一大堆,不用管,最后会有一个代码输入的地方:

这里就是我们写代码的地方

scrapy shell 的简单使用

- 1. response

- 执行命令之后,可以看到有很多 [s] 开头的东西,就是我们可以在下面代码输入框中使用的变量**

- 执行后,会自动将指定 url 的网页

- 下载完后,url 的内容保存在 response 的变量中

- response.body

- response.headers

- response.headers['Server']

- response.xpath() 使用 xpath

- response.css() 使用 css 语法选取内容

- 2.例如:我们使用:view(response):

- 截图:

- 结果就是调用浏览器,查看视图

- 截图:

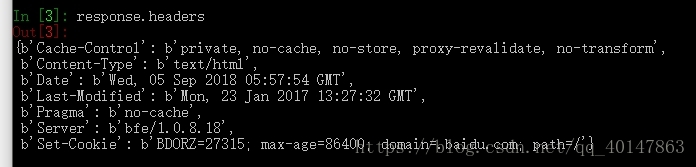

- 3.例如:我们想查看 headers 的内容:

- 使用:response.headers

- 截图:

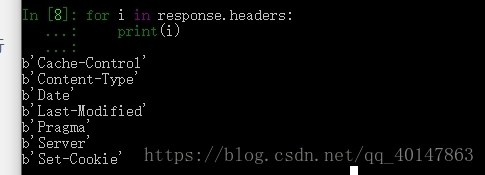

- 4.一回车就执行了,怎样多行输入呢?

- 在 scrapy shell 中,我们只进行简单的多行输入,比如函数,for循环,更多的多个函数,特别多行的话,我们何尝不使用 Pycharm 呢,我们使用 scrapy shell 的目的就是简单执行,快速

- 例如:for 循环打印 response.headers

- 截图:

- 这时候又有新的问题了,for 循环,可以多行了,但回车没法执行了

- 这时候使用的是:Ctrl + Enter 键执行

- 5.怎样输出属性的值呢?

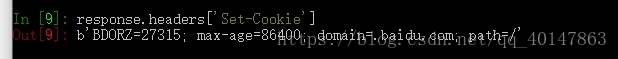

- 例如:我们打印 response.headers 中的一个 Set-Cookie 项对于的值

- 截图:

- 6.selector

- 选择器,允许用户使用选择器来选择自己想要的内容

- response.selector.xpath:response.xpath 是 response.selector.xpath 的快捷方式

- response.selector.css:response.css 是 response.selector.css 的快捷方式

- selector.extract:把节点内容用 unicode 形式返回

- selector.re:允许用户通过正则选择内容

response.xpath 使用案例

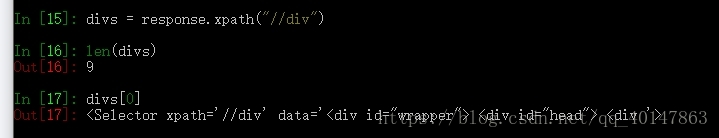

- 1.使用 scrapy shell "http://baidu.com" 访问百度,得到response

- 2.目标:我们是想要找到这个页面的所有 div 头,并赋值给 divs

- 3.使用 len(divs) 查看共有多少个 div

- 4.我们输出下标为 0 的 div 头信息

- 操作截图:

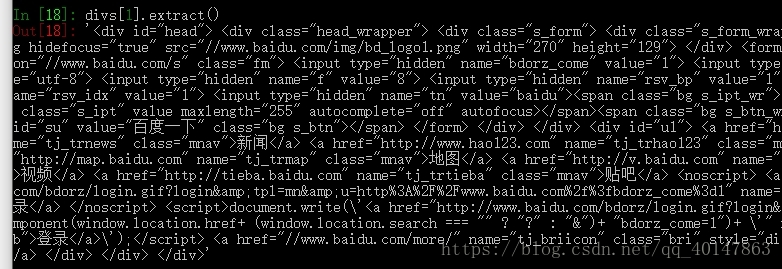

- 5.这里只是头信息,想要获取 div 的内容代码

- 使用 divs[1].extract()

- 截图:

- 6.使用 xpath 精确查找

1.我们想找表格中的一个 a 标签

response.xpath( "//table/tr/td/a" )

- 2.//table 表示不管 table 在哪个标签的下面,找到所有的 table 标签

- 3.这里 / 只是表示在哪个标签里,是谁的子标签,不一定是儿子标签,也包括孙子标签

- 4.如果需要查找的页面有很多很多 a 标签,那么这样找,范围还是太宽了

5.按标签属性查找:

res_href = response.xpath( "//table/tr/td/a/@href" )

- 这时候,我就可以找到所有 a 标签的链接,我们可以打印一下链接

for i in res_href :

print( i.extract() )- 6.按标签属性的值查找:

- 例如:我们想要查找表格中一个 id = teacher 的一个列

res_href = response.xpath( "//table/tr/td[@id='teacher']" )

以上是使用 xpath 精确查找,当然也可以使用 re 正则 去查找,本篇就介绍到这里了,拜拜

更多文章链接:Python 爬虫随笔

- 本笔记不允许任何个人和组织转载

Python爬虫教程-33-scrapy shell 的使用的更多相关文章

- Python爬虫教程-31-创建 Scrapy 爬虫框架项目

本篇是介绍在 Anaconda 环境下,创建 Scrapy 爬虫框架项目的步骤,且介绍比较详细 Python爬虫教程-31-创建 Scrapy 爬虫框架项目 首先说一下,本篇是在 Anaconda 环 ...

- Python爬虫教程-01-爬虫介绍

Spider-01-爬虫介绍 Python 爬虫的知识量不是特别大,但是需要不停和网页打交道,每个网页情况都有所差异,所以对应变能力有些要求 爬虫准备工作 参考资料 精通Python爬虫框架Scrap ...

- Python爬虫教程-00-写在前面

鉴于好多人想学Python爬虫,缺没有简单易学的教程,我将在CSDN和大家分享Python爬虫的学习笔记,不定期更新 基础要求 Python 基础知识 Python 的基础知识,大家可以去菜鸟教程进行 ...

- Python爬虫教程-32-Scrapy 爬虫框架项目 Settings.py 介绍

本篇介绍项目开发的过程中,对 Setting 文件的配置和使用 Python爬虫教程-32-Scrapy 爬虫框架项目 Settings.py 介绍 settings.py 文件的使用 想要详细查看 ...

- Python爬虫教程-30-Scrapy 爬虫框架介绍

从本篇开始学习 Scrapy 爬虫框架 Python爬虫教程-30-Scrapy 爬虫框架介绍 框架:框架就是对于相同的相似的部分,代码做到不出错,而我们就可以将注意力放到我们自己的部分了 常见爬虫框 ...

- Python爬虫进阶之Scrapy框架安装配置

Python爬虫进阶之Scrapy框架安装配置 初级的爬虫我们利用urllib和urllib2库以及正则表达式就可以完成了,不过还有更加强大的工具,爬虫框架Scrapy,这安装过程也是煞费苦心哪,在此 ...

- Python爬虫教程-11-proxy代理IP,隐藏地址(猫眼电影)

Python爬虫教程-11-proxy代理IP,隐藏地址(猫眼电影) ProxyHandler处理(代理服务器),使用代理IP,是爬虫的常用手段,通常使用UserAgent 伪装浏览器爬取仍然可能被网 ...

- Python爬虫教程-10-UserAgent和常见浏览器UA值

Python爬虫教程-10-UserAgent和常见浏览器UA值 有时候使用爬虫会被网站封了IP,所以需要去模拟浏览器,隐藏用户身份, UserAgent 包含浏览器信息,用户身份,设备系统信息 Us ...

- Python爬虫教程-09-error 模块

Python爬虫教程-09-error模块 今天的主角是error,爬取的时候,很容易出现错,所以我们要在代码里做一些,常见错误的处,关于urllib.error URLError URLError ...

随机推荐

- rest-assured之认证授权(Authentication)

rest-assured支持多种认证授权方案,比如:OAuth.digest(摘要认证).certificate(证书认证).form(表单认证)以及preemptive(抢占式基础认证)等.我们可以 ...

- 三种实现日志过滤器的方式 (过滤器 (Filter)、拦截器(Interceptors)和切面(Aspect))

1.建立RequestWrapper类 import com.g2.order.server.utils.HttpHelper; import java.io.BufferedReader; impo ...

- Python下使用 redis数据库

初识Rdeis数据库 简介 redis是一个key-value存储系统.和Memcached类似,它支持存储的value类型相对更多,包括string(字符串).list(链表).set(集合).zs ...

- Q481 神奇字符串

神奇的字符串 S 只包含 '1' 和 '2',并遵守以下规则: 字符串 S 是神奇的,因为串联字符 '1' 和 '2' 的连续出现次数会生成字符串 S 本身. 字符串 S 的前几个元素如下:S = & ...

- 使用virtualbox虚拟安装macos

需要工具: 虚拟机virtualbox:https://www.virtualbox.org/ empireEFIv1085.iso启动文件:http://yunpan.cn/c6UDGwL6wJm6 ...

- 使用maven构建多模块项目_记录

参照孤傲苍狼的博客:https://www.cnblogs.com/xdp-gacl/p/4242221.html 备注:博客中的生成语句,适用于maven3.0.5以上,若为3.0.5以下,则将cr ...

- cuda9.0 中不存在libnppi.so

编译一个caffe版本,报错找不到 -lnppi 发现使用打是cuda9.0, 但是cuda9.0 中不存在libnppi.so. 只好换成cuda8.0.

- reduce的用法

在不增加变量的情况下,统计数组中各元素出现的次数. ```jsfunction countItem (arr) { // 写入你的代码}countItem(['a', 'b', 'a', 'c', ' ...

- mysql故障总结

MYSQL故障排查 https://zhuanlan.zhihu.com/p/27834293

- Python爬虫抓取某音乐网站MP3(下载歌曲、存入Sqlite)

最近右胳膊受伤,打了石膏在家休息.为了实现之前的想法,就用左手打字.写代码,查资料完成了这个资源小爬虫.网页爬虫, 最主要的是协议分析(必须要弄清楚自己的目的),另外就是要考虑对爬取的数据归类,存储. ...