19.通过MAPREDUCE 把收集数据进行清洗

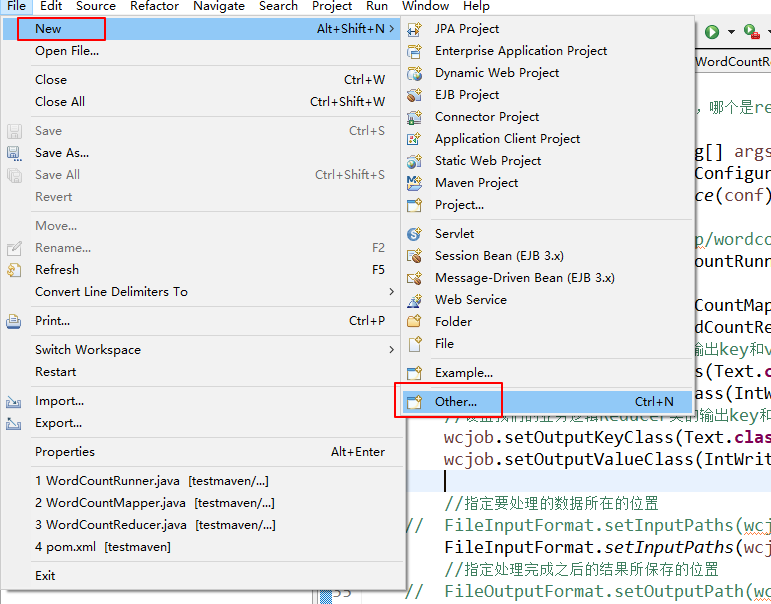

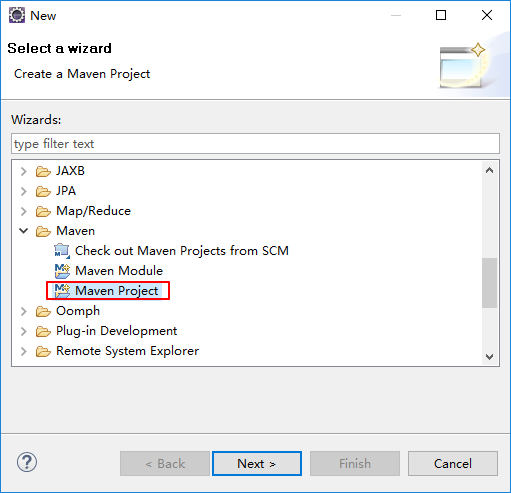

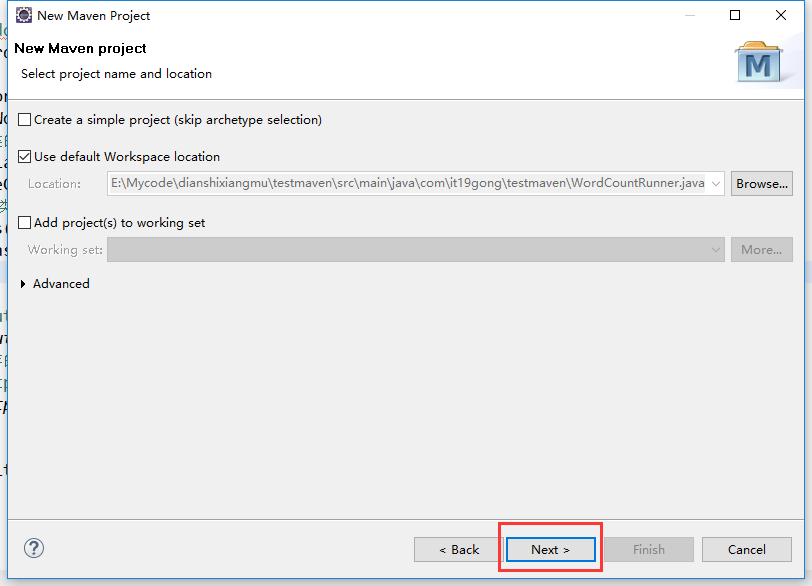

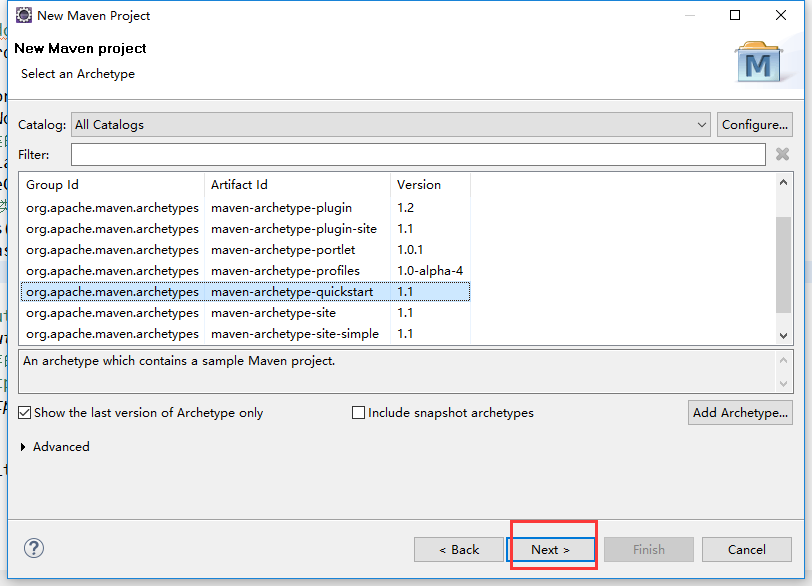

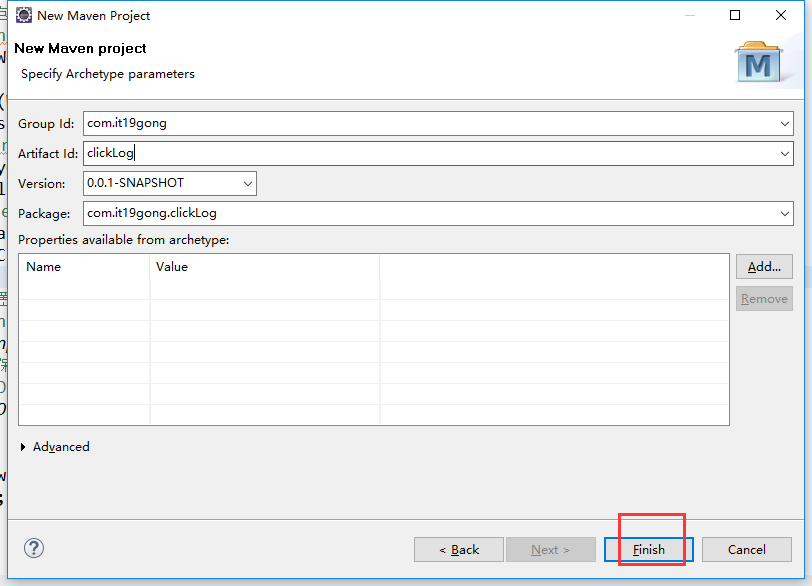

在eclipse软件里创建一个maven项目

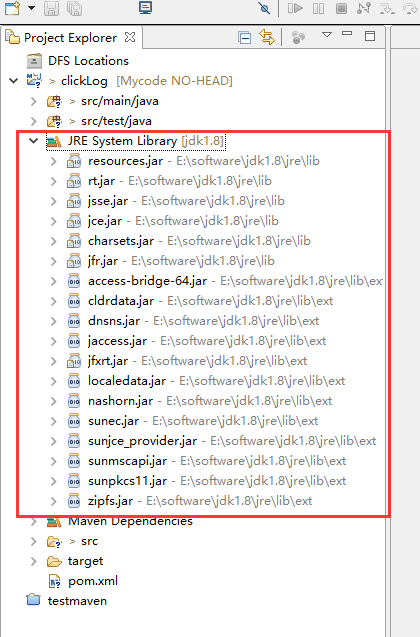

jdk要换成本地安装的1.8版本的

加载pom.xml文件

<project xmlns="http://maven.apache.org/POM/4.0.0" xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion> <groupId>com.it19gong</groupId>

<artifactId>clickLog</artifactId>

<version>0.0.1-SNAPSHOT</version>

<packaging>jar</packaging> <name>clickLog</name>

<url>http://maven.apache.org</url> <properties>

<project.build.sourceEncoding>UTF-8</project.build.sourceEncoding>

</properties> <dependencies>

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>3.8.1</version>

<scope>test</scope>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-common</artifactId>

<version>2.6.0</version>

</dependency> <dependency>

<groupId>jdk.tools</groupId>

<artifactId>jdk.tools</artifactId>

<version>1.8</version>

<scope>system</scope>

<systemPath>E:/software/jdk1.8/lib/tools.jar</systemPath>

</dependency> <dependency>

<groupId>org.apache.hive</groupId>

<artifactId>hive-jdbc</artifactId>

<version>2.1.0</version>

</dependency> <dependency>

<groupId>mysql</groupId>

<artifactId>mysql-connector-java</artifactId>

<version>5.1.33</version>

</dependency>

</dependencies> </project>

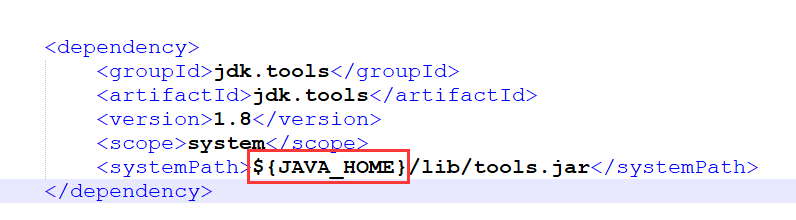

在加载依赖包的时候如果出现错误,在仓库里找不到1.8jdk.tools

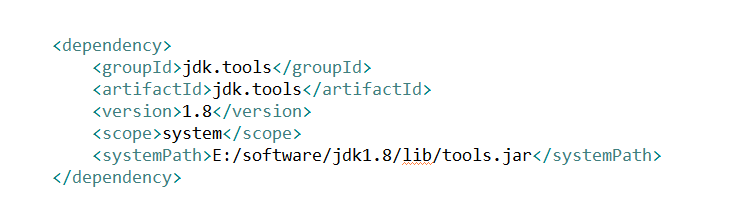

在这个地方改成本地的jdk绝对路径,再重新加载一次maven的依赖包

我这里修改成

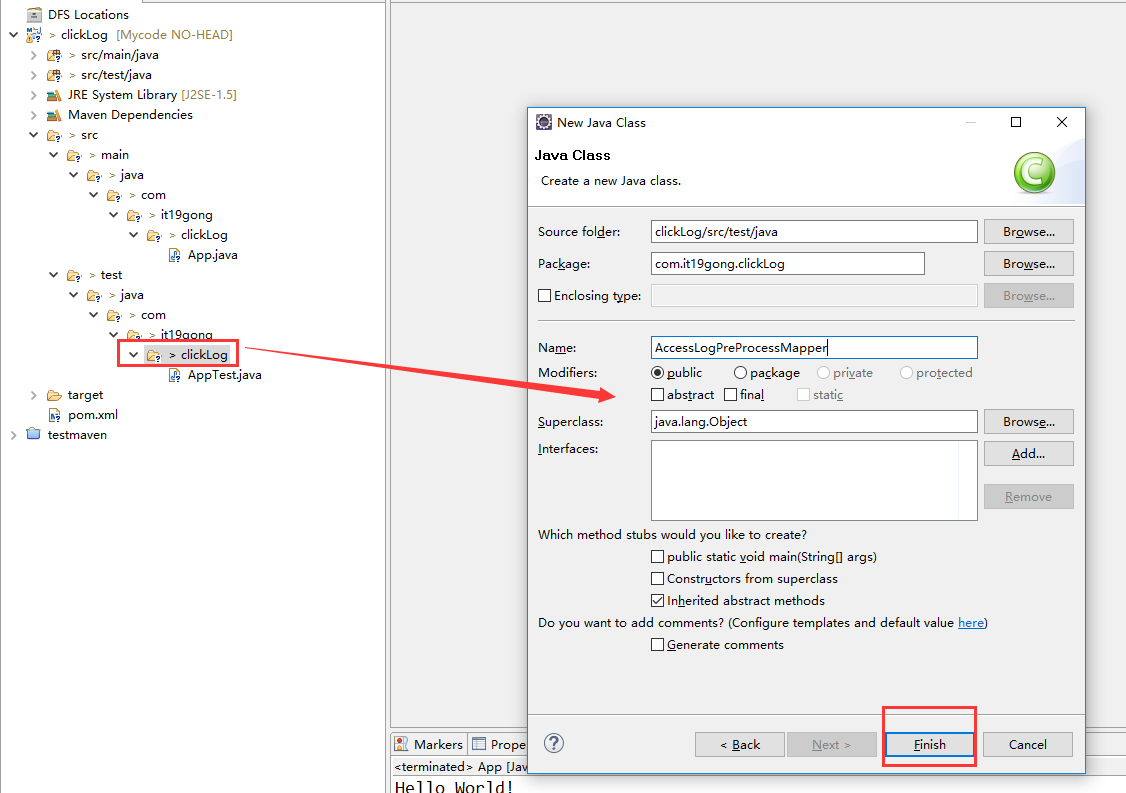

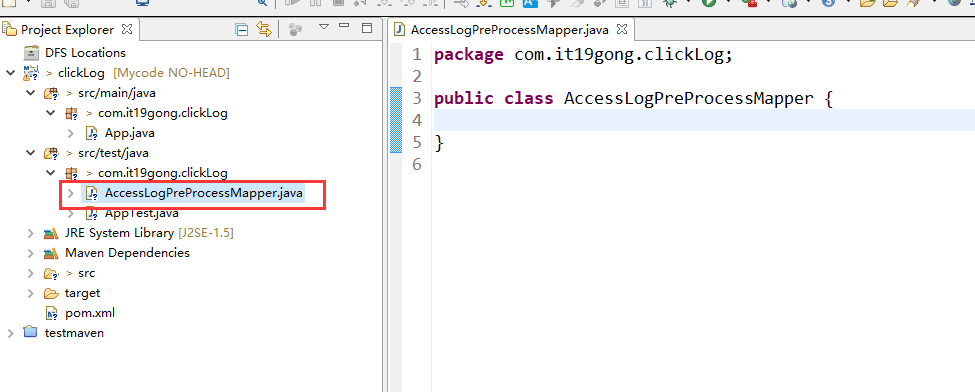

在项目下新建AccessLogPreProcessMapper类

package com.it19gong.clickLog; import java.io.IOException; import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper; public class AccessLogPreProcessMapper extends Mapper<LongWritable, Text, Text, NullWritable> {

Text text = new Text();

@Override

protected void map(LongWritable key, Text value,Context context)

throws IOException, InterruptedException {

String itr[] = value.toString().split(" ");

if (itr.length < 11)

{

return;

}

String ip = itr[0];

String date = AnalysisNginxTool.nginxDateStmpToDate(itr[3]);

String url = itr[6];

String upFlow = itr[9]; text.set(ip+","+date+","+url+","+upFlow);

context.write(text, NullWritable.get()); }

}

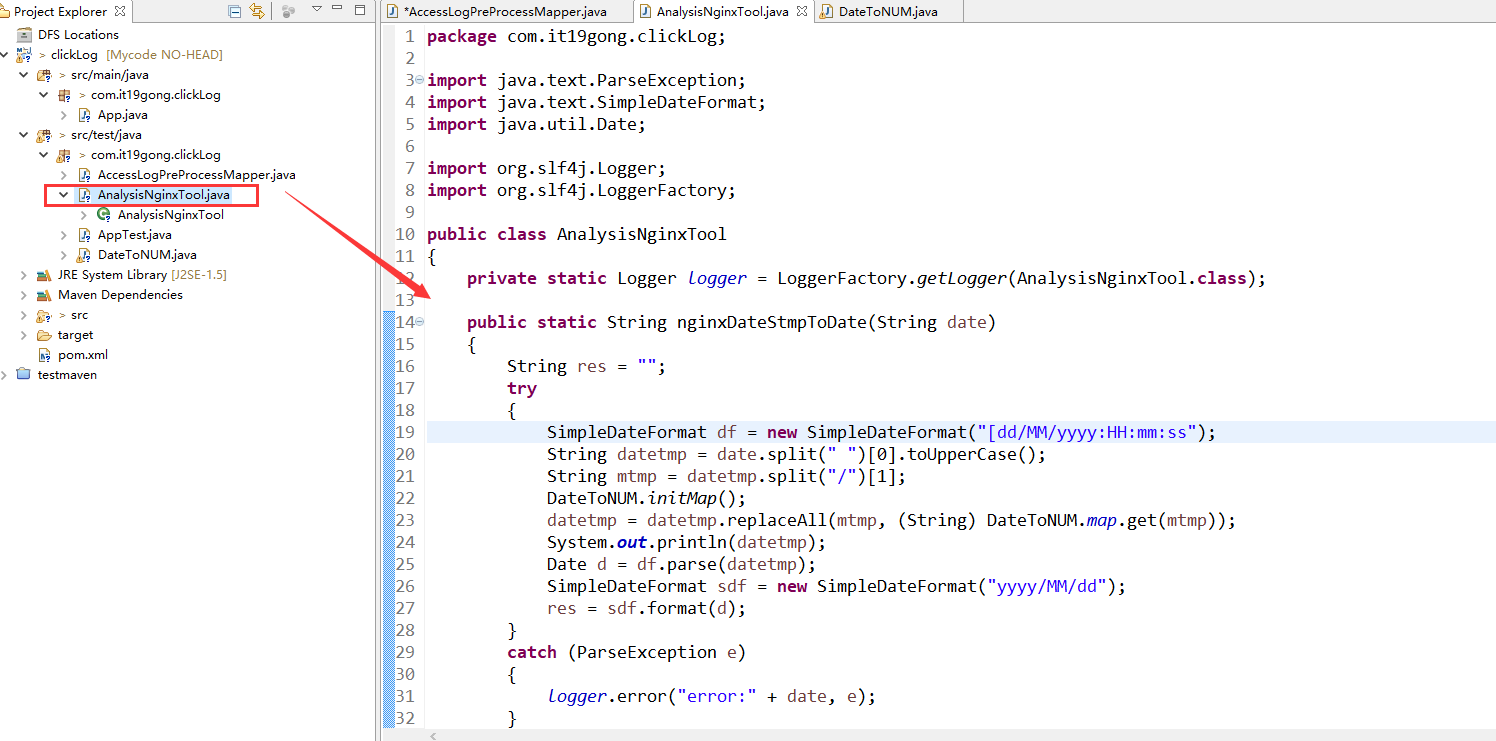

创建AnalysisNginxTool类

package com.it19gong.clickLog; import java.text.ParseException;

import java.text.SimpleDateFormat;

import java.util.Date; import org.slf4j.Logger;

import org.slf4j.LoggerFactory; public class AnalysisNginxTool

{

private static Logger logger = LoggerFactory.getLogger(AnalysisNginxTool.class); public static String nginxDateStmpToDate(String date)

{

String res = "";

try

{

SimpleDateFormat df = new SimpleDateFormat("[dd/MM/yyyy:HH:mm:ss");

String datetmp = date.split(" ")[0].toUpperCase();

String mtmp = datetmp.split("/")[1];

DateToNUM.initMap();

datetmp = datetmp.replaceAll(mtmp, (String) DateToNUM.map.get(mtmp));

System.out.println(datetmp);

Date d = df.parse(datetmp);

SimpleDateFormat sdf = new SimpleDateFormat("yyyy/MM/dd");

res = sdf.format(d);

}

catch (ParseException e)

{

logger.error("error:" + date, e);

}

return res;

} public static long nginxDateStmpToDateTime(String date)

{

long l = 0;

try

{

SimpleDateFormat df = new SimpleDateFormat("[dd/MM/yyyy:HH:mm:ss");

String datetmp = date.split(" ")[0].toUpperCase();

String mtmp = datetmp.split("/")[1];

datetmp = datetmp.replaceAll(mtmp, (String) DateToNUM.map.get(mtmp)); Date d = df.parse(datetmp);

l = d.getTime();

}

catch (ParseException e)

{

logger.error("error:" + date, e);

}

return l;

}

}

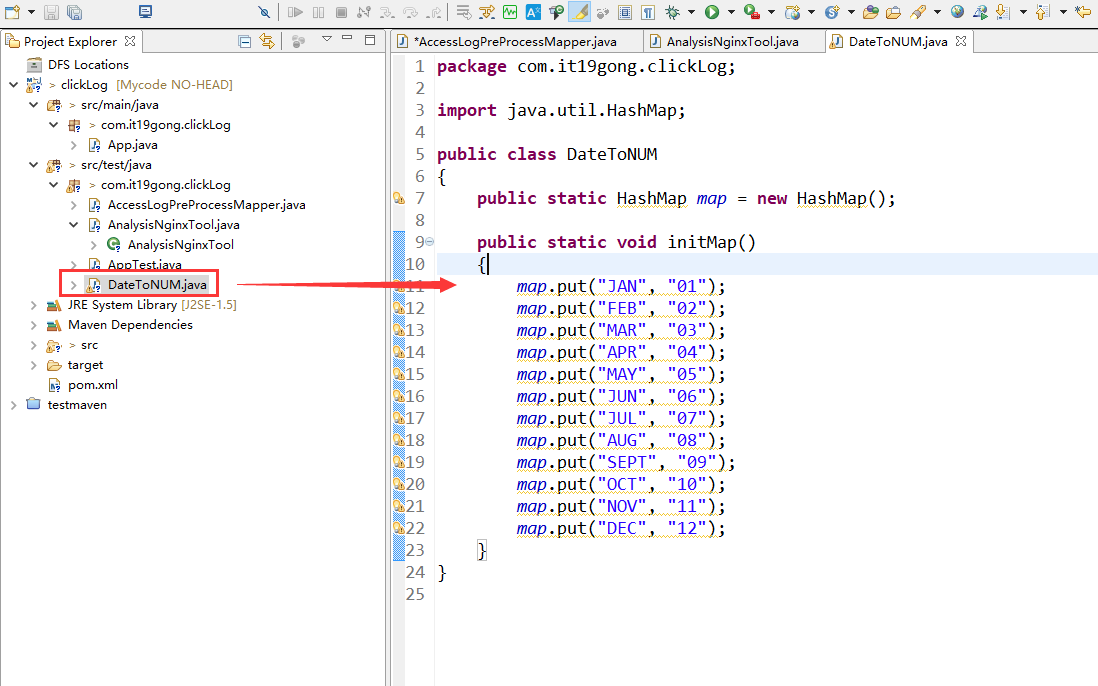

创建DateToNUM类

package com.it19gong.clickLog; import java.util.HashMap; public class DateToNUM

{

public static HashMap map = new HashMap(); public static void initMap()

{

map.put("JAN", "01");

map.put("FEB", "02");

map.put("MAR", "03");

map.put("APR", "04");

map.put("MAY", "05");

map.put("JUN", "06");

map.put("JUL", "07");

map.put("AUG", "08");

map.put("SEPT", "09");

map.put("OCT", "10");

map.put("NOV", "11");

map.put("DEC", "12");

}

}

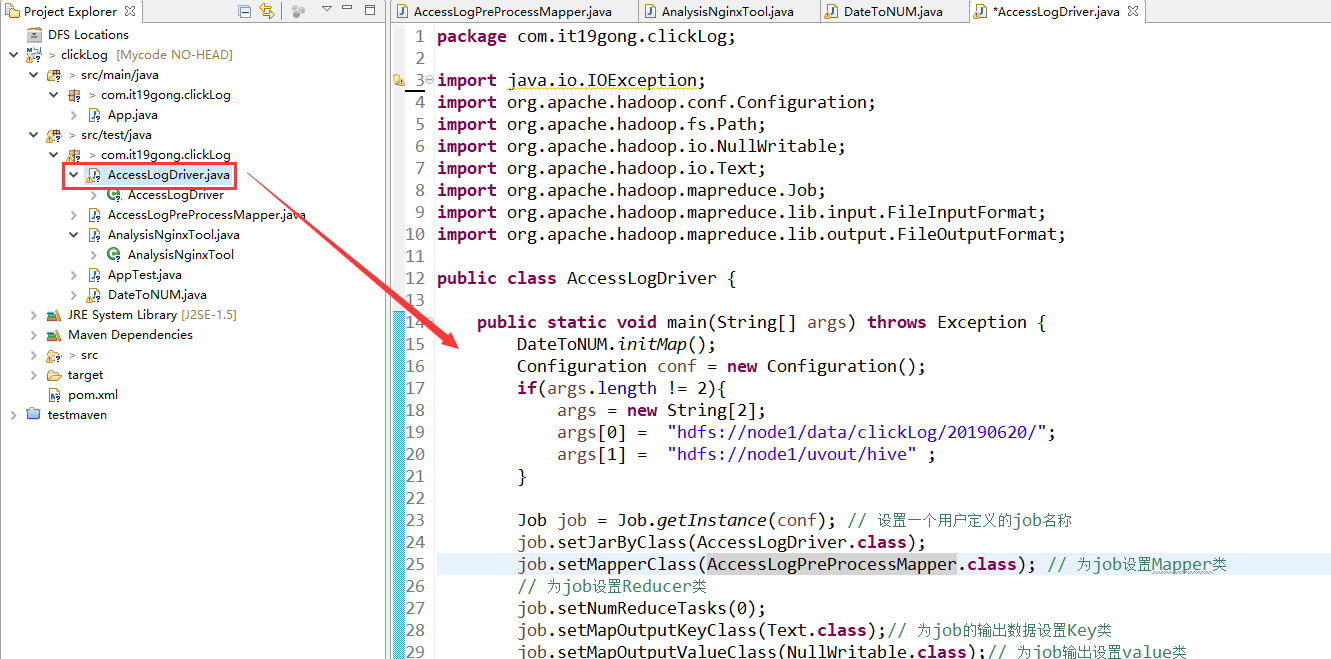

新建AccessLogDriver类

package com.it19gong.clickLog; import java.io.IOException;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat; public class AccessLogDriver { public static void main(String[] args) throws Exception {

DateToNUM.initMap();

Configuration conf = new Configuration();

if(args.length != 2){

args = new String[2];

args[0] = "hdfs://node1/data/clickLog/20190620/";

args[1] = "hdfs://node1/uvout/hive" ;

} Job job = Job.getInstance(conf); // 设置一个用户定义的job名称

job.setJarByClass(AccessLogDriver.class);

job.setMapperClass(AccessLogPreProcessMapper.class); // 为job设置Mapper类

// 为job设置Reducer类

job.setNumReduceTasks(0);

job.setMapOutputKeyClass(Text.class);// 为job的输出数据设置Key类

job.setMapOutputValueClass(NullWritable.class);// 为job输出设置value类

FileInputFormat.addInputPath(job, new Path(args[0])); // 为job设置输入路径

FileOutputFormat.setOutputPath(job, new Path(args[1]));// 为job设置输出路径

System.exit(job.waitForCompletion(true) ? 0 : 1); // 运行job

} }

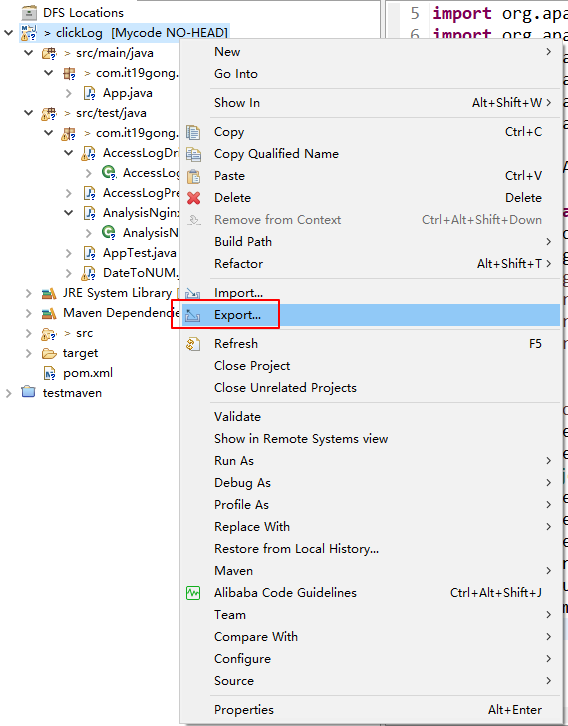

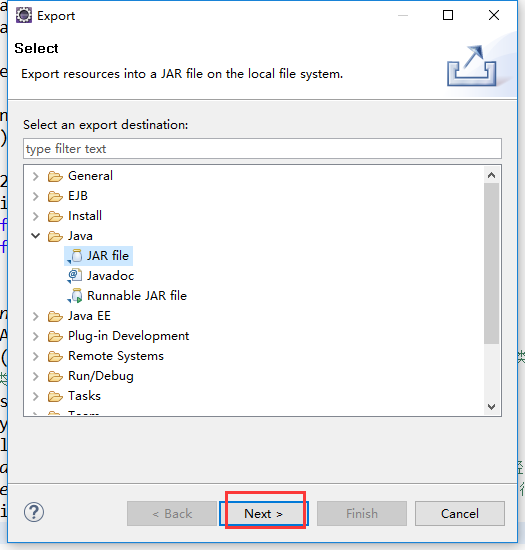

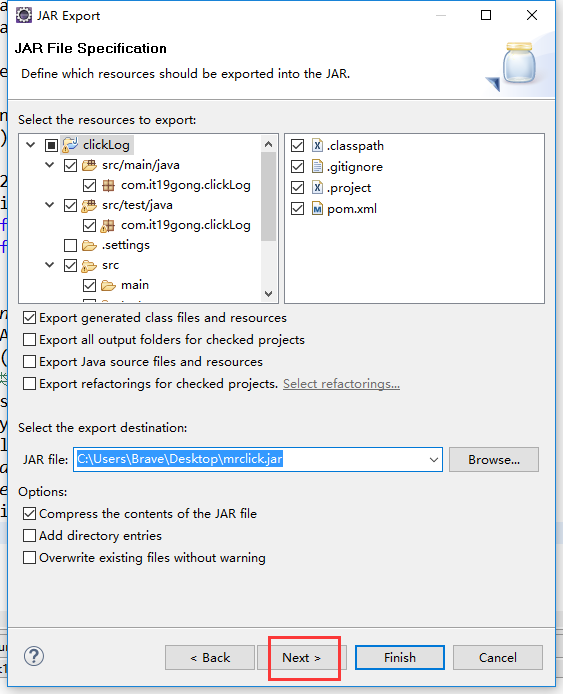

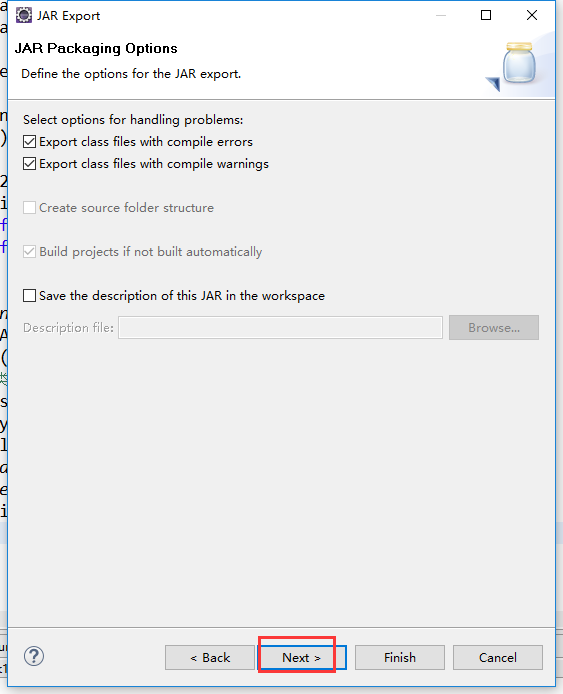

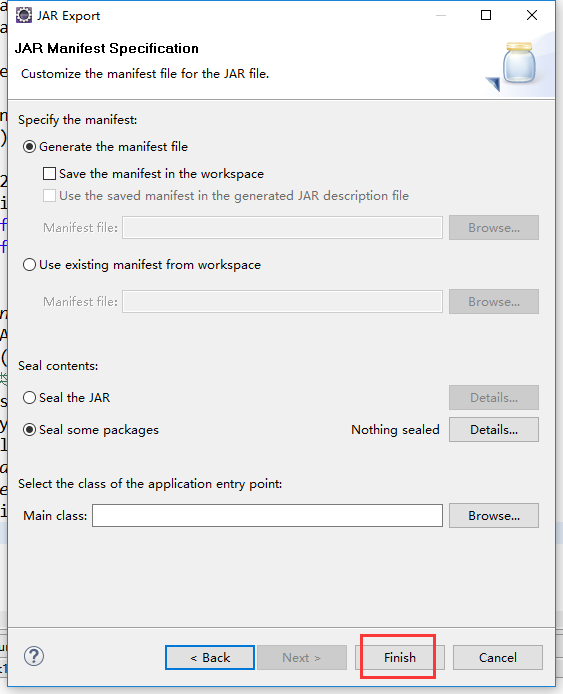

把工程打包成Jar包

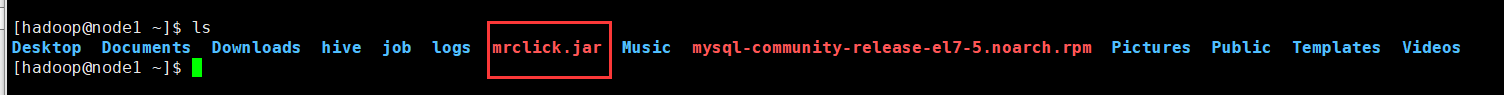

把jar包上传到集群

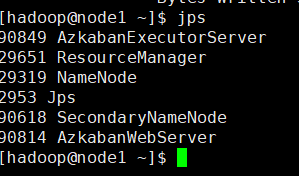

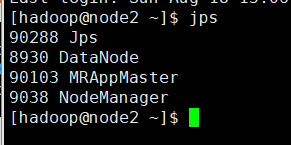

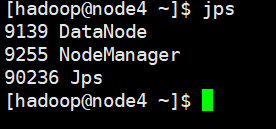

在集群上运行一下,先检查一下集群的启动进程

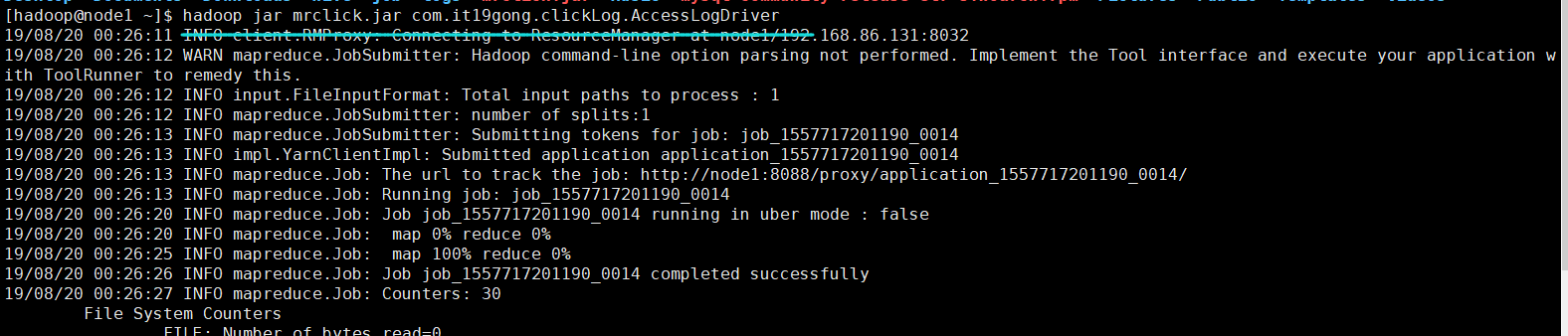

hadoop jar mrclick.jar com.it19gong.clickLog.AccessLogDriver

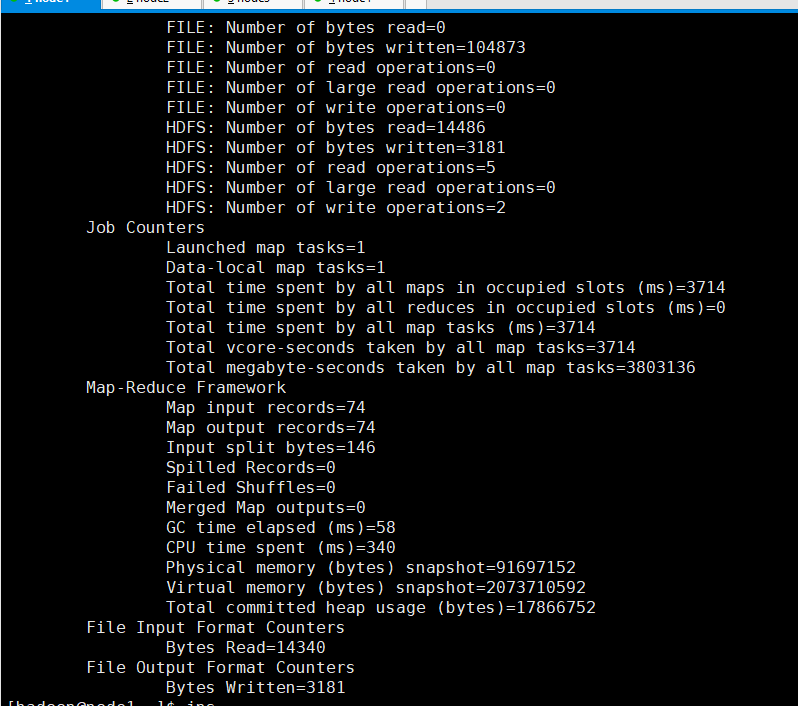

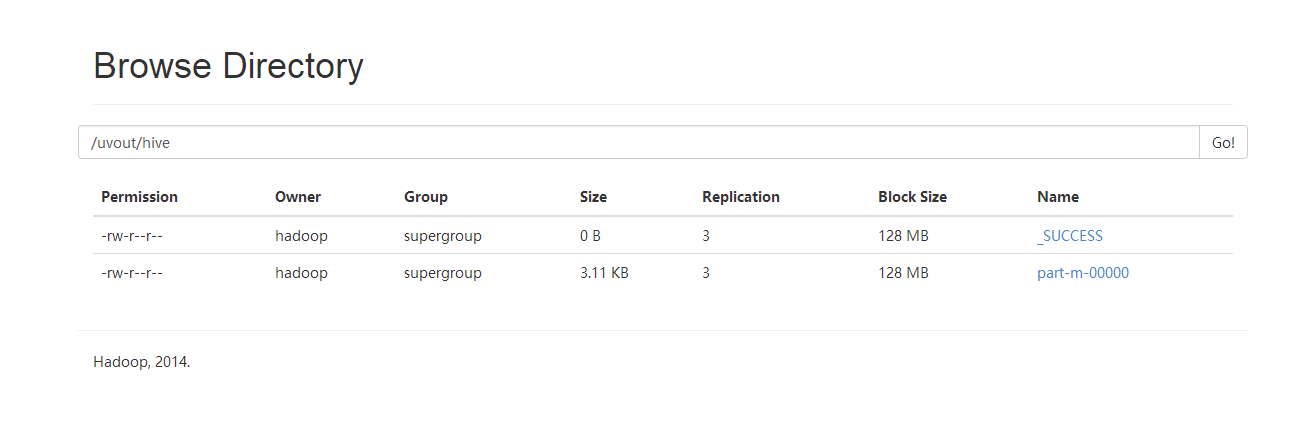

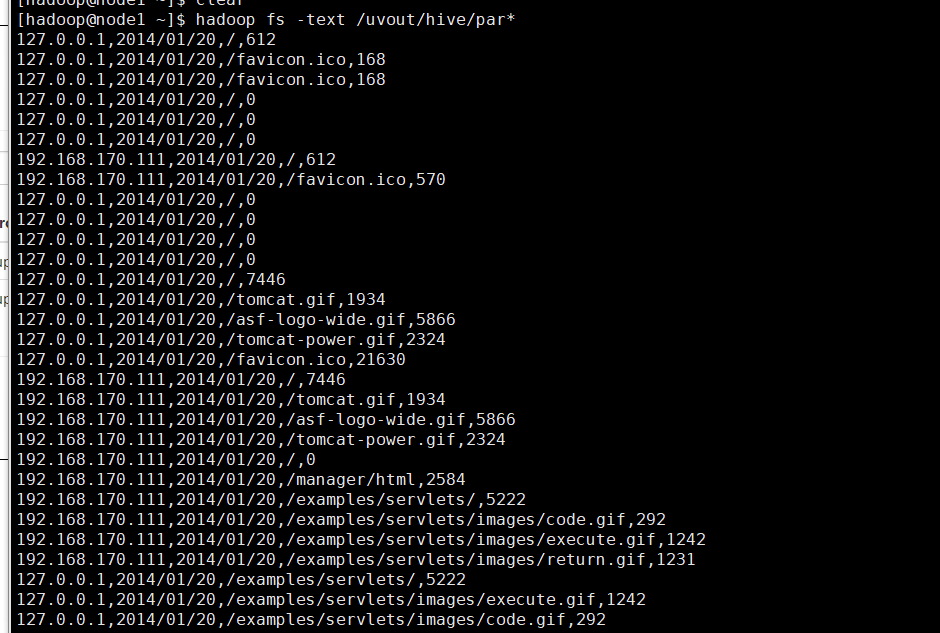

可以看到输出目录

查看清洗后的数据

19.通过MAPREDUCE 把收集数据进行清洗的更多相关文章

- Hadoop 中利用 mapreduce 读写 mysql 数据

Hadoop 中利用 mapreduce 读写 mysql 数据 有时候我们在项目中会遇到输入结果集很大,但是输出结果很小,比如一些 pv.uv 数据,然后为了实时查询的需求,或者一些 OLAP ...

- Hadoop生态圈-使用MapReduce处理HBase数据

Hadoop生态圈-使用MapReduce处理HBase数据 作者:尹正杰 版权声明:原创作品,谢绝转载!否则将追究法律责任. 一.对HBase表中数据进行单词统计(TableInputFormat) ...

- 使用MapReduce将HDFS数据导入Mysql

使用MapReduce将Mysql数据导入HDFS代码链接 将HDFS数据导入Mysql,代码示例 package com.zhen.mysqlToHDFS; import java.io.DataI ...

- 使用MapReduce将mysql数据导入HDFS

package com.zhen.mysqlToHDFS; import java.io.DataInput; import java.io.DataOutput; import java.io.IO ...

- 使用hadoop mapreduce分析mongodb数据

使用hadoop mapreduce分析mongodb数据 (现在很多互联网爬虫将数据存入mongdb中,所以研究了一下,写此文档) 版权声明:本文为yunshuxueyuan原创文章.如需转载请标明 ...

- 【原创】MapReduce备份Elasticsearch数据到HDFS(JAVA)

一.环境:JAVA8,Elasticsearch-5.6.2,Hadoop-2.8.1二.实现功能:mapreduce读elasticsearch数据.输出parquet文件.多输出路径三.主要依赖 ...

- Java 8 (5) Stream 流 - 收集数据

在前面已经使用过collect终端操作了,主要是用来把Stream中的所有元素结合成一个List,在本章中,你会发现collect是一个归约操作,就像reduce一样可以接受各种做法作为参数,将流中的 ...

- java8中用流收集数据

用流收集数据 汇总 long howManyDishes = menu.stream().collect(Collectors.counting()); int totalCalories = men ...

- 《Java 8 in Action》Chapter 6:用流收集数据

1. 收集器简介 collect() 接收一个类型为 Collector 的参数,这个参数决定了如何把流中的元素聚合到其它数据结构中.Collectors 类包含了大量常用收集器的工厂方法,toLis ...

随机推荐

- 宽字符(UNICODE)字符集

推荐使用宽字符(UNICODE)字符集,严格使用宽字符集的函数和定义.具体参考https://blog.csdn.net/qq_22642239/article/details/84822485

- IDEA Java

目录 1 配置 2 常用快捷键 3 安装插件 4 使用Maven创建web项目 5 使用Maven导入依赖 6 Maven创建项目后缺少文件夹 7 Tomcat LocalHost Log消失 8 E ...

- PHP mysqli_multi_query() 函数

实例 执行多个针对数据库的查询: <?php $con=mysqli_connect("localhost","my_user","my_pas ...

- linux 搜索文件夹下的所有文件内容

find . -type f -name "*.*" | xargs grep "博客园"

- Python - 默认参数传参陷阱

def extend_list(v, li=[]): li.append(v) return li list1 = extend_list(10) print(list1) # [10] list2 ...

- Linux终端中文显示乱码

今天,帮我们同学处理一下中文显示乱码的问题.这个是个国内Linux用户烦恼的问题,由于大部分的Linux发行版都是以英语为主体的,而且英文在通用性和稳定性上都比中文要好一些,各种奇怪的BUG也要少一点 ...

- 两个input之间有空隙,处理方法

修改css,给前边一个input添加一个左浮动. <input id="day" type="button" value="日" ...

- ftp服务器不能上传文件故障

1.在客户端lftp命令无法put文件 原因:登陆用户无法读写 ftp服务器的文件夹,在服务器上增加权限 chmod 777 即可 还有一种方法:在 vsftp的配置文件里,设置可匿名读写

- 一百二十三:CMS系统之登录功能

配置文件中加入前台用户的身份标识 form class SigninForm(BaseForm): telephone = StringField(validators=[Regexp(r'1[345 ...

- 如何使用delphi将Clientdataset的Delta保存到数据库中

[delphi] view plain copy //ATableName-表名, AKeyField-主键,多个主键用;隔开,如 ;pid;times; from:unit HlsImplBase; ...