requests,lxml爬启信宝

首先,

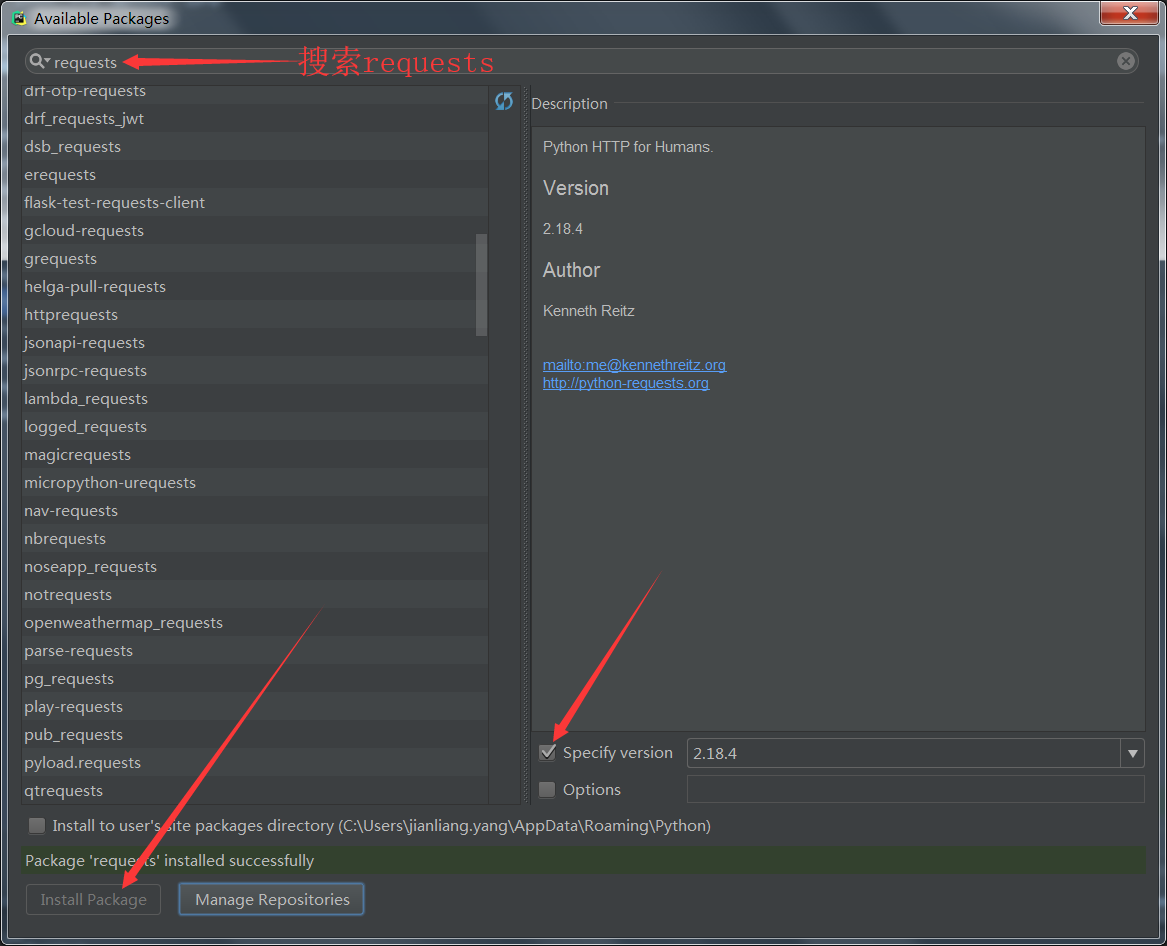

添加requests模块:

然后,

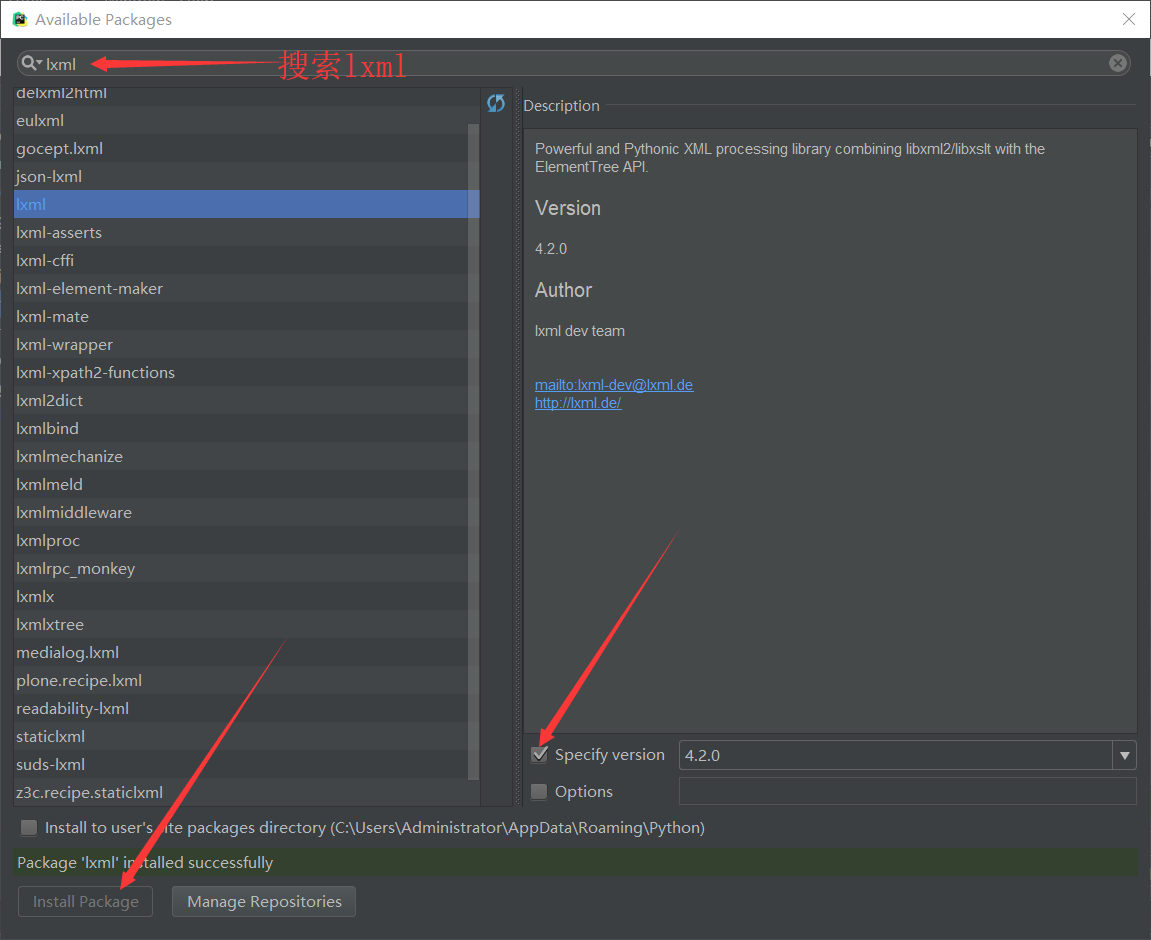

添加lxml模块:

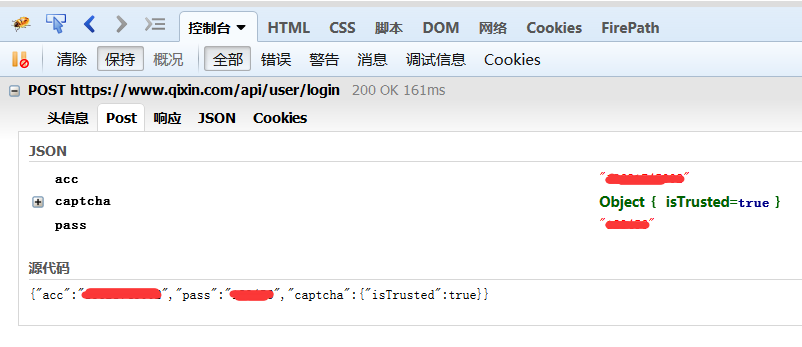

启信宝登录抓包:

QiXinBao.py:

import requests

from lxml import etree loginUrl = "https://www.qixin.com/api/user/login"

# 启信宝登录接口

homePage = "https://www.qixin.com"

# 启信宝首页 headers = {"Accept": "application/json, text/plain, */*",

"Accept-Encoding": "gzip, deflate, br",

"Accept-Language": "zh-CN,zh;q=0.8,en-US;q=0.5,en;q=0.3",

"Content-Length": "66",

"Content-Type": "application/json;charset=utf-8",

"Host": "www.qixin.com",

"Referer": "https://www.qixin.com/auth/login?return_url=%2Fnew-vip",

"User-Agent": "Mozilla/5.0 (Windows NT 6.1; Win64; x64; rv:52.0) Gecko/20100101 Firefox/52.0",

"X-Requested-With": "XMLHttpRequest",

"dc49417fe4f34f86b0fe": "44282ce68be84e73f8eb4d2a4d4b32c02e8e84970160b2d6829c6b8a5380483e50ec708bc38040dd715d283dfac3123cf422ecff2fe4977c8624e457c5046959"

}

# 请求头(伪装成浏览器)

parameter = {"acc": "13688888888", "pass": "000000", "captcha": {"isTrusted": True}}

# 请求体 session = requests.Session()

# 保持会话

response_1 = session.post(loginUrl, headers=headers, json=parameter, timeout=5)

# 登录

print(response_1.status_code)

# 打印响应码 response_2 = session.get(homePage).content

# 打开启信宝首页

page_2 = etree.HTML(response_2)

link = page_2.xpath("//html/body/div[1]/div[4]/div/div[2]/div/div[1]/div[1]/a//@href")

companyUrl = homePage+link[0]

# 获取第一家公司的URL response_3 = session.get(companyUrl).content

# 打开第一家公司

page_3 = etree.HTML(response_3)

companyName = page_3.xpath("//html/body/div[6]/div/div[2]/div/div/h4//text()")

# 获取公司名称

code_1 = page_3.xpath("//*[@id='icinfo']/table/tbody/tr[1]/td[2]//text()")

# 获取统一社会信用代码

code_2 = page_3.xpath("//*[@id='icinfo']/table/tbody/tr[2]/td[2]//text()")

# 获取注册号 print(companyName[0]+"\n"+code_1[0]+"\n"+code_2[0])

requests,lxml爬启信宝的更多相关文章

- selenium + ChromeDriver 实战系列之启信宝(一)

之前写了一篇selenium + ChromeDriver的一些入门的知识,这篇博客里面找了启信宝这个网站,简单的进行了一个实战练习.本篇博客的结构如下: 首先会给出一些使用seleniu ...

- requests+lxml+xpath爬取豆瓣电影

(1)lxml解析html from lxml import etree #创建一个html对象 html=stree.HTML(text) result=etree.tostring(html,en ...

- 爬虫系列2:Requests+Xpath 爬取租房网站信息

Requests+Xpath 爬取租房网站信息 [抓取]:参考前文 爬虫系列1:https://www.cnblogs.com/yizhiamumu/p/9451093.html [分页]:参考前文 ...

- <day003>登录+爬取淘宝商品信息+字典用json存储

任务1:利用cookie可以免去登录的烦恼(验证码) ''' 只需要有登录后的cookie,就可以绕过验证码 登录后的cookie可以通过Selenium用第三方(微博)进行登录,不需要进行淘宝的滑动 ...

- [实战演练]python3使用requests模块爬取页面内容

本文摘要: 1.安装pip 2.安装requests模块 3.安装beautifulsoup4 4.requests模块浅析 + 发送请求 + 传递URL参数 + 响应内容 + 获取网页编码 + 获取 ...

- 利用Python爬虫爬取淘宝商品做数据挖掘分析实战篇,超详细教程

项目内容 本案例选择>> 商品类目:沙发: 数量:共100页 4400个商品: 筛选条件:天猫.销量从高到低.价格500元以上. 项目目的 1. 对商品标题进行文本分析 词云可视化 2. ...

- 爬虫系列1:Requests+Xpath 爬取豆瓣电影TOP

爬虫1:Requests+Xpath 爬取豆瓣电影TOP [抓取]:参考前文 爬虫系列1:https://www.cnblogs.com/yizhiamumu/p/9451093.html [分页]: ...

- 利用Selenium爬取淘宝商品信息

一. Selenium和PhantomJS介绍 Selenium是一个用于Web应用程序测试的工具,Selenium直接运行在浏览器中,就像真正的用户在操作一样.由于这个性质,Selenium也是一 ...

- python爬虫学习(三):使用re库爬取"淘宝商品",并把结果写进txt文件

第二个例子是使用requests库+re库爬取淘宝搜索商品页面的商品信息 (1)分析网页源码 打开淘宝,输入关键字“python”,然后搜索,显示如下搜索结果 从url连接中可以得到搜索商品的关键字是 ...

随机推荐

- 第三章.搭建MyBatis工程环境

1.数据库的准备: 数据库: create DATABASE mybatis: 数据表: CREATE TABLE `user` ( `id` int(10) NOT NULL AUTO_INCREM ...

- Linux网络配置&进程管理

原理图 查看ip和网关

- 装饰模式案列(OutputStream)

使用装饰模式进行装饰OutputStream 写入文件成功 装饰类继承OutputStream类 DecorOutputStream package com.wbg.springRedis.decor ...

- vue使用element案列

第一步:使用vue创建项目‘ 第二步:在项目添加element cmd:vue add element demo:https://github.com/weibanggang/vuemode.git

- 最长公共子序列问题LCS

最长公共子序列问题 在这里介绍一种在动态规划中类似于板子题的类型 : 最长公共子序列问题.(Link) 首先来看题面:给出1-n的两个排列P1和P2,求它们的最长公共子序列. 我们看到题之后的第一个想 ...

- 【题解】洛谷P1514 [NOIP2010TG] 引水入城(DFS+DP)

次元传送门:洛谷P1514 思路 可以证明如果有解 那么每个蓄水池可以覆盖到的干旱区必定是线段 证明: 举个栗子 8 9 8 7 9 7 6 9 6 明显到不了中间的点 如果不是连续的线段 中间肯定有 ...

- OSTimeDlyHMSM函数

1.os_time.c里面 #if OS_TIME_DLY_HMSM_EN > 0 INT8U OSTimeDlyHMSM (INT8U hours, INT8U minutes, INT8U ...

- write函数过程解析

write函数作为用户向终端或者文件进行写数据的重要函数,有着重要的作用. |------| |---------| |---------| |----------| | wri ...

- ABI是什么? Swift ABI稳定有什么好处?

ABI是什么? 在软件开发中, 应用程序机器二元码界面(Application Binary Interface 简称ABI)指两个程序模块间的接口; 通常其中一个车还给你徐模块会是库或者操作系统提供 ...

- Python基础 List和Tuple类型

python 创建list python 内置一种数据类型是列表: 列表是一种有序的集合,可以随时添加和 删除其中的元素,list 中的元素是按照顺序排列的.构建list 直接用 [ ], list ...