scrapy-splash抓取动态数据例子七

一、介绍

本例子用scrapy-splash抓取36氪网站给定关键字抓取咨询信息。

给定关键字:个性化;融合;电视

抓取信息内如下:

1、资讯标题

2、资讯链接

3、资讯时间

4、资讯来源

二、网站信息

三、数据抓取

针对上面的网站信息,来进行抓取

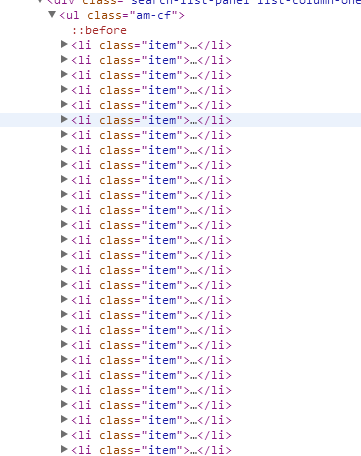

1、首先抓取信息列表

抓取代码:sels = site.xpath('//li[@class="item"]')

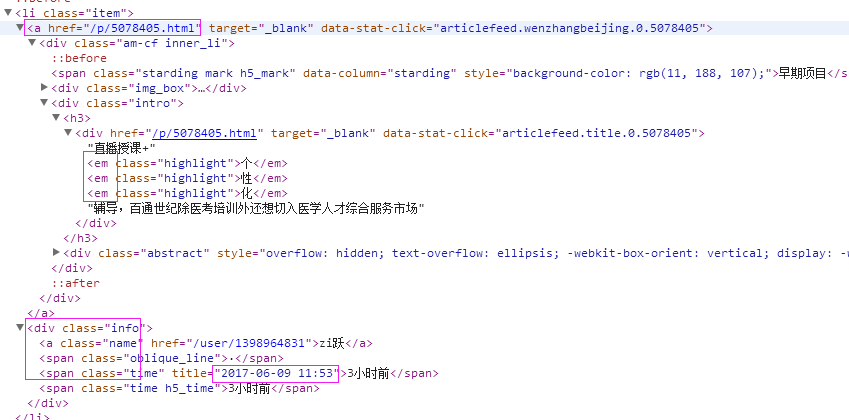

2、抓取标题

首先列表页面,根据标题和日期来判断是否自己需要的资讯,如果是,就今日到资讯对应的链接,来抓取来源,如果不是,就不用抓取了

抓取代码:titles = site.xpath('//div[@class="mobile_article"]/h1/text()')

3、抓取链接

抓取代码:url = 'http://36kr.com' + str(sel.xpath('.//a/@href')[0].extract())

4、抓取日期

抓取代码:dates = sel.xpath('.//div[@class="info"]/span[2]/@title')

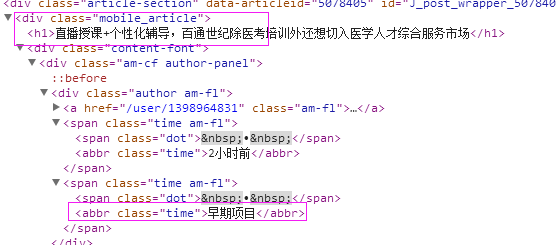

5、抓取来源

抓取代码:sources = site.xpath('//div[@class="author am-fl"]/span[2]/abbr/text()')

四、完整代码

# -*- coding: utf-8 -*-

import scrapy

from scrapy import Request

from scrapy.spiders import Spider

from scrapy_splash import SplashRequest

from scrapy_splash import SplashMiddleware

from scrapy.http import Request, HtmlResponse

from scrapy.selector import Selector

from scrapy_splash import SplashRequest

from splash_test.items import SplashTestItem

import IniFile

import sys

import os

import re

import time reload(sys)

sys.setdefaultencoding('utf-8') # sys.stdout = open('output.txt', 'w') class kr36Spider(Spider):

name = 'kr36' configfile = os.path.join(os.getcwd(), 'splash_test\spiders\setting.conf') cf = IniFile.ConfigFile(configfile)

information_keywords = cf.GetValue("section", "information_keywords")

information_wordlist = information_keywords.split(';')

websearchurl = cf.GetValue("kr36", "websearchurl")

start_urls = []

for word in information_wordlist:

print websearchurl + word

start_urls.append(websearchurl + word) # request需要封装成SplashRequest

def start_requests(self):

for url in self.start_urls:

index = url.rfind('/')

yield SplashRequest(url

, self.parse

, args={'wait': ''},

meta={'keyword': url[index + 1:]}

) def Comapre_to_days(self,leftdate, rightdate):

'''

比较连个字符串日期,左边日期大于右边日期多少天

:param leftdate: 格式:2017-04-15

:param rightdate: 格式:2017-04-15

:return: 天数

'''

l_time = time.mktime(time.strptime(leftdate, '%Y-%m-%d'))

r_time = time.mktime(time.strptime(rightdate, '%Y-%m-%d'))

result = int(l_time - r_time) / 86400

return result def date_isValid(self, strDateText): currentDate = time.strftime('%Y-%m-%d')

datePattern = re.compile(r'\d{4}-\d{1,2}-\d{1,2}')

strDate = re.findall(datePattern, strDateText)

if len(strDate) == 1:

if self.Comapre_to_days(currentDate, strDate[0]) == 0:

return True, currentDate

return False, '' def parse(self, response):

site = Selector(response)

sels = site.xpath('//li[@class="item"]')

for sel in sels:

dates = sel.xpath('.//div[@class="info"]/span[2]/@title')

flag,date =self.date_isValid(dates[0].extract())

titles = sel.xpath('.//div[@class="intro"]/h3/div/em')#如果没有em标签,说明标题中没有搜索的关键字,这样直接就过滤掉了

if flag and len(titles)>0 :

url = 'http://36kr.com' + str(sel.xpath('.//a/@href')[0].extract())

yield SplashRequest(url

, self.parse_item

, args={'wait': ''},

meta={'date': date, 'url': url,

'keyword': response.meta['keyword']}

) def parse_item(self, response):

site = Selector(response)

titles = site.xpath('//div[@class="mobile_article"]/h1/text()')

if len(titles) > 0:

it = SplashTestItem()

keyword = response.meta['keyword']

title = titles[0].extract() it['title'] = title

it['url'] = response.meta['url']

it['date'] = response.meta['date']

it['keyword'] = response.meta['keyword']

sources = site.xpath('//div[@class="author am-fl"]/span[2]/abbr/text()')

if len(sources) > 0:

it['source'] = sources[0].extract()

return it

scrapy-splash抓取动态数据例子七的更多相关文章

- scrapy-splash抓取动态数据例子一

目前,为了加速页面的加载速度,页面的很多部分都是用JS生成的,而对于用scrapy爬虫来说就是一个很大的问题,因为scrapy没有JS engine,所以爬取的都是静态页面,对于JS生成的动态页面都无 ...

- scrapy-splash抓取动态数据例子八

一.介绍 本例子用scrapy-splash抓取界面网站给定关键字抓取咨询信息. 给定关键字:个性化:融合:电视 抓取信息内如下: 1.资讯标题 2.资讯链接 3.资讯时间 4.资讯来源 二.网站信息 ...

- scrapy-splash抓取动态数据例子六

一.介绍 本例子用scrapy-splash抓取中广互联网站给定关键字抓取咨询信息. 给定关键字:打通:融合:电视 抓取信息内如下: 1.资讯标题 2.资讯链接 3.资讯时间 4.资讯来源 二.网站信 ...

- scrapy-splash抓取动态数据例子五

一.介绍 本例子用scrapy-splash抓取智能电视网网站给定关键字抓取咨询信息. 给定关键字:打通:融合:电视 抓取信息内如下: 1.资讯标题 2.资讯链接 3.资讯时间 4.资讯来源 二.网站 ...

- scrapy-splash抓取动态数据例子四

一.介绍 本例子用scrapy-splash抓取微众圈网站给定关键字抓取咨询信息. 给定关键字:打通:融合:电视 抓取信息内如下: 1.资讯标题 2.资讯链接 3.资讯时间 4.资讯来源 二.网站信息 ...

- scrapy-splash抓取动态数据例子三

一.介绍 本例子用scrapy-splash抓取今日头条网站给定关键字抓取咨询信息. 给定关键字:打通:融合:电视 抓取信息内如下: 1.资讯标题 2.资讯链接 3.资讯时间 4.资讯来源 二.网站信 ...

- scrapy-splash抓取动态数据例子二

一.介绍 本例子用scrapy-splash抓取一点资讯网站给定关键字抓取咨询信息. 给定关键字:打通:融合:电视 抓取信息内如下: 1.资讯标题 2.资讯链接 3.资讯时间 4.资讯来源 二.网站信 ...

- scrapy-splash抓取动态数据例子十六

一.介绍 本例子用scrapy-splash爬取梅花网(http://www.meihua.info/a/list/today)的资讯信息,输入给定关键字抓取微信资讯信息. 给定关键字:数字:融合:电 ...

- scrapy-splash抓取动态数据例子十五

一.介绍 本例子用scrapy-splash爬取电视之家(http://www.tvhome.com/news/)网站的资讯信息,输入给定关键字抓取微信资讯信息. 给定关键字:数字:融合:电视 抓取信 ...

随机推荐

- AC日记——[SDOI2017]相关分析 洛谷 P3707

[SDOI2017]相关分析 思路: 裸线段树: (玄学ac): 代码: #include <bits/stdc++.h> using namespace std; #define max ...

- Introducing the Filter Types

The ActionFilterAttribute class implements both the IActionFilter and IResultFilter interfaces. This ...

- nginx代理缓存

(1)缓存介绍 1.代理服务器端缓存作用 减少后端压力,提高网站并发延时 2.缓存常见类型 服务器端缓存:代理缓存,获取服务器端内容进行缓存 浏览器端缓存 3.nginx代理缓存:proxy_cach ...

- python之md5模块

python的md5模块使用非常简单,包括以下几个函数: md5.new([arg]) 返回一个md5对象,如果给出参数,则相当于调用了update(arg) md5.updte(arg) 用stri ...

- Java工具类-格式化日期

package common; import java.text.SimpleDateFormat; import java.util.Date; import java.util.Locale; p ...

- 洛谷P3038 牧草种植 [树链剖分]

题目传送门 牧草种植 题目描述 Farmer John has N barren pastures (2 <= N <= 100,000) connected by N-1 bidirec ...

- 洛谷P1514 引水入城 [搜索,区间DP]

题目传送门 引水入城 题目描述 在一个遥远的国度,一侧是风景秀美的湖泊,另一侧则是漫无边际的沙漠.该国的行政区划十分特殊,刚好构成一个 N 行×M 列的矩形,如上图所示,其中每个格子都代表一座城市,每 ...

- 第5天:Ansible-Playbook

Ansible中的每个模块专注于某一方面的功能.虽然每个模块实现的功能都比较简单,但是,将各个模块结合起来就可以实现比较复杂的功能.在Ansible中,将各个模块组合起来的文件是一个YAML格式的配置 ...

- Flask实战第54天:cms删除轮播图功能完成

后台逻辑 编辑cms.views.py @bp.route('/dbanner/',methods=['POST']) @login_required def dbanner(): banner_id ...

- 在spring中手动编写事务

利用事务模板TransactionTemplate来手动添加事务 public void addRant(Rant rant) { transactionTemplate.execute(-?tran ...