(19)python scrapy框架

安装scrapy

pycharm 建个纯python工程

settings里

环境变量设置

C:\Python27;C:\Python27\Scripts;

下载win32api

https://sourceforge.net/projects/pywin32/files/pywin32/

找到对应版本安装

import win32api

导入不报错就按成功

创建一个工程

在想要创建工程的位置点击 shift + 右键

scrapy startproject 工程名

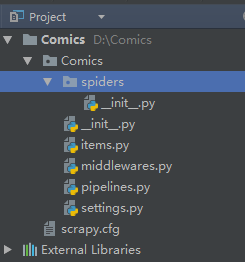

目录

scrapy.cfg:项目的配置文件

spiders文件夹:存储爬虫编写爬虫的目录

Items.py:数据容器,用来存储提取到的数据

settings.py:项目的设置文件

快速生成一个爬虫模板

scrapy genspider 爬虫名 爬虫网址

scrapy genspider huhu http://www.huhumh.com/

它会自动在spiders的文件夹下自动生成一个 huhu.py的文件

# -*- coding: utf-8 -*-

import scrapy class HuhuSpider(scrapy.Spider):

name = 'huhu'

allowed_domains = ['http://www.huhumh.com/']

start_urls = ['http://http://www.huhumh.com//'] def parse(self, response):

pass

这个huh.py用来写爬虫的核心代码

运行爬虫程序

在pycharm里的 Terminal输入: scrapy crawl 爬虫名

scrapy crawl huhu

scrapy命令行指令

显示scrapy版本

scrapy version

scrapy version -v #更全

帮助

scrapy --help

运行一个独立于Python文件的蜘蛛,无需创建一个项目

scrapy runspider myspider.py

查看有哪些当前工程下爬虫列表

scrapy list

在浏览器中打开给定的URL,并以Scrapy spider获取到的形式展现

scrapy view http://www.example.com/some/page.html

些时候spider获取到的页面和普通用户看到的并不相同。 因此该命令可以用来检查spider所获取到的页面,并确认这是您所期望的。

获取给定的URL并使用工程的parse方法分析处理

scrapy parse http://www.example.com/some/page.html

如果您提供 --callback 选项,则使用spider的该方法处理,否则使用 parse 。

支持的选项:

--spider=SPIDER: 跳过自动检测spider并强制使用特定的spider--a NAME=VALUE: 设置spider的参数(可能被重复)--callbackor-c: spider中用于解析返回(response)的回调函数--pipelines: 在pipeline中处理item--rulesor-r: 使用CrawlSpider规则来发现用来解析返回(response)的回调函数--noitems: 不显示爬取到的item--nolinks: 不显示提取到的链接--nocolour: 避免使用pygments对输出着色--depthor-d: 指定跟进链接请求的层次数(默认: 1)--verboseor-v: 显示每个请求的详细信息

scrapy对象

(19)python scrapy框架的更多相关文章

- Python -- Scrapy 框架简单介绍(Scrapy 安装及项目创建)

Python -- Scrapy 框架简单介绍 最近在学习python 爬虫,先后了解学习urllib.urllib2.requests等,后来发现爬虫也有很多框架,而推荐学习最多就是Scrapy框架 ...

- [Python][Scrapy 框架] Python3 Scrapy的安装

1.方法(只介绍 pip 方式安装) PS.不清楚 pip(easy_install) 可以百度或留言. cmd命令: (直接可以 pip,而不用跳转到 pip.exe目录下,是因为把所在目录加入 P ...

- python scrapy框架爬虫遇到301

1.什么是状态码301 301 Moved Permanently(永久重定向) 被请求的资源已永久移动到新位置,并且将来任何对此资源的引用都应该使用本响应返回的若干个URI之一.如果可能,拥有链接编 ...

- Python scrapy框架

Scrapy Scrapy是一个为了爬取网站数据,提取结构性数据而编写的应用框架. 其可以应用在数据挖掘,信息处理或存储历史数据等一系列的程序中.其最初是为了页面抓取 (更确切来说, 网络抓取 )所设 ...

- Python - Scrapy 框架

Scrapy 是采用Python 开发的一个快速可扩展的抓取WEB 站点内容的爬虫框架.Scrapy,Python开发的一个快速,高层次的屏幕抓取和web抓取框架,用于抓取web站点并从页面中提取结构 ...

- 我的第一篇博文,Python+scrapy框架安装。

自己用Python脚本写爬虫有一段时日了,也抓了不少网页,有的网页信息两多,一个脚本用exe跑了两个多月,数据还在进行中.但是总觉得这样抓效率有点低,问题也是多多的,很早就知道了这个框架好用,今天终于 ...

- 利用python scrapy 框架抓取豆瓣小组数据

因为最近在找房子在豆瓣小组-上海租房上找,发现搜索困难,于是想利用爬虫将数据抓取. 顺便熟悉一下Python. 这边有scrapy 入门教程出处:http://www.cnblogs.com/txw1 ...

- Python scrapy框架爬取瓜子二手车信息数据

项目实施依赖: python,scrapy ,fiddler scrapy安装依赖的包: 可以到https://www.lfd.uci.edu/~gohlke/pythonlibs/ 下载 pywi ...

- python scrapy框架爬取豆瓣

刚刚学了一下,还不是很明白.随手记录. 在piplines.py文件中 将爬到的数据 放到json中 class DoubanmoviePipelin2json(object):#打开文件 open_ ...

随机推荐

- 巧用Windows Server 2008的NPS策略

单位员工大部分是移动办公一族,由于病毒库更新不及时.系统补丁没有安装,使移动办公设备处于危险状态,访问内部网络时很可能威胁整个网络.该如何防守网络访问这扇门呢? 笔者所在的单位是一家传媒公司,有数百人 ...

- C#入门篇6-3:字符串操作 string的ToString() Split()和Copy()方法

//ToString()方法 public static void OutPut() { //字符型转换 转为字符串 Console.WriteLine(.ToString("n" ...

- win7装python3.6提示api-ms-win-runtime-1-1-0.dll丢失

win7为MSDN下的旗舰版,没有servicepack1那个,刚开始安装python3.6提示必须得安装servicepack1,于是乎到微软官网下了个900mb大小的安装包. https://ww ...

- Python-S9——Day115-Flask Web框架

01 当日内容概要 1 当日内容概要 1.1 Flask基础: 1.2 Web框架包含的基础组件: 1.2.1 路由.视图函数.模板渲染: 1.3 Flask配置文件: 1.4 Flask的路由系统: ...

- Wordpress 通过 post id 获取文章 url

global $post; echo get_permalink($post->ID); 函数详解: Codex - get_permalink() 注意:有些链接是通过 SEO 重定向的,比如 ...

- 使用CORS解决flask前端页面跨域问题

from flask import Flask from flask_cors import CORS app = Flask(__name__) CORS(app) @app.route(" ...

- top/free/df/jstack/jmap

上面的输出,load average后面分别是1分钟.5分钟.15分钟的负载情况.数据是每隔5秒钟检查一次活跃的进程数,然后根据这个数值算出来的.如果这个数除以CPU 的数目,结果高于5的时候就表明系 ...

- sql server 韩文查询匹配失败

在SQL Server 中查询韩文信息时,没有匹配到对应的信息,检查程序后发现字段类型是nvarchar类型的没有问题, 打开存储过程后找到问题了:原来是拼接后的查询语句存储在一个varchar变量中 ...

- https总结

http与https不能互相发送ajax请求,因为跨域了. http页面请求https静态资源可以,但是https请求http静态资源会提示错误. 总之,宽松的可以请求严格的,但是严格的不能请求宽松的 ...

- 基于深度摄像头的障碍物检测(realsense+opencv)

前几天老大给了个任务,让我帮slam组写一个基于深度摄像头的障碍物检测,捣鼓了两天弄出来了,效果还不错,就在这里记一下了. 代码的核心思路是首先通过二值化,将一米之外的安全距离置零不考虑,然后通过开运 ...