Java url爬虫

java 爬虫抓取

可以在线编辑java代码的连接http://www.runoob.com

import java.util.Scanner;

import java.util.ArrayList;

import java.net.*;

public class Spider {

public static void main(String[] args) {

String url = "http://www.runoob.com";

craweler(url);

} public static void craweler(String startingURL) {

int Max_item = 10000; // 爬虫抓取最大条目数

ArrayList<String> listOfPendingURLs=new ArrayList<>();

ArrayList<String> listOfTraversedURLs=new ArrayList<>();

//将起始的URL添加到listOfPendingURLs,然后通过一个while循环重复处理listOfPendingURLs中每一个URL

listOfPendingURLs.add(startingURL);

while(!listOfPendingURLs.isEmpty()&&listOfTraversedURLs.size()<=Max_item) {

//将列表中第一个RUL去除,如果该RUL没有被处理过则对其进行处理

String urlString=listOfPendingURLs.remove(0);

if(!listOfTraversedURLs.contains(urlString)) {

listOfTraversedURLs.add(urlString);

System.out.println("url:"+urlString);

//程序使用foreach循环,将页面中的每个不存在listOfTraversedURLs中的URL添加到listOfPendingURLs中

for(String s:getSubURLs(urlString)) {

if(!listOfTraversedURLs.contains(s))

listOfPendingURLs.add(s);

} }

}

} public static ArrayList<String> getSubURLs(String urlString) {

//该方法为每个给定的URL返回一个URL列表

ArrayList<String> list=new ArrayList<>();

try {

int current=0;

URL url=new URL(urlString);

Scanner input=new Scanner(url.openStream());

while(input.hasNext()) {

String line=input.nextLine();//从Web读取每一行

current=line.indexOf("http:",current);//寻找该行中的URL

while(current>0) {

int endIndex=line.indexOf("\"",current);//假设URL以引号"结束

if(endIndex>0) {

list.add(line.substring(current,endIndex));//一行中可能包含多个URL,

current=line.indexOf("http:",endIndex);//方法继续寻找下一个URL

}

else current=-1;//如果该行中没有发现URL,curr设为-1

}

}

}

catch (Exception ex) {

System.out.println("抓取异常: "+ex.getMessage());

}

return list; //页面中包含的URL以一个列表的形式返回

}

}

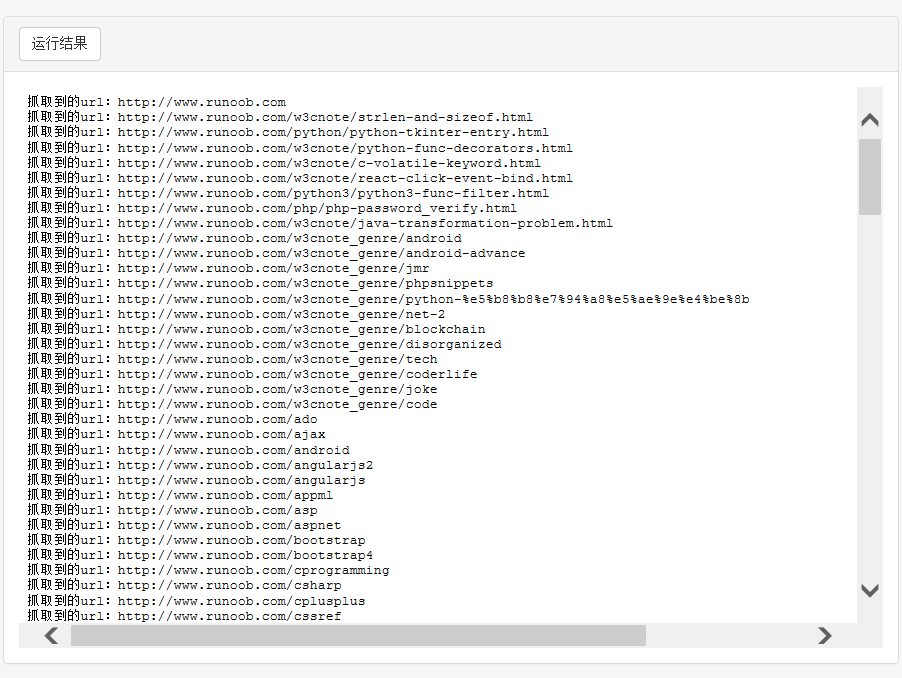

抓取效果:

可以对抓取到的url进行提取。

Java url爬虫的更多相关文章

- Java 网络爬虫获取网页源代码原理及实现

Java 网络爬虫获取网页源代码原理及实现 1.网络爬虫是一个自动提取网页的程序,它为搜索引擎从万维网上下载网页,是搜索引擎的重要组成.传统爬虫从一个或若干初始网页的URL开始,获得初始网页上的URL ...

- 开源的49款Java 网络爬虫软件

参考地址 搜索引擎 Nutch Nutch 是一个开源Java 实现的搜索引擎.它提供了我们运行自己的搜索引擎所需的全部工具.包括全文搜索和Web爬虫. Nutch的创始人是Doug Cutting, ...

- java正则表达式之java小爬虫

这个java小爬虫, 功能很简单,只有一个,抓取网上的邮箱.用到了javaI/O,正则表达式. public static void main(String[] args) throws IOExce ...

- 【转】44款Java 网络爬虫开源软件

原帖地址 http://www.oschina.net/project/lang/19?tag=64&sort=time 极简网络爬虫组件 WebFetch WebFetch 是无依赖极简网页 ...

- java网络爬虫基础学习(三)

尝试直接请求URL获取资源 豆瓣电影 https://movie.douban.com/explore#!type=movie&tag=%E7%83%AD%E9%97%A8&sort= ...

- java网络爬虫基础学习(一)

刚开始接触java爬虫,在这里是搜索网上做一些理论知识的总结 主要参考文章:gitchat 的java 网络爬虫基础入门,好像要付费,也不贵,感觉内容对新手很友好. 一.爬虫介绍 网络爬虫是一个自动提 ...

- Java 图片爬虫,java打包jar文件

目录 1. Java 图片爬虫,制作 .jar 文件 spider.java 制作 jar 文件 添加执行权限 1. Java 图片爬虫,制作 .jar 文件 spider.java spider.j ...

- java开发爬虫Deno

java开发爬虫Deno 身为一个程序员不会两三手爬虫怎么能在行业里立足啊,这是开发中自己写的一个java爬虫的Demo,供大家参考. java爬虫的开发依赖于jsoup.jar 直接上代码 publ ...

- Java基础-爬虫实战之爬去校花网网站内容

Java基础-爬虫实战之爬去校花网网站内容 作者:尹正杰 版权声明:原创作品,谢绝转载!否则将追究法律责任. 爬虫这个实现点我压根就没有把它当做重点,也没打算做网络爬虫工程师,说起爬虫我更喜欢用Pyt ...

随机推荐

- spring初始化相关

获取applicationContext implements ApplicationContextAware @Override public void setApplicationContext( ...

- html调用html的方法

html调用html的方法 html中引入调用另一个html的方法,尝试了好几种,都列出来: 其中第一种是最好的,其他的方法,可以尝试看看,是不是适合你当前项目 一.div+$(“#page1”).l ...

- 31.网站数据监控-2(scrapy文件下载)

温州数据采集 这里采集网站数据是下载pdf:http://wzszjw.wenzhou.gov.cn/col/col1357901/index.html(涉及的问题就是scrapy 文件的下载设置,之 ...

- jar 问题 : java.io.IOException: invalid header field

通过本文, 我们明白了什么是 jar的清单文件 MANIFEST.MF, 简单示例: E:\ws\Test\WEB-INF\classes>jar cvfm testCL.jar ListTes ...

- java位运算(操作)的使用

位操作是程序设计中对位模式按位或二进制数的一元和二元操作. 在许多古老的微处理器上, 位运算比加减运算略快, 通常位运算比乘除法运算要快很多. 在现代架构中, 情况并非如此:位运算的运算速度通常与加法 ...

- 02.设计模式_NullObject模式

使用NULL OBJECT模式,我们可以确保返回的总是有效的对象,即使失败时也代表对象什么也不做. 下面以一个数据库查询的示例来演示空对象模式. 1.Employe实体对象空对象的接口 Employe ...

- Swoole 内存操作(Table)

使用: //实例化表格,参数 int : 最大行数 $table = new swoole_table(1024); //设置表格字段 参数 (字段名:string , 字段类型:int.float. ...

- 解决jsfl 弹出警告

fl.showIdleMessage(false);

- jsfl完成通知air

jsfl完成后生成一个文本A.txt, air开始jsfl执行后一直检测A.txt是否存在,存在就是完成了.那么就可以删除这个A.txt

- 池以及barrier简单

用了下CyclicBarrier,注意线程池中的线程数量设置,还有就是DB连接的时候,需要考虑单个DB能承受的最大连接数目和每个连接上能同时打开的cursor等限制,需要时可以通过jstack查看堆栈 ...