(六)hadoop系列之__hadoop分布式集群环境搭建

配置hadoop(master,slave1,slave2)

说明:

NameNode: master

DataNode: slave1,slave2 --------------------------------------------------------

A. 修改主机的master 和 slaves

i. 配置slaves

# vi hadoop/conf/slaves

添加:192.168.126.20

192.168.126.30

...节点 ip ii. 配置master

添加:192.168.126.10

...主机 ip

-------------------------------------------------------- B. 配置master .xml文件

i. 配置core-site.xml

<?xml version="1.0"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<!-- Put site-specific property overrides in this file. -->

<configuration>

<property>

<name>hadoop.tmp.dir</name>

<value>/home/had/hadoop/data</value>

<description>A base for other temporary directories.</description>

</property>

<property>

<name>fs.default.name</name>

<value>hdfs://192.168.126.10:9000</value>

</property>

</configuration> ii. 配置hdfs-site.xml

<?xml version="1.0"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<!-- Put site-specific property overrides in this file. -->

<configuration>

<property>

<name>dfs.replication</name>

<value>3</value>

<description>Default block replication.

The actual number of replications can be specified when the file is created.

The default is used if replication is not specified in create time.

</description>

</property>

</configuration> iii.mapred-site.xml

<?xml version="1.0"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<!-- Put site-specific property overrides in this file. -->

<configuration>

<property>

<name>mapred.job.tracker</name>

<value>192.168.126.10:9001</value>

</property>

</configuration> -------------------------------------------------------------

C. 配置slave1,slave2 (同上)

i. core-site.xml

ii. mapred-site.xml

--------------------------------------------------------------- D. 配置 master,slave1,slave2的hadoop系统环境

$ vi /home/hadoop/.bashrc

添加:

export HADOOP_HOME=/home/hadoop/hadoop-0.20.2

export HADOOP_CONF_DIR=$HADOOP_HOME/conf

export PATH=/home/hadoop/hadoop-0.20.2/bin:$PATH

----------------------------------------------------------------

注意:有时候会出现以下错误信息

。。。

11/08/18 17:02:35 INFO ipc.Client: Retrying connect to server: localhost/192.168.126 .10:9000. Already tried 0 time(s).

Bad connection to FS. command aborted.

此时需要把根目录下的tmp文件里面的内容删掉,然后重新格式化即可。

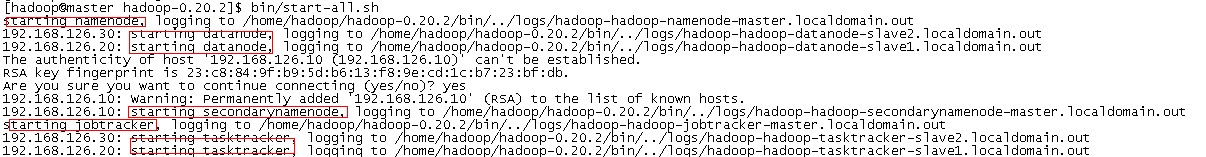

启动Hadoop:

完成后进行测试:

测试 $ bin/hadoop fs -put ./README.txt test1

$ bin/hadoop fs -ls

Found 1 items

drwxr-xr-x - hadoop supergroup 0 2013-07-14 00:51 /user/hadoop/test1

$hadoop jar hadoop-0.20.2-examples.jar wordcount /user/hadoop/test1/README.txt output1

结果出现以下问题

注:测试过程当中会有一些错误信息。一下是我在安装的过程当中碰到的几个问题。

1.org.apache.hadoop.ipc.RemoteException: org.apache.hadoop.hdfs.server.namenode.SafeModeException: Cannot delete /home/hadoop/hadoop-datastore

/hadoop-hadoop/mapred/system/job_201307132331_0005. Name node is in safe mode.

关闭安全模式:

bin/hadoop dfsadmin -safemode leave

2.org.apache.hadoop.ipc.RemoteException: java.io.IOException: File /user/hadoop/test1/README.txt could only be replicated to 0 nodes,

instead of 1

情况1. hadoop.tmp.dir 磁盘空间不足。

解决方法: 换个足够空间的磁盘即可。

情况2. 查看防火墙状态

/etc/init.d/iptables status

/etc/init.d/iptables stop//关闭所有的防火墙

情况3.先后启动namenode、datanode(我的是这种情况)

参考文章:http://sjsky.iteye.com/blog/1124545

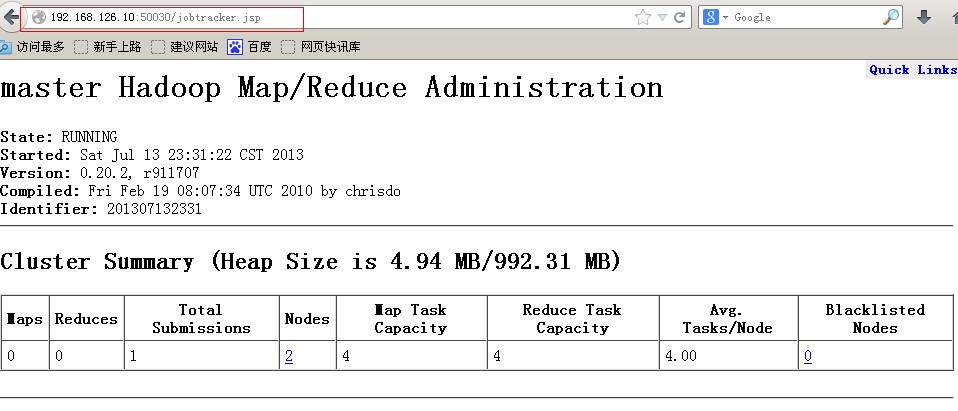

最后执行界面如下:

查看hdfs运行状态(web):http://192.168.126.10:50070/dfshealth.jsp

查看map-reduce信息(web):http://192.168.126.10:50030/jobtracker.jsp

整个Hadoop集群搭建结束。

(六)hadoop系列之__hadoop分布式集群环境搭建的更多相关文章

- Spark 1.6.1分布式集群环境搭建

一.软件准备 scala-2.11.8.tgz spark-1.6.1-bin-hadoop2.6.tgz 二.Scala 安装 1.master 机器 (1)下载 scala-2.11.8.tgz, ...

- Hadoop完全分布式集群环境搭建

1. 在Apache官网下载Hadoop 下载地址:http://hadoop.apache.org/releases.html 选择对应版本的二进制文件进行下载 2.解压配置 以hadoop-2.6 ...

- ZooKeeper 完全分布式集群环境搭建

1. 搭建前准备 示例共三台主机,主机IP映射信息如下: 192.168.32.101 s1 192.168.32.102 s2 192.168.32.103 s3 2.下载ZooKeeper, 以 ...

- Kafka 完全分布式集群环境搭建

思路: 先在主机s1上安装配置,然后远程复制到其它两台主机s2.s3上, 并分别修改配置文件server.properties中的broker.id属性. 1. 搭建前准备 示例共三台主机,主机IP映 ...

- Hadoop伪分布式集群环境搭建

本教程讲述在单机环境下搭建Hadoop伪分布式集群环境,帮助初学者方便学习Hadoop相关知识. 首先安装Hadoop之前需要准备安装环境. 安装Centos6.5(64位).(操作系统再次不做过多描 ...

- 阿里云ECS服务器部署HADOOP集群(一):Hadoop完全分布式集群环境搭建

准备: 两台配置CentOS 7.3的阿里云ECS服务器: hadoop-2.7.3.tar.gz安装包: jdk-8u77-linux-x64.tar.gz安装包: hostname及IP的配置: ...

- Hadoop+HBase+ZooKeeper分布式集群环境搭建

一.环境说明 集群环境至少需要3个节点(也就是3台服务器设备):1个Master,2个Slave,节点之间局域网连接,可以相互ping通,下面举例说明,配置节点IP分配如下: Hostname IP ...

- Hadoop学习(一):完全分布式集群环境搭建

1. 设置免密登录 (1) 新建普通用户hadoop:useradd hadoop(2) 在主节点master上生成密钥对,执行命令ssh-keygen -t rsa便会在home文件夹下生成 .ss ...

- Spark 2.2.0 分布式集群环境搭建

集群机器: 1台 装了 ubuntu 14.04的 台式机 1台 装了ubuntu 16.04 的 笔记本 (机器更多时同样适用) 1.需要安装好Hadoop分布式环境 参照:Hadoop分类 ...

随机推荐

- (数据科学学习手札50)基于Python的网络数据采集-selenium篇(上)

一.简介 接着几个月之前的(数据科学学习手札31)基于Python的网络数据采集(初级篇),在那篇文章中,我们介绍了关于网络爬虫的基础知识(基本的请求库,基本的解析库,CSS,正则表达式等),在那篇文 ...

- 20155209 2016-2017-2 《Java程序设计》第1周学习总结

20155209 2016-2017-2 <Java程序设计>第1周学习总结 初读教材对每章节的提问 第一章:为什么java被广泛使用,java这样的平台相比其它语言有什么实质的好处? 第 ...

- 20155329胡佩伦 《Java程序设计》第3周学习总结

学号 2016-2017-20155329胡佩伦 <Java程序设计>第3周学习总结 教材学习内容总结 本周复习巩固了运算符. 前缀自增自减法(++i,--i): 先进行自增或者自减运算, ...

- DevOps是一种文化,不是角色!

一.DevOps是一种文化,不是角色! 软件无处不在.在如今的世界里,每个主流公司/组织都和软件开发息息相关,并且公司需要向软件一样运作.更快且更敏捷,同时保证安全性和可靠性,这样的要求前所未有的强烈 ...

- mfs分布式系统从理论简介到实战部署

文章前面想说的话:这篇博客写出来真是有点累到了,本来昨天就基本就写好了,放在草稿里面,今天打开就没有了!!唉,就尼玛离我而去了,只有重写,然后中间虚拟机还“爆炸”重启又搞了一会,不容易呀!!希望各位博 ...

- selenium自动化之元素定位方法

在使用selenium webdriver进行元素定位时,有8种基本元素定位方法(注意:并非只有8种,总共来说,有16种). 分别介绍如下: 1.name定位 (注意:必须确保name属性值在当前ht ...

- 人脸检测及识别python实现系列(6)——终篇:从实时视频流识别出“我”

人脸检测及识别python实现系列(6)——终篇:从实时视频流识别出“我” 终于到了最后一步,激动时刻就要来临了,先平复一下心情,把剩下的代码加上,首先是为Model类增加一个预测函数: #识别人脸 ...

- 人脸检测及识别python实现系列(3)——为模型训练准备人脸数据

人脸检测及识别python实现系列(3)——为模型训练准备人脸数据 机器学习最本质的地方就是基于海量数据统计的学习,说白了,机器学习其实就是在模拟人类儿童的学习行为.举一个简单的例子,成年人并没有主动 ...

- Unity ScriptableObject自定义属性显示

1. 继承Editor,重写OnInspectorGUI方法 Editor官方文档 需求 将TestClass中intData属性和stringData按指定格式显示. 实现 定义一个测试类TestC ...

- 【Python 开发】Python目录

目录: [Python开发]第一篇:计算机基础 [Python 开发]第二篇 :Python安装 [Python 开发]第三篇:python 实用小工具