07.k近邻算法kNN

1、将数据分为测试数据和预测数据

2、数据分为data和target,data是矩阵,target是向量

3、将每条data(向量)绘制在坐标系中,就得到了一系列的点

4、根据每条data的target的不同,给点赋予不同的颜色

5、当新数据来到时,比如只有一条数据,将新数据绘制在坐标系中,就得到了新的一个点

6、确定k值,比如k=3

7、计算所有数据和新数据点的距离,找出最近的3个

8、根据结果判断新数据应该归属的分类,即为预测数据确定target

生成测试数据

import numpy as np

import matplotlib.pyplot as plt raw_data_a = np.random.random((10,2))

raw_data_b = np.random.randint(0,10,size=(10,2))

X_train = raw_data_a + raw_data_b

X_train

array([[8.28164975, 4.19315143],

[2.92775657, 0.81556491],

[4.50761169, 2.84927016],

[6.53083961, 4.26093009],

[2.27051172, 4.05065263],

[7.7954489 , 8.68019714],

[4.43708588, 6.72986275],

[4.65529575, 4.7985332 ],

[3.52301327, 4.19730249],

[2.2773095 , 0.07817849]])

构造target

y_train = np.array([0,0,0,0,0,1,1,1,1,1])

y_train

array([0, 0, 0, 0, 0, 1, 1, 1, 1, 1])

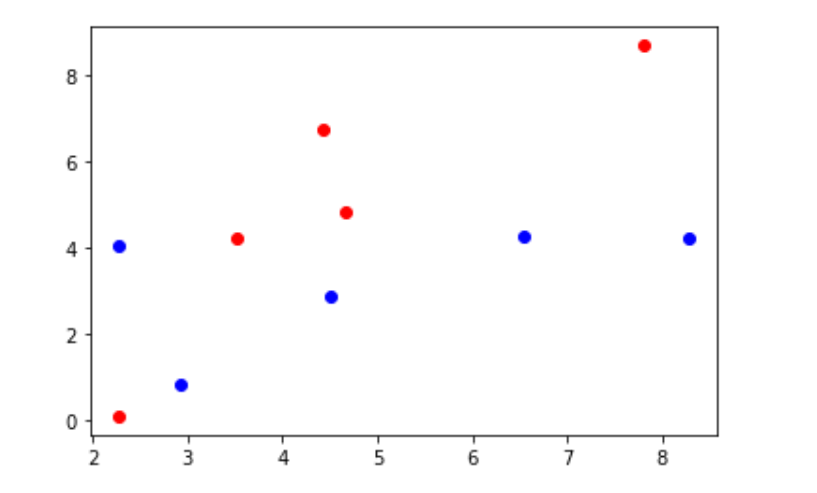

绘制散点图

plt.scatter(X_train[y_train == 0,0], X_train[y_train == 0,1],color="b")

plt.scatter(X_train[y_train == 1,0], X_train[y_train == 1,1],color="r")

构造新数据

new_data_a = np.random.random((10,2))

new_data_b = np.random.randint(0,10,size=(10,2))

new_data = new_data_a + new_data_b

new_data

array([[7.66654552, 3.43737304],

[9.00627805, 8.35944151],

[4.35322638, 5.29260333],

[2.9064343 , 0.05002835],

[8.68350808, 1.50262447],

[0.23152764, 9.688442 ],

[9.2139265 , 7.96068869],

[5.14763436, 2.40288244],

[9.52077384, 9.4833882 ],

[5.04330854, 4.96045193]])

预测数据(拿一条数据举例)

X_predict = new_data[0]

X_predict

array([3.05595894, 6.89591993])

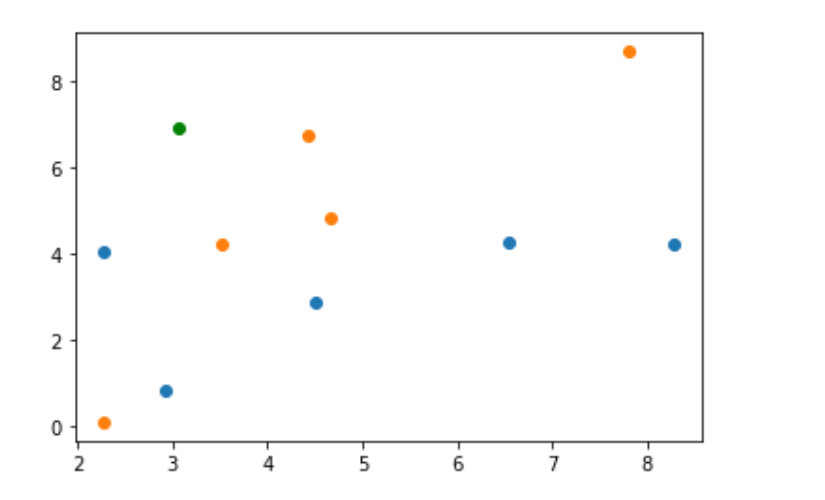

原始数据和预测数据共同绘制在一个坐标系中

plt.scatter(X_train[y_train == 0,0], X_train[y_train == 0,1])

plt.scatter(X_train[y_train == 1,0], X_train[y_train == 1,1])

plt.scatter(X_predict[0], X_predict[1], color="g")

计算与测试点的距离

from math import sqrt distances = [sqrt(np.sum((x - X_predict)**2)) for x in X_train]

distances

[5.883264572139944,

6.0817064237981535,

4.299147591752391,

4.360959428669816,

2.951689913705071,

5.064228496651553,

1.3910739045173681,

2.637595368153982,

2.7387361757860287,

6.862061882958762]

K = 6,找出距离最近的6个点

k = 6

nearest = np.argsort(distances)

topk_y = [y_train[i] for i in nearest[:k]]

topk_y

[1, 1, 1, 1, 1, 0]

结果

from collections import Counter

Counter(topk_y)

Counter({1: 5, 0: 1})

votes = Counter(topk_y)

votes.most_common(1)

[(1, 5)]

votes.most_common(1)[0][0]

1

predic = votes.most_common(1)[0][0]

predic

1

使用scikit-learn中的kNN

from sklearn.neighbors import KNeighborsClassifier kNN_classifier = KNeighborsClassifier()

kNN_classifier.fit(X_train,y_train)

KNeighborsClassifier(algorithm='auto', leaf_size=30, metric='minkowski',

metric_params=None, n_jobs=None, n_neighbors=5, p=2,

weights='uniform')

kNN_classifier.predict(new_data_1.reshape(1,-1))

array([1])

重新整理knn代码

import numpy as np

from math import sqrt

from collections import Counter class KNNClassifier: def __init__(self, k):

# 初始化KNN分类器

self.k = k

self._X_train = None

self._y_train = None def fit(self, X_train, y_train):

# 根据训练集X_train, Y_train训练分类器

self._X_train = X_train

self._y_train = y_train

return self def predict(self, X_predict):

# 给定待遇测的数据集X_predict,返回表示X_predict的结果向量

y_predict = [self._predict(x) for x in X_predict]

return np.array(y_predict) def _predict(self, x):

# 给定单个待遇测数据x,返回x的预测结果值

distances = [sqrt(np.sum((x_train - x) ** 2)) for x_train in self._X_train]

nearest = np.argsort(distances)

topK_y = [self._y_train[i] for i in nearest[:self.k]]

votes = Counter(topK_y)

return votes.most_common(1)[0][0] def __repr__(self):

return "KNN=(%d)" % self.k

knn_clf = KNNClassifier(k=6)

knn_clf.fit(X_train, y_train)

KNN=(6)

y_predict = knn_clf.predict(X_predict)

y_predict

array([0, 1])

07.k近邻算法kNN的更多相关文章

- k近邻算法(KNN)

k近邻算法(KNN) 定义:如果一个样本在特征空间中的k个最相似(即特征空间中最邻近)的样本中的大多数属于某一个类别,则该样本也属于这个类别. from sklearn.model_selection ...

- 机器学习(四) 分类算法--K近邻算法 KNN (上)

一.K近邻算法基础 KNN------- K近邻算法--------K-Nearest Neighbors 思想极度简单 应用数学知识少 (近乎为零) 效果好(缺点?) 可以解释机器学习算法使用过程中 ...

- 一看就懂的K近邻算法(KNN),K-D树,并实现手写数字识别!

1. 什么是KNN 1.1 KNN的通俗解释 何谓K近邻算法,即K-Nearest Neighbor algorithm,简称KNN算法,单从名字来猜想,可以简单粗暴的认为是:K个最近的邻居,当K=1 ...

- 机器学习(四) 机器学习(四) 分类算法--K近邻算法 KNN (下)

六.网格搜索与 K 邻近算法中更多的超参数 七.数据归一化 Feature Scaling 解决方案:将所有的数据映射到同一尺度 八.scikit-learn 中的 Scaler preprocess ...

- k近邻算法(knn)的c语言实现

最近在看knn算法,顺便敲敲代码. knn属于数据挖掘的分类算法.基本思想是在距离空间里,如果一个样本的最接近的k个邻居里,绝大多数属于某个类别,则该样本也属于这个类别.俗话叫,"随大流&q ...

- 《机器学习实战》---第二章 k近邻算法 kNN

下面的代码是在python3中运行, # -*- coding: utf-8 -*- """ Created on Tue Jul 3 17:29:27 2018 @au ...

- 最基础的分类算法-k近邻算法 kNN简介及Jupyter基础实现及Python实现

k-Nearest Neighbors简介 对于该图来说,x轴对应的是肿瘤的大小,y轴对应的是时间,蓝色样本表示恶性肿瘤,红色样本表示良性肿瘤,我们先假设k=3,这个k先不考虑怎么得到,先假设这个k是 ...

- 机器学习随笔01 - k近邻算法

算法名称: k近邻算法 (kNN: k-Nearest Neighbor) 问题提出: 根据已有对象的归类数据,给新对象(事物)归类. 核心思想: 将对象分解为特征,因为对象的特征决定了事对象的分类. ...

- 机器学习(1)——K近邻算法

KNN的函数写法 import numpy as np from math import sqrt from collections import Counter def KNN_classify(k ...

随机推荐

- 安装kettle

保证安装了jdk 在window 下载解压 解压到任意目录下 运行startZK.bat 在Linux安装 1.将kettle上传到Linux服务器的/opt/server目录下(如果该目录不存在则创 ...

- DolphinScheduler 源码分析之 DAG类

1 /* 2 * Licensed to the Apache Software Foundation (ASF) under one or more 3 * contributor license ...

- Codeforces Round #627 (Div. 3) E - Sleeping Schedule(递推)

题意: 每天有 h 小时,有一序列 an,每次可以选择 ai 或 ai - 1 小时后睡觉,问从 0 次 0 时开始,最多在 l ~ r 时间段入睡多少次. 思路: 如果此时可达,计算此时可达的时间点 ...

- 【洛谷 p3383】模板-线性筛素数(数论)

题目:给定一个范围N,你需要处理M个某数字是否为质数的询问(每个数字均在范围1-N内).(N<=10000000,M<=100000) 解法:1.欧拉筛O(n),数组近乎100KB:2.( ...

- Codeforces Round #481 (Div. 3) C. Letters (模拟,二分)

题意:有个\(n\)个公寓,每个公寓\(a_{i}\)代表着编号为\(1-a_{i}\)个房间,给你房间号,问它在第几栋公寓的第几个房间. 题解:对每个公寓的房间号记一个前缀和,二分查找属于第几个公寓 ...

- ucosIII学习笔记——钩子函数

一开始听见钩子函数感觉很莫名其妙,更不知道它有何作用,这是第一篇博客,也是学习ucosIII操作系统的一个开始吧. 在系统中有开发者自己创建的任务也有系统内部任务 ,UCOSIII中有五个系统任务,分 ...

- jdk8下的接口和抽象类

接口 在java8中,接口可以定义变量和方法,其中变量必须为 public && static && final: 方法必须为public && (ab ...

- 4.Direct交换机之使用指定routingkey完成日志记录场景

标题 : 4.Direct交换机之使用指定routingkey完成日志记录场景 目录 : RabbitMQ 序号 : 4 const string logOthersQueueName = " ...

- VScode 配置c++环境

参考 https://code.visualstudio.com/docs/cpp/config-mingw https://zhuanlan.zhihu.com/p/77645306 主要 http ...

- Leetcode(145)-二叉树的后序遍历

给定一个二叉树,返回它的 后序 遍历. 示例: 输入: [1,null,2,3] 1 \ 2 / 3 输出: [3,2,1] 思路:一开始编写二叉树后序遍历的程序,感觉定级为困难有点欠妥,确实,如果用 ...