获取kafka最新offset-scala

无论是在spark streaming消费kafka,或是监控kafka的数据时,我们经常会需要知道offset最新情况

kafka数据的topic基于分区,并且通过每个partition的主分区可以获取offset的最新情况

GetOffsetShellWrap

//这是对kafka自带工具包的扩展object GetOffsetShellWrap {

//在主函数添加一个参数map

def main(args: Array[String],map: ArrayBuffer[String]): Unit = { //对参数的解析

val parser = new OptionParser

val brokerListOpt = parser.accepts("broker-list", "REQUIRED: The list of hostname and port of the server to connect to.")

.withRequiredArg

.describedAs("hostname:port,...,hostname:port")

.ofType(classOf[String])

val topicOpt = parser.accepts("topic", "REQUIRED: The topic to get offset from.")

.withRequiredArg

.describedAs("topic")

.ofType(classOf[String])

val partitionOpt = parser.accepts("partitions", "comma separated list of partition ids. If not specified, it will find offsets for all partitions")

.withRequiredArg

.describedAs("partition ids")

.ofType(classOf[String])

.defaultsTo("")

val timeOpt = parser.accepts("time", "timestamp of the offsets before that")

.withRequiredArg

.describedAs("timestamp/-1(latest)/-2(earliest)")

.ofType(classOf[java.lang.Long])

val nOffsetsOpt = parser.accepts("offsets", "number of offsets returned")

.withRequiredArg

.describedAs("count")

.ofType(classOf[java.lang.Integer])

.defaultsTo(1)

val maxWaitMsOpt = parser.accepts("max-wait-ms", "The max amount of time each fetch request waits.")

.withRequiredArg

.describedAs("ms")

.ofType(classOf[java.lang.Integer])

.defaultsTo(1000)

if(args.length == 0)

CommandLineUtils.printUsageAndDie(parser, "An interactive shell for getting consumer offsets.")

val options = parser.parse(args : _*)

CommandLineUtils.checkRequiredArgs(parser, options, brokerListOpt, topicOpt, timeOpt)

//获取参数的值

val clientId = "GetOffsetShell"

val brokerList = options.valueOf(brokerListOpt)

ToolsUtils.validatePortOrDie(parser, brokerList)

val metadataTargetBrokers = ClientUtils.parseBrokerList(brokerList)

val topic = options.valueOf(topicOpt)

var partitionList = options.valueOf(partitionOpt)

var time = options.valueOf(timeOpt).longValue

val nOffsets = options.valueOf(nOffsetsOpt).intValue

val maxWaitMs = options.valueOf(maxWaitMsOpt).intValue()

val topicsMetadata = ClientUtils.fetchTopicMetadata(Set(topic), metadataTargetBrokers, clientId, maxWaitMs).topicsMetadata

if(topicsMetadata.size != 1 || !topicsMetadata(0).topic.equals(topic)) {

System.err.println(("Error: no valid topic metadata for topic: %s, " + " probably the topic does not exist, run ").format(topic) +

"kafka-list-topic.sh to verify")

System.exit(1)

}

val partitions =

if(partitionList == "") {

topicsMetadata.head.partitionsMetadata.map(_.partitionId)

} else {

partitionList.split(",").map(_.toInt).toSeq

} //遍历每个主分区

partitions.foreach { partitionId =>

val partitionMetadataOpt = topicsMetadata.head.partitionsMetadata.find(_.partitionId == partitionId)

partitionMetadataOpt match {

case Some(metadata) =>

metadata.leader match {

case Some(leader) =>

val consumer = new SimpleConsumer(leader.host, leader.port, 10000, 100000, clientId)

val topicAndPartition = TopicAndPartition(topic, partitionId)

val request = OffsetRequest(Map(topicAndPartition -> PartitionOffsetRequestInfo(time, nOffsets)))

val offsets = consumer.getOffsetsBefore(request).partitionErrorAndOffsets(topicAndPartition).offsets

//把获取到的offset进行存储

map += "%s:%d:%s".format(topic, partitionId, offsets.mkString(","))

case None => System.err.println("Error: partition %d does not have a leader. Skip getting offsets".format(partitionId))

}

case None => System.err.println("Error: partition %d does not exist".format(partitionId))

}

}

}

}

GetOffsetShellWrapScalaTest

object GetOffsetShellWrapScalaTest {

def main(args: Array[String]) {

var arr = ArrayBuffer[String]();

arr+="--broker-list=hadoop-01:9092"

arr+="-topic=2017-11-6-test"

arr+="--time=-1"

val resule = getOffset(arr.toArray)

for(i<-resule){

println("我自己获取到的偏移量=> "+i)

}

}

def getOffset(args: Array[String]) : Array[String]={

val map = new ArrayBuffer[String]()

GetOffsetShellWrap.main(args.toArray,map)

map.toArray

}

}

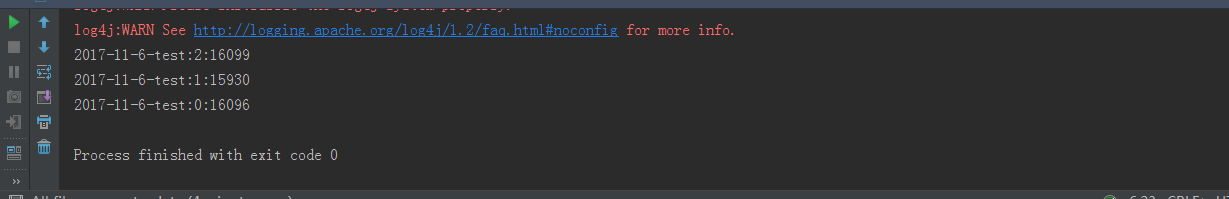

结果输出:

2017-11-6-test:2:16099 2017-11-6-test:1:15930 2017-11-6-test:0:16096

获取kafka最新offset-scala的更多相关文章

- 获取kafka最新offset-java

之前笔者曾经写过通过scala的方式获取kafka最新的offset 但是大多数的情况我们需要使用java的方式进行获取最新offset scala的方式可以参考: http://www.cnblog ...

- Spark-Streaming获取kafka数据的两种方式:Receiver与Direct的方式

简单理解为:Receiver方式是通过zookeeper来连接kafka队列,Direct方式是直接连接到kafka的节点上获取数据 Receiver 使用Kafka的高层次Consumer API来 ...

- 工具篇-Spark-Streaming获取kafka数据的两种方式(转载)

转载自:https://blog.csdn.net/weixin_41615494/article/details/7952173 一.基于Receiver的方式 原理 Receiver从Kafka中 ...

- SparkStreaming获取kafka数据的两种方式:Receiver与Direct

简介: Spark-Streaming获取kafka数据的两种方式-Receiver与Direct的方式,可以简单理解成: Receiver方式是通过zookeeper来连接kafka队列, Dire ...

- spark-streaming获取kafka数据的两种方式

简单理解为:Receiver方式是通过zookeeper来连接kafka队列,Direct方式是直接连接到kafka的节点上获取数据 一.Receiver方式: 使用kafka的高层次Consumer ...

- 获取Kafka每个分区最新Offset的几种方法

目录 脚本方法 Java 程序 参考资料 脚本方法 ./bin/kafka-run-class.sh kafka.tools.GetOffsetShell --broker-list localhos ...

- 关于怎么获取kafka指定位置offset消息(转)

1.在kafka中如果不设置消费的信息的话,一个消息只能被一个group.id消费一次,而新加如的group.id则会被“消费管理”记录,并指定从当前记录的消息位置开始向后消费.如果有段时间消费者关闭 ...

- 如何获取流式应用程序中checkpoint的最新offset

对于流式应用程序,保证应用7*24小时的稳定运行,是非常必要的.因此对于计算引擎,要求必须能够适应与应用程序逻辑本身无关的问题(比如driver应用失败重启.网络问题.服务器问题.JVM崩溃等),具有 ...

- Scala创建SparkStreaming获取Kafka数据代码过程

正文 首先打开spark官网,找一个自己用版本我选的是1.6.3的,然后进入SparkStreaming ,通过搜索这个位置找到Kafka, 点击过去会找到一段Scala的代码 import or ...

随机推荐

- 透彻的了解Linux系统故障并解决

透彻的了解Linux系统故障并解决 2009-12-25 10:24 佚名 NET130 字号:T | T 经常应用Windows操作系统时,我们会很多的系统故障,于是很多人开始应用Linux操作系统 ...

- electron 点击事件无效

用CSS的 -webkit-app-region: drag;设置窗口可以移动后,点击事件无效 解决办法暂时不知道, 给点击的按钮加 -webkit-app-region: no-drag; 就可以点 ...

- 【leetcode】Largest Plus Sign

题目如下: In a 2D grid from (0, 0) to (N-1, N-1), every cell contains a 1, except those cells in the giv ...

- C++ -- 类与成员

一.初始化列表 1.是构造函数中一种成员的初始化方式 例如,class 类名 { 类名(参数列表):成员1(成员1),成员2(成员2)... { } } 2.用此方法可以解决类中的成员与 ...

- React 项目中修改 Ant Design 的默认样式(Input Checkbox 等等

修改样式更符合项目的需求特别是在 Input 和 Checkbox 等等一系列 试过很的方式都有问题, 比如直接在行内添加样式会无法传递到特定的层级 最好的办法是添加 id 可行 渲染部分代码 < ...

- (79)【按键】[独立按键] - 1: 单击,双击,三击以及N击

此按键程序的实现的功能是单个独立按键的[单击],[长按],[双击],[三击]以及[多击].本文分为三个部分, 第一个部分是说[单击],[长按]的程序: 第二部分是讲[双击]: 第三部分是讲[三击],[ ...

- box-shadow inset

安卓支持,ios不支持:box-shadow: 0px 0px 2px inset rgba(0,0,0,0.08); 安卓,ios都支持:box-shadow: inset 0px 0px 2px ...

- sqli-labs29-31关Background-6 服务器(两层)架构

首先介绍一下29,30,31这三关的基本情况: 服务器端有两个部分:第一部分为tomcat为引擎的jsp型服务器,第二部分为apache为引擎的php服务器,真正提供web服务的是php服务器.工作流 ...

- 一句话搞定python六剑客

六剑客 一行搞定六剑客:三个函数:map filter reduce + lambda 切片 推导列表 python最有特点的一行代码,所有代码均可以借用一行代码(目标) 1.map(函数,列表或者字 ...

- (转)openssl 命令: openssl req 命令详解

openssl req命令主要的功能有,生成证书请求文件, 查看验证证书请求文件,还有就是生成自签名证书.本文就主要记录一下open ...