【python实现卷积神经网络】优化器的实现(SGD、Nesterov、Adagrad、Adadelta、RMSprop、Adam)

代码来源:https://github.com/eriklindernoren/ML-From-Scratch

卷积神经网络中卷积层Conv2D(带stride、padding)的具体实现:https://www.cnblogs.com/xiximayou/p/12706576.html

激活函数的实现(sigmoid、softmax、tanh、relu、leakyrelu、elu、selu、softplus):https://www.cnblogs.com/xiximayou/p/12713081.html

损失函数定义(均方误差、交叉熵损失):https://www.cnblogs.com/xiximayou/p/12713198.html

先看下优化器实现的代码:

import numpy as np

from mlfromscratch.utils import make_diagonal, normalize # Optimizers for models that use gradient based methods for finding the

# weights that minimizes the loss.

# A great resource for understanding these methods:

# http://sebastianruder.com/optimizing-gradient-descent/index.html class StochasticGradientDescent():

def __init__(self, learning_rate=0.01, momentum=0):

self.learning_rate = learning_rate

self.momentum = momentum

self.w_updt = None def update(self, w, grad_wrt_w):

# If not initialized

if self.w_updt is None:

self.w_updt = np.zeros(np.shape(w))

# Use momentum if set

self.w_updt = self.momentum * self.w_updt + (1 - self.momentum) * grad_wrt_w

# Move against the gradient to minimize loss

return w - self.learning_rate * self.w_updt class NesterovAcceleratedGradient():

def __init__(self, learning_rate=0.001, momentum=0.4):

self.learning_rate = learning_rate

self.momentum = momentum

self.w_updt = np.array([]) def update(self, w, grad_func):

# Calculate the gradient of the loss a bit further down the slope from w

approx_future_grad = np.clip(grad_func(w - self.momentum * self.w_updt), -1, 1)

# Initialize on first update

if not self.w_updt.any():

self.w_updt = np.zeros(np.shape(w)) self.w_updt = self.momentum * self.w_updt + self.learning_rate * approx_future_grad

# Move against the gradient to minimize loss

return w - self.w_updt class Adagrad():

def __init__(self, learning_rate=0.01):

self.learning_rate = learning_rate

self.G = None # Sum of squares of the gradients

self.eps = 1e-8 def update(self, w, grad_wrt_w):

# If not initialized

if self.G is None:

self.G = np.zeros(np.shape(w))

# Add the square of the gradient of the loss function at w

self.G += np.power(grad_wrt_w, 2)

# Adaptive gradient with higher learning rate for sparse data

return w - self.learning_rate * grad_wrt_w / np.sqrt(self.G + self.eps) class Adadelta():

def __init__(self, rho=0.95, eps=1e-6):

self.E_w_updt = None # Running average of squared parameter updates

self.E_grad = None # Running average of the squared gradient of w

self.w_updt = None # Parameter update

self.eps = eps

self.rho = rho def update(self, w, grad_wrt_w):

# If not initialized

if self.w_updt is None:

self.w_updt = np.zeros(np.shape(w))

self.E_w_updt = np.zeros(np.shape(w))

self.E_grad = np.zeros(np.shape(grad_wrt_w)) # Update average of gradients at w

self.E_grad = self.rho * self.E_grad + (1 - self.rho) * np.power(grad_wrt_w, 2) RMS_delta_w = np.sqrt(self.E_w_updt + self.eps)

RMS_grad = np.sqrt(self.E_grad + self.eps) # Adaptive learning rate

adaptive_lr = RMS_delta_w / RMS_grad # Calculate the update

self.w_updt = adaptive_lr * grad_wrt_w # Update the running average of w updates

self.E_w_updt = self.rho * self.E_w_updt + (1 - self.rho) * np.power(self.w_updt, 2) return w - self.w_updt class RMSprop():

def __init__(self, learning_rate=0.01, rho=0.9):

self.learning_rate = learning_rate

self.Eg = None # Running average of the square gradients at w

self.eps = 1e-8

self.rho = rho def update(self, w, grad_wrt_w):

# If not initialized

if self.Eg is None:

self.Eg = np.zeros(np.shape(grad_wrt_w)) self.Eg = self.rho * self.Eg + (1 - self.rho) * np.power(grad_wrt_w, 2) # Divide the learning rate for a weight by a running average of the magnitudes of recent

# gradients for that weight

return w - self.learning_rate * grad_wrt_w / np.sqrt(self.Eg + self.eps) class Adam():

def __init__(self, learning_rate=0.001, b1=0.9, b2=0.999):

self.learning_rate = learning_rate

self.eps = 1e-8

self.m = None

self.v = None

# Decay rates

self.b1 = b1

self.b2 = b2 def update(self, w, grad_wrt_w):

# If not initialized

if self.m is None:

self.m = np.zeros(np.shape(grad_wrt_w))

self.v = np.zeros(np.shape(grad_wrt_w)) self.m = self.b1 * self.m + (1 - self.b1) * grad_wrt_w

self.v = self.b2 * self.v + (1 - self.b2) * np.power(grad_wrt_w, 2) m_hat = self.m / (1 - self.b1)

v_hat = self.v / (1 - self.b2) self.w_updt = self.learning_rate * m_hat / (np.sqrt(v_hat) + self.eps) return w - self.w_updt

这里导入了了mlfromscratch.utils中的make_diagonal, normalize函数,它们在data_manipulation.py中。但是好像没有用到,还是去看一下这两个函数:

def make_diagonal(x):

""" Converts a vector into an diagonal matrix """

m = np.zeros((len(x), len(x)))

for i in range(len(m[0])):

m[i, i] = x[i]

return m

def normalize(X, axis=-1, order=2):

""" Normalize the dataset X """

l2 = np.atleast_1d(np.linalg.norm(X, order, axis))

l2[l2 == 0] = 1

return X / np.expand_dims(l2, axis)

make_diagonal()的作用是将x中的元素变成对角元素。

normalize()函数的作用是正则化。

补充:

- np.linalg.norm(x, ord=None, axis=None, keepdims=False):需要注意ord的值表示的是范数的类型。

- np.atleast_1d():改变维度,将输入直接视为1维,比如np.atleast_1d([1])的输出就是[1]

- np.expand_dims():用于扩展数组的维度,要深入了解还是得去查一下。

然后再看看优化器的实现,以最常用的随机梯度下降为例:

class StochasticGradientDescent():

def __init__(self, learning_rate=0.01, momentum=0):

self.learning_rate = learning_rate

self.momentum = momentum

self.w_updt = None def update(self, w, grad_wrt_w):

# If not initialized

if self.w_updt is None:

self.w_updt = np.zeros(np.shape(w))

# Use momentum if set

self.w_updt = self.momentum * self.w_updt + (1 - self.momentum) * grad_wrt_w

# Move against the gradient to minimize loss

return w - self.learning_rate * self.w_updt

直接看带动量的随机梯度下降公式:

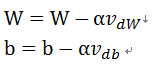

这里的β就是动量momentum的值,一般取值是0.9。正好是对应上面的公式,最后更新W和b就是:

其中 α就表示学习率learning_rate。

至于不同优化器之间的优缺点就不在本文的考虑追之中了,可以自行去查下。

【python实现卷积神经网络】优化器的实现(SGD、Nesterov、Adagrad、Adadelta、RMSprop、Adam)的更多相关文章

- 各种优化器对比--BGD/SGD/MBGD/MSGD/NAG/Adagrad/Adam

指数加权平均 (exponentially weighted averges) 先说一下指数加权平均, 公式如下: \[v_{t}=\beta v_{t-1}+(1-\beta) \theta_{t} ...

- 各种优化方法总结比较(sgd/momentum/Nesterov/adagrad/adadelta)

前言 这里讨论的优化问题指的是,给定目标函数f(x),我们需要找到一组参数x,使得f(x)的值最小. 本文以下内容假设读者已经了解机器学习基本知识,和梯度下降的原理. Batch gradient d ...

- 基于Python的卷积神经网络和特征提取

基于Python的卷积神经网络和特征提取 用户1737318发表于人工智能头条订阅 224 在这篇文章中: Lasagne 和 nolearn 加载MNIST数据集 ConvNet体系结构与训练 预测 ...

- 深度学习笔记:优化方法总结(BGD,SGD,Momentum,AdaGrad,RMSProp,Adam)

深度学习笔记:优化方法总结(BGD,SGD,Momentum,AdaGrad,RMSProp,Adam) 深度学习笔记(一):logistic分类 深度学习笔记(二):简单神经网络,后向传播算法及实现 ...

- 【python实现卷积神经网络】开始训练

代码来源:https://github.com/eriklindernoren/ML-From-Scratch 卷积神经网络中卷积层Conv2D(带stride.padding)的具体实现:https ...

- 【python实现卷积神经网络】卷积层Conv2D反向传播过程

代码来源:https://github.com/eriklindernoren/ML-From-Scratch 卷积神经网络中卷积层Conv2D(带stride.padding)的具体实现:https ...

- 【python实现卷积神经网络】全连接层实现

代码来源:https://github.com/eriklindernoren/ML-From-Scratch 卷积神经网络中卷积层Conv2D(带stride.padding)的具体实现:https ...

- 【python实现卷积神经网络】批量归一化层实现

代码来源:https://github.com/eriklindernoren/ML-From-Scratch 卷积神经网络中卷积层Conv2D(带stride.padding)的具体实现:https ...

- 【python实现卷积神经网络】池化层实现

代码来源:https://github.com/eriklindernoren/ML-From-Scratch 卷积神经网络中卷积层Conv2D(带stride.padding)的具体实现:https ...

随机推荐

- 关于WPF System.windows.Media.FontFamily 的类型初始值设定项引发异常问题解决方法

造成原因:此问题的根本原因是.NET Framework January 2018 Rollup(KB4055002)与已安装的.NET Framework 4.7.1产品版本之间的MSI安装交互.R ...

- Linux学习第六天

学习Linux环境下的挂载命令. 什么是挂载命令? 1.Windows下,mount挂载,就是给磁盘分区提供一个盘符(C,D,E,...).比如插入U盘后系统自动分配给了它I:盘符其实就是挂载,退优盘 ...

- 图数据库 Nebula Graph TTL 特性

导读 身处在现在这个大数据时代,我们处理的数据量需以 TB.PB, 甚至 EB 来计算,怎么处理庞大的数据集是从事数据库领域人员的共同问题.解决这个问题的核心在于,数据库中存储的数据是否都是有效的.有 ...

- 二进制补码:Why & How

二进制补码:Why & How 学习计算机原理或者语言的底层操作难免会遇到用二进制补码表示负数的问题.由于一些书本上对于采用补码的原因没有详细解释,很多人会认为这只是一种规定,但实际上采用补码 ...

- java 为什么重写equals一定要重写hashcode?

前言 最近复习,又看到了这个问题,在此记录和整理,通过例子来说明这种情况的原因,使大家可以清晰明白这个问题. 初步探索 首先我们要了解equals方法是什么,hashcode方法是什么. equals ...

- TensorFlow系列专题(十三): CNN最全原理剖析(续)

目录: 前言 卷积层(余下部分) 卷积的基本结构 卷积层 什么是卷积 滑动步长和零填充 池化层 卷积神经网络的基本结构 总结 参考文献 一.前言 上一篇我们一直说到了CNN[1]卷积层的特性,今天 ...

- 记录一个不同的流媒体网站实现方法,和用Python爬虫爬它的坑

今天找到一片电影,想把它下载下来. 先开Networks工具分析一下: 初步分析发现,视频加载时会拉取TS格式的文件,推测这是一个m3u8的索引,记录着几百段TS文件,这样方便快进时加载. 但是实际分 ...

- 《Mathematical Analysis of Algorithms》中有关“就地排列”(In Situ Permutation)的算法分析

问题描述 把数列\((x_1,x_2,\cdots,x_n)\)变换顺序为\((x_{p(1)},x_{p(2)},\cdots,x_{p(n)})\),其中\(p\)是\(A=\{1,2,3,\cd ...

- Gin框架系列01:极速上手

Gin是什么? Gin是Go语言编写的web框架,具备中间件.崩溃处理.JSON验证.内置渲染等多种功能. 准备工作 本系列演示所有代码都在Github中,感兴趣的同学可以自行查阅,欢迎大家一起完善. ...

- Java常用类__装箱/拆箱

以下是常用的各两种方法(各类提供了构造方法,静态方法) 一.基本数据类型 转化为 包装类(装箱) 例:int i=10: Integer num=i;//num=10 二.包装类 转化为 基本数据类 ...