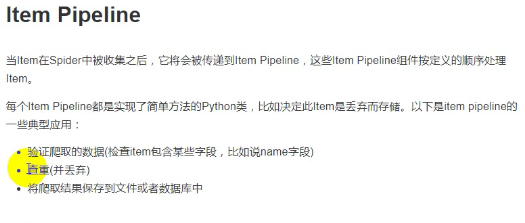

『Scrapy』全流程爬虫demo

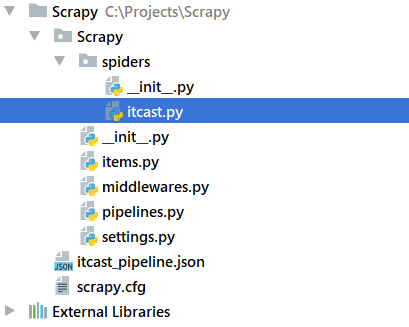

建立好的爬虫工程如下:

item.py

它用来存储解析后的响应文件:

# -*- coding: utf-8 -*- # Define here the models for your scraped items

#

# See documentation in:

# http://doc.scrapy.org/en/latest/topics/items.html import scrapy class ScrapyItem(scrapy.Item):

# define the fields for your item here like:

# name = scrapy.Field()

# pass

name = scrapy.Field()

title = scrapy.Field()

info = scrapy.Field()

这是一个类似字典的数据结构,通过dict(items)可以直接转换为字典,以上面为例,其实例具有'name','title','info'三个key值。

spider爬虫

sipder需要调用item字典用于临时存储解析出来的数据,注意使用yield来动态化整个过程

这里面没有着重介绍解析过程,原因是我现在也不太懂

import scrapy

from Scrapy.items import ScrapyItem class ITcastSpider(scrapy.Spider):

# 名称

name = 'itcast'

# 限制域

allowed_domains = 'itcast.cn'

# 起始域

start_urls = ['http://www.itcast.cn/channel/teacher.shtml'] def parse(self, response):

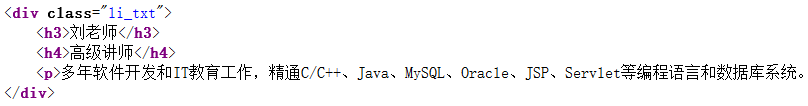

node_list = response.xpath("//div[@class='li_txt']")

for node in node_list:

item = ScrapyItem()

#

name = node.xpath('./h3/text()').extract()

title = node.xpath('./h4/text()').extract()

info = node.xpath('./p/text()').extract() item['name'] = name[0]

item['title'] = title[0]

item['info'] = info[0] yield item

由于我本身对html并不熟悉,为了理解一下我去原网页查看了一下源码,对应部分的结构如下:

spider的补充说明

一,视频spider中的return是返回给引擎,引擎会根据返回值的内容的做出不同处理,

- 如果是上面的item实例,则会交给管线程序处理,

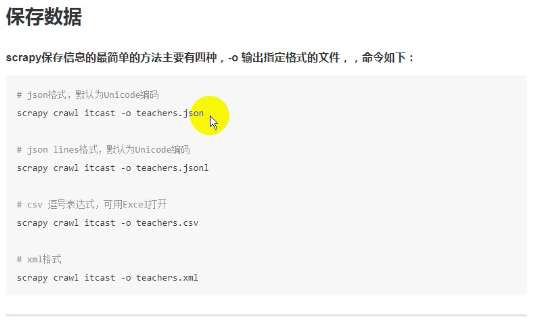

- 如果是list或者其他普通数据结构的话可以在crawl命令位置添加-o输出到文件,有一下四种输出,但是这种方法无法修改编码方式,

- return的是请求的话会进入新一轮的爬取,

二,有关response,这是一个响应对象,response.xpath()后是一个xpath对象,

print(node.xpath('./h3/text()'))

print(name)

print(name[0])看看输出,

[<Selector xpath='./h3/text()' data='杨老师'>]

['杨老师']

杨老师

也就是说.extract()方法可以把xpath对象的data部分提取出来作为一个字符串列表。

另一处就是xpath对象的提取规则了,//表示全匹配(任意匹配)而./表示当前匹配xpath对象下的级,text()就是文本对象了,不单单是xpath,response的解析方式还有其他的,css也是可以的,本节不过多讨论。

settings.py

指定管道文件,下面的语句原本是注释掉的,我们需要取消注释并可以做出修改,字典中的数字表示优先级,0~1000,越小优先度越高,spider解析出来的item数据会按照优先级依次流入各个管道做后续处理(存储之类的),由于是依次,所以管道处理数据后返回值必须是原始数据,这在后面会看到

# Configure item pipelines

# See http://scrapy.readthedocs.org/en/latest/topics/item-pipeline.html

ITEM_PIPELINES = {

'Scrapy.pipelines.ScrapyPipeline': 300,

}

pipelines.py

__init__()和close_spider()会被自动调用与爬虫起始与结束,process_item()会在每次出现返回值都被调用,并将自己的返回值交给下一优先级的管线

# -*- coding: utf-8 -*- # Define your item pipelines here

#

# Don't forget to add your pipeline to the ITEM_PIPELINES setting

# See: http://doc.scrapy.org/en/latest/topics/item-pipeline.html import json class ScrapyPipeline():

def __init__(self):

self.f = open('itcast_pipeline.json', 'w') def process_item(self, item, spider):

content = json.dumps(dict(item), ensure_ascii=False) + '\n'

self.f.write(content)

# 必须return这个,可以传给下一管道

return item def close_spider(self,spider):

self.f.close()

如果在这里面添加print(item),会看到输出如下,每次一行:

{'info': '五年以上教学经验及多年开发经验,精通C/S架构、B/S架构,涉足.NET、IOS等技术平台及各种数据库系统。精通多种主流编程语言。课上行云流水,通俗易懂,由浅入深,诙谐幽默。待学员如初恋,一个肯为学员玩命教学的男人! ', 'title': '高

级讲师', 'name': '杨老师'}

json.dumps()操作将字典转化为str,而json.loads()做反向变换,它们和保存文件的尾缀没有关系,由于默认是ascii格式保存一般中文会加上ensure_ascii=False:

In [1]: import json

In [2]: a = {'name': 'wang', 'age': 29}

In [3]: b = json.dumps(a) In [4]: print b, type(b)

{"age": 29, "name": "wang"} <type 'str'> In [11]: json.loads(b)

Out[11]: {u'age': 29, u'name': u'wang'} In [12]: print type(json.loads(b))

<type 'dict'>

运行

scrapy check itcast # 检查逻辑是否有错误

scrapy crawl itcast # 运行爬虫,注意,指定的是爬虫类的名称属性

『Scrapy』全流程爬虫demo的更多相关文章

- 『Scrapy』爬取腾讯招聘网站

分析爬取对象 初始网址, http://hr.tencent.com/position.php?@start=0&start=0#a (可选)由于含有多页数据,我们可以查看一下这些网址有什么相 ...

- 『Scrapy』爬虫框架入门

框架结构 引擎:处于中央位置协调工作的模块 spiders:生成需求url直接处理响应的单元 调度器:生成url队列(包括去重等) 下载器:直接和互联网打交道的单元 管道:持久化存储的单元 框架安装 ...

- 『Scrapy』爬取斗鱼主播头像

分析目标 爬取的是斗鱼主播头像,示范使用的URL似乎是个移动接口(下文有提到),理由是网页主页属于动态页面,爬取难度陡升,当然爬取斗鱼主播头像这么恶趣味的事也不是我的兴趣...... 目标URL如下, ...

- 『Scrapy』终端调用&选择器方法

Scrapy终端 示例,输入如下命令后shell会进入Python(或IPython)交互式界面: scrapy shell "http://www.itcast.cn/channel/te ...

- Python爬虫:scrapy 的运行流程和各模块的作用

scrapy的运行流程 爬虫 -> 起始URL封装Request -> 爬虫中间件 -> 引擎 -> 调度器(Scheduler): 缓存请求, 请求去重 调度器 -> ...

- 『Json』常用方法记录

json模块可以把字典结构改写为string然后保存,并可以反向读取字典 pickle模块则可以持久化任意数据结构 但是即使同样是字典数据结构,两个包也是有差别的, json字典value不支持其他对 ...

- 『Os』常用方法记录

os.rename(name_old, name_new) 『Scrapy』爬取斗鱼主播头像 重命名函数os.rename比win下的重命名强多了,它可以对路径重命名达到修改文件位置的功效. os.p ...

- 『TensorFlow』流程控制

『PyTorch』第六弹_最小二乘法对比PyTorch和TensorFlow TensorFlow 控制流程操作 TensorFlow 提供了几个操作和类,您可以使用它们来控制操作的执行并向图中添加条 ...

- python 网络爬虫全流程教学,从入门到实战(requests+bs4+存储文件)

python 网络爬虫全流程教学,从入门到实战(requests+bs4+存储文件) requests是一个Python第三方库,用于向URL地址发起请求 bs4 全名 BeautifulSoup4, ...

随机推荐

- python环境安装selenium和手动下载安装selenium的方法

方法1:cmd环境下,用pip install selenium 可能会很慢 方法2:下载selenium安装包手动安装 下载地址:https://pypi.org/project/selenium/ ...

- 借助IDE到处Runnable JAR 的步骤

1. 选择项目,右键,export,选择Java目录下的Runnable JAR file , next 2. Lanch configuration 中选择启动类 3. Export destina ...

- DBMS_OUTPUT.PUT_LINE()方法的简单介绍

1.最基本的DBMS_OUTPUT.PUT_LINE()方法. 随便在什么地方,只要是BEGIN和END之间,就可以使用DBMS_OUTPUT.PUT_LINE(output);然而这会有一个问题,就 ...

- cojs 强连通图计数1-2 题解报告

OwO 题目含义都是一样的,只是数据范围扩大了 对于n<=7的问题,我们直接暴力搜索就可以了 对于n<=1000的问题,我们不难联想到<主旋律>这一道题 没错,只需要把方程改一 ...

- java异常复习

如果有时学东西概念太多了,可以反着学,从结果到过程,从代码到概念,也许就不会那么枯燥了,比如学反射的时候. java异常复习 异常和错误的区别? 异常:程序或环境本身出现错误.(程序员可以捕获并处理) ...

- P2571 [SCOI2010]传送带

P2571 [SCOI2010]传送带 三分套三分. 前提条件:P3382 [模板]三分法 三分,求区间内单峰函数的最大/最小值. 我们把两条线段都跑三分,先ab后cd,求出最小值. 可以直接将二维坐 ...

- Java 实现后缀xls文件读取

Java 实现后缀xls文件读取 一.开发环境 poi采用的3.9版本 + JDK1.6 + Myeclipse 二,JAR包 三.实现代码 实体类:UserRoleBean package nc.x ...

- (GO_GTD_3)基于OpenCV和QT,建立Android图像处理程序

一.解决权限问题 图片采集了,处理了,如何保存?最直接的方法是使用imwrite,但是如果现在直接使用的话,比如会出现这样或那样的错误,因为我们现在是在android的环境下进行图像处理,所以 ...

- 20145337《网络对抗技术》MSF基础应用

20145337<网络对抗技术>MSF基础应用 一.实验后回答问题 什么是exploit.payload.encode Metasploit这种模块化的设计,大大提高了代码的复用率.exp ...

- uboot 网络驱动模型

原文:https://blog.csdn.net/zhouxinlin2009/article/details/45390065 UBOOT的PHYCHIP配置 PHYCHIP的配置位于 includ ...