scrapy的CrawlSpider类

了解CrawlSpider

踏实爬取一般网站的常用spider,其中定义了一些规则(rule)来提供跟进link的方便机制,也许该spider不适合你的目标网站,但是对于大多数情况是可以使用的。因此,可以以此为七点,根据需求修改部分方法,当然也可以实现自己的spider。

官方文档:http://scrapy-chs.readthedocs.io/zh_CN/0.24/topics/spiders.html#crawlspider

CrawlSpider的使用

简单使用

创建爬虫文件:scrapy genspider -t crawl "spider_name" "url"

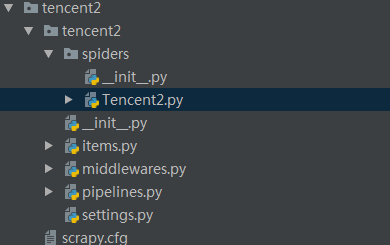

得到如下目录:

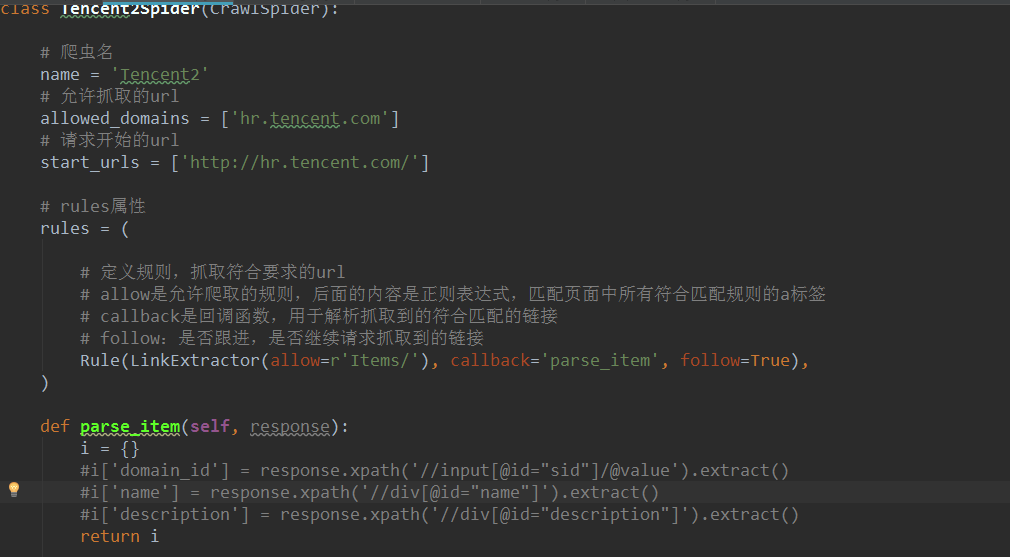

其中spider文件夹中的爬虫文件下的内容如下所示:

CrawlSpider是Spider的派生类,Spider类的设计原则是只爬取start_url列表中的网页,而CrawlSpider类中定义了一些规则(rule)来提取跟进link的方便机制,从而爬取的网页中获取link并继续爬取。

方法属性

Name:定义spider的名字

allow_domains:包含了spider允许抓起去的域名列表。

start_url:初始化url列表,当没有指定的url时,spider将从该列表中开始进行爬取。

start_requests(self):该方法返回一个可迭代对象,该对象包含了spider用于抓取的第一个request。

parse(self, resposne):默认的Request对象回调函数,用来处理返回的response,以及生成Items或者Request对象。

使用CralwSpider抓取数据

编写CrawlSpider,抓取腾讯招聘的信息,具体网页分析,见:

http://www.cnblogs.com/pythoner6833/p/9018782.html

具体代码如下:

# -*- coding: utf-8 -*-

import scrapy

from scrapy.linkextractors import LinkExtractor

from scrapy.spiders import CrawlSpider, Rule

from tencent2.items import Tencent2Item, DetailsItem class Tencent2Spider(CrawlSpider): # 爬虫名

name = 'Tencent2'

# 允许抓取的url

allowed_domains = ['hr.tencent.com']

# 请求开始的url

start_urls = ['https://hr.tencent.com/position.php?'] # rules属性

rules = ( # 定义规则,抓取符合要求的url

# allow是允许爬取的规则,后面的内容是正则表达式,匹配页面中所有符合匹配规则的a标签

# callback是回调函数,用于解析抓取到的符合匹配的链接

# follow:是否跟进,是否继续请求抓取到的链接

Rule(LinkExtractor(allow=r'start=\d+'), callback='parse_tencent', follow=True), #编写匹配详情页的规则,抓取到详情页的链接后不用跟进

Rule(LinkExtractor(allow=r'position_detail\.php\?id=\d+'), callback='parse_detail', follow=False),

) def parse_tencent(self, response):

# 获取页面中招聘信息在网页中位置节点

node_list = response.xpath('//tr[@class="even"] | //tr[@class="odd"]') # 遍历节点,进入详情页,获取其他信息

for node in node_list:

# 实例化,填写数据

item = Tencent2Item() item['position_name'] = node.xpath('./td[1]/a/text()').extract_first()

item['position_link'] = node.xpath('./td[1]/a/@href').extract_first()

item['position_type'] = node.xpath('./td[2]/text()').extract_first()

item['wanted_number'] = node.xpath('./td[3]/text()').extract_first()

item['work_location'] = node.xpath('./td[4]/text()').extract_first()

item['publish_time'] = node.xpath('./td[5]/text()').extract_first() yield item def parse_detail(self, response):

"""

解析详情页数据

:param response:

:return:

"""

item = DetailsItem()

# 从详情页获取工作责任和工作技能两个字段名

item['work_duties'] = ''.join(response.xpath('//ul[@class="squareli"]')[0].xpath('./li/text()').extract())

item['work_skills'] = ''.join(response.xpath('//ul[@class="squareli"]')[1].xpath('./li/text()').extract())

yield item

其他部分,包括items.py和数据保存的pipelines.py里的代码编写和上文中链接里的已解释。

scrapy的CrawlSpider类的更多相关文章

- Scrapy框架——CrawlSpider类爬虫案例

Scrapy--CrawlSpider Scrapy框架中分两类爬虫,Spider类和CrawlSpider类. 此案例采用的是CrawlSpider类实现爬虫. 它是Spider的派生类,Spide ...

- python爬虫入门(八)Scrapy框架之CrawlSpider类

CrawlSpider类 通过下面的命令可以快速创建 CrawlSpider模板 的代码: scrapy genspider -t crawl tencent tencent.com CrawSpid ...

- Scrapy的Spider类和CrawlSpider类

Scrapy shell 用来调试Scrapy 项目代码的 命令行工具,启动的时候预定义了Scrapy的一些对象 设置 shell Scrapy 的shell是基于运行环境中的python 解释器sh ...

- scrapy项目4:爬取当当网中机器学习的数据及价格(CrawlSpider类)

scrapy项目3中已经对网页规律作出解析,这里用crawlspider类对其内容进行爬取: 项目结构与项目3中相同如下图,唯一不同的为book.py文件 crawlspider类的爬虫文件book的 ...

- Scrapy框架-CrawlSpider

目录 1.CrawlSpider介绍 2.CrawlSpider源代码 3. LinkExtractors:提取Response中的链接 4. Rules 5.重写Tencent爬虫 6. Spide ...

- 13.CrawlSpider类爬虫

1.CrawlSpider介绍 Scrapy框架中分两类爬虫,Spider类和CrawlSpider类. 此案例采用的是CrawlSpider类实现爬虫. 它是Spider的派生类,Spider类的设 ...

- 全栈爬取-Scrapy框架(CrawlSpider)

引入 提问:如果想要通过爬虫程序去爬取”糗百“全站数据新闻数据的话,有几种实现方法? 方法一:基于Scrapy框架中的Spider的递归爬取进行实现(Request模块递归回调parse方法). 方法 ...

- Scrapy框架——CrawlSpider爬取某招聘信息网站

CrawlSpider Scrapy框架中分两类爬虫,Spider类和CrawlSpider类. 它是Spider的派生类,Spider类的设计原则是只爬取start_url列表中的网页, 而Craw ...

- python爬虫之Scrapy框架(CrawlSpider)

提问:如果想要通过爬虫程序去爬取”糗百“全站数据新闻数据的话,有几种实现方法? 方法一:基于Scrapy框架中的Spider的递归爬去进行实现的(Request模块回调) 方法二:基于CrawlSpi ...

随机推荐

- leetcode系列---Two Sum C#code

/// <summary> /// 方法一:双循环 /// </summary> /// <param name="array"></pa ...

- 一个开源组件 bug 引发的分析

这是一个悲伤的故事.某日清晨,距离版本转测还剩一天,切图仔的我正按照计划有条不紊的画页面.当我点击一个下拉弹框组件中分页组件页数过多而出现的向后 5 页省略号时,悲剧开始了,弹框被收回了.情景再现 问 ...

- Nginx 的请求处理流程,你了解吗?

之前我们已经讲解了 Nginx 的基础内容,接下来我们开始介绍 Nginx 的架构基础. 为什么我们要讨论 Nginx 的架构基础? 因为 Nginx 运行在企业内网的最外层也就是边缘节点,那么他处理 ...

- CSPS_106

这场 死的太惨了! 我也不把我的错误像倒垃圾一样放在blog里了qwq 通过这场考试 我深深地认识到了情绪对人类的影响qwq 只要这种东西,不要出现在我的csp中就好了 T1 区间DP.. T2 枚举 ...

- kettle数据同步的5中方案

数据同步:当数据源发生改变时,其他相关数据也跟着发展变化.根据需求不同可采取以下方案.1.触发器:在数据库建立增删改的触发器.触发器将变更放到一张临时表里.oracle同步cdc优点:实时同步缺点:影 ...

- git命令--subtree

目录 git命令--subtree subtree 主要命令 git subtree add --prefix=<prefix> <commit> git subtree ...

- day 2 DP专场

上午讲了一上午背包,从01背包到完全背包到多重背包,感觉也没说什么,旁边的大佬一直在飞鸽里说让老师讲快点,然而最后也没人敢跟老师说.... 例题真的各个都是神仙题, 挂饰 好像就是一上午最简单的... ...

- 线性模型之逻辑回归(LR)(原理、公式推导、模型对比、常见面试点)

参考资料(要是对于本文的理解不够透彻,必须将以下博客认知阅读,方可全面了解LR): (1).https://zhuanlan.zhihu.com/p/74874291 (2).逻辑回归与交叉熵 (3) ...

- 【集合系列】- 初探java集合框架图

一.集合类简介 Java集合就像一种容器,可以把多个对象(实际上是对象的引用,但习惯上都称对象)"丢进"该容器中.从Java 5 增加了泛型以后,Java集合可以记住容器中对象的数 ...

- Keras 中间层可视化,附代码详解,以Mnist数字为对象

最近搭建了个Resnet50 的神经网络模型,相看一看中间某一层的输出结果,想感性的感受下逐层提取特征的过程,以数字0为对象,对数字0逐层提取特征,话不多说直接上代码,关于如何搭建Resnet,可以参 ...