爬虫(八):分析Ajax请求抓取今日头条街拍美图

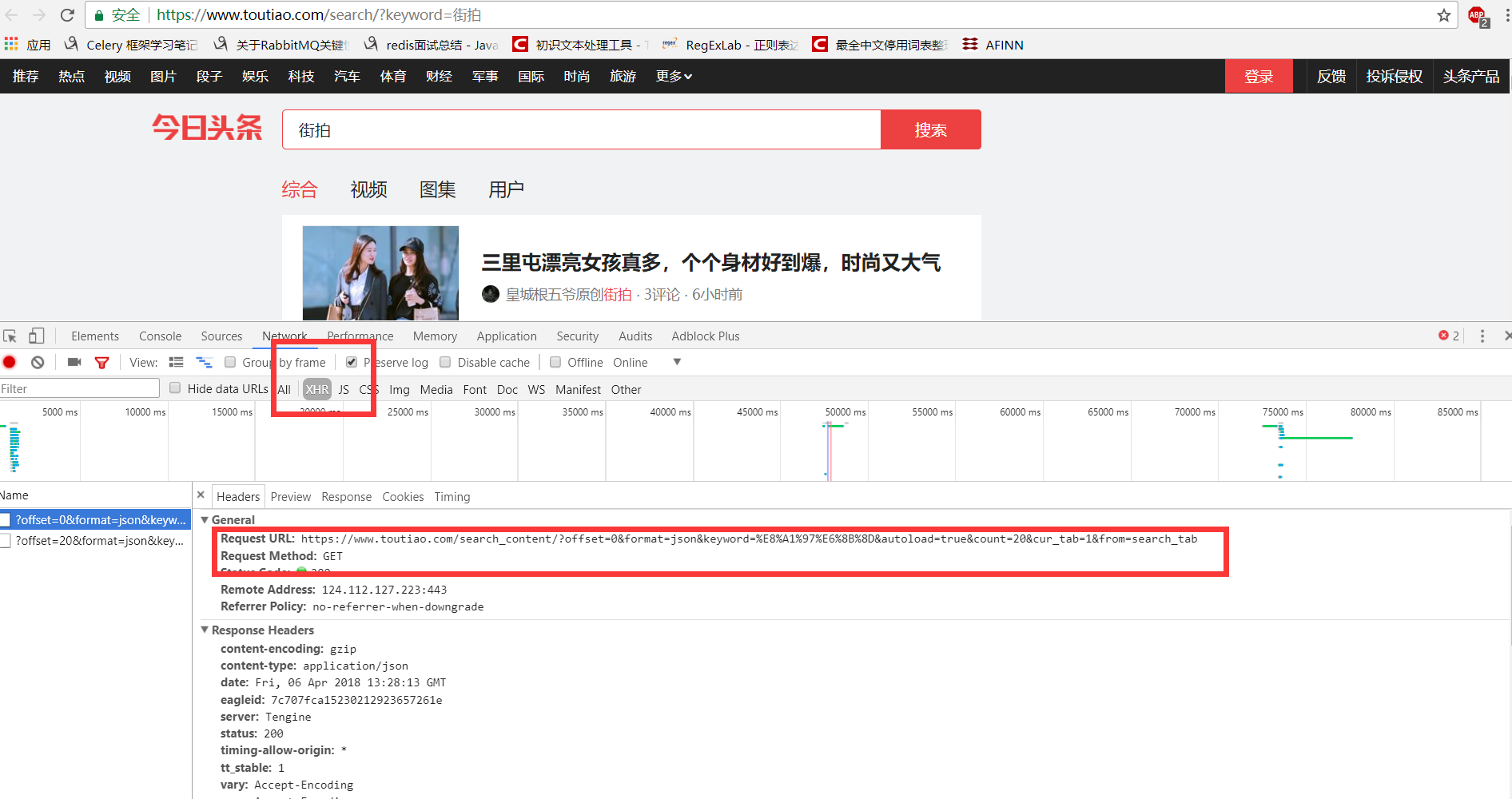

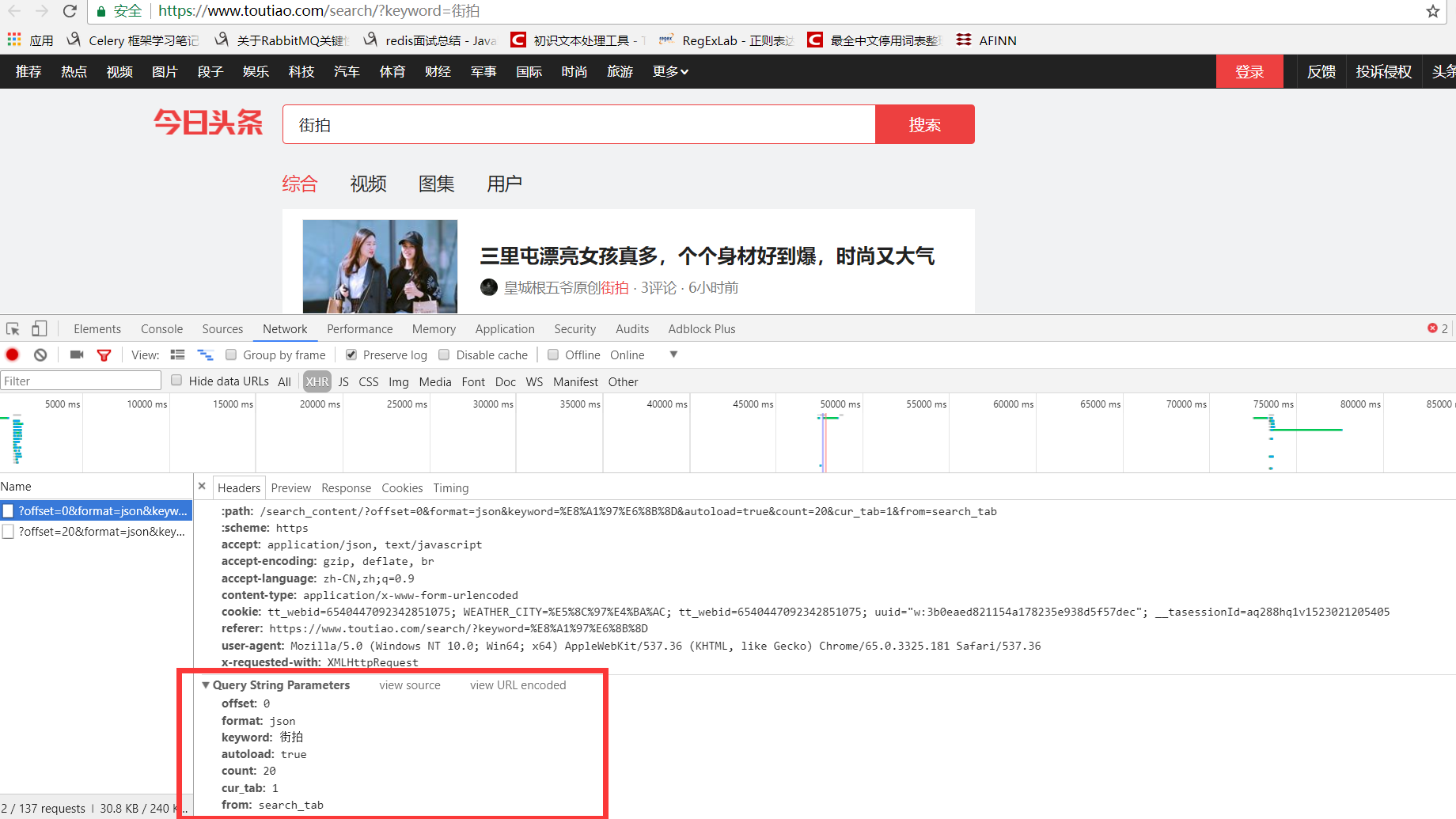

(1):分析网页

分析ajax的请求网址,和需要的参数。通过不断向下拉动滚动条,发现请求的参数中offset一直在变化,所以每次请求通过offset来控制新的ajax请求。

(2)上代码

a、通过ajax请求获取页面数据

# 获取页面数据

def get_page_index(offset, keyword):

# 参数通过分析页面的ajax请求获得

data = {

'offset': offset,

'format': 'json',

'keyword': keyword,

'autoload': 'true',

'count': '',

'cur_tab': '',

'from': 'search_tab',

}

url = 'https://www.toutiao.com/search_content/?' + urlencode(data) # 将字典转换为url参数形式

try:

response = requests.get(url, headers=headers)

if response.status_code == 200:

return response.text

else:

return None

except RequestException:

print('请求索引页错误')

return None

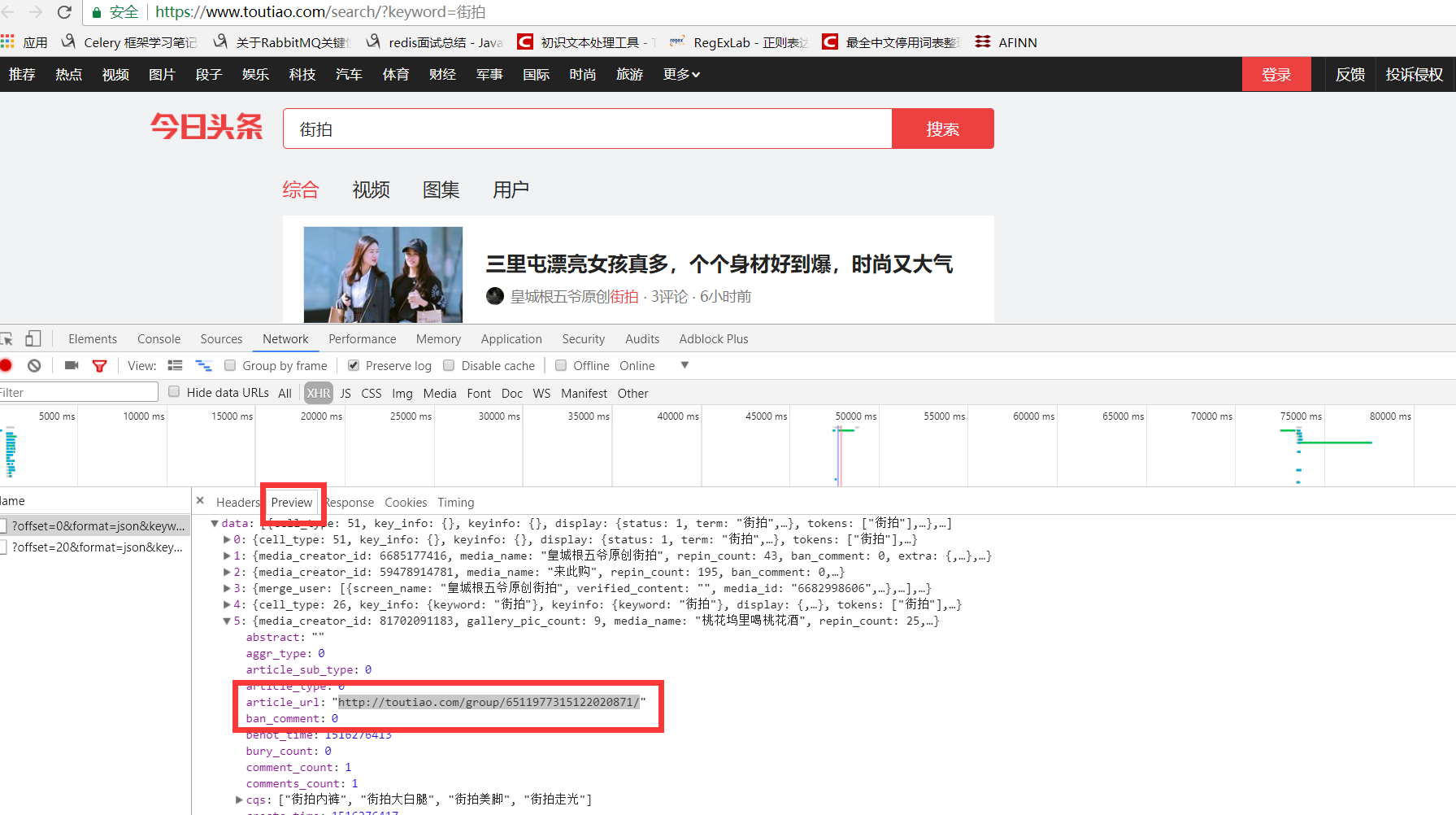

b、分析ajax请求的返回结果,获取图片集的url

# 分析ajax请求的返回结果,获取图片集的url

def parse_page_index(html):

data = json.loads(html) # 加载返回的json数据

if data and 'data' in data.keys():

for item in data.get('data'):

yield item.get('article_url')

c、得到图集url后获取图集的内容

# 获取详情页的内容

def get_page_detail(url):

try:

response = requests.get(url, headers=headers)

if response.status_code == 200:

return response.text

else:

return None

except RequestException:

print('详情页页错误', url)

return None

d、其他看完整代码

完整代码:

# -*- coding: utf-8 -*-

# @Author : FELIX

# @Date : 2018/4/4 12:49 import json import os

from hashlib import md5 import requests

from urllib.parse import urlencode

from requests.exceptions import RequestException

from bs4 import BeautifulSoup

import re

import pymongo

from multiprocessing import Pool MONGO_URL='localhost' MONGO_DB='toutiao' MONGO_TABLE='toutiao' GROUP_START=1

GROUP_END=20

KEYWORD='街拍' client = pymongo.MongoClient(MONGO_URL) # 连接MongoDB

db = client[MONGO_DB] # 如果已经存在连接,否则创建数据库 headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/65.0.3325.181 Safari/537.36',

} # 获取页面数据

def get_page_index(offset, keyword):

# 参数通过分析页面的ajax请求获得

data = {

'offset': offset,

'format': 'json',

'keyword': keyword,

'autoload': 'true',

'count': '',

'cur_tab': '',

'from': 'search_tab',

}

url = 'https://www.toutiao.com/search_content/?' + urlencode(data) # 将字典转换为url参数形式

try:

response = requests.get(url, headers=headers)

if response.status_code == 200:

return response.text

else:

return None

except RequestException:

print('请求索引页错误')

return None # 分析ajax请求的返回结果,获取图片集的url

def parse_page_index(html):

data = json.loads(html) # 加载返回的json数据

if data and 'data' in data.keys():

for item in data.get('data'):

yield item.get('article_url') # 获取详情页的内容

def get_page_detail(url):

try:

response = requests.get(url, headers=headers)

if response.status_code == 200:

return response.text

else:

return None

except RequestException:

print('详情页页错误', url)

return None def parse_page_detail(html, url):

# soup=BeautifulSoup(html,'lxml')

# print(soup)

# title=soup.select('tetle').get_text()

# print(title)

images_pattern = re.compile('articleInfo:.*?title: \'(.*?)\'.*?content.*?\'(.*?)\'', re.S)

result = re.search(images_pattern, html)

if result:

title = result.group(1)

url_pattern = re.compile('"(http:.*?)"')

img_url = re.findall(url_pattern, str(result.group(2)))

if img_url:

for img in img_url:

download_img(img) # 下载

data = {

'title': title,

'url': url,

'images': img_url,

}

return data def save_to_mongo(result):

if result:

if db[MONGO_TABLE].insert(result): # 插入数据

print('存储成功', result)

return True

return False def download_img(url):

print('正在下载', url)

try:

response = requests.get(url, headers=headers)

if response.status_code == 200:

save_img(response.content)

else:

return None

except RequestException:

print('下载图片错误', url)

return None def save_img(content):

# os.getcwd()获取当前文件路径,用md5命名,保证不重复

file_path = '{}/imgs/{}.{}'.format(os.getcwd(), md5(content).hexdigest(), 'jpg')

if not os.path.exists(file_path):

with open(file_path, 'wb')as f:

f.write(content) def main(offset):

html = get_page_index(offset, KEYWORD)

for url in parse_page_index(html):

html = get_page_detail(url)

print(url,'++++++++++++++++++++++++++++++++++++++++++++++++')

print(html)

if html:

result = parse_page_detail(html, url)

save_to_mongo(result)

# print(result)

# print(url) if __name__ == '__main__':

groups = [i * 20 for i in range(GROUP_START, GROUP_END + 1)]

pool = Pool()

pool.map(main, groups)

爬虫(八):分析Ajax请求抓取今日头条街拍美图的更多相关文章

- python3爬虫-分析Ajax,抓取今日头条街拍美图

# coding=utf-8 from urllib.parse import urlencode import requests from requests.exceptions import Re ...

- 通过分析Ajax请求 抓取今日头条街拍图集

代码: import os import re import json import time from hashlib import md5 from multiprocessing import ...

- 分析Ajax来爬取今日头条街拍美图并保存到MongDB

前提:.需要安装MongDB 注:因今日投票网页发生变更,如下代码不保证能正常使用 #!/usr/bin/env python #-*- coding: utf-8 -*- import json i ...

- python爬虫之分析Ajax请求抓取抓取今日头条街拍美图(七)

python爬虫之分析Ajax请求抓取抓取今日头条街拍美图 一.分析网站 1.进入浏览器,搜索今日头条,在搜索栏搜索街拍,然后选择图集这一栏. 2.按F12打开开发者工具,刷新网页,这时网页回弹到综合 ...

- 15-分析Ajax请求并抓取今日头条街拍美图

流程框架: 抓取索引页内容:利用requests请求目标站点,得到索引网页HTML代码,返回结果. 抓取详情页内容:解析返回结果,得到详情页的链接,并进一步抓取详情页的信息. 下载图片与保存数据库:将 ...

- Python Spider 抓取今日头条街拍美图

""" 抓取今日头条街拍美图 """ import os import time import requests from hashlib ...

- 分析Ajax请求并抓取今日头条街拍美图

项目说明 本项目以今日头条为例,通过分析Ajax请求来抓取网页数据. 有些网页请求得到的HTML代码里面并没有我们在浏览器中看到的内容.这是因为这些信息是通过Ajax加载并且通过JavaScript渲 ...

- 2.分析Ajax请求并抓取今日头条街拍美图

import requests from urllib.parse import urlencode # 引入异常类 from requests.exceptions import RequestEx ...

- 分析 ajax 请求并抓取今日头条街拍美图

首先分析街拍图集的网页请求头部: 在 preview 选项卡我们可以找到 json 文件,分析 data 选项,找到我们要找到的图集地址 article_url: 选中其中一张图片,分析 json 请 ...

随机推荐

- spring的事务解决方案之@Transactional注解

首先此注解位于 org.springframework.transaction.annotation 这个包路径下面, 事务有两种类别,一种是编程式事务,另一种是声明式事务,显然此注解是声明式事务,这 ...

- Docker 学习笔记(一):基础命令

仅为个人查阅使用,要学习 Docker 的话,推荐看这份文档:<Docker - 从入门到实践> P.S. 大多数的 docker container xxx/docker image x ...

- Linux下用命令来执行kettle文件资源库的文件ktr与kjb的方法

转载地址: https://blog.csdn.net/zuolovefu/article/details/78083445 1. 准备工作 一个简单的job,一个简单的trans. trans:读取 ...

- 立体像对空间前方交会-共线方程求解法(python实现)

一.原理 二.步骤 a.用各自像片的角元素计算出左右像片的旋转矩阵R1和R2. b.有同名像点列出共线方程. c.将方程写为未知数的线性方程形式,计算线性系数. d.写出误差方程,系数矩阵与常数项. ...

- js的for循环中出现异步函数,回调引用的循环值总是最后一步的值?

这几天跟着视频学习node.js,碰到很多的异步函数的问题,现在将for循环中出现的异步函数回调值的问题总结如下: 具体问题是关于遍历文件夹中的子文件夹的,for循环包裹异步函数的代码: for (v ...

- 四、eureka服务端同步注册操作

所有文章 https://www.cnblogs.com/lay2017/p/11908715.html 正文 在eureka服务端注册服务一文中,我们提到register方法做了两件事 1)注册服务 ...

- 查询自动生成Guid列

--newid()可以在查询的时候自动生成Guid列 ' ordey by Random --创建对应的列 用 uniqueidentifier 类型 IF NOT EXISTS ( SELECT * ...

- Python标准库3.4.3-random

9.6. random — Generate pseudo-random numbers Source code: Lib/random.py 翻译:Z.F. This module impleme ...

- sed进阶教程

寻址规则 常规寻址 如果没有指定地址,那么命令将应用于每一行. 如果只有一个地址,那么命令应用于与这个地址匹配的任意行. 如果指定了由逗号分隔的两个地址,那么命令应用于匹配第一个地址(不包括第一个地址 ...

- arduino之16*16点阵庆祝祖国70周年

之前电脑上存了很多自己写的关于arduino的有趣的小demo,因为重装了系统,不小心误删了所有的文件(气的半死),所以现在准备一有空就重写一下之前写过的东东,顺带再温习一次,这次总不能再删了吧,嘿嘿 ...