爬虫(六):XPath、lxml模块

1. XPath

1.1 什么是XPath

XPath(XML Path Language) 是一门在XML和HTML文档中查找信息的语言,可用来在XML和HTML文档中对元素和属性进行遍历。

1.2 XPath开发工具

1.2.1 Chrome插件XPath Helper

https://jingyan.baidu.com/article/1e5468f94694ac484861b77d.html

1.2.2 Firefox插件XPath Checker

https://blog.csdn.net/menofgod/article/details/75646443

1.3 Xpath语法

这个就要看我写的selenium基础中的文章了。

https://www.cnblogs.com/liuhui0308/p/11937139.html

2. lxml模块

lxml是一个HTML/XML的解析库,主要功能是如何解析和提取HTML/XML数据。

lxml和正则是一样,也是用C语言实现的,是一款高性能的Python HTML/XML解析器,可以利用之前学习的XPath语法,来快速定位特定元素以及节点信息。

可通过 pip 安装:

pip install lxml -i http://pypi.douban.com/simple/ --trusted-host pypi.douban.com

2.1 基本使用

我们可以利用它来解析HTML 代码,且在解析 HTML 代码的时候,如果 HTML 代码不规范,他会自动进行补全。

from lxml.html import etree htmlText = '''

<div>

<ul>

<li class="item-0"><a href="link1.html">first item</a></li>

<li class="item-1"><a href="link2.html">second item</a></li>

<li class="item-inactive"><a href="link3.html">third item</a></li>

<li class="item-1"><a href="link4.html">fourth item</a></li>

<li class="item-0"><a href="link5.html">fifth item</a></li>

</ul>

</div>

''' # 利用 etree.HTML,将字符串解析为 HTML 文档

html = etree.HTML(htmlText) # 按字符串序列化 HTML 文档

result = etree.tostring(html, encoding='utf-8', pretty_print=True).decode('utf-8') print(result)

2.2 在文件中读取html代码

除了直接使用字符串进行解析,lxml 还支持从文件中读取内容。

html代码:

<!DOCTYPE html>

<html lang="zh-CN">

<head>

<meta charset="utf-8">

<title></title> </head>

<body>

<div>

<ul>

<li class="item-0"><a href="link1.html">first item</a></li>

<li class="item-1"><a href="link2.html">second item</a></li>

<li class="item-inactive"><a href="link3.html">third item</a></li>

<li class="item-1"><a href="link4.html">fourth item</a></li>

<li class="item-0"><a href="link5.html">fifth item</a></li>

</ul>

</div>

</body>

</html>

然后利用etree.parse()方法来读取文件。

from lxml.html import etree

html = etree.parse('./hello.html')

result = etree.tostring(html, encoding='utf-8', pretty_print=True).decode('utf-8')

print(result)

结果:

我们看到居然报错了,为什么呢?

之所以使用etree.parse()方法解析 html 内容时,会报lxml.etree.XMLSyntaxError的错,是因为etree.parse()默认使用的是XML的解析器,所以当html内容不规范,比如出现某个标签缺少闭合标签时,就会报这个错误。这时,可使用etree.HTMLParser()创建一个HTML的解析器,然后作为etree.parse()方法的参数即可。

from lxml.html import etree htmlParser = etree.HTMLParser(encoding='utf-8')

html = etree.parse('./hello.html', parser=htmlParser)

result = etree.tostring(html, encoding='utf-8', pretty_print=True).decode('utf-8')

print(result)

2.3 在lxml中使用XPath语法

使用XPath语法,应该使用Element.xpath语法,来执行XPath的选择。

xpath函数返回的永远是一个列表。

我们先来匹配下li标签和a标签

from lxml.html import etree htmlParser = etree.HTMLParser(encoding='utf-8')

html = etree.parse('./hello.html', parser=htmlParser) lis = html.xpath('//li')

for li in lis:

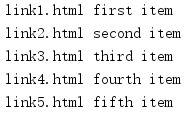

print(etree.tostring(li, encoding='utf-8', pretty_print=True).decode('utf-8'), end='') aList = html.xpath('//a/@href')

for a in aList:

print(a)

获得li标签下a标签的href属性和内容:

from lxml.html import etree htmlParser = etree.HTMLParser(encoding='utf-8')

html = etree.parse('./hello.html', parser=htmlParser) lis = html.xpath('//li')

for li in lis:

# . 号表示在当前的 li 元素下去匹配

href = li.xpath('.//a/@href')[0] #获取 a 标签的 href 属性

txt = li.xpath('.//a/text()')[0] #获取 a 标签的文本

print(href, txt)

爬虫(六):XPath、lxml模块的更多相关文章

- 洗礼灵魂,修炼python(71)--爬虫篇—【转载】xpath/lxml模块,爬虫精髓讲解

Xpath,lxml模块用法 转载的原因和前面的一样,我写的没别人写的好,所以我也不浪费时间了,直接转载这位崔庆才大佬的 原帖链接:传送门 以下为转载内容: --------------------- ...

- Python爬虫基础——XPath语法的学习与lxml模块的使用

XPath与正则都是用于数据的提取,二者的区别是: 正则:功能相对强大,写起来相对复杂: XPath:语法简单,可以满足绝大部分的需求: 所以,如果你可以根据自己的需要进行选择. 一.首先,我们需要为 ...

- Python爬虫 XPath语法和lxml模块

XPath语法和lxml模块 什么是XPath? xpath(XML Path Language)是一门在XML和HTML文档中查找信息的语言,可用来在XML和HTML文档中对元素和属性进行遍历. X ...

- lxml模块(应用xpath技术)

一.lxml介绍 第三方库lxml是第一款表现出高性能特征的python xml库,天生支持Xpath1.0.XSLT1.0.定制元素类,甚至python风格的数据绑定接口.lxml是通过Cpytho ...

- python爬虫网页解析之lxml模块

08.06自我总结 python爬虫网页解析之lxml模块 一.模块的安装 windows系统下的安装: 方法一:pip3 install lxml 方法二:下载对应系统版本的wheel文件:http ...

- XPath语法和lxml模块

XPath语法和lxml模块 什么是XPath? xpath(XML Path Language)是一门在XML和HTML文档中查找信息的语言,可用来在XML和HTML文档中对元素和属性进行遍历. X ...

- 爬虫学习笔记(六)PyQuery模块

PyQuery模块也是一个解析html的一个模块,它和Beautiful Soup用起来差不多,它是jquery实现的,和jquery语法差不多,会用jquery的人用起来就比较方便了. Pyquer ...

- python3爬虫lxml模块的安装

1:在下载lxml之前,要先查看python的版本信息, 在CMD命令行输入python 再输入import pip; print(pip.pep425tags.get_supported()) -- ...

- 【爬虫入门手记03】爬虫解析利器beautifulSoup模块的基本应用

[爬虫入门手记03]爬虫解析利器beautifulSoup模块的基本应用 1.引言 网络爬虫最终的目的就是过滤选取网络信息,因此最重要的就是解析器了,其性能的优劣直接决定这网络爬虫的速度和效率.Bea ...

随机推荐

- 【笔记】总结Springboot和Vue前后端分离的跨域问题

跨域一直是个很玄学的问题,SSM的时候又得前后端一起配置,sb的时候又不用. 前端 axios普通get请求 submitForm() { var v=this; this.$axios({ meth ...

- Java程序在内存中运行详解

目录 Java程序在内存中运行详解 一.JVM的内存分布 二.程序执行的过程 三.只有一个对象时的内存图 四.两个对象使用同一个方法的内存图 五.两个引用指向同一个对象的内存图 六.使用对象类型作为方 ...

- 模型量化原理及tflite示例

模型量化 什么是量化 模型的weights数据一般是float32的,量化即将他们转换为int8的.当然其实量化有很多种,主流是int8/fp16量化,其他的还有比如 二进制神经网络:在运行时具有二进 ...

- Mac OS 终端利器 iTerm2(怕以后找不到,自存自用)

之前一直使用 Mac OS 自带的终端,用起来虽然有些不太方便,但总体来说还是可以接受的,是有想换个终端的想法,然后今天偶然看到一个终端利器 iTerm2,发现真的很强大,也非常的好用,按照网上配置了 ...

- 依赖注入利器 - Dagger ‡

转载请标明出处:http://blog.csdn.net/shensky711/article/details/53715960 本文出自: [HansChen的博客] 概述 声明需要注入的对象 如何 ...

- MySQL主从介绍、配置主从、测试主从同步

6月28日任务 说明:有不少同学不能一次性把实验做成功,这是因为还不熟悉,建议至少做3遍17.1 MySQL主从介绍17.2 准备工作17.3 配置主17.4 配置从17.5 测试主从同步有的同学,遇 ...

- php踩过的那些坑(5)浮点数计算

一.前方有坑 php在使用加减乘除等运算符计算浮点数的时候,经常会出现意想不到的结果,特别是关于财务数据方面的计算,给不少工程师惹了很多的麻烦.比如今天工作终于到的一个案例: $a = 2586; $ ...

- css3学习——一列固定宽度且居中

<!DOCTYPE html><html lang="en"><head> <meta charset="UTF-8" ...

- 16.Django学习之文件上传和下载

上传就这么六步! 一. settings配置文件中配置 MEDIA_URL = '/media/' MEDIA_ROOT = os.path.join(BASE_DIR, 'medias').repl ...

- 3D硬件加速提升动画性能 与 z-index属性

目录 1. chrome Layer borders 2. 层创建标准 3. 例子 总结 1. chrome Layer borders <WebKit技术内幕>第二章介绍了网页的结构,其 ...