scrapy框架整理

0.安装scrapy框架

pip install scrapy

注:找不到的库,或者安装部分库报错,去python第三方库中找,很详细

https://www.lfd.uci.edu/~gohlke/pythonlibs/#wordcloud

1.创建一个scrapy框架

scrapy startproject 项目名

2.使用scrapy框架爬虫的三个步骤

a.配置items文件,确定需要爬取的字段

b.配置pipeline文件,确定文件的存储方式,并在setting文件中配置管道文件

注:如果存的是json数据,json.dumps(dict(item), ensure_ascii=False)

这里要记得将ensure_ascii置为False,原因是因为默认为ascii编码,但是中文用ascii编码会有问题

c.配置爬虫文件(分为两种,父类为Spider,CrawlSpider)

在终端中进入到项目目录下,执行:

scrapy genspider 爬虫名 限制的域名范围(创建Spider模板)

scrapy genspider -t crawl 爬虫名 限制的域名范围(创建CrawlSpider模板)

3.Spider类的使用

a.三个变量:name(爬虫名), allowed_domains(限定域), start_urls(最先请求的网站)

b.重写parse()方法,方法名必须是这个

c.在函数的最后yield item,会把item交给管道文件处理

d.如果需要再次发送请求的话需要 yield scrapy.Request(url,meta,callback)方法

url:为再次请求的地址

meta:请求携带的内容(字典格式),可以被response.meta取到,用于两个函数之间变量的传递

callback:请求的回调函数

4.CrawlSpider类的使用

a.三个变量(与Spider类一致)

b.rules规则的定义(用于匹配需要爬取的链接内容,且每次请求的页面也遵循这个规则)

优点:比Spider类更简洁,不需要写scrapy.Request()再次发送请求

注:rule规则可以写多条,如第一个规则用于翻页,第二个规则用于匹配当前页内中的链接

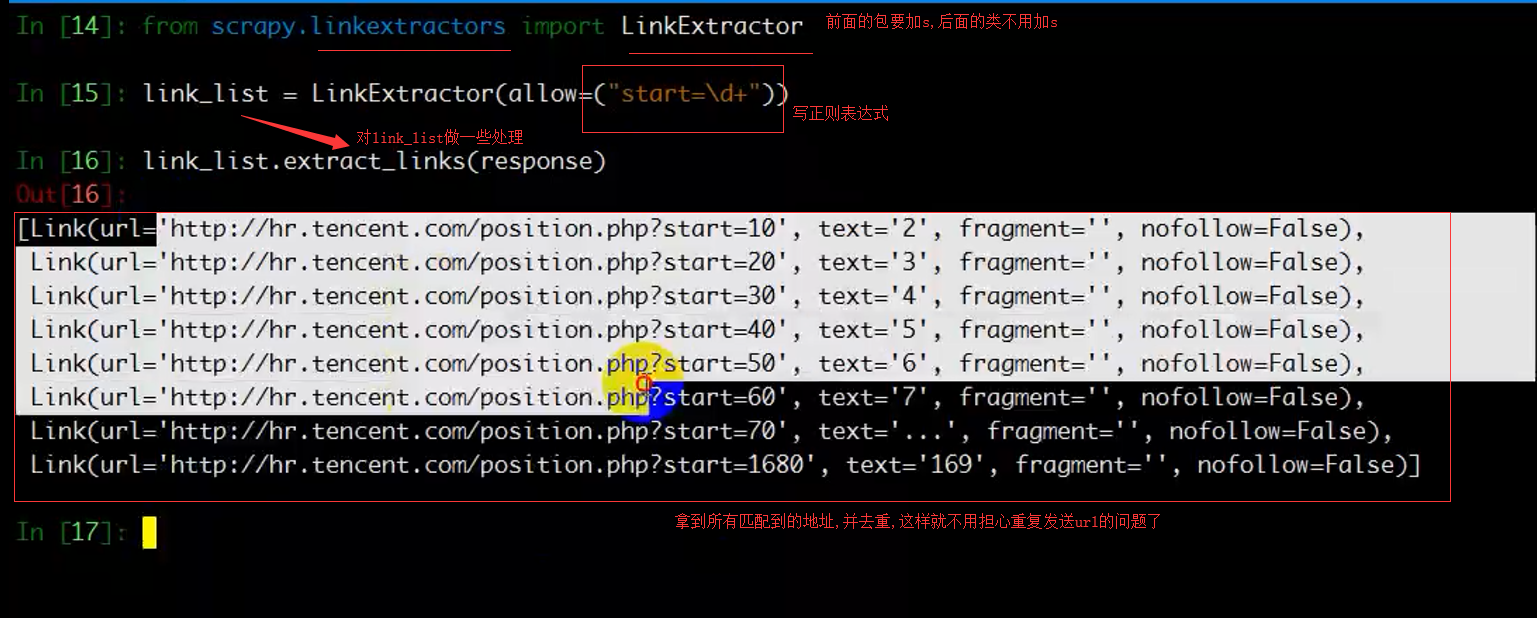

例:rules = (

Rule(LinkExtractor(allow=r'Items/'), callback='parse_item', follow=True),

)

allow:代表使用正则来匹配链接

restrict_xpaths:代表使用xpath来匹配链接

restrict_css:代表使用beautifulsoup4来匹配链接

callback:回调函数

follow:是否跟进(如果没有callback,follow默认为True),应用在匹配页码链接时,需要跟进

如果有callback,follow默认为False

注:在使用CrawlSpider时,callback不能再写parse,因为框架使用了parse实现其逻辑,我们在使用时,需要另起一个名字

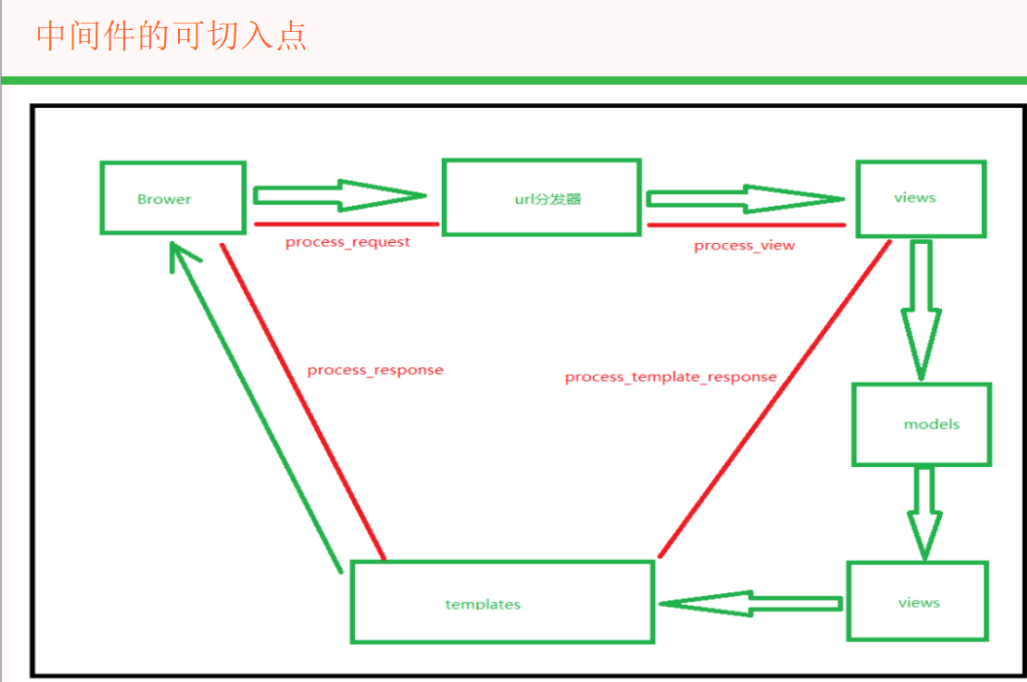

5.中间件的设置

1.定义User-Agent列表,循环使用

2.如果需要使用代理服务器,需要设置代理,并附上对应的host和账号密码

scrapy框架整理的更多相关文章

- Python爬虫从入门到放弃(十一)之 Scrapy框架整体的一个了解

这里是通过爬取伯乐在线的全部文章为例子,让自己先对scrapy进行一个整理的理解 该例子中的详细代码会放到我的github地址:https://github.com/pythonsite/spider ...

- python爬虫入门(六) Scrapy框架之原理介绍

Scrapy框架 Scrapy简介 Scrapy是用纯Python实现一个为了爬取网站数据.提取结构性数据而编写的应用框架,用途非常广泛. 框架的力量,用户只需要定制开发几个模块就可以轻松的实现一个爬 ...

- Scrapy 框架流程详解

框架流程图 Scrapy 使用了 Twisted 异步非阻塞网络库来处理网络通讯,整体架构大致如下(绿线是数据流向): 简单叙述一下每层图的含义吧: Spiders(爬虫):它负责处理所有Respon ...

- Scrapy框架-----爬虫

说明:文章是本人读了崔庆才的Python3---网络爬虫开发实战,做的简单整理,希望能帮助正在学习的小伙伴~~ 1. 准备工作: 安装Scrapy框架.MongoDB和PyMongo库,如果没有安装, ...

- 12.scrapy框架

一.Scrapy 框架简介 1.简介 Scrapy是用纯Python实现一个为了爬取网站数据.提取结构性数据而编写的应用框架,用途非常广泛. 框架的力量,用户只需要定制开发几个模块就可以轻松的实现一个 ...

- Scrapy 框架 安装

Scrapy 框架 Scrapy是用纯Python实现一个为了爬取网站数据.提取结构性数据而编写的应用框架,用途非常广泛. 框架的力量,用户只需要定制开发几个模块就可以轻松的实现一个爬虫,用来抓取网页 ...

- Scrapy框架学习笔记

1.Scrapy简介 Scrapy是用纯Python实现一个为了爬取网站数据.提取结构性数据而编写的应用框架,用途非常广泛. 框架的力量,用户只需要定制开发几个模块就可以轻松的实现一个爬虫,用来抓取网 ...

- scrapy框架系列 (1) 初识scrapy

Scrapy 框架 Scrapy是用纯Python实现一个为了爬取网站数据.提取结构性数据而编写的应用框架,用途非常广泛. 框架的力量,用户只需要定制开发几个模块就可以轻松的实现一个爬虫,用来抓取网页 ...

- Python爬虫进阶三之Scrapy框架安装配置

初级的爬虫我们利用urllib和urllib2库以及正则表达式就可以完成了,不过还有更加强大的工具,爬虫框架Scrapy,这安装过程也是煞费苦心哪,在此整理如下. Windows 平台: 我的系统是 ...

随机推荐

- 解决端口耗尽问题: tcp_tw_reuse、tcp_timestamps

一.本地端口有哪些可用 首先,需要了解到TCP协议中确定一条TCP连接有4要素:local IP, local PORT, remote IP, remote PORT.这个四元组应该是唯一的. 在我 ...

- 16.1-uC/OS-III同步 (任务内建信号量)

1.经常通过发送信号量实现同步.每个任务都有内建的信号量,通过任务内建的信号量不仅可以简化信号量通信的代码而且更加有效. 与任务内建的信号量相关的函数都是以 OSTaskSem???()为前缀的.相关 ...

- 关于MySQL慢日志,你想知道的都在这

关于MySQL慢日志,你想知道的都在这 https://mp.weixin.qq.com/s/Ifbq0Dk13SO3WVghqWVUbA 作者介绍邹鹏,现任职于腾讯云数据库团队,负责腾讯云数据库My ...

- js回溯法计算最佳旅行线路

假如有 A,B,C,D四个城市,他们之间的距离用 G[V][E] 表示,为 无穷大,则表示两座城市不相通 现在从计算从某一个城市出发,把所有的城市不重复旅行一次,最短路径 其中G为: (Infinit ...

- Software Testing 2 —— Fault、error and failure小练习

Questions: Below are two faulty programs. Each includes a test case that results in failure. Answer ...

- 前端学习历程--js事件监听

一.事件监听使用场景 1.事件触发多个方法的时候,后一个方法会把前一个方法覆盖掉. window.onload = function(){ var btn = document.getElement ...

- Ngnix 配置文件

配置文件路径/usr/local/nginx/conf/nginx.conf user www www; #nginx 服务的伪用户和用户组 worker_processes auto; #启动进程, ...

- HDU 1114

在 ACM 能够开展之前,必须准备预算,并获得必要的财力支持.该活动的主要收入来自于 Irreversibly Bound Money (IBM).思路很简单.任何时候,某位 ACM 会员有少量的钱时 ...

- 单端测序(Single-read)和双端测序(Paired-end和Mate-pair)的关系

https://blog.csdn.net/hanli1992/article/details/82982434

- hdu4777 树状数组

题意:给了n个数,然后又m次查询,询问[L,R] 内有多少个数与其他的数不互质. 解: 我们首先可以通过处理得出每个数的有效区间,LR 就是 左边L位置上的数 和他不互质, 右边R位置上的数和不互质, ...