使用Selenium&PhantomJS的方式爬取代理

前面已经爬取了代理,今天我们使用Selenium&PhantomJS的方式爬取快代理 :快代理 - 高速http代理ip每天更新。

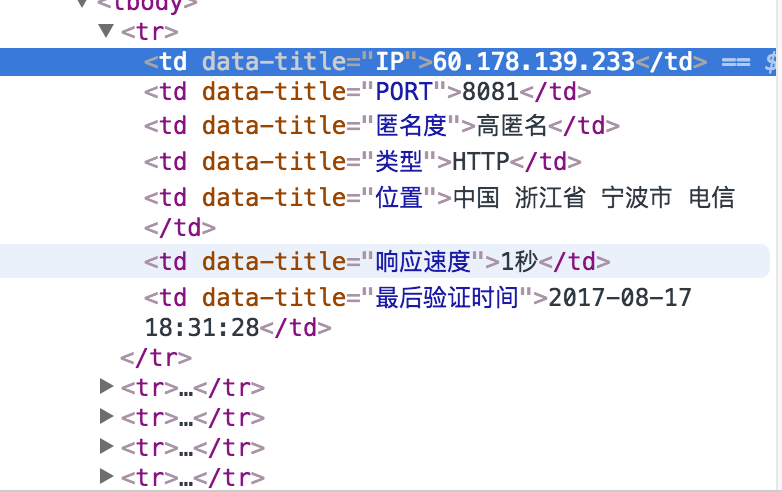

首先分析一下快代理,如下

使用谷歌浏览器,检查,发现每个代理信息都在tr里面,每个tr里面包含多个td,就是IP的信息。

这个结构我们可以通过多种方法抓取,例如bs4、xpath、selenium等

这里我们演示selenium方法。具体解释在下面代码中都有的。

from selenium import webdriver class Item(object):

'''

模拟scrapy框架

写item类

用以表示每个代理

'''

ip = None #IP地址

port = None #端口

anonymous = None #是否匿名

type = None #http 或者https

local = None #物理地址

speed = None #速度 class GetProxy(object):

def __init__(self):

self.starturl = 'http://www.kuaidaili.com/free/inha/'

self.urls = self.get_urls()

self.proxylist = self.get_proxy_list(self.urls)

self.filename = 'proxy.txt'

self.saveFile(self.filename,self.proxylist) def get_urls(self):

'''

:return: 返回代理url列表

'''

urls = []

for i in range(1,3):

url = self.starturl + str(i)

urls.append(url)

return urls def get_proxy_list(self,urls):

'''

爬取代理列表

:param urls:

:return:

'''

browser = webdriver.PhantomJS()

proxy_list = [] for url in urls:

browser.get(url) # 通过get方法打开

browser.implicitly_wait(3)

elements = browser.find_elements_by_xpath('//tbody/tr') #找到每个代理的位置

for element in elements:

item = Item()

item.ip = element.find_element_by_xpath('./td[1]').text

item.port = element.find_element_by_xpath('./td[2]').text

item.anonymous = element.find_element_by_xpath('./td[3]').text

item.local = element.find_element_by_xpath('./td[4]').text

item.speed = element.find_element_by_xpath('./td[5]').text

print(item.ip)

proxy_list.append(item) browser.quit()

return proxy_list def saveFile(self,filename,proxy_list):

'''

将爬取的信息保存到本地

:param filename:

:param proxy_list:

:return:

'''

with open(filename,'w') as f:

for item in proxy_list:

f.write(item.ip + '\t')

f.write(item.port + '\t')

f.write(item.anonymous + '\t')

f.write(item.local + '\t')

f.write(item.speed + '\n\n') if __name__ == '__main__':

Get = GetProxy()

下面我们展示一下爬取的结果

如果用到代理的话,还需要对这些IP进行测试一下。

使用Selenium&PhantomJS的方式爬取代理的更多相关文章

- 使用selenium+phantomJS实现网页爬取

有些网站反爬虫技术设计的非常好,很难采用WebClient等技术进行网页信息爬取,这时可以考虑采用selenium+phantomJS模拟浏览器(其实是真实的浏览器)的方式进行信息爬取.之前一直使用的 ...

- selenium&phantomjs实战--漫话爬取

为什么直接保存当前网页,而不是找到所有漫话链接,再有针对性的保存图片? 因为防盗链的原因,当直接保存漫话链接图片时,只能保存到防盗链的图片. #!/usr/bin/env python # _*_ c ...

- 针对源代码和检查元素不一致的网页爬虫——利用Selenium、PhantomJS、bs4爬取12306的列车途径站信息

整个程序的核心难点在于上次豆瓣爬虫针对的是静态网页,源代码和检查元素内容相同:而在12306的查找搜索过程中,其网页发生变化(出现了查找到的数据),这个过程是动态的,使得我们在审查元素中能一一对应看到 ...

- Selenium+Chrome/phantomJS模拟浏览器爬取淘宝商品信息

#使用selenium+Carome/phantomJS模拟浏览器爬取淘宝商品信息 # 思路: # 第一步:利用selenium驱动浏览器,搜索商品信息,得到商品列表 # 第二步:分析商品页数,驱动浏 ...

- Scrapy 通过登录的方式爬取豆瓣影评数据

Scrapy 通过登录的方式爬取豆瓣影评数据 爬虫 Scrapy 豆瓣 Fly 由于需要爬取影评数据在来做分析,就选择了豆瓣影评来抓取数据,工具使用的是Scrapy工具来实现.scrapy工具使用起来 ...

- python爬虫爬取代理IP

# #author:wuhao # #--*------------*-- #-****#爬取代理IP并保存到Excel----#爬取当日的代理IP并保存到Excel,目标网站xicidaili.co ...

- Python爬虫-代理池-爬取代理入库并测试代理可用性

目的:建立自己的代理池.可以添加新的代理网站爬虫,可以测试代理对某一网址的适用性,可以提供获取代理的 API. 整个流程:爬取代理 ----> 将代理存入数据库并设置分数 ----> 从数 ...

- Python实训day07pm【Selenium操作网页、爬取数据-下载歌曲】

练习1-爬取歌曲列表 任务:通过两个案例,练习使用Selenium操作网页.爬取数据.使用无头模式,爬取网易云的内容. ''' 任务:通过两个案例,练习使用Selenium操作网页.爬取数据. 使用无 ...

- 爬虫实例——爬取淘女郎相册(通过selenium、PhantomJS、BeautifulSoup爬取)

环境 操作系统:CentOS 6.7 32-bit Python版本:2.6.6 第三方插件 selenium PhantomJS BeautifulSoup 代码 # -*- coding: utf ...

随机推荐

- Redis: temple

ylbtech-Redis: 1.返回顶部 2.返回顶部 3.返回顶部 4.返回顶部 5.返回顶部 6.返回顶部 7.返回顶部 8.返回顶部 9.返回顶部 1 ...

- 简单的PL/SQl链接远程ORACLE数据库方法

简单的PL/SQl链接远程ORACLE数据库方法 PLSQL Developer新手使用教程 pasting

- lamp环境应用实践

LAMP之apache2.4.33 apache工作模式 apache 常用工作模式有2种,区别在于 worker模式 1. 线程模式 2. 占用资源少 3. 稳定性略差 4. 并发大 prefork ...

- Python - 第一个 Django 项目

Django 的安装: pip3 install django==1.11.11 pip3 install -i https://pypi.tuna.tsinghua.edu.cn/simple/ d ...

- C++模板类练习题

题目说明: 编写一个程序,使用类模板对数组元素进行排序,倒置.查找和求和 具有对数组元素进行排序,倒置.查找和求和功能, 然后产生类型实参分别为int型和double型的两个模板类, 分别对整型数组与 ...

- Python极其简单的分布式异步作业管理系统RQ入门

Python极其简单的分布式异步作业管理系统RQ入门 原创 2017-08-19 lixing 生信人 Python极其简单的分布式异步作业管理系统RQ入门 1. 什么是Job? Job直译过来就是工 ...

- 关于Fiddler常见问题之一

Fiddler设置代理后,手机无法上网常见检查项 1.检查IP 2.确认端口在工作 > “ netstat -ano” 3.设置手机代理>管理网络设置>高级>代理服务器, ...

- Netty简单的重连机制

其实重连机制并不是多么多高深的技术,其实就是一个在客户端做一个简单的判断,如果连接断了,那么就重新调用连接服务端的代码 当然,我们重连的动作肯定是发生在断连之后发生的,我们可以在上篇的心跳机制的基础上 ...

- 在Spring中使用Redis Lua脚本批量删除缓存

背景 之前分享了一篇利用lua脚本批量删除redis的key的文章.现在项目中我打算使用spring的缓存,而Spring缓存以前我是用ehcache来做实现的.没发现什么问题..这次我换成redis ...

- 关于LOH(Large Object Heap)及内存泄漏

关于LOH(Large Object Heap)的. .NET CLR中对于大于85000字节的内存既不像引用类型那样分配到普通堆上,也不像值类型那样分配到栈上,而是分配到了一个特殊的称为LOH的内部 ...