Flink JobManager HA模式部署(基于Standalone)

参考文章:https://ci.apache.org/projects/flink/flink-docs-release-1.3/setup/jobmanager_high_availability.html#bootstrap-zookeeper

Flink典型的任务处理过程如下所示:

很容易发现,JobManager存在单点故障(SPOF:Single Point Of Failure),因此对Flink做HA,主要是对JobManager做HA,根据Flink集群的部署模式不同,分为Standalone、OnYarn,本文主要涉及Standalone模式。

JobManager的HA,是通过Zookeeper实现的,因此需要先搭建好Zookeeper集群,同时HA的信息,还要存储在HDFS中,因此也需要Hadoop集群,最后修改Flink中的配置文件。

一、部署Zookeeper集群

参考博文:http://www.cnblogs.com/liugh/p/6671460.html

二、部署Hadoop集群

参考博文:http://www.cnblogs.com/liugh/p/6624872.html

三、部署Flink集群

参考博文:http://www.cnblogs.com/liugh/p/7446295.html

四、conf/flink-conf.yaml修改

4.1 必选项

high-availability: zookeeper

high-availability.zookeeper.quorum: DEV-SH-MAP-:,DEV-SH-MAP-:,DEV-SH-MAP-:

high-availability.zookeeper.storageDir: hdfs:///flink/ha

4.2 可选项

high-availability.zookeeper.path.root: /flink

high-availability.zookeeper.path.cluster-id: /map_flink

修改完后,使用scp命令将flink-conf.yaml文件同步到其他节点

五、conf/masters修改

设置要启用JobManager的节点及端口:

dev-sh-map-:

dev-sh-map-:

修改完后,使用scp命令将masters文件同步到其他节点

六、conf/zoo.cfg修改

# ZooKeeper quorum peers

server.=DEV-SH-MAP-::

server.=DEV-SH-MAP-::

server.=DEV-SH-MAP-::

修改完后,使用scp命令将masters文件同步到其他节点

七、启动HDFS

[root@DEV-SH-MAP- conf]# start-dfs.sh

Starting namenodes on [DEV-SH-MAP-]

DEV-SH-MAP-: starting namenode, logging to /usr/hadoop-2.7./logs/hadoop-root-namenode-DEV-SH-MAP-.out

DEV-SH-MAP-: starting datanode, logging to /usr/hadoop-2.7./logs/hadoop-root-datanode-DEV-SH-MAP-.out

DEV-SH-MAP-: starting datanode, logging to /usr/hadoop-2.7./logs/hadoop-root-datanode-DEV-SH-MAP-.out

DEV-SH-MAP-: starting datanode, logging to /usr/hadoop-2.7./logs/hadoop-root-datanode-DEV-SH-MAP-.out

Starting secondary namenodes [0.0.0.0]

0.0.0.0: starting secondarynamenode, logging to /usr/hadoop-2.7./logs/hadoop-root-secondarynamenode-DEV-SH-MAP-.out

八、启动Zookeeper集群

[root@DEV-SH-MAP- conf]# start-zookeeper-quorum.sh

Starting zookeeper daemon on host DEV-SH-MAP-.

Starting zookeeper daemon on host DEV-SH-MAP-.

Starting zookeeper daemon on host DEV-SH-MAP-.

【注】这里使用的命令start-zookeeper-quorum.sh是FLINK_HOME/bin中的脚本

九、启动Flink集群

[root@DEV-SH-MAP- conf]# start-cluster.sh

Starting HA cluster with masters.

Starting jobmanager daemon on host DEV-SH-MAP-.

Starting jobmanager daemon on host DEV-SH-MAP-.

Starting taskmanager daemon on host DEV-SH-MAP-.

Starting taskmanager daemon on host DEV-SH-MAP-.

Starting taskmanager daemon on host DEV-SH-MAP-.

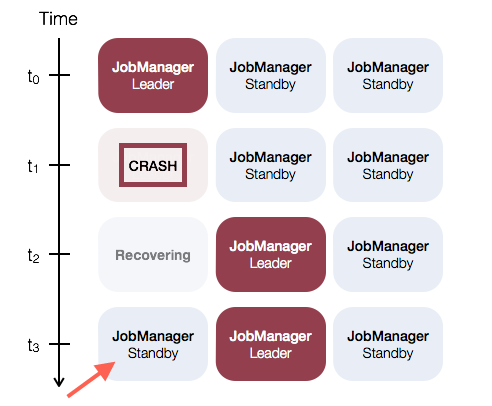

可以看到,启动了两个JobManager,一个Leader,一个Standby

十、测试HA

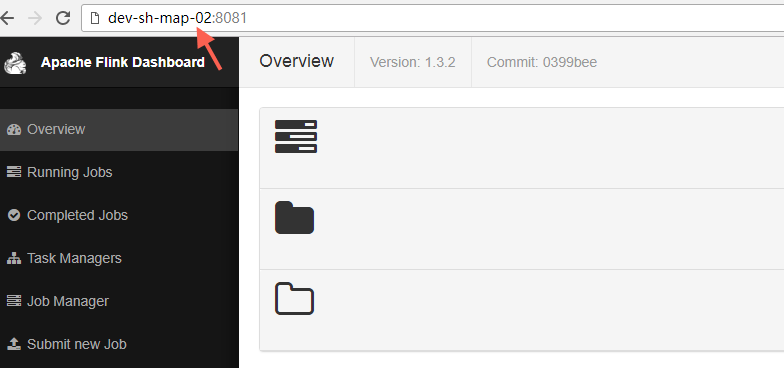

10.1 访问Leader的WebUI:

10.2 访问StandBy的WebUI

这时也会跳转到Leader的WebUI

10.3 Kill掉Leader

[root@DEV-SH-MAP- flink-1.3.]# jps

Jps

TaskManager

DataNode

SecondaryNameNode

JobManager

FlinkZooKeeperQuorumPeer

NameNode

[root@DEV-SH-MAP- flink-1.3.]# kill -9 34562

[root@DEV-SH-MAP- flink-1.3.]# jps

TaskManager

DataNode

SecondaryNameNode

Jps

FlinkZooKeeperQuorumPeer

NameNode

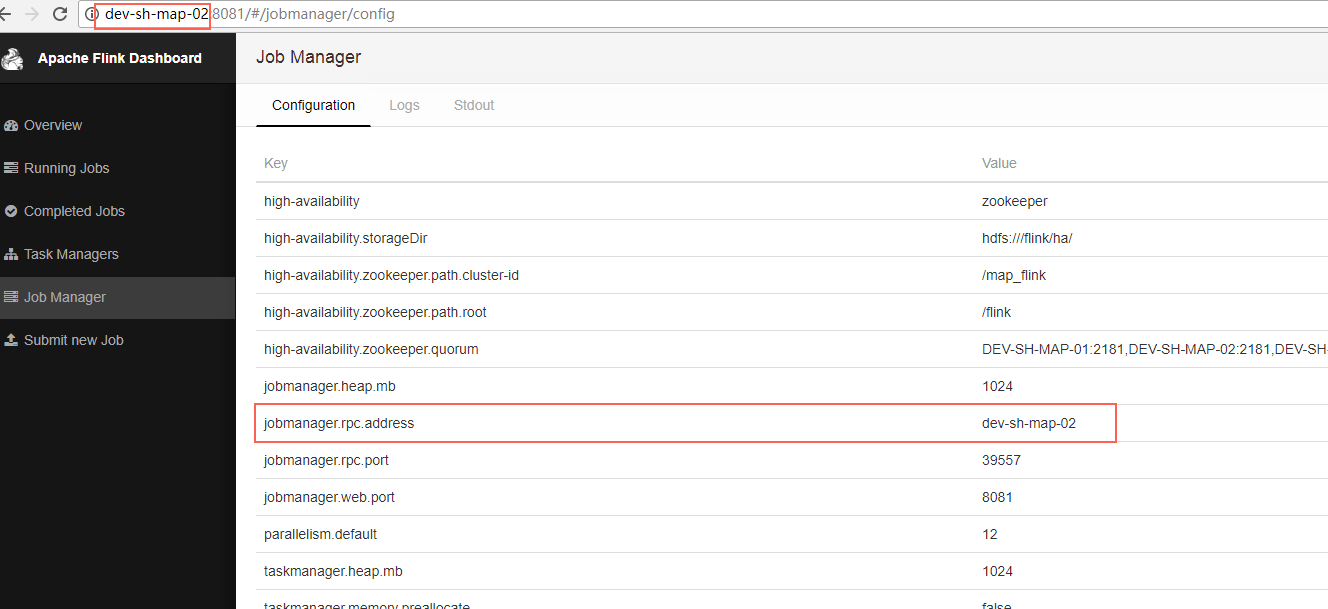

再次访问Flink WebUI,发现Leader已经发生切换

10.4 重启被Kill掉的JobManager

[root@DEV-SH-MAP- bin]# jobmanager.sh start cluster DEV-SH-MAP-01

Starting jobmanager daemon on host DEV-SH-MAP-.

[root@DEV-SH-MAP- bin]# jps

TaskManager

DataNode

SecondaryNameNode

JobManager

Jps

FlinkZooKeeperQuorumPeer

NameNode

再次查看WebUI,发现虽然以前被Kill掉的Leader起来了,但是现在仍是StandBy,现有的Leader不会发生切换,也就是Flink下面的示意图:

十一、存在的问题

JobManager发生切换时,TaskManager也会跟着发生重启

Flink JobManager HA模式部署(基于Standalone)的更多相关文章

- 一脸懵逼学习Hadoop分布式集群HA模式部署(七台机器跑集群)

1)集群规划:主机名 IP 安装的软件 运行的进程master 192.168.199.130 jdk.hadoop ...

- 分布式集群HA模式部署

一:HDFS系统架构 (一)利用secondary node备份实现数据可靠性 (二)问题:NameNode的可用性不高,当NameNode节点宕机,则服务终止 二:HA架构---提高NameNode ...

- 搭建高可用的flink JobManager HA

JobManager协调每个flink应用的部署,它负责执行定时任务和资源管理. 每一个Flink集群都有一个jobManager, 如果jobManager出现问题之后,将不能提交新的任务和运行新任 ...

- Flink集群模式部署及案例执行

一.软件要求 Flink在所有类UNIX的环境[例如linux,mac os x和cygwin]上运行,并期望集群由一个 主节点和一个或多个工作节点组成.在开始设置系统之前,确保在每个节点上都安装了一 ...

- Spark部署三种方式介绍:YARN模式、Standalone模式、HA模式

参考自:Spark部署三种方式介绍:YARN模式.Standalone模式.HA模式http://www.aboutyun.com/forum.php?mod=viewthread&tid=7 ...

- 第06讲:Flink 集群安装部署和 HA 配置

Flink系列文章 第01讲:Flink 的应用场景和架构模型 第02讲:Flink 入门程序 WordCount 和 SQL 实现 第03讲:Flink 的编程模型与其他框架比较 第04讲:Flin ...

- [hadoop][会装]HBase集群安装--基于hadoop ha模式

可以参考部署HBase系统(分布式部署) 和基于无HA模式的hadoop下部署相比,主要是修改hbase-site .xml文件,修改如下参数即可: <property> <name ...

- Spark运行模式与Standalone模式部署

上节中简单的介绍了Spark的一些概念还有Spark生态圈的一些情况,这里主要是介绍Spark运行模式与Spark Standalone模式的部署: Spark运行模式 在Spark中存在着多种运行模 ...

- Spark集群基于Zookeeper的HA搭建部署笔记(转)

原文链接:Spark集群基于Zookeeper的HA搭建部署笔记 1.环境介绍 (1)操作系统RHEL6.2-64 (2)两个节点:spark1(192.168.232.147),spark2(192 ...

随机推荐

- jquery 禁止herf跳转,并执行相应的js代码

<a class="oh_btn bg_3" href="javascript:void(0);" onclick="myfun(this)&q ...

- java中方法的参数传递机制

问:当一个对象被当作参数传递到一个方法后,此方法可改变这个对象的属性,并可返回变化后的结果,那么这里到底是值传递还是引用传递? 答:是值传递.Java 编程语言只有值传递参数.当一个对象实例作为一个 ...

- jqthumb.js缩略图插件-让缩略图正常显示而不变形

插件介绍 项目中有图片的时候,有的宽大于高,有的宽小于高,尤其在做图片列表的时候,经常发现缩略图会有变形的.我们怎样来解决这一问题呢. 方法一:用photoshop来处理缩略图.小的项目还可以,大的项 ...

- 几种常见排序算法原理&C语言实现

一.冒泡排序(以下各法均以从小到大排序为例,定义len为数组array的长度) 原理:比较相邻元素的大小,对于每次循环,按排序的规则把最值移向数组的一端,同时循环次数依次减少. C代码实现 写法一: ...

- [硬件]_ELVE_VS2015下opencv3.3的配置问题

0x00 引言 最近想搞一下摄像头,但是我的Windows版本是64位的,opencv3.3貌似也只支持64位系统了,所以就配置一下win10+vs2015+opencv3.3的环境变量,具体下载和 ...

- 有时在UIWindow上添加遮罩层不成功的原因

程序启动后,初始化window,初始化controller,加载试图,这三个方法的顺序是嵌套的 类似于: - (id) initWindow {[self initController];} 而我在i ...

- struts2增删改查---layer---iframe层

在这里写一下struts2中的简单的增删改查 struts.xml中的配置 <?xml version="1.0" encoding="UTF-8" ?& ...

- 转换Json中的时间戳为标准时间格式

//出自http://www.cnblogs.com/ahjesus function ConvertJSONDateToJSDate(jsonDate) { /// <su ...

- 程序设计入门——C语言 习题汇总

<img width="108" height="40" alt="浙江大学" src="http://imgsize.ph ...

- Hadoop 之 NameNode 元数据原理

在对NameNode节点进行格式化时,调用了FSImage的saveFSImage()方法和FSEditLog.createEditLogFile()存储当前的元数据.Namenode主要维护两个文件 ...