菜鸟学IT之python网页爬取多页爬取

作业来源:https://edu.cnblogs.com/campus/gzcc/GZCC-16SE1/homework/3002

0.从新闻url获取点击次数,并整理成函数

- newsUrl

- newsId(re.search())

- clickUrl(str.format())

- requests.get(clickUrl)

- re.search()/.split()

- str.lstrip(),str.rstrip()

- int

- 整理成函数

- 获取新闻发布时间及类型转换也整理成函数

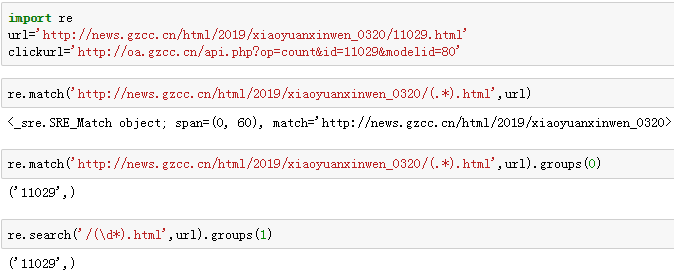

import re

url='http://news.gzcc.cn/html/2019/xiaoyuanxinwen_0320/11029.html'

clickurl='http://oa.gzcc.cn/api.php?op=count&id=11029&modelid=80'

re.match('http://news.gzcc.cn/html/2019/xiaoyuanxinwen_0320/(.*).html',url)

re.match('http://news.gzcc.cn/html/2019/xiaoyuanxinwen_0320/(.*).html',url).groups(0)

re.search('/(\d*).html',url).groups(1)

re.findall('(\d+)',url)

结果如下:

1.从新闻url获取新闻详情: 字典,anews

import requests

from bs4 import BeautifulSoup

from datetime import datetime

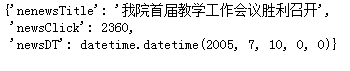

import re def click(url):

id=re.findall('(\d{1,5})',url)[-1]

clickUrl = 'http://oa.gzcc.cn/api.php?op=count&id=11029&modelid=80'.format(id)

resClick = requests.get(clickUrl)

newsClick = int(resClick.text.split('.html')[-1].lstrip("('").rstrip("');"))

return newsClick def newsdt(showinfo):

newsDate = showinfo.split()[0].split(':')[1]

newsTime = showinfo.split()[1]

newsDT = newsDate+' '+newsTime

dt = datetime.strptime(newsDT, '%Y-%m-%d %H:%M:%S') return dt def anews(url):

newsDetail = {}

res = requests.get(url)

res.encoding ='utf-8'

soup = BeautifulSoup(res.text,'html.parser')

newsDetail['nenewsTitle'] =soup.select('.show-title')[0].text

showinfo = soup.select('.show-info')[0].text

newsDetail['newsDT']=newsdt(showinfo)

newsDetail['newsClick'] =click(newsUrl)

return newsDetail newsUrl='http://news.gzcc.cn/html/2005/xiaoyuanxinwen_0710/4.html'

anews(newsUrl)

结果:

2.从列表页的url获取新闻url:列表append(字典) alist

- 获取列表数据

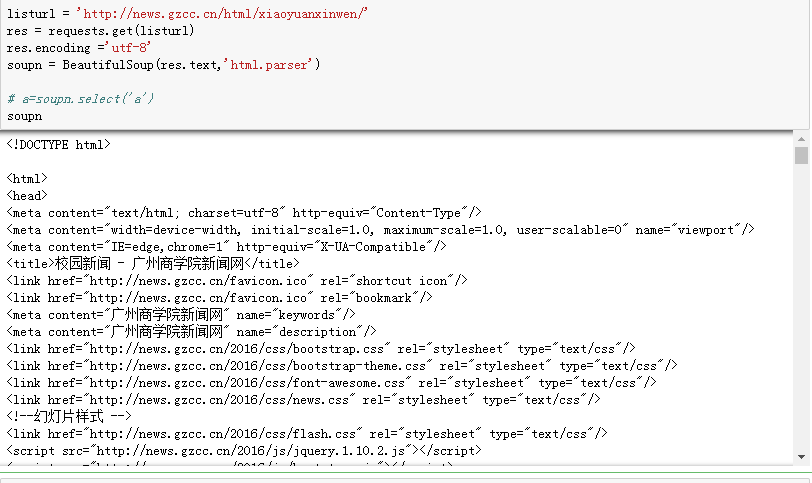

listurl = 'http://news.gzcc.cn/html/xiaoyuanxinwen/'

res = requests.get(listurl)

res.encoding ='utf-8'

soupn = BeautifulSoup(res.text,'html.parser') # a=soupn.select('a')

soupn

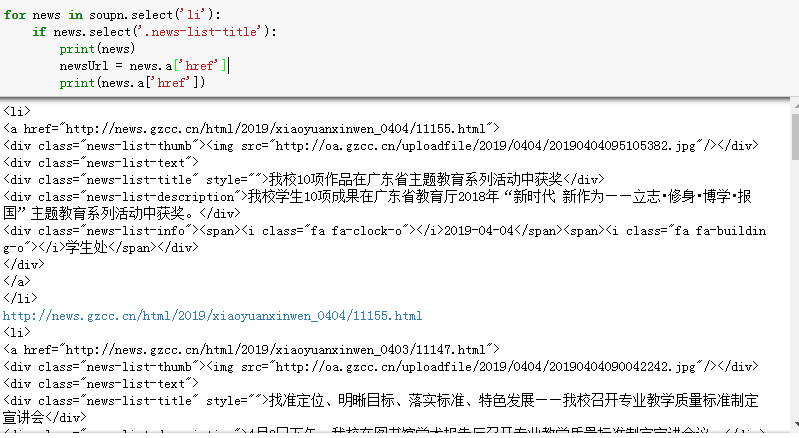

2.过滤过滤数据,只获取列表的新闻信息

for news in soupn.select('li'):

if news.select('.news-list-title'):

print(news)

newsUrl = news.a['href']

print(news.a['href'])

3.获取整页信息

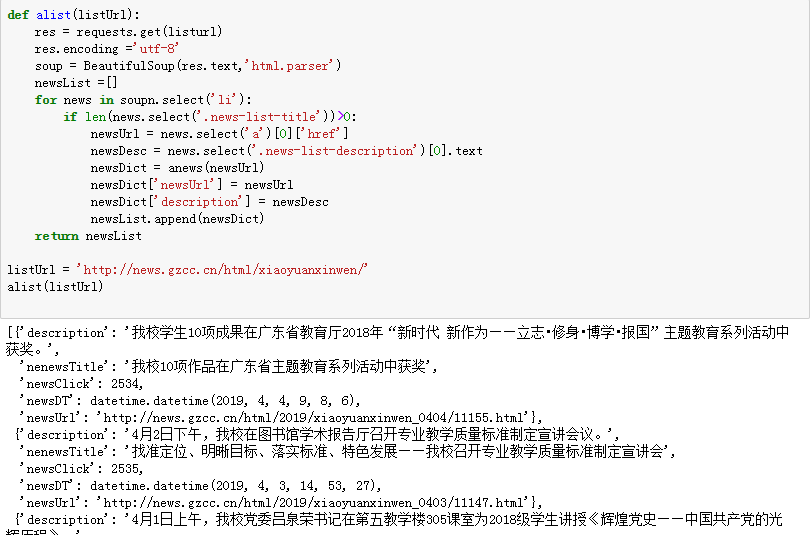

def alist(listUrl):

res = requests.get(listurl)

res.encoding ='utf-8'

soup = BeautifulSoup(res.text,'html.parser')

newsList =[]

for news in soupn.select('li'):

if len(news.select('.news-list-title'))>0:

newsUrl = news.select('a')[0]['href']

newsDesc = news.select('.news-list-description')[0].text

newsDict = anews(newsUrl)

newsDict['newsUrl'] = newsUrl

newsDict['description'] = newsDesc

newsList.append(newsDict)

return newsList listUrl = 'http://news.gzcc.cn/html/xiaoyuanxinwen/'

alist(listUrl)

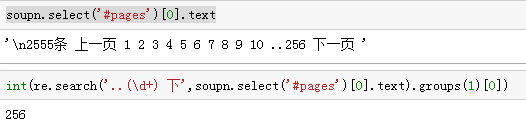

3.生成所页列表页的url并获取全部新闻 :列表extend(列表) allnews

*每个同学爬学号尾数开始的10个列表页

- 获取多页信息

- 截取以学号尾数开始的10个列表页

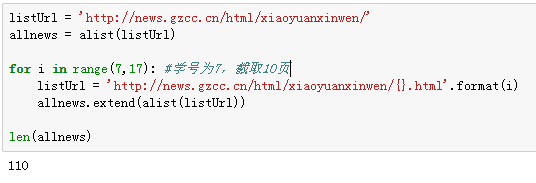

listUrl = 'http://news.gzcc.cn/html/xiaoyuanxinwen/'

allnews = alist(listUrl) for i in range(7,17): #学号为7,截取10页

listUrl = 'http://news.gzcc.cn/html/xiaoyuanxinwen/{}.html'.format(i)

allnews.extend(alist(listUrl)) len(allnews)

4.设置合理的爬取间隔

import time

import random

time.sleep(random.random()*3)

import time

import random

listUrl = 'http://news.gzcc.cn/html/xiaoyuanxinwen/'

allnews = alist(listUrl) for i in range(1,170): #学号为7,截取10页

listUrl = 'http://news.gzcc.cn/html/xiaoyuanxinwen/{}.html'.format(i)

allnews.extend(alist(listUrl))

time.sleep(random.random()*3) #设置每3秒爬取一次

print(alist(listUrl)) len(allnews)

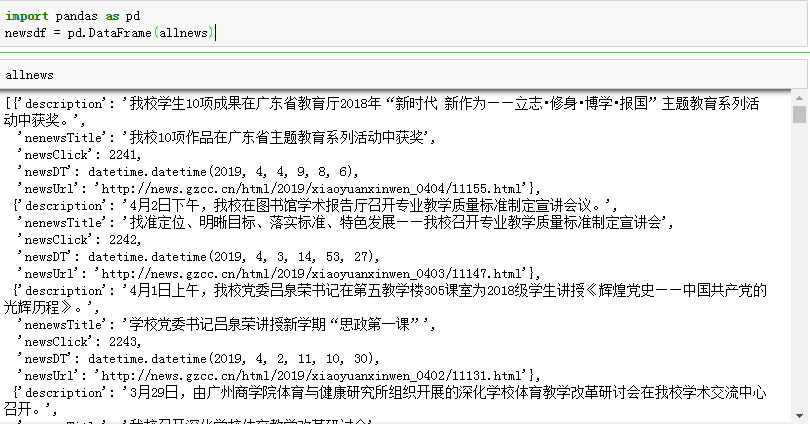

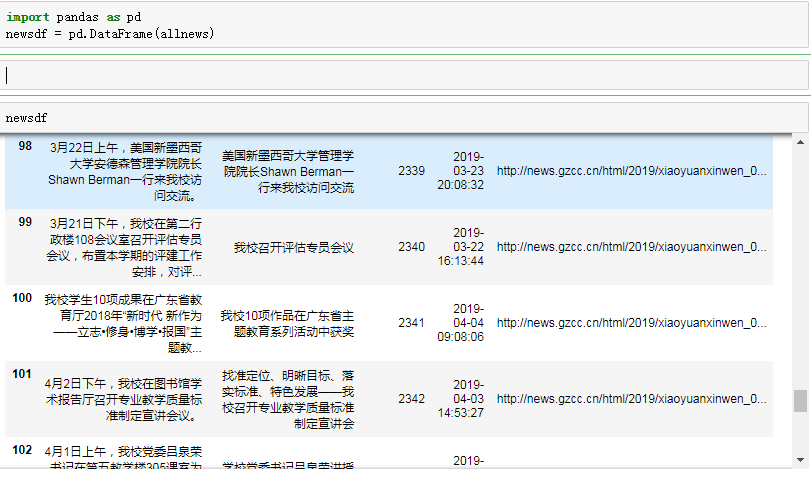

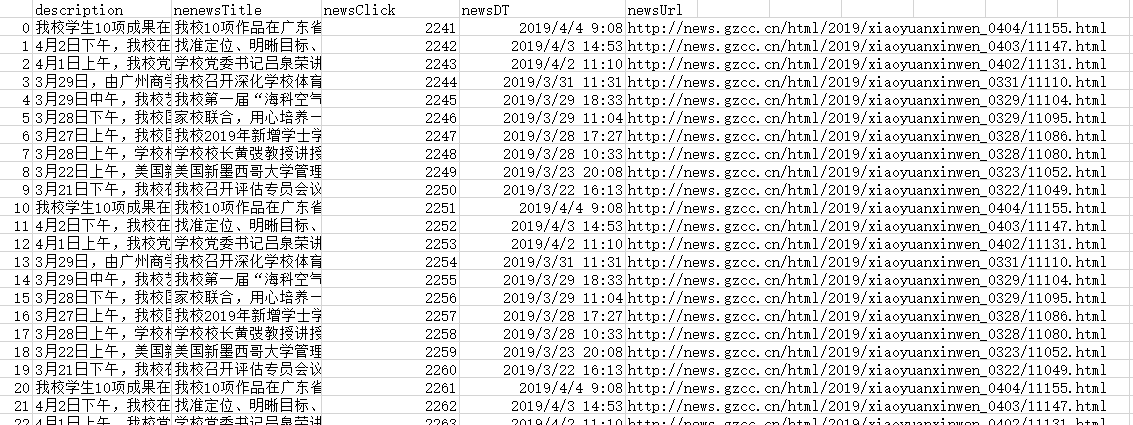

5.用pandas做简单的数据处理并保存

保存到csv或excel文件

newsdf.to_csv(r'F:\duym\爬虫\gzccnews.csv')

- 使用pandas函数整理爬取的数据

- 列表的形式打印数据

- 显示 “newsClick” 游览次数大于2337的新闻

- 生成csv文件

newsdf.to_csv(r'E:\gzcc.csv')

菜鸟学IT之python网页爬取多页爬取的更多相关文章

- 菜鸟学IT之python网页爬取初体验

作业来源:https://edu.cnblogs.com/campus/gzcc/GZCC-16SE1/homework/2881 1. 简单说明爬虫原理 爬虫简单来说就是通过程序模拟浏览器放松请求站 ...

- python实现一个栏目的分页抓取列表页抓取

python实现一个栏目的分页抓取列表页抓取 #!/usr/bin/env python # coding=utf-8 import requests from bs4 import Beautifu ...

- 菜鸟学IT之python词云初体验

作业来源:https://edu.cnblogs.com/campus/gzcc/GZCC-16SE1/homework/2822 1. 下载一长篇中文小说. 2. 从文件读取待分析文本. txt = ...

- python网页爬虫开发之五-反爬

1.头信息检查是否频繁相同 随机产生一个headers, #user_agent 集合 user_agent_list = [ 'Mozilla/5.0 (Windows NT 6.1; WOW64 ...

- Python爬虫学习三------requests+BeautifulSoup爬取简单网页

第一次第一次用MarkDown来写博客,先试试效果吧! 昨天2018俄罗斯世界杯拉开了大幕,作为一个伪球迷,当然也得为世界杯做出一点贡献啦. 于是今天就编写了一个爬虫程序将腾讯新闻下世界杯专题的相关新 ...

- 初识python 之 爬虫:使用正则表达式爬取“糗事百科 - 文字版”网页数据

初识python 之 爬虫:使用正则表达式爬取"古诗文"网页数据 的兄弟篇. 详细代码如下: #!/user/bin env python # author:Simple-Sir ...

- 初识python 之 爬虫:使用正则表达式爬取“古诗文”网页数据

通过requests.re(正则表达式) 爬取"古诗文"网页数据. 详细代码如下: #!/user/bin env python # author:Simple-Sir # tim ...

- Python网页解析库:用requests-html爬取网页

Python网页解析库:用requests-html爬取网页 1. 开始 Python 中可以进行网页解析的库有很多,常见的有 BeautifulSoup 和 lxml 等.在网上玩爬虫的文章通常都是 ...

- python使用requests库爬取网页的小实例:爬取京东网页

爬取京东网页的全代码: #爬取京东页面的全代码 import requests url="https://item.jd.com/2967929.html" try: r=requ ...

随机推荐

- 栈到CLR

提起栈想必会听到这样几个关键词:后进先出,先进后出,入栈,出栈. 栈这种数据结构,数组完全可以代替其功能. 但是存在即是真理,其目的就是避免暴漏不必要的操作. 如角色一样,不同的情景或者角色拥有不同的 ...

- 关于Bulk加载模式

Bulk加载模式是Informatica提供的一种高性能数据加载模式,它利用数据库底层机制,依靠调用数据库本身提供的Utility来进行数据的加载 该方式将绕过数据库的log记录,以此提高数据库加载性 ...

- Python开发:Python2和Python3的共存和切换使用

从python2到python3,这两个版本可以说是从语法.编码等多个方面上都有很大的差别.为了不带入过多的累赘,Python 3.0在设计的时候没有考虑向下相容,也就是说许多针对早期Python2版 ...

- Vuex,状态管理模式

对于 Vue 本人目前接触不深,只得浅层分析,Vue 是单向数据流, state,驱动应用的数据源: view,以声明方式将 state 映射到视图: actions,响应在 view 上的用户输入导 ...

- 网络协议 21 - RPC 协议(中)- 基于 JSON 的 RESTful 接口协议

上一节我们了解了基于 XML 的 SOAP 协议,SOAP 的 S 是啥意思来着?是 Simple,但是好像一点儿都不简单啊! 传输协议问题 对于 SOAP 来讲,比如我创建一个订单, ...

- 【Android Studio安装部署系列】十、Android studio打包发布apk安装包

版权声明:本文为HaiyuKing原创文章,转载请注明出处! 概述 使用Android studio发布apk安装包的操作步骤. 开始打包发布apk Build > Generate Signe ...

- Jenkins|简单Job配置|启动脚本|测试报告

目录 1.Jenkins安装 2.Jenkins启动脚本 3.节点配置 4.任务配置 5.集成HTML测试报告 1.Jenkins安装 操作环境:Ubuntu jenkins针对windows,ubu ...

- Python编程从入门到实践笔记——函数

Python编程从入门到实践笔记——函数 #coding=gbk #Python编程从入门到实践笔记——函数 #8.1定义函数 def 函数名(形参): # [缩进]注释+函数体 #1.向函数传递信息 ...

- springcloud情操陶冶-bootstrapContext(三)

本文则将重点阐述context板块的自动配置类,观察其相关的特性并作相应的总结 自动配置类 直接查看cloudcontext板块下的spring.factories对应的EnableAutoConfi ...

- Windows 10 安装ElasticSearch(2)- MSI安装ElasticSearch和安装Kibana

翻阅上篇文章:Windows 10 安装 ElasticSearch 上次写的是下载Zip包安装的,在下载页面 发现有 MSI (BETA) 的下载可选项.了解之后发现MSI安装也值得尝试. MSI安 ...