线性回归和批量梯度下降法python

通过学习斯坦福公开课的线性规划和梯度下降,参考他人代码自己做了测试,写了个类以后有时间再去扩展,代码注释以后再加,作业好多:

import numpy as np

import matplotlib.pyplot as plt

import random class dataMinning:

datasets = []

labelsets = [] addressD = '' #Data folder

addressL = '' #Label folder npDatasets = np.zeros(1)

npLabelsets = np.zeros(1) cost = []

numIterations = 0

alpha = 0

theta = np.ones(2)

#pCols = 0

#dRows = 0

def __init__(self,addressD,addressL,theta,numIterations,alpha,datasets=None):

if datasets is None:

self.datasets = []

else:

self.datasets = datasets

self.addressD = addressD

self.addressL = addressL

self.theta = theta

self.numIterations = numIterations

self.alpha = alpha def readFrom(self):

fd = open(self.addressD,'r')

for line in fd:

tmp = line[:-1].split()

self.datasets.append([int(i) for i in tmp])

fd.close()

self.npDatasets = np.array(self.datasets) fl = open(self.addressL,'r')

for line in fl:

tmp = line[:-1].split()

self.labelsets.append([int(i) for i in tmp])

fl.close() tm = []

for item in self.labelsets:

tm = tm + item

self.npLabelsets = np.array(tm) def genData(self,numPoints,bias,variance):

self.genx = np.zeros(shape = (numPoints,2))

self.geny = np.zeros(shape = numPoints) for i in range(0,numPoints):

self.genx[i][0] = 1

self.genx[i][1] = i

self.geny[i] = (i + bias) + random.uniform(0,1) * variance def gradientDescent(self):

xTrans = self.genx.transpose() #

i = 0

while i < self.numIterations:

hypothesis = np.dot(self.genx,self.theta)

loss = hypothesis - self.geny

#record the cost

self.cost.append(np.sum(loss ** 2))

#calculate the gradient

gradient = np.dot(xTrans,loss)

#updata, gradientDescent

self.theta = self.theta - self.alpha * gradient

i = i + 1 def show(self):

print 'yes' if __name__ == "__main__":

c = dataMinning('c:\\city.txt','c:\\st.txt',np.ones(2),100000,0.000005)

c.genData(100,25,10)

c.gradientDescent()

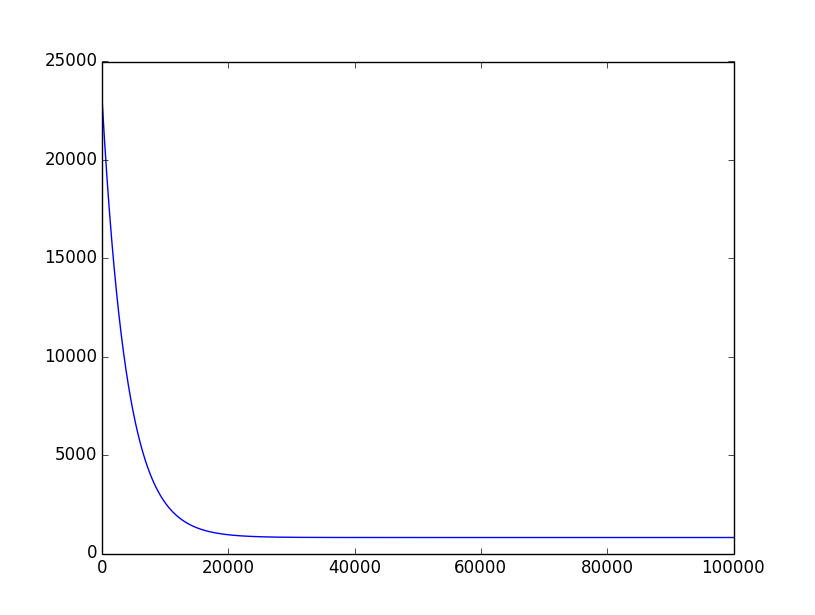

cx = range(len(c.cost))

plt.figure(1)

plt.plot(cx,c.cost)

plt.ylim(0,25000)

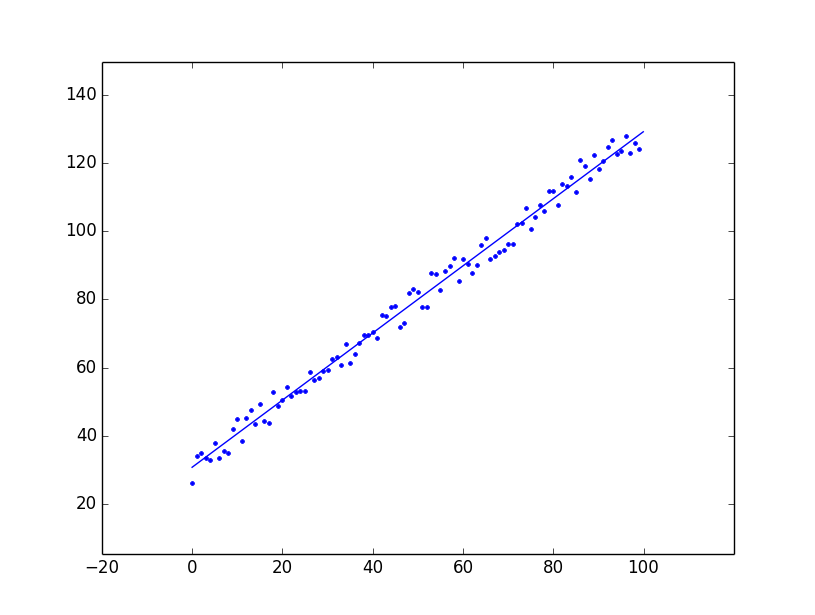

plt.figure(2)

plt.plot(c.genx[:,1],c.geny,'b.')

x = np.arange(0,100,0.1)

y = x * c.theta[1] + c.theta[0]

plt.plot(x,y)

plt.margins(0.2)

plt.show()

图1. 迭代过程中的误差cost

图2. 数据散点图和解直线

参考资料:

1.python编写类:http://blog.csdn.net/wklken/article/details/6313265

2.python中if __name__ == __main__的用法:http://www.cnblogs.com/herbert/archive/2011/09/27/2193482.html

3.matplotlab gallery:http://matplotlib.org/gallery.html

4.python批量梯度下降参考代码:http://www.91r.net/ask/17784587.html

线性回归和批量梯度下降法python的更多相关文章

- 【Python】机器学习之单变量线性回归 利用批量梯度下降找到合适的参数值

[Python]机器学习之单变量线性回归 利用批量梯度下降找到合适的参数值 本题目来自吴恩达机器学习视频. 题目: 你是一个餐厅的老板,你想在其他城市开分店,所以你得到了一些数据(数据在本文最下方), ...

- 线性回归(最小二乘法、批量梯度下降法、随机梯度下降法、局部加权线性回归) C++

We turn next to the task of finding a weight vector w which minimizes the chosen function E(w). Beca ...

- 1. 批量梯度下降法BGD 2. 随机梯度下降法SGD 3. 小批量梯度下降法MBGD

排版也是醉了见原文:http://www.cnblogs.com/maybe2030/p/5089753.html 在应用机器学习算法时,我们通常采用梯度下降法来对采用的算法进行训练.其实,常用的梯度 ...

- 梯度下降法VS随机梯度下降法 (Python的实现)

# -*- coding: cp936 -*- import numpy as np from scipy import stats import matplotlib.pyplot as plt # ...

- matlib实现梯度下降法

样本文件下载:ex2Data.zip ex2x.dat文件中是一些2-8岁孩子的年龄. ex2y.dat文件中是这些孩子相对应的体重. 我们尝试用批量梯度下降法,随机梯度下降法和小批量梯度下降法来对这 ...

- 梯度下降法的python代码实现(多元线性回归)

梯度下降法的python代码实现(多元线性回归最小化损失函数) 1.梯度下降法主要用来最小化损失函数,是一种比较常用的最优化方法,其具体包含了以下两种不同的方式:批量梯度下降法(沿着梯度变化最快的方向 ...

- 梯度下降法实现(Python语言描述)

原文地址:传送门 import numpy as np import matplotlib.pyplot as plt %matplotlib inline plt.style.use(['ggplo ...

- 梯度下降法原理与python实现

梯度下降法(Gradient descent)是一个一阶最优化算法,通常也称为最速下降法. 要使用梯度下降法找到一个函数的局部极小值,必须向函数上当前点对应梯度(或者是近似梯度)的反方向的规定步长距离 ...

- 机器学习中梯度下降法原理及用其解决线性回归问题的C语言实现

本文讲梯度下降(Gradient Descent)前先看看利用梯度下降法进行监督学习(例如分类.回归等)的一般步骤: 1, 定义损失函数(Loss Function) 2, 信息流forward pr ...

随机推荐

- yii2干货

Sites 网站 yiifeed:Yii 最新动态都在这里 yiigist:Yii 专用的 Packages my-yii:Yii 学习资料和新闻 Docs 文档 Yii Framework 2.0 ...

- Keepalived+Redis高可用部署

1 Redis简介及安装 Redis是一个开源,先进的key-value存储,并用于构建高性能,可扩展的Web应用程序的完美解决方案. Redis从它的许多竞争继承来的三个主要特点: Redis数 ...

- Memcached, Redis, MongoDB区别

mongodb和memcached不是一个范畴内的东西.mongodb是文档型的非关系型数据库,其优势在于查询功能比较强大,能存储海量数据.mongodb和memcached不存在谁替换谁的问题. 和 ...

- 顺序栈C语言实现

"` #include <stdio.h> #define MAXSIZE 10001 #define ELEMTYPE int #define STACK_EMPTY -999 ...

- SpringMVC自定义视图 Excel视图和PDF视图

一.自定义视图-Excel视图 1.Maven依赖 引入POI <dependency> <groupId>org.apache.poi</groupId> < ...

- Echarts-柱状图柱图宽度设置

先看两张图 图中柱图只需要设置series中的坐标系属性barWidth就可以, 这种图柱状图,折叠柱状图都适应 eg: /** * 堆积柱状图 * @param xaxisdata x轴:标签(数组 ...

- 安装python-docx

安装环境: windows 7 64位 python 3.4.2 64位 说明: 用pip install python-docx不行,当装lxml时出现错误,一直卡在那. 安装非官方的版本,如下图, ...

- Quality trimming using Trimmomatic

java -jar /home/liuhui/bin/trinityrnaseq_r20140413p1/trinity-plugins/Trimmomatic/trimmomatic.jar PE ...

- TLS版本

常见应用: https其实就是建构在SSL/TLS之上的 http协议. 1) setProtocol="TLS" will enable SSLv3 and TLSv1 2) s ...

- SSH无密码登陆Agent admitted failure to sign using the key

A :CentOS_Master B:Slave_1 C:Slave_2 普通用户hxsyl 1.现在A 上 ssh-keygen -t rsa 一路回车,不需要输入密码 执行该操作将在/home/h ...