线性回归和批量梯度下降法python

通过学习斯坦福公开课的线性规划和梯度下降,参考他人代码自己做了测试,写了个类以后有时间再去扩展,代码注释以后再加,作业好多:

import numpy as np

import matplotlib.pyplot as plt

import random class dataMinning:

datasets = []

labelsets = [] addressD = '' #Data folder

addressL = '' #Label folder npDatasets = np.zeros(1)

npLabelsets = np.zeros(1) cost = []

numIterations = 0

alpha = 0

theta = np.ones(2)

#pCols = 0

#dRows = 0

def __init__(self,addressD,addressL,theta,numIterations,alpha,datasets=None):

if datasets is None:

self.datasets = []

else:

self.datasets = datasets

self.addressD = addressD

self.addressL = addressL

self.theta = theta

self.numIterations = numIterations

self.alpha = alpha def readFrom(self):

fd = open(self.addressD,'r')

for line in fd:

tmp = line[:-1].split()

self.datasets.append([int(i) for i in tmp])

fd.close()

self.npDatasets = np.array(self.datasets) fl = open(self.addressL,'r')

for line in fl:

tmp = line[:-1].split()

self.labelsets.append([int(i) for i in tmp])

fl.close() tm = []

for item in self.labelsets:

tm = tm + item

self.npLabelsets = np.array(tm) def genData(self,numPoints,bias,variance):

self.genx = np.zeros(shape = (numPoints,2))

self.geny = np.zeros(shape = numPoints) for i in range(0,numPoints):

self.genx[i][0] = 1

self.genx[i][1] = i

self.geny[i] = (i + bias) + random.uniform(0,1) * variance def gradientDescent(self):

xTrans = self.genx.transpose() #

i = 0

while i < self.numIterations:

hypothesis = np.dot(self.genx,self.theta)

loss = hypothesis - self.geny

#record the cost

self.cost.append(np.sum(loss ** 2))

#calculate the gradient

gradient = np.dot(xTrans,loss)

#updata, gradientDescent

self.theta = self.theta - self.alpha * gradient

i = i + 1 def show(self):

print 'yes' if __name__ == "__main__":

c = dataMinning('c:\\city.txt','c:\\st.txt',np.ones(2),100000,0.000005)

c.genData(100,25,10)

c.gradientDescent()

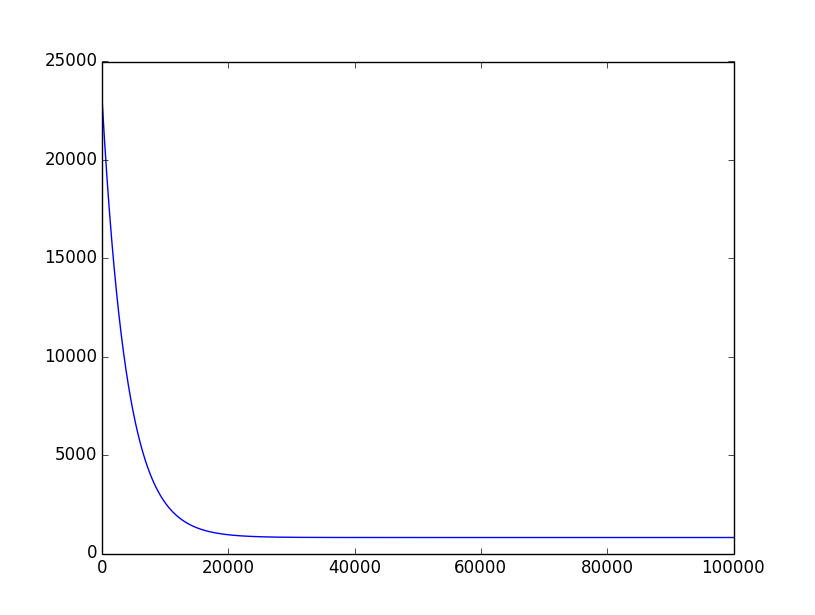

cx = range(len(c.cost))

plt.figure(1)

plt.plot(cx,c.cost)

plt.ylim(0,25000)

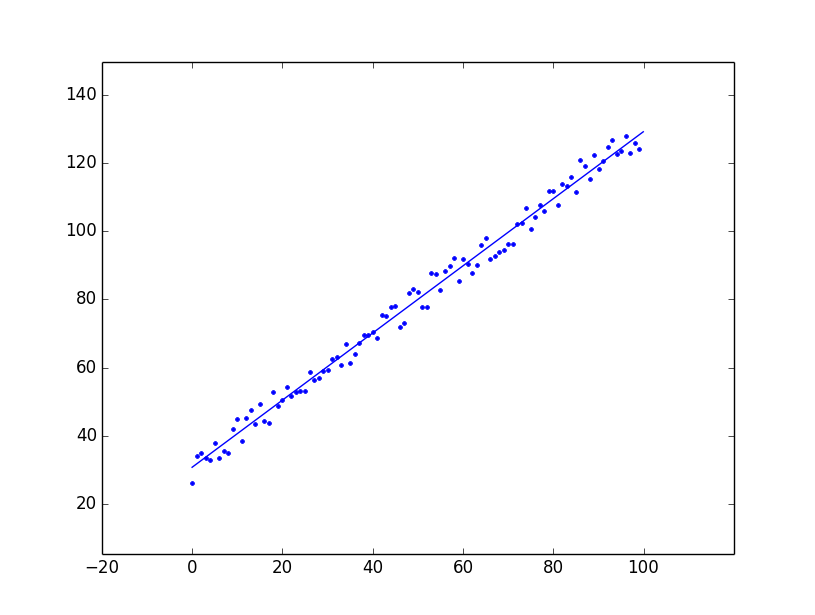

plt.figure(2)

plt.plot(c.genx[:,1],c.geny,'b.')

x = np.arange(0,100,0.1)

y = x * c.theta[1] + c.theta[0]

plt.plot(x,y)

plt.margins(0.2)

plt.show()

图1. 迭代过程中的误差cost

图2. 数据散点图和解直线

参考资料:

1.python编写类:http://blog.csdn.net/wklken/article/details/6313265

2.python中if __name__ == __main__的用法:http://www.cnblogs.com/herbert/archive/2011/09/27/2193482.html

3.matplotlab gallery:http://matplotlib.org/gallery.html

4.python批量梯度下降参考代码:http://www.91r.net/ask/17784587.html

线性回归和批量梯度下降法python的更多相关文章

- 【Python】机器学习之单变量线性回归 利用批量梯度下降找到合适的参数值

[Python]机器学习之单变量线性回归 利用批量梯度下降找到合适的参数值 本题目来自吴恩达机器学习视频. 题目: 你是一个餐厅的老板,你想在其他城市开分店,所以你得到了一些数据(数据在本文最下方), ...

- 线性回归(最小二乘法、批量梯度下降法、随机梯度下降法、局部加权线性回归) C++

We turn next to the task of finding a weight vector w which minimizes the chosen function E(w). Beca ...

- 1. 批量梯度下降法BGD 2. 随机梯度下降法SGD 3. 小批量梯度下降法MBGD

排版也是醉了见原文:http://www.cnblogs.com/maybe2030/p/5089753.html 在应用机器学习算法时,我们通常采用梯度下降法来对采用的算法进行训练.其实,常用的梯度 ...

- 梯度下降法VS随机梯度下降法 (Python的实现)

# -*- coding: cp936 -*- import numpy as np from scipy import stats import matplotlib.pyplot as plt # ...

- matlib实现梯度下降法

样本文件下载:ex2Data.zip ex2x.dat文件中是一些2-8岁孩子的年龄. ex2y.dat文件中是这些孩子相对应的体重. 我们尝试用批量梯度下降法,随机梯度下降法和小批量梯度下降法来对这 ...

- 梯度下降法的python代码实现(多元线性回归)

梯度下降法的python代码实现(多元线性回归最小化损失函数) 1.梯度下降法主要用来最小化损失函数,是一种比较常用的最优化方法,其具体包含了以下两种不同的方式:批量梯度下降法(沿着梯度变化最快的方向 ...

- 梯度下降法实现(Python语言描述)

原文地址:传送门 import numpy as np import matplotlib.pyplot as plt %matplotlib inline plt.style.use(['ggplo ...

- 梯度下降法原理与python实现

梯度下降法(Gradient descent)是一个一阶最优化算法,通常也称为最速下降法. 要使用梯度下降法找到一个函数的局部极小值,必须向函数上当前点对应梯度(或者是近似梯度)的反方向的规定步长距离 ...

- 机器学习中梯度下降法原理及用其解决线性回归问题的C语言实现

本文讲梯度下降(Gradient Descent)前先看看利用梯度下降法进行监督学习(例如分类.回归等)的一般步骤: 1, 定义损失函数(Loss Function) 2, 信息流forward pr ...

随机推荐

- 记一次在Eclipse中用Axis生成webservice服务端的过程中出现的问题

问题一. Unable to find config file. Creating new servlet engine config file: /WEB-INF/server-config.ws ...

- UTF-8 's format

几篇比较好的博客 古腾龙的博客:编码规则(UTF-8 GBK) GBK 千千秀字 shell set man ascii可以查看ascii码表,man utf-8看以查看utf-8的帮助 Unicod ...

- hdu-1823 Luck and Love

题目链接:hdu1823二维线段树单点更新区间查询 题意 向一个100*1000的二维空间中插入点,每次查询时,查询区间最大值. 题解 身高既然是100~200,那就相当于100;活泼度相当于1000 ...

- Android中的各种单位

px(像素):屏幕上的点.in(英寸):长度单位.mm(毫米):长度单位.pt(磅):1/72英寸.dp(与密度无关的像素):一种基于屏幕密度的抽象单位.在每英寸160点的显示器上,1dp = 1px ...

- 【Alpha版本】冲刺阶段——Day 5

我说的都队 031402304 陈燊 031402342 许玲玲 031402337 胡心颖 03140241 王婷婷 031402203 陈齐民 031402209 黄伟炜 031402233 郑扬 ...

- 【BZOJ 2809】【APIO 2012】dispatching

昨天晚上zyf神犇问我的题,虽然我太弱参加不了APIO但也做一做吧. 用小数据拍了无数次总是查不出错来,交上去就WA,后来用国内数据测发现是主席树上区间相减的值没有用long long存,小数据真是没 ...

- Kernel Methods (6) The Representer Theorem

The Representer Theorem, 表示定理. 给定: 非空样本空间: \(\chi\) \(m\)个样本:\(\{(x_1, y_1), \dots, (x_m, y_m)\}, x_ ...

- HTML video 视频标签全属性详解

HTML 5 video 视频标签全属性详解 现在如果要在页面中使用video标签,需要考虑三种情况,支持Ogg Theora或者VP8(如果这玩意儿没出事的话)的(Opera.Mozilla.C ...

- Sublime Text 3配置C++编译运行

2016.9.8更新: linux(Ubuntu16.04)下的配置,编译后用终端运行,解决了不能输入的问题 { "encoding": "utf-8", &q ...

- 【HDU 5833】Zhu and 772002(异或方程组高斯消元)

300个最大质因数小于2000的数,选若干个它们的乘积为完全平方数有多少种方案. 合法方案的每个数的质因数的个数的奇偶值异或起来为0. 比如12=2^2*3,对应的奇偶值为01(2的个数是偶数为0,3 ...