Python网络爬虫笔记(五):下载、分析京东P20销售数据

(一) 分析网页

下载下面这个链接的销售数据

https://item.jd.com/6733026.html#comment

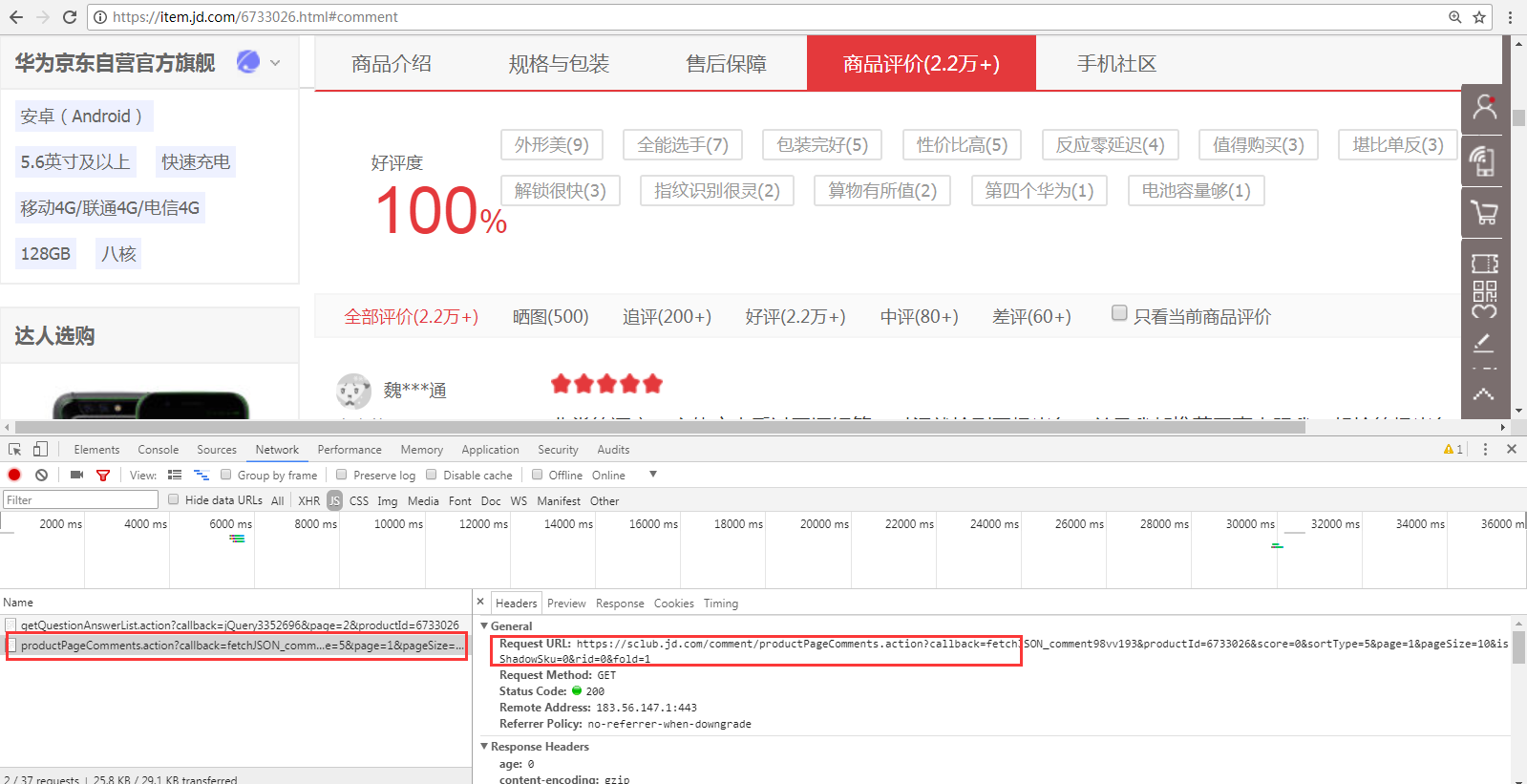

1、 翻页的时候,谷歌F12的Network页签可以看到下面的请求。(这里的翻页指商品评价中1、2、3页等)

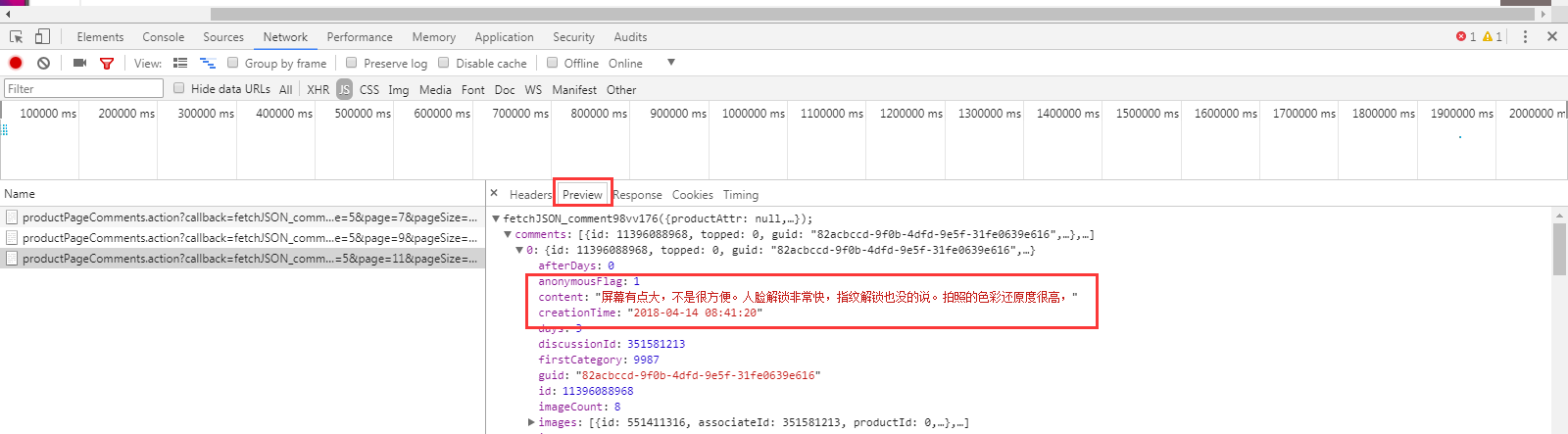

从Preview页签可以看出,这个请求是获取评论信息的

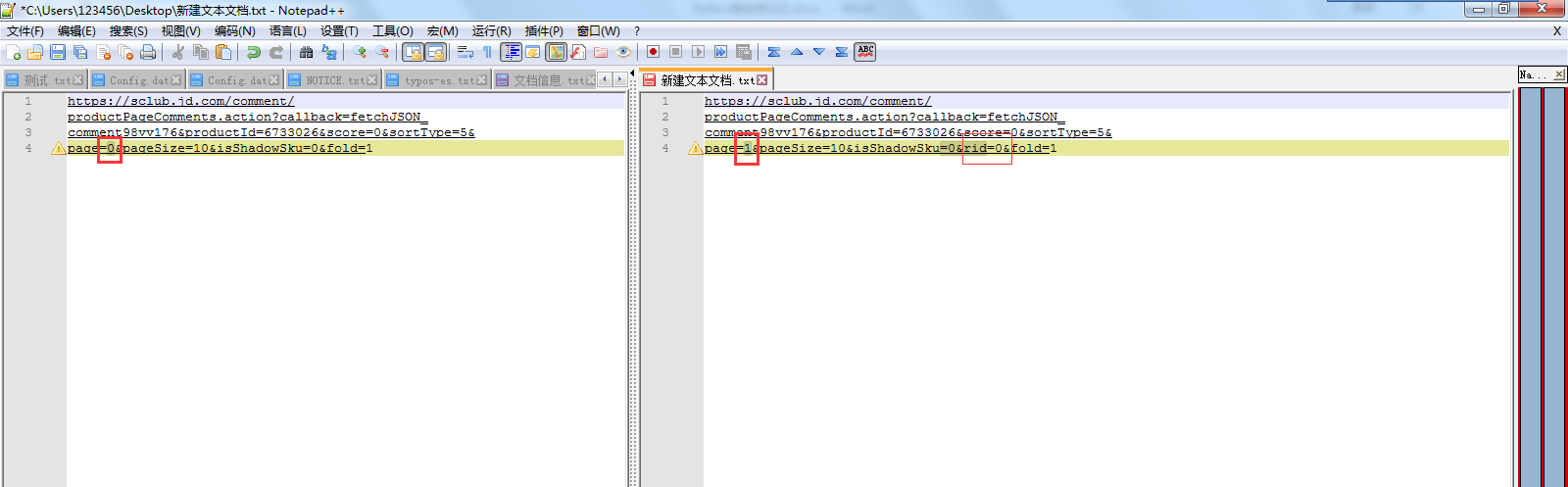

2、 对比第一页、第二页、第三页…请求URL的区别

可以发现 page=0、page=1,0和1指的应该是页数。

第一页的 request url:没有这个rid=0& 。 第二、三页…的request url:多了这个rid=0&

除了上面这2个地方,其他内容都是一样的。

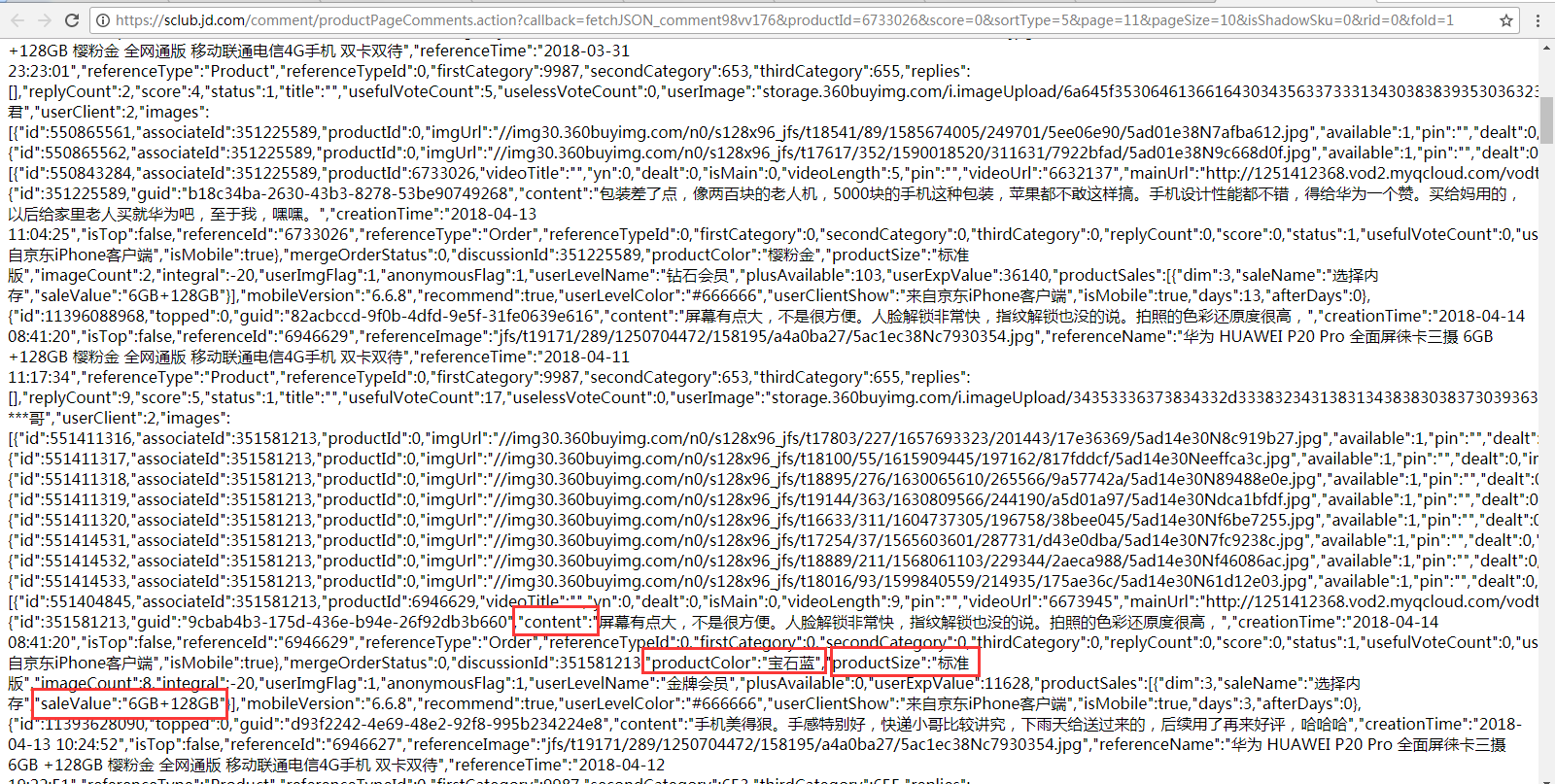

3、 直接在浏览器输入 复制出来的request url,可以看到评论、颜色、版本、内存信息,代码将根据这些信息来写正则表达式进行匹配。

(二) 实现代码

delayed.py的代码和我前面发的是一样的(Python网络爬虫笔记(二)),不限速的话把和这个模块相关的代码删除就行了

import urllib.request as ure

import urllib.parse

import openpyxl

import re

import os

from delayed import WaitFor

def download(url,user_agent='FireDrich',num=2,proxy=None):

print('下载:'+url)

#设置用户代理

headers = {'user_agent':user_agent}

request = ure.Request(url,headers=headers)

#支持代理

opener = ure.build_opener()

if proxy:

proxy_params = {urllib.parse.urlparse(url).scheme: proxy}

opener.add_handler(ure.ProxyHandler(proxy_params))

try:

#下载网页

# html = ure.urlopen(request).read()

html = opener.open(request).read()

except ure.URLError as e:

print('下载失败'+e.reason)

html=None

if num>0:

#遇到5XX错误时,递归调用自身重试下载,最多重复2次

if hasattr(e,'code') and 500<=e.code<600:

return download(url,num=num-1)

return html

def writeXls(sale_list):

#如果Excel不存在,创建Excel,否则直接打开已经存在文档

if 'P20销售情况.xlsx' not in os.listdir():

wb =openpyxl.Workbook()

else:

wb =openpyxl.load_workbook('P20销售情况.xlsx')

sheet = wb['Sheet']

sheet['A1'] = '颜色'

sheet['B1'] = '版本'

sheet['C1'] = '内存'

sheet['D1'] = '评论'

sheet['E1'] = '评论时间'

x = 2

#迭代所有销售信息(列表)

for s in sale_list:

#获取颜色等信息

content = s[0]

creationTime = s[1]

productColor = s[2]

productSize = s[3]

saleValue = s[4]

# 将颜色等信息添加到Excel

sheet['A' + str(x)] = productColor

sheet['B' + str(x)] = productSize

sheet['C' + str(x)] = saleValue

sheet['D' + str(x)] = content

sheet['E' + str(x)] = creationTime

x += 1

wb.save('P20销售情况.xlsx') page = 0

allSale =[]

waitFor = WaitFor(2)

#预编译匹配颜色、版本、内存等信息的正则表达式

regex = re.compile('"content":"(.*?)","creationTime":"(.*?)".*?"productColor":"(.*?)","productSize":"(.*?)".*?"saleValue":"(.*?)"')

#这里只下载20页数据,可以设置大一些(因为就算没评论信息,也能下载到一些标签信息等,所以可以if 正则没匹配的话就结束循环,当然,下面没处理这个)

while page<20:

if page==0:

url = 'https://sclub.jd.com/comment/productPageComments.action?callback=fetchJSON_comment98vv176&productId=6733026&score=0&sortType=5&page=' + str(page) + '&pageSize=10&isShadowSku=0&fold=1'

else:

url = 'https://sclub.jd.com/comment/productPageComments.action?callback=fetchJSON_comment98vv176&productId=6733026&score=0&sortType=5&page=' + str(page) + '&pageSize=10&isShadowSku=0&rid=0&fold=1'

waitFor.wait(url)

html = download(url)

html = html.decode('GBK')

#以列表形式返回颜色、版本、内存等信息

sale = regex.findall(html)

#将颜色、版本、内存等信息添加到allSale中(扩展allSale列表)

allSale.extend(sale)

page += 1 writeXls(allSale)

(三) 数据分析

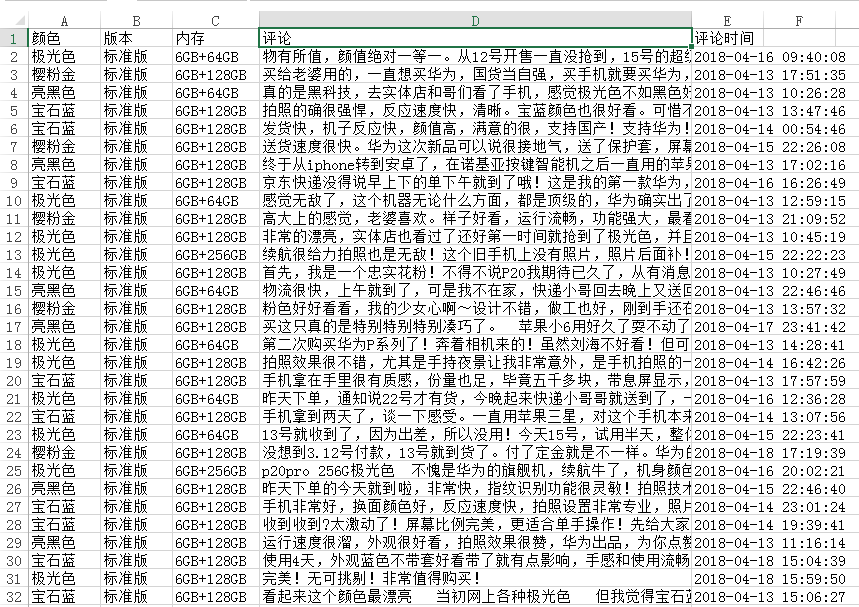

1、 下载后的数据如下图所示。

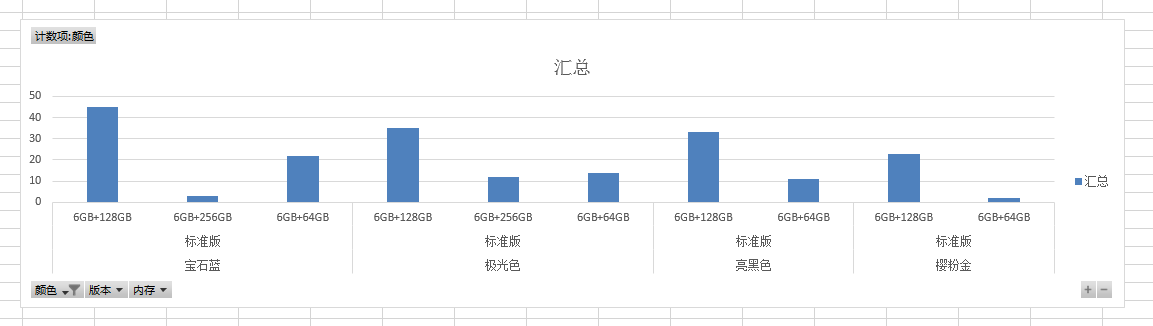

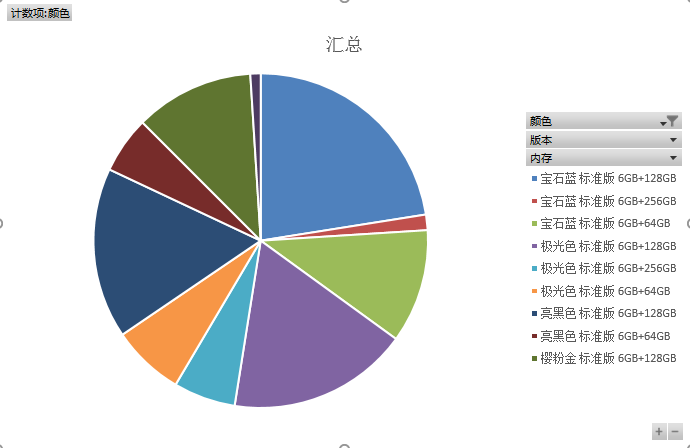

2、 生成图表。

我的博客即将搬运同步至腾讯云+社区,邀请大家一同入驻:https://cloud.tencent.com/developer/support-plan?invite_code=3ff1njli6hwk0

Python网络爬虫笔记(五):下载、分析京东P20销售数据的更多相关文章

- Python网络爬虫实战(五)批量下载B站收藏夹视频

我们除了爬取文本信息,有的时候还需要爬媒体信息,比如视频图片音乐等.就拿B站来说,我的收藏夹内的视频可能随时会失效,所以把它们下载到本地是非常保险的一件事. 对于这种大量列表型的数据,可以猜测B站收藏 ...

- Python网络爬虫笔记(二):链接爬虫和下载限速

(一)代码1(link_crawler()和get_links()实现链接爬虫) import urllib.request as ure import re import urllib.parse ...

- python网络爬虫笔记(五)

一.python的类对象的继承 1.所有的父类都是object类,由于类可以起到模块的作用,因此,可以在创建实例的时候,巴西一些认为必须要绑定的属性填写上去,通过定义一个特殊的方法 __init__, ...

- Python网络爬虫笔记(四):使用selenium获取动态加载的内容

(一) 说明 上一篇只能下载一页的数据,第2.3.4....100页的数据没法获取,在上一篇的基础上修改了下,使用selenium去获取所有页的href属性值. 使用selenium去模拟浏览器有点 ...

- Python网络爬虫笔记(一):网页抓取方式和LXML示例

(一) 三种网页抓取方法 1. 正则表达式: 模块使用C语言编写,速度快,但是很脆弱,可能网页更新后就不能用了. 2. Beautiful Soup 模块使用Python编写,速度慢. ...

- [Python]网络爬虫(五):urllib2的使用细节与抓站技巧

转自:http://blog.csdn.net/pleasecallmewhy/article/details/8925978 前面说到了urllib2的简单入门,下面整理了一部分urllib2的使用 ...

- [Python]网络爬虫(五):urllib2的使用细节与抓站技巧(转)

1.Proxy 的设置 urllib2 默认会使用环境变量 http_proxy 来设置 HTTP Proxy. 如果想在程序中明确控制 Proxy 而不受环境变量的影响,可以使用代理. 新建test ...

- python网络爬虫笔记(九)

4.1.1 urllib2 和urllib是两个不一样的模块 urllib2最简单的就是使用urllie2.urlopen函数使用如下 urllib2.urlopen(url[,data[,timeo ...

- python网络爬虫笔记(八)

一.pthon 序列化json格式 1.将python内置对象转换成json 模块,dumps()方法返回的是一个str,内容是标准的JSON,dump()方法可以直接吧JSON写入一个file-li ...

随机推荐

- linux分析、诊断及调优必备的“杀器”之二

先说明下,之所以同类内容分成多篇文章,不是为了凑篇数,而是为了便于自己和大家阅读,下面继续: 7.sar The sar command is used to collect, report, and ...

- 《结对-HTML贪吃蛇游戏项目-测试过程》

项目托管平台地址:https://gitee.com/zhaojianhuiAA/TanChiShe/blob/master/snake.html 项目成员:赵建辉.马壮. 测试: 1.界面:用jav ...

- alpha-咸鱼冲刺day4

一,合照 emmmmm.自然还是没有的. 二,项目燃尽图 三,项目进展 QAQ具体工作量没啥进展.但是前后端终于可以数据交互了!.. 四,问题困难 日常啥都不会,百度真心玩一年. 还得自学nodejs ...

- python实现朴素贝叶斯

参考:<机器学习实战>- Machine Learning in Action 一. 基本思想 简单的说,用概率的高低来决定数据属于哪一类别,这就是贝叶斯决策理论的核心思想,即选择具有最 ...

- Json转model对象,model转json,解析json字符串

GitHub链接: https://github.com/mozhenhau/D3Json D3Json 通过swift的反射特性,把json数据转换为model对象,本类最主要是解决了其他一般jso ...

- SQL的介绍及MySQL的安装

基础篇 - SQL 介绍及 MySQL 安装 SQL的介绍及MySQL的安装 课程介绍 本课程为实验楼提供的 MySQL 实验教程,所有的步骤都在实验楼在线实验环境中完成, ...

- 《高级软件测试》Linux平台Jira的安装与配置

现在大部分的程序开发都是在linux下进行的,jira更多的时候是安装在linux上,那么,如何在linux下安装配置jira呢?本文将以Ubuntu 17.10和jira7.5.2为例,对linux ...

- java:多层文件夹情况下,判断文件夹下是否有文件夹,并获取到没有文件夹的名字的方法

业务问题案例 在公司遇到的一个问题,本以为很小很好解决,没想到花了一下午时间.图给的是文件路径,page1下有10个文件夹,每个有的有文件夹或者文件,要求得到page1下(即:123456789,10 ...

- python全栈开发-json和pickle模块(数据的序列化)

一.什么是序列化? 我们把对象(变量)从内存中变成可存储或传输的过程称之为序列化,在Python中叫pickling,在其他语言中也被称之为serialization,marshalling,flat ...

- gogs详细配置

sudo apt-get update sudo apt-get upgrade sudo adduser git //创建用户 密码 ******* su git//切换到git用户 cd ~ ...