scrapy-splash抓取动态数据例子十三

一、介绍

本例子用scrapy-splash通过搜狗搜索引擎,输入给定关键字抓取微信资讯信息。

给定关键字:数字;融合;电视

抓取信息内如下:

1、资讯标题

2、资讯链接

3、资讯时间

4、资讯来源

二、网站信息

三、数据抓取

针对上面的网站信息,来进行抓取

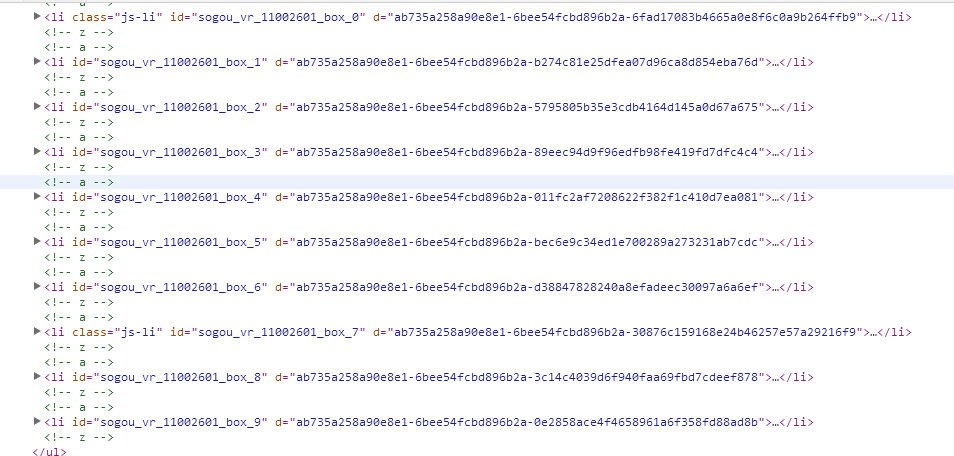

1、首先抓取信息列表

抓取代码:sels = site.xpath('//li[contains(@id,"sogou_vr")]')

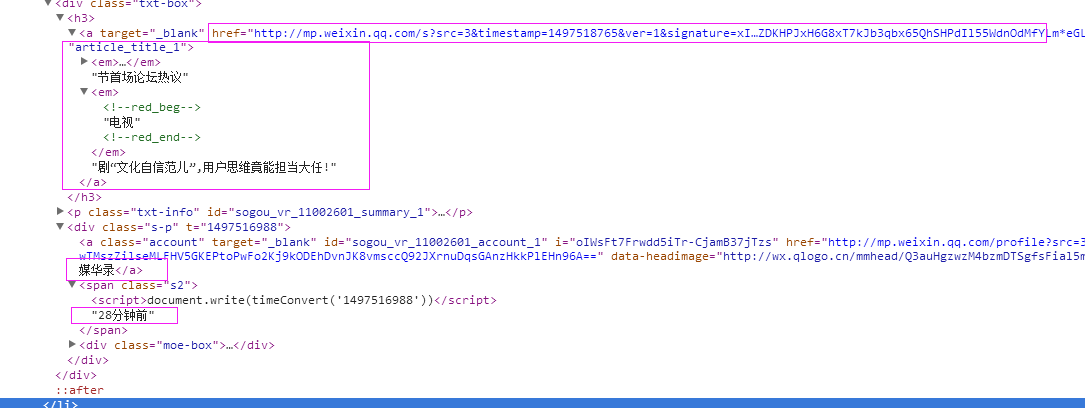

2、抓取标题

抓取代码:titles = sel.xpath('.//div[@class="txt-box"]/h3/a/text()|.//div[@class="txt-box"]/h3/a/em/text()')

3、抓取链接

抓取代码:sel.xpath('.//div[@class="txt-box"]/h3/a/@href')[0].extract()

4、抓取日期

抓取代码:strdate = sel.xpath('.//span[@class="s2"]/text()')

5、抓取来源

抓取代码:sources = sel.xpath('.//div[@class="s-p"]/a/text()')

四、完整代码

# -*- coding: utf-8 -*-

import scrapy

from scrapy import Request

from scrapy.spiders import Spider

from scrapy_splash import SplashRequest

from scrapy_splash import SplashMiddleware

from scrapy.http import Request, HtmlResponse

from scrapy.selector import Selector

from scrapy_splash import SplashRequest

from scrapy_ott.items import SplashTestItem

from scrapy_ott.mongoDB import mongoDbBase

import scrapy_ott.IniFile

import sys

import os

import re

import time reload(sys)

sys.setdefaultencoding('utf-8') # sys.stdout = open('output.txt', 'w') class weixinSpider(Spider):

name = 'weixin' db = mongoDbBase() configfile = os.path.join(os.getcwd(), 'scrapy_ott\setting.conf')

cf = scrapy_ott.IniFile.ConfigFile(configfile)

information_keywords = cf.GetValue("section", "information_keywords")

information_wordlist = information_keywords.split(';')

websearchurl_list = cf.GetValue("weixin", "websearchurl").split(';')

start_urls = []

for word in information_wordlist:

for url in websearchurl_list:

start_urls.append(url + word) # request需要封装成SplashRequest

def start_requests(self): for url in self.start_urls:

index = url.rfind('=')

yield SplashRequest(url

, self.parse

, args={'wait': ''},

meta={'keyword': url[index + 1:]}

) def Comapre_to_days(self,leftdate, rightdate):

'''

比较连个字符串日期,左边日期大于右边日期多少天

:param leftdate: 格式:2017-04-15

:param rightdate: 格式:2017-04-15

:return: 天数

'''

l_time = time.mktime(time.strptime(leftdate, '%Y-%m-%d'))

r_time = time.mktime(time.strptime(rightdate, '%Y-%m-%d'))

result = int(l_time - r_time) / 86400

return result def date_isValid(self, strDateText):

'''

判断日期时间字符串是否合法:如果给定时间大于当前时间是合法,或者说当前时间给定的范围内

:param strDateText: 四种格式 '慧聪网 7小时前'; '新浪游戏 29分钟前' ; '中国行业研究网 2017-6-13'

:return: True:合法;False:不合法

'''

currentDate = time.strftime('%Y-%m-%d') if strDateText.find('分钟前') > 0 :

return True,currentDate

elif strDateText.find('小时前') > 0:

datePattern = re.compile(r'\d{1,2}')

ch = int(time.strftime('%H')) # 当前小时数

strDate = re.findall(datePattern, strDateText)

if len(strDate) == 1:

if int(strDate[0]) <= ch: # 只有小于当前小时数,才认为是今天

return True,currentDate

else:

datePattern = re.compile(r'\d{4}-\d{1,2}-\d{1,2}')

strDate = re.findall(datePattern, strDateText)

if len(strDate) == 1:

if self.Comapre_to_days(currentDate, strDate[0]) == 0:

return True,currentDate

return False, '' def parse(self, response):

keyword = response.meta['keyword']

site = Selector(response)

sels = site.xpath('//li[contains(@id,"sogou_vr")]')

item_list = []

for sel in sels:

strdate = sel.xpath('.//span[@class="s2"]/text()')

if len(strdate)>0:

flag,date = self.date_isValid(strdate[0].extract())

if flag:

titles = sel.xpath('.//div[@class="txt-box"]/h3/a/text()|.//div[@class="txt-box"]/h3/a/em/text()')

title = ''

for t in titles:

title += str(t.extract())

if title.find(keyword) > -1:

it = SplashTestItem()

sources = sel.xpath('.//div[@class="s-p"]/a/text()')

if len(sources)>0:

it['source'] = sources[0].extract()

it['url'] = sel.xpath('.//div[@class="txt-box"]/h3/a/@href')[0].extract()

it['date'] = date

it['keyword'] = keyword

it['title'] = title

item_list.append(it) if len(item_list)>0:

# self.db.SaveInformations(item_list)

return item_list

scrapy-splash抓取动态数据例子十三的更多相关文章

- scrapy-splash抓取动态数据例子一

目前,为了加速页面的加载速度,页面的很多部分都是用JS生成的,而对于用scrapy爬虫来说就是一个很大的问题,因为scrapy没有JS engine,所以爬取的都是静态页面,对于JS生成的动态页面都无 ...

- scrapy-splash抓取动态数据例子八

一.介绍 本例子用scrapy-splash抓取界面网站给定关键字抓取咨询信息. 给定关键字:个性化:融合:电视 抓取信息内如下: 1.资讯标题 2.资讯链接 3.资讯时间 4.资讯来源 二.网站信息 ...

- scrapy-splash抓取动态数据例子七

一.介绍 本例子用scrapy-splash抓取36氪网站给定关键字抓取咨询信息. 给定关键字:个性化:融合:电视 抓取信息内如下: 1.资讯标题 2.资讯链接 3.资讯时间 4.资讯来源 二.网站信 ...

- scrapy-splash抓取动态数据例子六

一.介绍 本例子用scrapy-splash抓取中广互联网站给定关键字抓取咨询信息. 给定关键字:打通:融合:电视 抓取信息内如下: 1.资讯标题 2.资讯链接 3.资讯时间 4.资讯来源 二.网站信 ...

- scrapy-splash抓取动态数据例子五

一.介绍 本例子用scrapy-splash抓取智能电视网网站给定关键字抓取咨询信息. 给定关键字:打通:融合:电视 抓取信息内如下: 1.资讯标题 2.资讯链接 3.资讯时间 4.资讯来源 二.网站 ...

- scrapy-splash抓取动态数据例子四

一.介绍 本例子用scrapy-splash抓取微众圈网站给定关键字抓取咨询信息. 给定关键字:打通:融合:电视 抓取信息内如下: 1.资讯标题 2.资讯链接 3.资讯时间 4.资讯来源 二.网站信息 ...

- scrapy-splash抓取动态数据例子三

一.介绍 本例子用scrapy-splash抓取今日头条网站给定关键字抓取咨询信息. 给定关键字:打通:融合:电视 抓取信息内如下: 1.资讯标题 2.资讯链接 3.资讯时间 4.资讯来源 二.网站信 ...

- scrapy-splash抓取动态数据例子二

一.介绍 本例子用scrapy-splash抓取一点资讯网站给定关键字抓取咨询信息. 给定关键字:打通:融合:电视 抓取信息内如下: 1.资讯标题 2.资讯链接 3.资讯时间 4.资讯来源 二.网站信 ...

- scrapy-splash抓取动态数据例子十六

一.介绍 本例子用scrapy-splash爬取梅花网(http://www.meihua.info/a/list/today)的资讯信息,输入给定关键字抓取微信资讯信息. 给定关键字:数字:融合:电 ...

随机推荐

- LeetCode 5:Given an input string, reverse the string word by word.

problem: Given an input string, reverse the string word by word. For example: Given s = "the sk ...

- springboot整合jsp模板

springboot整合jsp模板 在使用springboot框架里使用jsp的时候,页面模板使用jsp在pom.xnl中需要引入相关的依赖,否则在controller中无法返回到指定页面 〇.搭建s ...

- 【 浅谈Linux路由机制 】

以下均为个人实验验证结果,如有问题,恳请指正. 现在服务器一般都有四张网卡,给了我们更多网络模型的选择.为了业务的需求,有时我们需要如下网络架构 系统:centos 7.2 x64 两张网卡不在同一个 ...

- js一段小代码(浏览器用alert,否则用console)

(function(){ var root=this, isBrowserSide=false; if(typeof window !=="undefined" && ...

- 「转」基于Jmeter和Jenkins搭建性能测试框架

搭建这个性能测试框架是希望能够让每个人(开发人员.测试人员)都能快速的进行性能测试,而不需要关注性能测试环境搭建过程.因为,往往配置一个性能环境可能需要很长的时间. 1.性能测试流程 该性能测试框架工 ...

- python 如何放心干净的卸载模块

windows系统: C:\selenium-2.43.0>python setup.py install --record ./record.txt C:\selenium-2.43.0> ...

- Linux命令之last

last [-num | -n num] [-f file] [-t YYYYMMDDHHMMSS] [-R] [-adioxFw] [username..] [tty..] last作用是显示近期用 ...

- 11、Flask实战第11天:蓝图

蓝图的基本使用 之前我们写的代码都是集中在一个主程序文件里面.这样不利于分层解耦和维护.蓝图的作用就是让我们的flask项目更加模块化结构更加清晰,可以将相同模块的视图函数放在同一个蓝图下,同一个文件 ...

- 17、Django实战第17天:机构详情展示

1.进入xadmin添加测试数据(教师.课程) 2.把以下4个前端页面复制到templates中 先打开这几个页面分析,它们和之前的课程机构列表页是不一样的机构,且没有共同的部分,但是这4个页面却是类 ...

- Column 1 of table 'xxx' cannot be converted from type 'varchar(33)' to type 'varchar(11)'

mysql主从同步失败.错误日志如下. Column 1 of table 'xxx' cannot be converted from type 'varchar(33)' to type 'var ...