Lucene实现自己的英文空格小写分词器

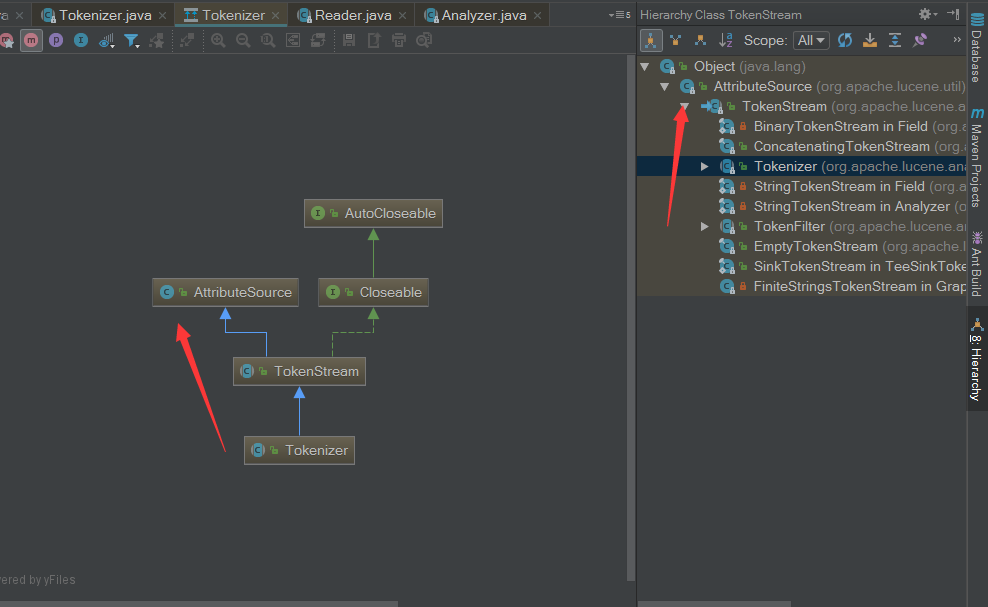

看一下继承图,Tokenizer和TokenFilter都是继承于TokenStream,TokenStream继承了AttributeSource

package com.lucene.demo.analizer;

import org.apache.lucene.analysis.Analyzer;

import org.apache.lucene.analysis.TokenFilter;

import org.apache.lucene.analysis.TokenStream;

import org.apache.lucene.analysis.Tokenizer;

import org.apache.lucene.util.Attribute;

import org.apache.lucene.util.AttributeImpl;

import org.apache.lucene.util.AttributeReflector;

import java.io.IOException;

public class SansamAnalyzer extends Analyzer{

/**

*

*/

@Override

protected TokenStreamComponents createComponents(String fieldName) {

//装饰器模式,将分出的词项用filter进行处理,可以链式装饰实现多个filter

MyTokenizer myTokenizer = new MyTokenizer();

MyLowerCaseTokenFilter myLowerCaseTokenFilter = new MyLowerCaseTokenFilter(myTokenizer);

return new TokenStreamComponents(myTokenizer, myLowerCaseTokenFilter);

}

public static class MyTokenizer extends Tokenizer{

//调用AttributeSource-addAttribute方法

//维护了一个attributes Map,实现可复用

//private final Map<Class<? extends Attribute>, AttributeImpl> attributes;

//private final Map<Class<? extends AttributeImpl>, AttributeImpl> attributeImpls;

MyAttribute attribute = this.addAttribute(MyAttribute.class);

char[] buffer = new char[255];

int length = 0;

int c;

@Override

public boolean incrementToken() throws IOException {

//进行分析处理逻辑

clearAttributes();

length = 0;

while (true){

c = this.input.read();

if(c == -1){

if(length > 0){

this.attribute.setChar(buffer,length);

return true;

}else {

return false;

}

}

if(Character.isWhitespace(c)){

if(length > 0){

this.attribute.setChar(buffer,length);

return true;

}

}

buffer[length++] = (char)c;

}

}

}

public static class MyLowerCaseTokenFilter extends TokenFilter{

public MyLowerCaseTokenFilter(TokenStream s){

super(s);

}

MyAttribute attribute = this.addAttribute(MyAttribute.class);

@Override

public boolean incrementToken() throws IOException {

//获取一个分词项进行处理

boolean b = this.input.incrementToken();

if (b){

char[] chars = this.attribute.getChar();

int length = this.attribute.getLength();

if(length > 0){

for (int i = 0; i < length; i++) {

chars[i] = Character.toLowerCase(chars[i]);

}

}

}

return b;

}

}

/**

* 自定义Attribute属性接口 继承Attribute

*/

public static interface MyAttribute extends Attribute {

void setChar(char [] c, int length);

char [] getChar();

int getLength();

String getString();

}

/**

* 必须使用interface+Impl 继承AttributeImpl

*/

public static class MyAttributeImpl extends AttributeImpl implements MyAttribute {

char [] term = new char[255];

int length = 0;

@Override

public void setChar(char[] c, int length) {

this.length = length;

if(c.length > 0){

System.arraycopy(c,0,term,0,length);

}

}

@Override

public char[] getChar() {

return term;

}

@Override

public int getLength() {

return length;

}

@Override

public String getString() {

if(length > 0){

return new String(term,0,length);

}

return null;

// return new String(term); //不能直接返回 因为长度问题 默认255字符

}

@Override

public void clear() {

term = null;

term = new char[255];

this.length = 0;

}

@Override

public void reflectWith(AttributeReflector reflector) {

}

@Override

public void copyTo(AttributeImpl target) {

}

}

public static void main(String[] args) {

String text = "Hello World A b C";

try(SansamAnalyzer analyzer = new SansamAnalyzer();

//调用tokenStream()时 会先得到TokenStreamComponents对象 得到了MyLowerCaseTokenFilter 对象 观察其构造方法及此方法的返回值

TokenStream stream = analyzer.tokenStream("title",text);){

MyAttribute attribute = stream.getAttribute(MyAttribute.class);

stream.reset();

while (stream.incrementToken()){

System.out.print(attribute.getString()+" | ");

}

stream.end();

}catch (Exception e){

e.printStackTrace();

}

}

}

Lucene实现自己的英文空格小写分词器的更多相关文章

- lucene整理3 -- 排序、过滤、分词器

1. 排序 1.1. Sort类 public Sort() public Sort(String field) public Sort(String field,Boolean reverse ...

- Lucene的中文分词器IKAnalyzer

分词器对英文的支持是非常好的. 一般分词经过的流程: 1)切分关键词 2)去除停用词 3)把英文单词转为小写 但是老外写的分词器对中文分词一般都是单字分词,分词的效果不好. 国人林良益写的IK Ana ...

- Lucene介绍及简单入门案例(集成ik分词器)

介绍 Lucene是apache软件基金会4 jakarta项目组的一个子项目,是一个开放源代码的全文检索引擎工具包,但它不是一个完整的全文检索引擎,而是一个全文检索引擎的架构,提供了完整的查询引擎和 ...

- elasticsearch 分析器 分词器

参考:https://www.elastic.co/guide/en/elasticsearch/reference/current/analysis-tokenizers.html 在全文搜索(Fu ...

- Elasticsearch之文档的增删改查以及ik分词器

文档的增删改查 增加文档 使用elasticsearch-head查看 修改文档 使用elasticsearch-head查看 删除文档 使用elasticsearch-head查看 查看文档的三种方 ...

- Restful认识和 IK分词器的使用

什么是Restful风格 Restful是一种面向资源的架构风格,可以简单理解为:使用URL定位资源,用HTTP动词(GET,POST,DELETE,PUT)描述操作. 使用Restful的好处: 透 ...

- IK分词器 原理分析 源码解析

IK分词器在是一款 基于词典和规则 的中文分词器.本文讲解的IK分词器是独立于elasticsearch.Lucene.solr,可以直接用在java代码中的部分.关于如何开发es分词插件,后续会有文 ...

- ElasticSearch-IK分词器和集成使用

1.查询存在问题分析 在进行字符串查询时,我们发现去搜索"搜索服务器"和"钢索"都可以搜索到数据: 而在进行词条查询时,我们搜索"搜索"却没 ...

- 三、Solr多核心及分词器(IK)配置

多核心的概念 多核心说白了就是多索引库.也可以理解为多个"数据库表" 说一下使用multicore的真实场景,比若说,产品搜索和会员信息搜索,不使用多核也没问题,这样带来的问题是 ...

随机推荐

- Echarts属性大全(及时更新最新信息)

echarts属性的设置(完整大全) // 全图默认背景 // backgroundColor: ‘rgba(0,0,0,0)’, // 默认色板 color: ['#ff7f50','#87c ...

- C#调用C++的DLL 尝试写入受保护的内存

原因:C#中的声明函数的参数类型与C++的函数的参数类型不一致,在参照C#与C++的参数类型对照表以后,修改相应参数类型,问题解决

- Centos7 操作系统 mysql5.7 配置远程登陆操作

Centos7 操作系统: mysql5.7 配置远程登陆操作: 首先登陆服务器,进入数据库: mysql -u root -p show databases; use mysql; show tab ...

- 40_redux_counter应用_redux完善版本

项目结构: 代码: import React from 'react'; import ReactDOM from 'react-dom'; import store from './redux/st ...

- [Docker] 写 Dockerfile 的最佳实践理论

指导方针 创建短暂的容器 意思是 container 可以停止和销毁,接着以最小化启动和配置进行重新构建和替换. 理解构建的上下文 使用 docker build ,当前工作环境称 ...

- 读取文件不是真实的具体路径 setZh.ini

读取 c:\windows\Syswow64\XX\XX.ini 时内容不正确. 发现真实文件为: C:\Users\用户名\AppData\Local\VirtualStore\Windows\Sy ...

- 基于IAR平台FreeRTOS移植

开始这篇文章之前先简单说明一下,我使用的MCU是我们公司自主研发的ACH1180芯片,和STM32差不多,都是Cortex-M4的核,所以移植的过程参考了STM32移植的步骤. 1.解压FreeRT ...

- Jquery 字符串转数字

其实在jquery里把字符串转换为数字,用的还是js,因为jquery本身就是用js封装编写的. 比如我们在用jquery里的ajax来更新文章的阅读次数或人气的时候,就需要用到字符串转换为数字的功能 ...

- iptables实现端口转发实际案例

拓扑 client : 跳板机 外网:192.168.10.194 内网:10.1.1.1 内网mysql: 10.1.1.2 [root@test194 network-scripts]# cat ...

- 使用Log4J收集日志

一:搭建好Selenium+testNG+Maven环境,可参考 http://www.cnblogs.com/hc1020/p/8602863.html 二:百度搜索Maven仓库,然后搜索Log4 ...