python爬虫-爬取你想要的小姐姐

一、准备

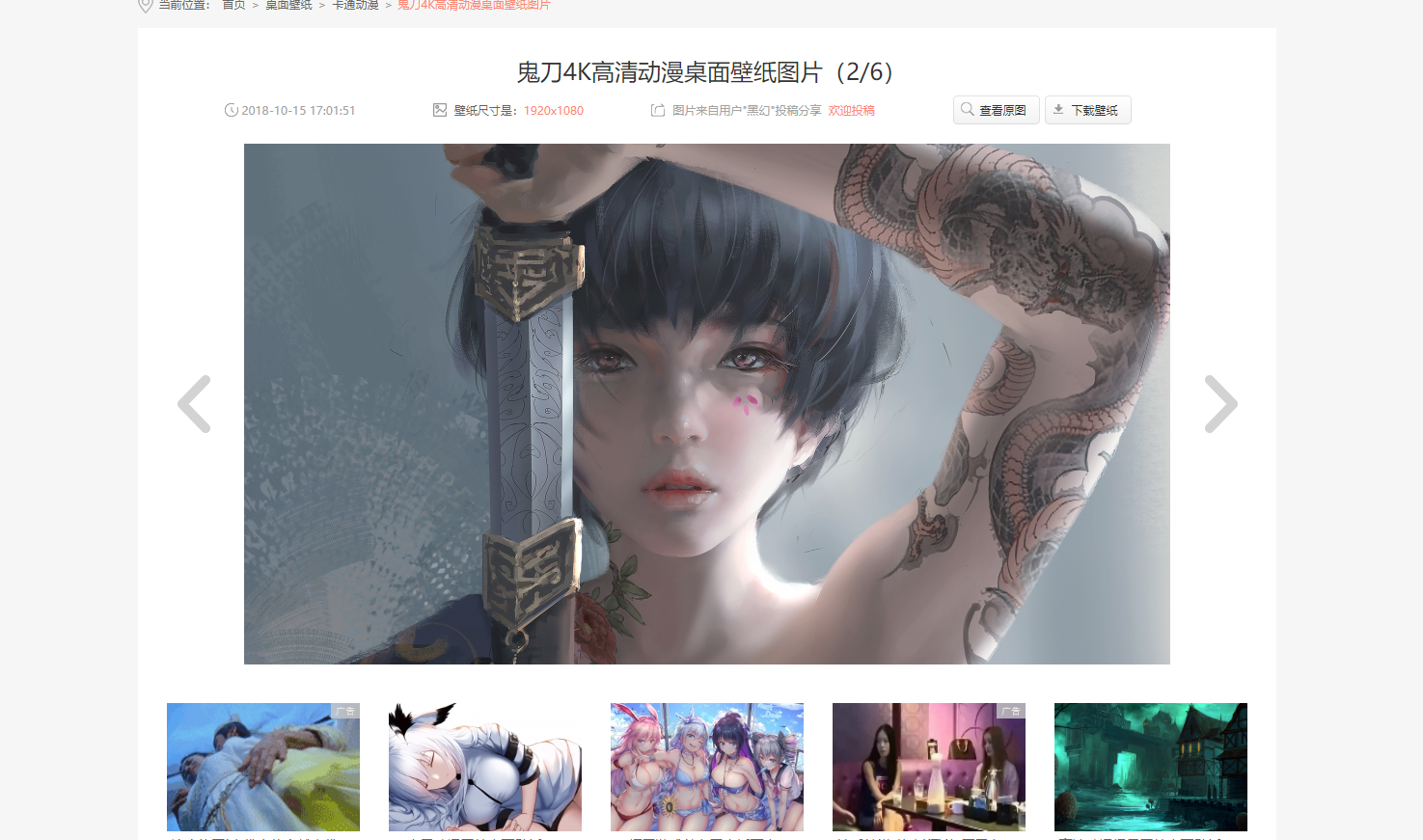

1. 原地址

2. 检查html发现,网页是有规则的分页, 最大图片的class为pic-large

二、代码

import requests

import os

from bs4 import BeautifulSoup url = 'http://www.win4000.com/wallpaper_detail_157712.html'

imgmkdir = 'D://Download//ghost_1//' # 获取网页url

def getUrlList():

imgUrlList = []

for i in range(0, 10):

imgUrl = ''

url_split = url.split('.html')

if not i == 0:

imgUrl += url_split[0] + '_' + str(i) + '.html'

# print(imgUrl)

imgUrlList.append(imgUrl) return imgUrlList # 下载图片

def downImg(imgUrl):

try:

if not os.path.exists(imgmkdir):

os.mkdir(imgmkdir)

if not os.path.exists(imgUrl):

r = requests.get(imgUrl)

r.raise_for_status()

# 使用with语句可以不用自己手动关闭已经打开的文件流

imgpath = imgmkdir + imgUrl.split('/')[-1]

# 开始写文件, wb表示写二进制文件

with open(imgpath, 'wb') as f:

f.write(r.content)

print(imgUrl + '【爬取完成】')

else:

print(imgUrl.split('/')[-1] + '【文件已存在】')

except Exception as e:

print("爬取失败" + str(e)) # 获取imgHtml标签

def getcontent(soup):

for i in soup.find_all('img', class_='pic-large'):

imgsrc = i['src']

if imgsrc.find('http') >= 0 or imgsrc.find('https') >= 0:

# 下载图片

downImg(imgsrc) # 根据url获取html源码

def getHtmlByUrl(htmlUrl):

htmlText = requests.get(htmlUrl).content

# 使用beautifulSoup解析html

soup = BeautifulSoup(htmlText, 'lxml') return soup def main():

htmlUrlList = getUrlList()

for url in htmlUrlList:

htmltext = getHtmlByUrl(url)

getcontent(htmltext) if __name__ == '__main__':

main()

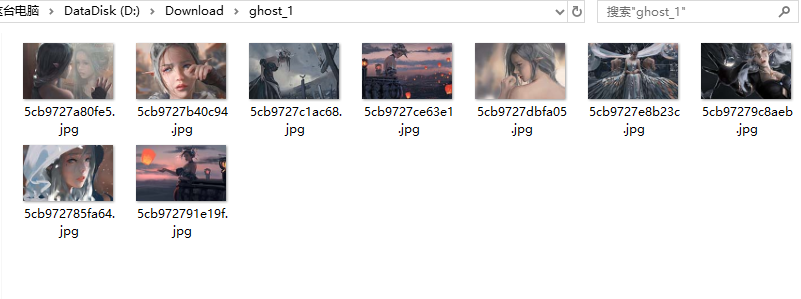

三、结果

四、总结

代码用比较笨的方法来获取,先试水

python爬虫-爬取你想要的小姐姐的更多相关文章

- 使用Python爬虫爬取网络美女图片

代码地址如下:http://www.demodashi.com/demo/13500.html 准备工作 安装python3.6 略 安装requests库(用于请求静态页面) pip install ...

- Python爬虫爬取全书网小说,程序源码+程序详细分析

Python爬虫爬取全书网小说教程 第一步:打开谷歌浏览器,搜索全书网,然后再点击你想下载的小说,进入图一页面后点击F12选择Network,如果没有内容按F5刷新一下 点击Network之后出现如下 ...

- python爬虫—爬取英文名以及正则表达式的介绍

python爬虫—爬取英文名以及正则表达式的介绍 爬取英文名: 一. 爬虫模块详细设计 (1)整体思路 对于本次爬取英文名数据的爬虫实现,我的思路是先将A-Z所有英文名的连接爬取出来,保存在一个cs ...

- 一个简单的python爬虫,爬取知乎

一个简单的python爬虫,爬取知乎 主要实现 爬取一个收藏夹 里 所有问题答案下的 图片 文字信息暂未收录,可自行实现,比图片更简单 具体代码里有详细注释,请自行阅读 项目源码: # -*- cod ...

- Python爬虫 - 爬取百度html代码前200行

Python爬虫 - 爬取百度html代码前200行 - 改进版, 增加了对字符串的.strip()处理 源代码如下: # 改进版, 增加了 .strip()方法的使用 # coding=utf-8 ...

- 用Python爬虫爬取广州大学教务系统的成绩(内网访问)

用Python爬虫爬取广州大学教务系统的成绩(内网访问) 在进行爬取前,首先要了解: 1.什么是CSS选择器? 每一条css样式定义由两部分组成,形式如下: [code] 选择器{样式} [/code ...

- Python爬虫|爬取喜马拉雅音频

"GOOD Python爬虫|爬取喜马拉雅音频 喜马拉雅是知名的专业的音频分享平台,用户规模突破4.8亿,汇集了有声小说,有声读物,儿童睡前故事,相声小品等数亿条音频,成为国内发展最快.规模 ...

- python爬虫爬取内容中,-xa0,-u3000的含义

python爬虫爬取内容中,-xa0,-u3000的含义 - CSDN博客 https://blog.csdn.net/aiwuzhi12/article/details/54866310

- python爬虫-爬取百度图片

python爬虫-爬取百度图片(转) #!/usr/bin/python# coding=utf-8# 作者 :Y0010026# 创建时间 :2018/12/16 16:16# 文件 :spider ...

随机推荐

- Spring的Core模块

Core模块主要的功能是实现了反向控制IOC(Inversion of Control)与依赖注入DI(Dependency Injection).Bean配置以及加载.Core模块中有Beans.B ...

- Kafka与ActiveMQ区别

Kafka 是LinkedIn 开发的一个高性能.分布式的消息系统,广泛用于日志收集.流式数据处理.在线和离线消息分发等场景.虽然不是作为传统的MQ来设计,在大部分情况,Kafaka 也可以代替原先A ...

- 模板 - 数学 - 多项式 - 快速数论变换/NTT

Huffman分治的NTT,常数一般.使用的时候把多项式的系数们放进vector里面,然后调用solve就可以得到它们的乘积.注意这里默认最大长度是1e6,可能需要改变. #include<bi ...

- [代码审计]PHP_Bugs题目总结(1)

0x00 简介 最近这几天看到了许多关于代码审计的ctf题,在电脑里也翻出来好长时间没看过的php_bugs,干脆最近把这个好好看看! 下载地址:https://github.com/bowu678/ ...

- Zk单机多实例部署

一.环境准备 当前环境:centos7.3一台软件版本:zookeeper-3.5.2部署目录:/usr/local/zookeeper启动端口:2181,2182,2183配置文件:/usr/loc ...

- cnetos7--zabbix(3.4)-server安装

1.安装前准备 (1)关闭防火墙 [root@localhost ~]#Systemctl stop firewalld.service (2)开机关闭防火墙 [root@localhost ~]#S ...

- ICEM-带把圆环

原视频下载地址:https://pan.baidu.com/s/1pKSXyR5 密码: dynm

- 【软工实践】团队项目Snug-需求分析报告

组长博客链接 博客链接 团队项目整体计划安排 阶段序列 阶段时间 主要阶段任务 完成情况 第一阶段 9.6 团队成立 已完成 第二阶段 9.6-9.13 课题选择 已完成 第三阶段 9.13-9.18 ...

- centos7.6下编译安装zabbix4.0.10长期支持版

一.安装数据库,这里使用的是percona-server5..24版本 配置如下 [root@zabbix4_clone:~]# cat /etc/my.cnf # Example MySQL con ...

- append()、appendChild() 和 innerHTML 的区别

概念和区别:append() 可以同时传入多个节点或字符串,没有返回值: 据说 append 还是试用期的方法,有兼容问题,(但我用了暂时火狐,谷歌,iE都能使用). https://develope ...