python 1992和2006年国家标准学科分类和代码标准化并存入MySQL数据库

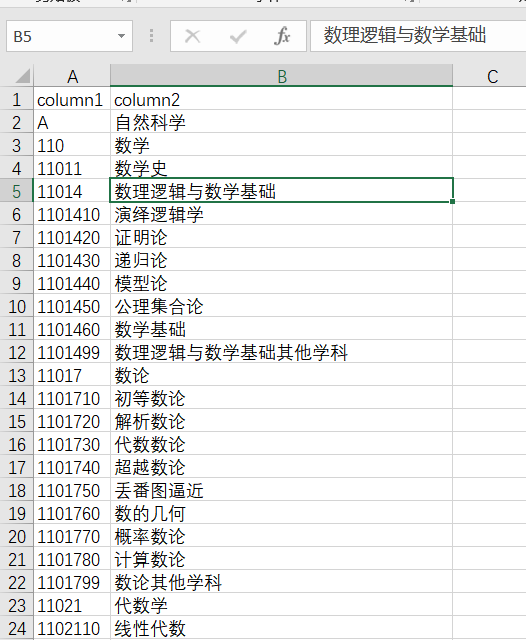

数据表

代码

1 import pandas as pd

2 import pymysql

3

4

5 def get_subject_1992():

6 res={}

7 the_former_code = ""

8 layer1_code = "" # 一位

9 layer1_name = ""

10 layer2_code = "" # 三位

11 layer2_name = "" # 三位

12 layer3_code = "" # 五位

13 layer3_name = ""

14 layer4_code = "" # 七位

15 layer4_name = "" # 七位

16 df = pd.read_excel("std_subject_1992.xlsx")

17 for i in range(len(df.values)):

18 item=df.values[i]

19 # print(item[0],item[1])

20 if (len(str(item[0])) == 1):

21 layer1_code = str(item[0])

22 layer1_name = item[1]

23 # print(layer1_code,layer1_name)

24 if (len(str(item[0])) == 3):

25 layer2_code = str(item[0])

26 layer2_name = item[1]

27 # print(layer2_code, layer2_name)

28 if (len(str(item[0])) == 5):

29 layer3_code = str(item[0])

30 layer3_name = item[1]

31 if(i!=(len(df.values)-1)):

32 if(len(str(df.values[i+1][0]))!=7):

33 # print(layer1_code + layer3_code,layer1_name + "·" + layer2_name + "·" +layer3_name)

34 res.update({layer1_code + layer3_code+"00":layer1_name + "·" + layer2_name + "·" +layer3_name})

35 # print(layer3_code, layer3_name)

36 if (len(str(item[0])) == 6):

37 layer4_code = str(item[0])+"0"

38 layer4_name = item[1]

39 # print(layer4_code, layer4_name)

40 if (layer4_code[:5] == layer3_code):

41 # print(layer1_code + layer4_code,layer1_name + "·" + layer2_name + "·" + layer3_name + "·" + layer4_name)

42 res.update({layer1_code + layer4_code:layer1_name + "·" + layer2_name + "·" + layer3_name + "·" + layer4_name})

43 if (len(str(item[0])) == 7):

44 layer4_code = str(item[0])

45 layer4_name = item[1]

46 # print(layer4_code, layer4_name)

47 if (layer4_code[:5] == layer3_code):

48 # print(layer1_code + layer4_code,layer1_name + "·" + layer2_name + "·" + layer3_name + "·" + layer4_name)

49 res.update({layer1_code + layer4_code:layer1_name + "·" + layer2_name + "·" + layer3_name + "·" + layer4_name})

50 return res

51

52 """

53 ---------------------------------------------------------------------------------------

54 """

55 def get_subject_2009():

56 res={}

57 the_former_code = ""

58 layer1_code = "" # 一位

59 layer1_name = ""

60 layer2_code = "" # 三位

61 layer2_name = "" # 三位

62 layer3_code = "" # 五位

63 layer3_name = ""

64 layer4_code = "" # 七位

65 layer4_name = "" # 七位

66 df = pd.read_excel("std_subject_2009.xlsx")

67 for i in range(len(df.values)):

68 item=df.values[i]

69 # print(item[0],item[1])

70 if (len(str(item[0])) == 1):

71 layer1_code = str(item[0])

72 layer1_name = item[1]

73 # print(layer1_code,layer1_name)

74 if (len(str(item[0])) == 3):

75 layer2_code = str(item[0])

76 layer2_name = item[1]

77 # print(layer2_code, layer2_name)

78 if (len(str(item[0])) == 5):

79 layer3_code = str(item[0])

80 layer3_name = item[1]

81 if(i!=(len(df.values)-1)):

82 if(len(str(df.values[i+1][0]))!=7):

83 # print(layer1_code + layer3_code,layer1_name + "·" + layer2_name + "·" +layer3_name)

84 res.update({layer1_code + layer3_code+"00":layer1_name + "·" + layer2_name + "·" +layer3_name})

85 if (len(str(item[0])) == 7):

86 layer4_code = str(item[0])

87 layer4_name = item[1]

88 # print(layer4_code, layer4_name)

89 if (layer4_code[:5] == layer3_code):

90 # print(layer1_code + layer4_code,layer1_name + "·" + layer2_name + "·" + layer3_name + "·" + layer4_name)

91 res.update({layer1_code + layer4_code:layer1_name + "·" + layer2_name + "·" + layer3_name + "·" + layer4_name})

92 return res

93 """

94 ---------------------------------------------------------------------------------------------------------------

95 """

96 def get_conn():

97 """

98 :return: 连接,游标

99 """

100 # 创建连接

101 conn = pymysql.connect(host="127.0.0.1",

102 user="root",

103 password="000429",

104 db="data_cleaning",

105 charset="utf8")

106 # 创建游标

107 cursor = conn.cursor() # 执行完毕返回的结果集默认以元组显示

108 return conn, cursor

109

110 def close_conn(conn, cursor):

111 if cursor:

112 cursor.close()

113 if conn:

114 conn.close()

115

116

117 def into_mysql():

118 global conn, cursor

119 res=get_subject_2009()

120 for k,v in res.items():

121 print(k,v)

122 try:

123 conn,cursor=get_conn()

124 SQL="insert into std_subject_2009 (year,subject_code,subject_name) values (2009,'"+k+"','"+v+"')"

125 cursor.execute(SQL)

126 conn.commit()

127 except:

128 print(k,v+" 插入失败!")

129 conn,cursor.close()

130 return None

131 if __name__ == '__main__':

132 into_mysql()

获取标准学科分类表 请关注公众号【靠谱杨阅读人生】回复【学科】获取

python 1992和2006年国家标准学科分类和代码标准化并存入MySQL数据库的更多相关文章

- 用Python获取沪深两市上市公司股票信息,提取创近10天股价新高的、停牌的、复牌不超过一天或者新发行的股票,并存入mysql数据库

#该脚本可以提取沪深两市上市公司股票信息,并按以下信息分类:(1)当天股价创近10个交易日新高的股票:(2)停牌的股票:(3)复牌不超过一个交易日或者新发行的股票 #将分类后的股票及其信息(股价新高. ...

- Python之道1-环境搭建与pycharm的配置django安装及MySQL数据库配置

近期做那个python的开发,今天就来简单的写一下开发路线的安装及配置, 开发路线 Python3.6.1+Pycharm5.0.6+Django1.11+MySQL5.7.18 1-安装Python ...

- (转载)Python之道1-环境搭建与pycharm的配置django安装及MySQL数据库配置

近期做那个python的开发,今天就来简单的写一下开发路线的安装及配置, 开发路线 Python3.6.1+Pycharm5.0.6+Django1.11+MySQL5.7.18 1-安装Python ...

- python爬虫学习(2)__抓取糗百段子,与存入mysql数据库

import pymysql import requests from bs4 import BeautifulSoup#pymysql链接数据库 conn=pymysql.connect(host= ...

- Python+Scrapy+Crawlspider 爬取数据且存入MySQL数据库

1.Scrapy使用流程 1-1.使用Terminal终端创建工程,输入指令:scrapy startproject ProName 1-2.进入工程目录:cd ProName 1-3.创建爬虫文件( ...

- python爬取疫情数据存入MySQL数据库

import requests from bs4 import BeautifulSoup import json import time from pymysql import * def mes( ...

- python爬虫:爬取易迅网价格信息,并写入Mysql数据库

本程序涉及以下方面知识: 1.python链接mysql数据库:http://www.cnblogs.com/miranda-tang/p/5523431.html 2.爬取中文网站以及各种乱码处 ...

- MySQL数据库和Python的交互

一.缘由 这是之前学习的时候写下的基础代码,包含着MySQL数据库和Python交互的基本操作. 二.代码展示 import pymysql ''' 1.数据库的链接和创建视图 ''' # db=py ...

- Python pandas ERROR 2006 (HY000): MySQL server has gone away

之前在做python pandas大数据分析的时候,在将分析后的数据存入mysql的时候报ERROR 2006 (HY000): MySQL server has gone away 原因分析:在对百 ...

- python实现HOG+SVM对CIFAR-10数据集分类(上)

本博客只用于学习,如果有错误的地方,恳请指正,如需转载请注明出处. 看机器学习也是有一段时间了,这两天终于勇敢地踏出了第一步,实现了HOG+SVM对图片分类,具体代码可以在github上下载,http ...

随机推荐

- Docker实践之09-高级网络配置

目录 一.Docker网络原理及默认配置 二.Docker网络定制配置参数 三.容器访问控制原理 1.容器访问外部网络 2.容器之间访问 3.访问所有端口 4.访问指定端口 5.映射容器端口到主机端口 ...

- SpringBoot事务注解@Transactional 事物回滚、手动回滚事物

处理springboot 下提交事务异常,数据库没有回滚的问题. spring的文档中说道,spring声明式事务管理默认对非检查型异常和运行时异常进行事务回滚,而对检查型异常则不进行回滚操作. 什么 ...

- python中操作csv

示例 import csv with open('t.csv', mode='r', encoding='utf-8') as f: reader_obj = csv.reader(f) # 通过re ...

- 4-request对象

前端提交数据 必备知识点 前端form表单中action属性,不写默认是当前路由地址 前端form表单中的method属性,不写默认是GET请求 前端页面 templates\register.htm ...

- SSH不对称密钥自动登入服务器

SSH不对称密钥自动登入服务器 1.先在自己的电脑上创建密钥对 ssh-keygen -t rsa Windows下生成SSH密钥 $ ssh-keygen -t rsa -C "youre ...

- React实现导航栏点击高亮

在jquery中实现导航栏的切换只需要一行代码找到同级其他元素removeClass以及添加点击元素addClass就可以实现了,但是React没法直接找到同级元素,这个时候需要一点js中的思维,根据 ...

- Emqx高可用架构

目录 优化前架构 主要问题 haproxy问题 优化后架构 优化功能点 emq版本升级 linux系统调优 haproxy调优 测试工具 依赖安装 配置erl环境变量 安装压测软件 测试指令与结果展示 ...

- 【Azure Function App】如何修改Azure函数应用的默认页面呢?

问题描述 当在Azure中创建了一个函数应用(Function App)后,访问默认URL会得到一个默认的页面.是否有办法修改这个默认页面呢? 问题解答 在之前的博文中,介绍了修改App Servic ...

- 一次生产环境OOM排查

一.背景 前几天下午飞书告警群里报起了java.lang.OutOfMemoryError: unable to create new native thread告警,看见后艾特了对应的项目负责人但是 ...

- 一文上手图数据备份恢复工具 NebulaGraph BR

作者:NebulaGraph 工程师 Kenshin NebulaGraph BR 开源已经有一段时间了,为了给社区用户提供一个更稳.更快.更易用的备份恢复工具,去年对其进行了比较大的重构.Nebul ...