python 3 爬取某小说网站小说,注释详细

目标:每一个小说保存成一个txt文件

思路:获取每个小说地址(图一),进入后获取每章节地址(图二),然后进入获取该章节内容(图三)保存文件中。循环

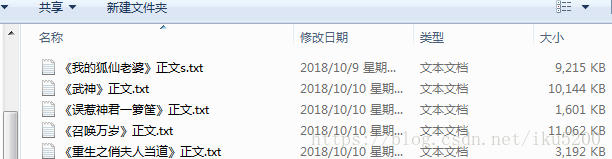

效果图:

每一行都有注释,不多解释了

import requests

from bs4 import BeautifulSoup

import os

if __name__ == '__main__':

# 要下载的网页

url = 'https://www.biqubao.com/quanben/'

# 网站根网址

root_url = 'https://www.biqubao.com'

# 保存本地路径

path = 'F:\\python\\txt'

# 解析网址

req = requests.get(url)

# 设置编码,浏览器查看网站编码:F12,控制开输入document.characterSet回车即可查看

req.encoding = 'gbk'

# 获取网页所有内容

soup = BeautifulSoup(req.text, 'html.parser')

# 查找网页中div的id为main的标签

list_tag = soup.div(id="main")

# 查看div内所有里标签

li = list_tag[0](['li'])

# 删除第一个没用的标签

del li[0]

# 循环遍历

for i in li:

# 获取到a标签间的内容---小说类型

txt_type = i.a.string

# 获取a标签的href地址值---小说网址

short_url = (i(['a'])[1].get('href'))

# 获取第三个span标签的值---作者

author = i(['span'])[3].string

# 获取网页设置网页编码

req = requests.get(root_url + short_url)

req.encoding = 'gbk'

# 解析网页

soup = BeautifulSoup(req.text, "html.parser")

list_tag = soup.div(id="list")

# 获取小说名

name = list_tag[0].dl.dt.string

print("类型:{} 短址:{} 作者:{} 小说名:{}".format(txt_type, short_url, author, name))

# 创建同名文件夹

# paths = path + '\\' + name

if not os.path.exists(path):

# 获取当前目录并组合新目录

# os.path.join(path, name)

os.mkdir(path)

# 循环所有的dd标签

for dd_tag in list_tag[0].dl.find_all('dd'):

# 章节名

zjName = dd_tag.string

# 章节地址

zjUrl = root_url + dd_tag.a.get('href')

# 访问网址爬取章节内容

req2 = requests.get(zjUrl)

req2.encoding = 'gbk'

zj_soup = BeautifulSoup(req2.text, "html.parser")

content_tag = zj_soup.div.find(id="content")

# 把空格内容替换成换行

text = str(content_tag.text.replace('\xa0', '\n'))

text.replace('\ufffd', '\n')

# 写入文件操作'a'追加

with open(path + "\\" + name + ".txt", 'a') as f:

f.write('\n' + '\n' + zjName)

f.write(text)

print("{}------->写入完毕".format(zjName))python 3 爬取某小说网站小说,注释详细的更多相关文章

- Python轻松爬取Rosimm写真网站全部图片

RosimmImage 爬取Rosimm写真网站图片 有图有真相 def main_start(url): """ 爬虫入口,主要爬取操作 ""&qu ...

- Python爬虫爬取美剧网站

一直有爱看美剧的习惯,一方面锻炼一下英语听力,一方面打发一下时间.之前是能在视频网站上面在线看的,可是自从广电总局的限制令之后,进口的美剧英剧等貌似就不在像以前一样同步更新了.但是,作为一个宅diao ...

- Python——Scrapy爬取链家网站所有房源信息

用scrapy爬取链家全国以上房源分类的信息: 路径: items.py # -*- coding: utf-8 -*- # Define here the models for your scrap ...

- python爬虫爬取ip记录网站信息并存入数据库

import requests import re import pymysql #10页 仔细观察路由 db = pymysql.connect("localhost",&quo ...

- Python爬虫爬取全书网小说,程序源码+程序详细分析

Python爬虫爬取全书网小说教程 第一步:打开谷歌浏览器,搜索全书网,然后再点击你想下载的小说,进入图一页面后点击F12选择Network,如果没有内容按F5刷新一下 点击Network之后出现如下 ...

- Jsoup-基于Java实现网络爬虫-爬取笔趣阁小说

注意!仅供学习交流使用,请勿用在歪门邪道的地方!技术只是工具!关键在于用途! 今天接触了一款有意思的框架,作用是网络爬虫,他可以像操作JS一样对网页内容进行提取 初体验Jsoup <!-- Ma ...

- bs4爬取笔趣阁小说

参考链接:https://www.cnblogs.com/wt714/p/11963497.html 模块:requests,bs4,queue,sys,time 步骤:给出URL--> 访问U ...

- Python 爬取所有51VOA网站的Learn a words文本及mp3音频

Python 爬取所有51VOA网站的Learn a words文本及mp3音频 #!/usr/bin/env python # -*- coding: utf-8 -*- #Python 爬取所有5 ...

- Python开发爬虫之BeautifulSoup解析网页篇:爬取安居客网站上北京二手房数据

目标:爬取安居客网站上前10页北京二手房的数据,包括二手房源的名称.价格.几室几厅.大小.建造年份.联系人.地址.标签等. 网址为:https://beijing.anjuke.com/sale/ B ...

- python爬虫学习之使用BeautifulSoup库爬取开奖网站信息-模块化

实例需求:运用python语言爬取http://kaijiang.zhcw.com/zhcw/html/ssq/list_1.html这个开奖网站所有的信息,并且保存为txt文件和excel文件. 实 ...

随机推荐

- go Test的实现 以及 压力测试

引用 import "testing" 一些原则 文件名必须是 *_test.go* 结尾的,这样在执行 go test 的时候才会执行到相应的代码 必须 import testi ...

- os.listdir()、os.walk()和os.mkdir()的用法

内容主要参照博客https://blog.csdn.net/xxn_723911/article/details/78795033 http://www.runoob.com/python/os-wa ...

- django系列7:修改404页面展示,优化模板,降低urlconf和模板之间的耦合,命名app将模板和app绑定

为了增加程序的友好和健壮性,修改view代码,处理以下如果出现404,页面的UI展示. 修改view代码 from django.http import Http404 from django.sho ...

- Vue(小案例_vue+axios仿手机app)_公共组件(路由组件传参)

一.前言 1.公共轮播图的实现 2.组件传参,公共组件的实现 二.主要内容 1.公共轮播图的实现 (1)分析:当渲染不同的轮 ...

- mysql中常用的函数

-- 基本上都是抄的别人整理的 -- 一.数学函数 ABS(x) -- 返回x的绝对值 BIN(x) -- 返回x的二进制(OCT返回八进制,HEX返回十六进制) CEILING(x) -- 返回大于 ...

- [物理学与PDEs]第1章习题6 无限长载流直线的磁场

试计算电流强度为 $I$ 的无限长的直导线所产生的磁场的磁感强度. 解答: 设 $P$ 到直线的距离为 $r$, 垂足为 $P_0$, 则 ${\bf B}(P)$ 的方向为 ${\bf I}\tim ...

- Jasmine

Jasmine https://www.npmjs.com/package/jasmine The Jasmine Module The jasmine module is a package of ...

- css 兼容各种iPhone

@media (device-height:480px) and (-webkit-min-device-pixel-ratio:2){/* 兼容iphone4/4s */ .class{} } @m ...

- mysql 原理 ~ 并行复制

一 概念1 MTS(Prepared transactions slave parallel applier) 主库在同一时间进入prepare状态的事务可以被从库并行回放2 传统与改进 ma ...

- iTOP-4412开发板_驱动_adc驱动升级和测试例程

本文档介绍 iTOP-4412 开发板的 adc 驱动的升级和测试例程.自带的驱动只能支持一路 adc,本文介绍如何修改可以支持 4 路 adc 的控制.1 硬件简介如下图所示,这是 4412 的 d ...