Python爬虫,爬取腾讯漫画实战

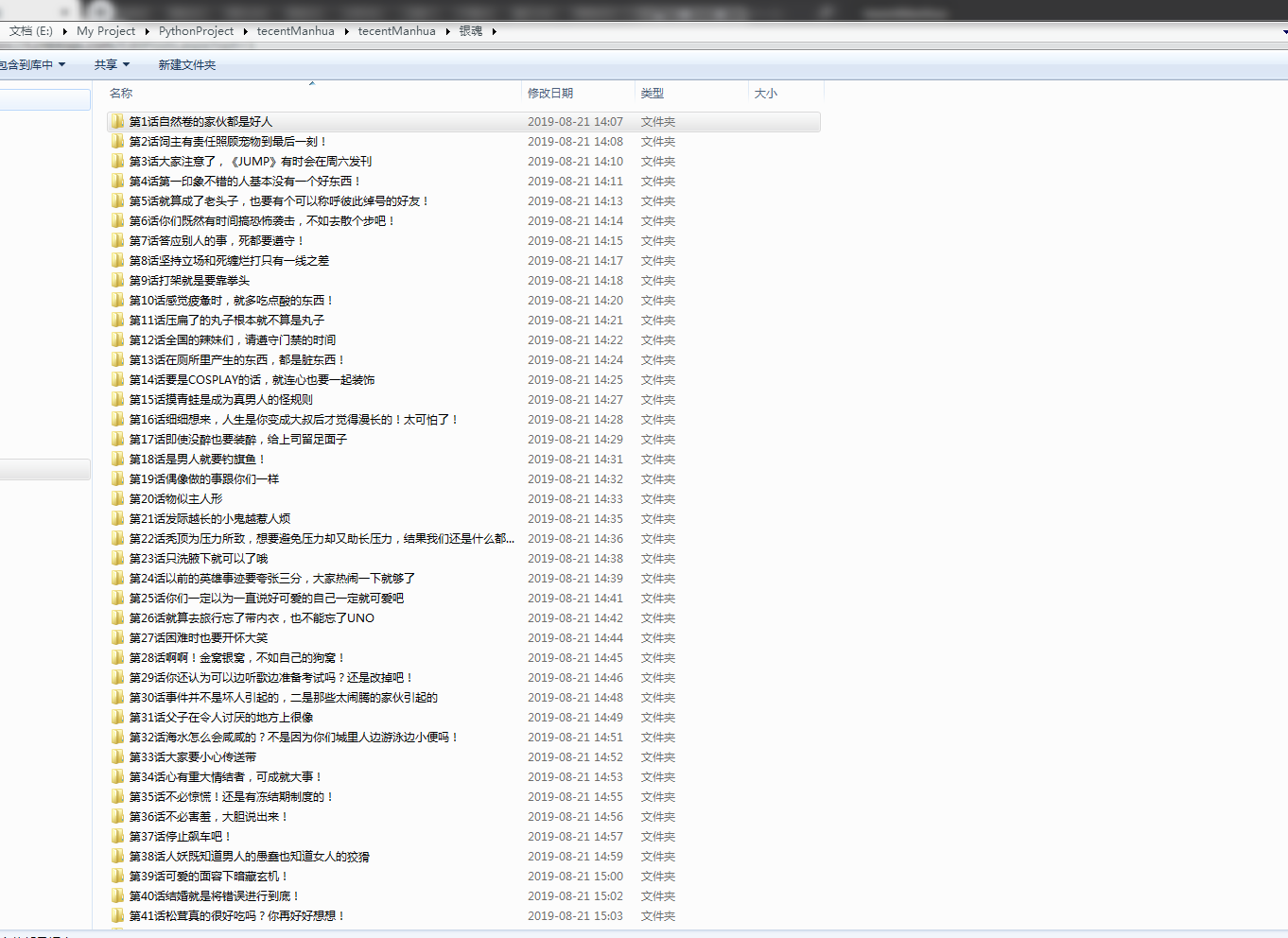

先上个爬取的结果图

最后的结果为每部漫画按章节保存

运行环境

IDE VS2019

Python3.7

Chrome、ChromeDriver

Chrome和ChromeDriver的版本需要相互对应

先上代码,代码非常简短,包含空行也才50行,多亏了python强大的库

import os

import time

import requests

from selenium import webdriver

from lxml import etree def getChapterUrl(url):

headers = {

"User-Agent": "Mozilla/5.0 (Macintosh; Intel Mac OS X 10_13_4) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/66.0.3359.139 Safari/537.36"

}

part_url = "http://ac.qq.com"

res = requests.get(url, headers=headers)

html=res.content.decode()

el = etree.HTML(html)

li_list = el.xpath('//*[@id="chapter"]/div[2]/ol[1]/li')

for li in li_list:

for p in li.xpath("./p"):

for span in p.xpath("./span[@class='works-chapter-item']"):

item = {}

list_title = span.xpath("./a/@title")[0].replace(' ', '').split(':')

if list_title[1].startswith(('第', '序')):

getChapterFile(part_url + span.xpath("./a/@href")[0], list_title[0],list_title[1]) def getChapterFile(url,path1,path2):

#path = os.path.join(path)

#漫画名称目录

path=os.path.join(path1)

if not os.path.exists(path):

os.mkdir(path)

#章节目录

path=path+'\\'+path2

if not os.path.exists(path):

os.mkdir(path)

chrome=webdriver.Chrome()

#"http://ac.qq.com/ComicView/index/id/505435/cid/2"

chrome.get(url)

time.sleep(4)

imgs = chrome.find_elements_by_xpath("//div[@id='mainView']/ul[@id='comicContain']//img")

for i in range(0, len(imgs)):

js="document.getElementById('mainView').scrollTop="+str((i) * 1280)

chrome.execute_script(js)

time.sleep(3)

print(imgs[i].get_attribute("src"))

with open(path+'\\'+str(i)+'.png', 'wb') as f:

f.write(requests.get(imgs[i].get_attribute("src")).content)

chrome.close()

print('下载完成') if __name__ == '__main__':

getChapterUrl('http://ac.qq.com/Comic/ComicInfo/id/505435')

简单解释

输入一个漫画的url即可爬取该漫画所有的章节,由于是模拟用户爬取的,所以速度方面有点慢,我试了下爬取银魂前70章,用了1个半小时,代码中的sleep可以适当简短点已加快爬取的速度

付费的漫画是没有办法爬取的

谈一下过程中遇到的坑

腾讯的漫画网站打开章节时没有把所有图片的url都加载出来,所以我在这里用的方式是使用selenium来模拟用户操作,每次打开页面以后使用js操作滚动条下拉

最后再贴下代码库,其实贴出的代码已经是所有的代码了

https://dev.azure.com/shenjuncaci/PythonTecentManhua

Python爬虫,爬取腾讯漫画实战的更多相关文章

- Python爬虫---爬取腾讯动漫全站漫画

目录 操作环境 网页分析 明确目标 提取漫画地址 提取漫画章节地址 提取漫画图片 编写代码 导入需要的模块 获取漫画地址 提取漫画的内容页 提取章节名 获取漫画源网页代码 下载漫画图片 下载结果 完整 ...

- python爬虫爬取腾讯招聘信息 (静态爬虫)

环境: windows7,python3.4 代码:(亲测可正常执行) import requests from bs4 import BeautifulSoup from math import c ...

- Python爬虫 - 爬取百度html代码前200行

Python爬虫 - 爬取百度html代码前200行 - 改进版, 增加了对字符串的.strip()处理 源代码如下: # 改进版, 增加了 .strip()方法的使用 # coding=utf-8 ...

- 用Python爬虫爬取广州大学教务系统的成绩(内网访问)

用Python爬虫爬取广州大学教务系统的成绩(内网访问) 在进行爬取前,首先要了解: 1.什么是CSS选择器? 每一条css样式定义由两部分组成,形式如下: [code] 选择器{样式} [/code ...

- 使用Python爬虫爬取网络美女图片

代码地址如下:http://www.demodashi.com/demo/13500.html 准备工作 安装python3.6 略 安装requests库(用于请求静态页面) pip install ...

- Python爬虫|爬取喜马拉雅音频

"GOOD Python爬虫|爬取喜马拉雅音频 喜马拉雅是知名的专业的音频分享平台,用户规模突破4.8亿,汇集了有声小说,有声读物,儿童睡前故事,相声小品等数亿条音频,成为国内发展最快.规模 ...

- python爬虫爬取内容中,-xa0,-u3000的含义

python爬虫爬取内容中,-xa0,-u3000的含义 - CSDN博客 https://blog.csdn.net/aiwuzhi12/article/details/54866310

- Python爬虫爬取全书网小说,程序源码+程序详细分析

Python爬虫爬取全书网小说教程 第一步:打开谷歌浏览器,搜索全书网,然后再点击你想下载的小说,进入图一页面后点击F12选择Network,如果没有内容按F5刷新一下 点击Network之后出现如下 ...

- python爬虫—爬取英文名以及正则表达式的介绍

python爬虫—爬取英文名以及正则表达式的介绍 爬取英文名: 一. 爬虫模块详细设计 (1)整体思路 对于本次爬取英文名数据的爬虫实现,我的思路是先将A-Z所有英文名的连接爬取出来,保存在一个cs ...

随机推荐

- uSID:SRv6新范式

摘要:本文介绍最新的SRv6创新uSID(Micro Segment).uSID兼容既有的SRv6框架,将极大地改变SRv6的设计.实现和部署方式,成为SRv6的新范式. 一.SRv6 101 Seg ...

- MyBatis从入门到精通:第二章数据的创建与插入文件

数据库表的创建: create table sys_user ( id bigint not null auto_increment, ), user_password ), user_email ) ...

- vector是序列式容器而set是关联式容器。set包含0个或多个不重复不排序的元素。

1.vector是序列式容器而set是关联式容器.set包含0个或多个不重复不排序的元素.也就是说set能够保证它里面所有的元素都是不重复的.另外对set容器进行插入时可以指定插入位置或者不指定插入位 ...

- 小白学python之整型,布尔值,十进制二进制转换和字符串详解for循环!

整型与字符串转化 十进制转二进制. python2,存在int 整型和long(长整型),在python3里就是int/获取的是浮点数 小数 print(bin(15)) 这样可以通过代码来计算十进制 ...

- 个人永久性免费-Excel催化剂功能第101波-批量替换功能(增加正则及高性能替换能力)

数据处理无小事,正如没有人活在真空理想环境一下,在数据分析过程中,也没有那么真空理想化的数据源可以使用,数据处理占据数据分析的80%的时间,每一个小小的改善,获益都良多.Excel查找替换,有其局限性 ...

- NameNode和SecondaryNameNode的工作机制

NameNode&Secondary NameNode 工作机制 NameNode: 1.启动时,加载编辑日志和镜像文件到内存 2.当客户端对元数据进行增删改,请求NameNode 3.Nam ...

- Java 基础知识面试题

equals与==有什么区别? (1)==是判断两个变量或实例是不是指向同一个内存空间 (2)equals是判断两个变量或实例所指向的内存空间的值是不是相同 Object有哪些公用方法? (1)equ ...

- spring applicationContext.xml文件移到resources目录下

SpringMVC的框架默认目录结构 修改后的目录结构及web.xml 同时在pom里的配置:将resources目录打包到web-inf/classes目录下<resources> ...

- storm trident 的介绍与使用

一.trident 的介绍 trident 的英文意思是三叉戟,在这里我的理解是因为之前我们通过之前的学习topology spout bolt 去处理数据是没有问题的,但trident 的对spou ...

- Spring 整合 ibatis

是的,真的是那个不好用的ibatis,不是好用的mybatis. 由于工作需要用到ibatis需要自己搭建环境,遇到了不少的坑,做一下记录. 一.环境配置 Maven JDK1.6 (非常重要,使用S ...