Python 之scrapy框架58同城招聘爬取案例

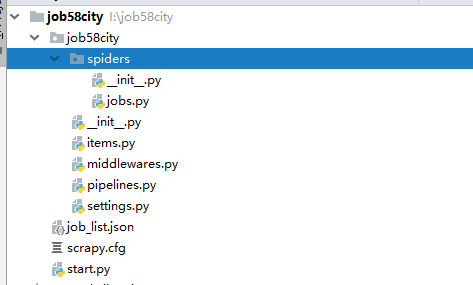

一、项目目录结构:

代码如下:

# -*- coding: utf-8 -*- # Define here the models for your scraped items

#

# See documentation in:

# https://doc.scrapy.org/en/latest/topics/items.html import scrapy class Job58CityItem(scrapy.Item):

# define the fields for your item here like:

# name = scrapy.Field()

job_name = scrapy.Field()

money = scrapy.Field()

job_wel = scrapy.Field()

company = scrapy.Field()

position_type = scrapy.Field()

xueli = scrapy.Field()

jingyan = scrapy.Field()

address = scrapy.Field()

# -*- coding: utf-8 -*-

import scrapy

from ..items import Job58CityItem class JobsSpider(scrapy.Spider):

name = 'jobs'

allowed_domains = ['58.com']

# 配置起始页url

offset = 1

url = "https://cd.58.com/job/pn{0}/"

start_urls = [url.format(str(offset))] #解析html内容

def parse(self, response):

for each in response.xpath("//ul[@id='list_con']/li"):

item = Job58CityItem()

item['job_name'] = each.xpath(".//span[@class='name']/text()").extract()[0]

money_list = each.xpath(".//p[@class='job_salary']/text()").extract()

money = "未知"

if len(money_list) > 0:

money = money_list[0]

item['money'] = money

span = each.xpath(".//div[@class='job_wel clearfix']/span")

item['job_wel'] = []

for i in span:

item['job_wel'].append(i.xpath("./text()").extract()[0])

item['company'] = each.xpath(".//div[@class='comp_name']/a/text()").extract()[0]

item['position_type'] = each.xpath(".//span[@class='cate']/text()").extract()[0]

item['xueli'] = each.xpath(".//span[@class='xueli']/text()").extract()[0]

item['jingyan'] = each.xpath(".//span[@class='jingyan']/text()").extract()[0]

item['address'] = each.xpath("//span[@class='address']/text()").extract()[0]

yield item

if self.offset < 100:

self.offset += 1

yield scrapy.Request("https://cd.58.com/job/pn{0}/".format(str(self.offset)), callback=self.parse)

from scrapy import cmdline if __name__ == '__main__':

cmdline.execute("scrapy crawl jobs".split())

数据:

源码链接:https://github.com/yangsphp/Scrapy-master

Python 之scrapy框架58同城招聘爬取案例的更多相关文章

- python爬虫 scrapy框架(一)爬取壁纸照片

此项目仅供学习参考, 不用于任何商业用途 若侵权留言,立刻删除 刚入门爬虫不久,一心想找个网站试试,然后朋友推荐了这个壁纸网站

- Scrapy 框架 CrawlSpider 全站数据爬取

CrawlSpider 全站数据爬取 创建 crawlSpider 爬虫文件 scrapy genspider -t crawl chouti www.xxx.com import scrapy fr ...

- scrapy框架用CrawlSpider类爬取电影天堂.

本文使用CrawlSpider方法爬取电影天堂网站内国内电影分类下的所有电影的名称和下载地址 CrawlSpider其实就是Spider的一个子类. CrawlSpider功能更加强大(链接提取器,规 ...

- 爬虫(十七):Scrapy框架(四) 对接selenium爬取京东商品数据

1. Scrapy对接Selenium Scrapy抓取页面的方式和requests库类似,都是直接模拟HTTP请求,而Scrapy也不能抓取JavaScript动态谊染的页面.在前面的博客中抓取Ja ...

- python爬虫scrapy框架

Scrapy 框架 关注公众号"轻松学编程"了解更多. 一.简介 Scrapy是用纯Python实现一个为了爬取网站数据.提取结构性数据而编写的应用框架,用途非常广泛. 框架的力量 ...

- python爬虫scrapy框架——人工识别登录知乎倒立文字验证码和数字英文验证码(2)

操作环境:python3 在上一文中python爬虫scrapy框架--人工识别知乎登录知乎倒立文字验证码和数字英文验证码(1)我们已经介绍了用Requests库来登录知乎,本文如果看不懂可以先看之前 ...

- Python爬虫(四)——开封市58同城数据模型训练与检测

前文参考: Python爬虫(一)——开封市58同城租房信息 Python爬虫(二)——对开封市58同城出租房数据进行分析 Python爬虫(三)——对豆瓣图书各模块评论数与评分图形化分析 数据的构建 ...

- [Python爬虫] 使用 Beautiful Soup 4 快速爬取所需的网页信息

[Python爬虫] 使用 Beautiful Soup 4 快速爬取所需的网页信息 2018-07-21 23:53:02 larger5 阅读数 4123更多 分类专栏: 网络爬虫 版权声明: ...

- 【图文详解】scrapy爬虫与动态页面——爬取拉勾网职位信息(2)

上次挖了一个坑,今天终于填上了,还记得之前我们做的拉勾爬虫吗?那时我们实现了一页的爬取,今天让我们再接再厉,实现多页爬取,顺便实现职位和公司的关键词搜索功能. 之前的内容就不再介绍了,不熟悉的请一定要 ...

随机推荐

- 中间件解析FDMEMTABLE.delta生成SQL的方法

遍历Delta.DataView.Rows,Delta.DataView.Rows是记录的行集,由行组成 TFDDatSRow,即是一行记录的对象 TFDDatSRow的方法: GetData(), ...

- Swift: 转换NSString to String

如下代码获取一个String?的结果 let s = NSString(data: data, encoding: encoding) return s as? String

- centos忘了root用户密码

centos5.5启动时,按“空格”,到出现系统菜单GNU GRUB 第二步:按“e”进入编辑此GRUB界面 第三步:选择“rhgb quiet”此行,再按“e”进入编辑界面,在rhgb quiet后 ...

- 我的Android进阶之旅------>Android的ListView数据更新后,怎样使最新的条目能够自己主动滚动到可视范围内?

在ListView的layout配置中加入 android:transcriptMode="alwaysScroll" <ListView android:id=" ...

- poj 2559求柱形图中最大矩形

两种解法.当中一种是用单调栈. 我想到的是第二种:最大的矩形,中间一定有个最矮的某个单位矩形.所以求出每一个包括矩形histogram[i]的最大矩形的面积.输出这些面积中最大那个就可以. key:用 ...

- BAT 前端开发面经 —— 吐血总结 前端相关片段整理——持续更新 前端基础精简总结 Web Storage You don't know js

BAT 前端开发面经 —— 吐血总结 目录 1. Tencent 2. 阿里 3. 百度 更好阅读,请移步这里 聊之前 最近暑期实习招聘已经开始,个人目前参加了阿里的内推及腾讯和百度的实习生招聘, ...

- mac 下安装Anaconda Python

# 将anaconda的bin目录加入PATH echo 'export PATH="/Users/work/anaconda/bin/:$PATH"' >> ~/.b ...

- Android应用资源

Java刚開始学习的人直接在Java源代码使用"hello" 和123 类型的字符串和整型.但时间长了就会忘记当初定义的原因,有经验的或许会定义字符串常量ResultSet.TYP ...

- nodejs下cannot post错误

我写了一段CoffeeScript代码,主要是流程为: 1.当客户端请求方式为GET时,输出页面,页面上有个form,form 里有个submit按钮.form的 action="" ...

- tiny4412学习(三)之移植linux-4.x驱动(1)支持网卡驱动【转】

本文转载自:http://blog.csdn.net/fengyuwuzu0519/article/details/74160686 一.思路 上一节我们通过DNW将内核.文件系统.设备树文件烧入到内 ...