Python-爬虫-租房Ziroom

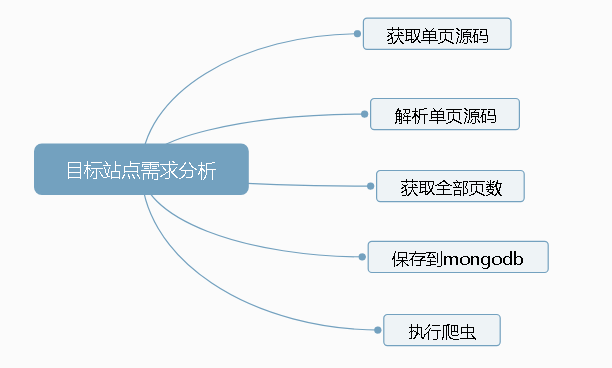

目标站点需求分析

涉及的库

import requests

import time

import pymongo

from lxml import etree

from requests.exceptions import RequestException

获取单页源码

def get_one_page(page):

'''获取单页源码'''

try:

url = "http://sh.ziroom.com/z/nl/z2.html?p=" + str(page)

print('url',url)

headers = {

'Referer':'http://sh.ziroom.com/',

'User-Agent':'Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/70.0.3538.77 Safari/537.36'

}

res = requests.get(url,headers=headers)

time.sleep(1)

if res.status_code == 200:

return res.text

return None

except RequestException:

return None

解析单页源码

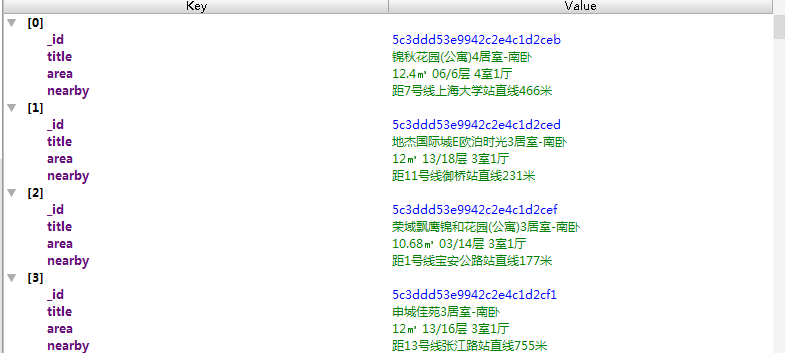

def parse_one_page(sourcehtml):

'''解析单页源码'''

contentTree = etree.HTML(sourcehtml) #解析源代码

results = contentTree.xpath('//ul[@id="houseList"]/li') #利用XPath提取相应内容

for result in results:

title = result.xpath("./div/h3/a/text()")[0][5:] if len(result.xpath("./div/h3/a/text()")[0]) > 0 else ""

area = " ".join(result.xpath("./div/div/p[1]/span/text()")).replace(" ", "", 1) # 使用join方法将列表中的内容以" "字符连接

nearby = result.xpath("./div/div/p[2]/span/text()")[0].strip() if len(result.xpath("./div/div/p[2]/span/text()"))>0 else ""

data = {

"title": title,

"area": area,

"nearby": nearby

}

print(data)

save_to_mongodb(data)

抓取总页数,保存到Mongobd中

def get_pages():

"""得到总页数"""

page = 1

html = get_one_page(page)

contentTree = etree.HTML(html)

pages = int(contentTree.xpath('//div[@class="pages"]/span[2]/text()')[0].strip("共页"))

return pages def save_to_mongodb(result):

"""存储到MongoDB中"""

# 创建数据库连接对象, 即连接到本地

client = pymongo.MongoClient(host="localhost")

# 指定数据库,这里指定ziroom和表名

db = client.iroomz

db_table = db.roominfo

try:

#插入到数据库

if db_table.insert(result):

print("抓取成功",result)

except Exception as reason:

print("抓取失败",reason)

def task():

pages = get_pages()

print('总共',pages)

for page in range(1,int(pages)+1):

html = get_one_page(page)

parse_one_page(html)

Python-爬虫-租房Ziroom的更多相关文章

- python 爬虫入门----案例爬取上海租房图片

前言 对于一个net开发这爬虫真真的以前没有写过.这段时间学习python爬虫,今天周末无聊写了一段代码爬取上海租房图片,其实很简短就是利用爬虫的第三方库Requests与BeautifulSoup. ...

- python爬虫项目(scrapy-redis分布式爬取房天下租房信息)

python爬虫scrapy项目(二) 爬取目标:房天下全国租房信息网站(起始url:http://zu.fang.com/cities.aspx) 爬取内容:城市:名字:出租方式:价格:户型:面积: ...

- python 爬虫入门案例----爬取某站上海租房图片

前言 对于一个net开发这爬虫真真的以前没有写过.这段时间开始学习python爬虫,今天周末无聊写了一段代码爬取上海租房图片,其实很简短就是利用爬虫的第三方库Requests与BeautifulSou ...

- Python爬虫(四)——开封市58同城数据模型训练与检测

前文参考: Python爬虫(一)——开封市58同城租房信息 Python爬虫(二)——对开封市58同城出租房数据进行分析 Python爬虫(三)——对豆瓣图书各模块评论数与评分图形化分析 数据的构建 ...

- Python爬虫之PyQuery使用(六)

Python爬虫之PyQuery使用 PyQuery简介 pyquery能够通过选择器精确定位 DOM 树中的目标并进行操作.pyquery相当于jQuery的python实现,可以用于解析HTML网 ...

- FocusBI: 使用Python爬虫为BI准备数据源(原创)

关注微信公众号:FocusBI 查看更多文章:加QQ群:808774277 获取学习资料和一起探讨问题. <商业智能教程>pdf下载地址 链接:https://pan.baidu.com/ ...

- 高德API+Python解决租房问题(.NET版)

源码地址:https://github.com/liguobao/58HouseSearch 在线地址:58公寓高德搜房(全国版):http://codelover.link:8080/ 周末闲着无事 ...

- Python爬虫:设置Cookie解决网站拦截并爬取蚂蚁短租

前言 文的文字及图片来源于网络,仅供学习.交流使用,不具有任何商业用途,版权归原作者所有,如有问题请及时联系我们以作处理. 作者: Eastmount PS:如有需要Python学习资料的小伙伴可以加 ...

- GitHub 上有哪些优秀的 Python 爬虫项目?

目录 GitHub 上有哪些优秀的 Python 爬虫项目? 大型爬虫项目: 实用型爬虫项目: 其它有趣的Python爬虫小项目: GitHub 上有哪些优秀的 Python 爬虫项目? 大型爬虫项目 ...

- Python爬虫系统化学习(5)

Python爬虫系统化学习(5) 多线程爬虫,在之前的网络编程中,我学习过多线程socket进行单服务器对多客户端的连接,通过使用多线程编程,可以大大提升爬虫的效率. Python多线程爬虫主要由三部 ...

随机推荐

- None.js 第三步 回调函数【阻塞代码--非阻塞代码】

阻塞代码实例 var fs = require("fs"); // 导入文件系统 file system var data = fs.readFileSync('input.txt ...

- Javaweb学习笔记——(十四)—————— 服务器端验证注册登入表单项目

项目:https://download.csdn.net/download/qq_40223688/10463436 项目 功能: *注册 *登录--------------------------- ...

- GCC编译器原理(一)------交叉编译器制作和GCC组件及命令

1.1 交叉编译器制作 默认安装的 GCC 编译系统所产生的代码适用于本机,即运行 GCC 的机器,但也可将 GCC 安装成能够生成其他的机器代码.安装一些必须的模块,就可产生多种目标机器代码,而且可 ...

- Intelij IDEA 内置 sql gui

IDEA 内置 自带 SQL GUI 最大意义 会自动识别 domain 对象与数据表的关系,也可以通过 Database 的数据表直接生成 domain 对象等等. 第一步 打开数据库视图 Vie ...

- tensorflow/core/kernels/conv_ops.cc:659] check failed: stream->parent()->getc

tensorflow版本与cudnn版本不对应,如tensorflow-gpu==1.1.0,cudnn==6.0 升级tensorflow-gpu到更高版本

- 状压DP初探·总结

2018过农历新年这几天,学了一下状态压缩动态规划,现在先总结一下. 状态压缩其实是一种并没有改变dp本质的优化方法,阶段还是要照分,状态还是老样子,决策依旧要做,转移方程还是得列,最优还是最优, ...

- bebugger调试理解commonJS原理

上面图片是bebugger一个导入的模块,使用vscode可以轻松的看到调用栈,通过断点调试进入断点 Mode函数的原型里面有一个require方法,函数里面有Module._load()加载模块,传 ...

- 「NowCoder Contest 295」H. Playing games

还是见的题太少了 「NowCoder Contest 295」H. Playing games 题意:选出尽量多的数使得异或和为$ 0$ $ Solution:$ 问题等价于选出尽量少的数使得异或和为 ...

- Realtime Multi-Person 2D Pose Estimation using Part Affinity Fields(翻译)

0 - Abstract 我们提出了一种方法去在一张图片中有效地识别多个人体的2D姿势.这个方法使用了一个无参数表示法,我们将其叫为Part Affinity Fields(PAFs),其是去在图片中 ...

- Thymeleaf引入公共片段方式

引入公共片段 引入公共片段的th属性,包括三种方式 th:insert 将公共片段,整个插入到声明引入的元素中 th:replace 将声明引入的元素,替换为公共片段 th:include 将被引入的 ...