C#最基本的小说爬虫

新手学习C#,自己折腾弄了个简单的小说爬虫,实现了把小说内容爬下来写入txt,还只能爬指定网站。

第一次搞爬虫,涉及到了网络协议,正则表达式,弄得手忙脚乱跑起来效率还差劲,慢慢改吧。

爬的目标:http://www.166xs.com/xiaoshuo/83/83557/

一、先写HttpWebRequest把网站扒下来

这里有几个坑,大概说下:

第一个就是记得弄个代理IP爬网站,第一次忘了弄代理然后ip就被封了。。。。。

第二个就是要判断网页是否压缩,第一次没弄结果各种转码gbk utf都是乱码。后面解压就好了。

/// <summary>

/// 抓取网页并转码

/// </summary>

/// <param name="url"></param>

/// <param name="post_parament"></param>

/// <returns></returns>

public string HttpGet(string url, string post_parament)

{

string html;

HttpWebRequest Web_Request = (HttpWebRequest)WebRequest.Create(url);

Web_Request.Timeout = ;

Web_Request.Method = "GET";

Web_Request.UserAgent = "Mozilla/4.0";

Web_Request.Headers.Add("Accept-Encoding", "gzip, deflate");

//Web_Request.Credentials = CredentialCache.DefaultCredentials; //设置代理属性WebProxy-------------------------------------------------

WebProxy proxy = new WebProxy("111.13.7.120", );

//在发起HTTP请求前将proxy赋值给HttpWebRequest的Proxy属性

Web_Request.Proxy = proxy; HttpWebResponse Web_Response = (HttpWebResponse)Web_Request.GetResponse(); if (Web_Response.ContentEncoding.ToLower() == "gzip") // 如果使用了GZip则先解压

{

using (Stream Stream_Receive = Web_Response.GetResponseStream())

{

using (var Zip_Stream = new GZipStream(Stream_Receive, CompressionMode.Decompress))

{

using (StreamReader Stream_Reader = new StreamReader(Zip_Stream, Encoding.Default))

{

html = Stream_Reader.ReadToEnd();

}

}

}

}

else

{

using (Stream Stream_Receive = Web_Response.GetResponseStream())

{

using (StreamReader Stream_Reader = new StreamReader(Stream_Receive, Encoding.Default))

{

html = Stream_Reader.ReadToEnd();

}

}

} return html;

}

二、下面就是用正则处理内容了,由于正则表达式不熟悉所以重复动作太多。

1.先获取网页内容

IWebHttpRepository webHttpRepository = new WebHttpRepository();

string html = webHttpRepository.HttpGet(Url_Txt.Text, "");

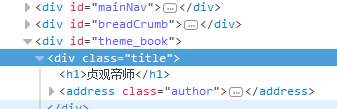

2.获取书名和文章列表

书名

文章列表

string Novel_Name = Regex.Match(html, @"(?<=<h1>)([\S\s]*?)(?=</h1>)").Value; //获取书名

Regex Regex_Menu = new Regex(@"(?is)(?<=<dl class=""book_list"">).+?(?=</dl>)");

string Result_Menu = Regex_Menu.Match(html).Value; //获取列表内容

Regex Regex_List = new Regex(@"(?is)(?<=<dd>).+?(?=</dd>)");

var Result_List = Regex_List.Matches(Result_Menu); //获取列表集合

3.因为章节列表前面有多余的<dd>,所以要剔除

int i = ; //计数

string Menu_Content = ""; //所有章节

foreach (var x in Result_List)

{

if (i < )

{

//前面五个都不是章节列表,所以剔除

}

else

{

Menu_Content += x.ToString();

}

i++;

}

4.然后获取<a>的href和innerHTML,然后遍历访问获得内容和章节名称并处理,然后写入txt

Regex Regex_Href = new Regex(@"(?is)<a[^>]*?href=(['""]?)(?<url>[^'""\s>]+)\1[^>]*>(?<text>(?:(?!</?a\b).)*)</a>");

MatchCollection Result_Match_List = Regex_Href.Matches(Menu_Content); //获取href链接和a标签 innerHTML string Novel_Path = Directory.GetCurrentDirectory() + "\\Novel\\" + Novel_Name + ".txt"; //小说地址

File.Create(Novel_Path).Close();

StreamWriter Write_Content = new StreamWriter(Novel_Path); foreach (Match Result_Single in Result_Match_List)

{

string Url_Text = Result_Single.Groups["url"].Value;

string Content_Text = Result_Single.Groups["text"].Value; string Content_Html = webHttpRepository.HttpGet(Url_Txt.Text + Url_Text, "");//获取内容页 Regex Rege_Content = new Regex(@"(?is)(?<=<p class=""Book_Text"">).+?(?=</p>)");

string Result_Content = Rege_Content.Match(Content_Html).Value; //获取文章内容 Regex Regex_Main = new Regex(@"( )(.*)");

string Rsult_Main = Regex_Main.Match(Result_Content).Value; //正文

string Screen_Content = Rsult_Main.Replace(" ", "").Replace("<br />", "\r\n"); Write_Content.WriteLine(Content_Text + "\r\n");//写入标题

Write_Content.WriteLine(Screen_Content);//写入内容

} Write_Content.Dispose();

Write_Content.Close();

MessageBox.Show(Novel_Name+".txt 创建成功!");

System.Diagnostics.Process.Start(Directory.GetCurrentDirectory() + "\\Novel\\");

三、小说写入成功

C#最基本的小说爬虫的更多相关文章

- 使用scrapy制作的小说爬虫

使用scrapy制作的小说爬虫 爬虫配套的django网站 https://www.zybuluo.com/xuemy268/note/63660 首先是安装scrapy,在Windows下的安装比 ...

- Scrapy - 小说爬虫

实例解析 - 小说爬虫 页面分析 共有三级页面 一级页面 大目录 二级页面 章节目录 三级界面 章节内容 爬取准备 一级界面 http://www.daomubiji.com/ 二级页面xpath 直 ...

- python基础爬虫,翻译爬虫,小说爬虫

基础爬虫: # -*- coding: utf-8 -*- import requests url = 'https://www.baidu.com' # 注释1 headers = { # 注释2 ...

- Node.js 实现简单小说爬虫

最近因为剧荒,老大追了爱奇艺的一部网剧,由丁墨的同名小说<美人为馅>改编,目前已经放出两季,虽然整部剧槽点满满,但是老大看得不亦乐乎,并且在看完第二季之后跟我要小说资源,直接要奔原著去看结 ...

- 使用python书写的小说爬虫

1.写了一个简单的网络爬虫 初期1 (后期将会继续完善) #小说的爬取 import requests import random from bs4 import BeautifulSoup base ...

- 基于nodeJS的小说爬虫实战

背景与需求分析 最近迷恋于王者荣耀.斗鱼直播与B站吃播视频,中毒太深,下班之后无心看书. 为了摆脱现状,能习惯看书,我开始看小说了,然而小说网站广告多而烦,屌丝心态不愿充钱,于是想到了爬虫. 功能分析 ...

- 【Python】我的第一个完整的小说爬虫

写在开头 纪念我的第一个爬虫程序,一共写了三个白天,其中有两个上午没有看,中途遇到了各种奇怪的问题,伴随着他们的解决,对于一些基本的操作也弄清楚了.果然,对于这些东西的最号的学习方式,就是在使用中学习 ...

- python写的有声小说爬虫

querybook.py from bs4 import BeautifulSoup from lxml import html import xml import requests import s ...

- python爬虫之小说网站--下载小说(正则表达式)

python爬虫之小说网站--下载小说(正则表达式) 思路: 1.找到要下载的小说首页,打开网页源代码进行分析(例:https://www.kanunu8.com/files/old/2011/244 ...

随机推荐

- class对象详解

我们知道,对于java语言,我们一般先写一个类对象,表示对某一类对象概述,其中包括属性,方法等.我们在对类对象编译时,会产生一个.class对象,jvm在加载类对象时,是加载.class 对象文件,我 ...

- Nginx + Memcached 实现Session共享的负载均衡

session共享 我们在做站点的试试,通常需要保存用户的一些基本信息,比如登录就会用到Session:当使用Nginx做负载均衡的时候,用户浏览站点的时候会被分配到不同的服务器上,此时如果登录后Se ...

- shell变量$(CURDIR),$0,$1,$2,$#含义解释

$(CURDIR): CURDIR是make的内嵌变量, 为当前目录 实例 SRCTREE := $(CURDIR) *$(CURDIR)为当前目录,相当于SRCTREE=./ MKCONFIG ...

- NHibernate教程(12)--延迟加载

本节内容 引入 延迟加载 实例分析 1.一对多关系实例 2.多对多关系实例 结语 引入 通过前面文章的分析,我们知道了如何使用NHibernate,比如CRUD操作.事务.一对多.多对多映射等问题,这 ...

- mac环境下安装mysql

一,下载mysql 官网"Community " 下会看到"MySQL Community Server"下方有一个"download"点击 ...

- 团队作业6——展示博客(Alpha)

一.团队简介 李永豪(PM):项目经理,后台开发人员,协调团队内部的工作及开发团队之间的工作 杨海亮:后台开发人员,测试人员,熟悉java语言,编写java代码 郑靖涛:后台开发人员,测试人员,安卓程 ...

- 201521123069 《Java程序设计》 第8周学习总结

1. 本周学习总结 1.1 以你喜欢的方式(思维导图或其他)归纳总结集合与泛型相关内容. 1.2 选做:收集你认为有用的代码片段 (1)泛型允许指定集合中元素的类型,在编译时就可以进行类型检查,避免运 ...

- 201521123005《java程序设计》第五周学习总结

1. 本周学习总结 1.1 尝试使用思维导图总结有关多态与接口的知识点. 1.2 可选:使用常规方法总结其他上课内容. 接口 有点类似继承中父类与子类的关系 方法声明和常量值的集合 对行为的抽象 一种 ...

- 201521123004《Java程序设计》第4周学习总结

1. 本周学习总结 1.1 尝试使用思维导图总结有关继承的知识点. 1.2 使用常规方法总结其他上课内容. 本周主要内容为: 继承:extends 抽取共同特征(行为与属性) 复用代码 继承时子类将获 ...

- 201521123040《Java程序设计》第4周学习总结

1. 本周学习总结 1.1 尝试使用思维导图总结有关继承的知识点. 1.2 使用常规方法总结其他上课内容. 本周学习了类的继承,包括子类父类的概念还有extends关键字,super关键字.继承与代码 ...