【二】Spark 核心

spark 核心

spark core

RDD创建 >>> RDD转换 >>> RDD缓存 >>> RDD行动 >>> RDD输出

RDD[Resilient Distributed Dataset]

它是一个弹性分布式数据集,具有良好的通用性、容错性与并行处理数据的能力,为用户屏蔽了底层对数据的复杂抽象和处理,为用户提供了一组方便的数据转换与求值方法。

弹性

- 存储弹性:n内存与磁盘d额自动切换

- 容错弹性:数据丢失可以自动恢复

- j计算的弹性:计算出错重试机制

- 分片弹性:根据需要重新分片

容错

通常在不同机器上备份数据或者记录数据更新的方式完成容错,但这种对任务密集型任务代价很高

RDD采用数据应用变换(map,filter,join),若部分数据丢失,RDD拥有足够的信息得知这部分数据是如何计算得到的,可通过重新计算来得到丢失的数据

这种恢复数据方法很快,无需大量数据复制操作,可以认为Spark是基于RDD模型的系统

懒操作

- 延迟计算,action的时候才操作

瞬时性

- 用时才产生,用完就释放

Spark允许从以下四个方面构建RDD

- 从共享文件系统中获取,如从HDFS中读数据构建RDD

val RDD = sc.textFile(“/xxx/yyy/file”)

- 通过现有RDD转换得到

val RDD = a.map(x => (x, 1))

- 定义一个scala数组

val RDD = sc.parallelize(1 to 10, 1)

- 有一个已经存在的RDD通过持久化操作生成

val RDD = a.persist(), a. saveAsHadoopFile(“/xxx/yyy/zzz”)

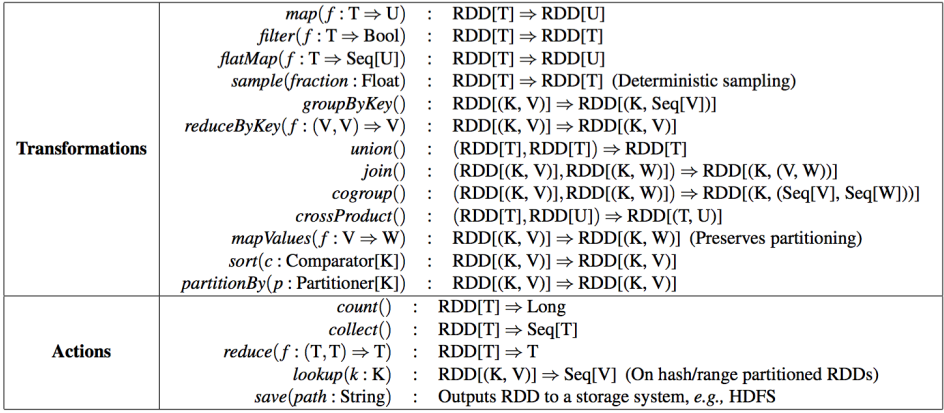

Spark针对RDD提供两类操作:transformations和action

transformations是RDD之间的变换,action会对数据执行一定的操作

transformations采用懒策略,仅在对相关RDD进行action提交时才触发计算

每个RDD包含了数据分块/分区(partition)的集合,每个partition是不可分割的

实际数据块的描述(实际数据到底存在哪,或者不存在)

其值依赖于哪些partition

与父RDD的依赖关系(rddA=>rddB)

宽依赖:B的每个partition依赖于A的所有partition

- 比如groupByKey、 reduceByKey、 join……,由A产生B时会先对A做shuffle分桶

窄依赖: B的每个partition依赖于A的常数个partition

- 比如map、 filter、 union……

RDD 依赖关系

窄依赖

每一个父RDD的Partition最多被子RDD的一个Partition使用

宽依赖

多个RDD的partition会依赖同一个父RDD的partition,会引起shuffle

【二】Spark 核心的更多相关文章

- spark浅谈(2):SPARK核心编程

一.SPARK-CORE 1.spark核心模块是整个项目的基础.提供了分布式的任务分发,调度以及基本的IO功能,Spark使用基础的数据结构,叫做RDD(弹性分布式数据集),是一个逻辑的数据分区的集 ...

- Spark核心—RDD初探

本文目的 最近在使用Spark进行数据清理的相关工作,初次使用Spark时,遇到了一些挑(da)战(ken).感觉需要记录点什么,才对得起自己.下面的内容主要是关于Spark核心-RDD的相关 ...

- Spark 核心篇-SparkContext

本章内容: 1.功能描述 本篇文章就要根据源码分析SparkContext所做的一些事情,用过Spark的开发者都知道SparkContext是编写Spark程序用到的第一个类,足以说明SparkCo ...

- Spark 核心篇-SparkEnv

本章内容: 1.功能概述 SparkEnv是Spark的执行环境对象,其中包括与众多Executor执行相关的对象.Spark 对任务的计算都依托于 Executor 的能力,所有的 Executor ...

- Netty 源码 Channel(二)核心类

Netty 源码 Channel(二)核心类 Netty 系列目录(https://www.cnblogs.com/binarylei/p/10117436.html) 一.Channel 类图 二. ...

- 科普Spark,Spark核心是什么,如何使用Spark(1)

科普Spark,Spark是什么,如何使用Spark(1)转自:http://www.aboutyun.com/thread-6849-1-1.html 阅读本文章可以带着下面问题:1.Spark基于 ...

- 2017.3.31 spring mvc教程(二)核心流程及配置详解

学习的博客:http://elf8848.iteye.com/blog/875830/ 我项目中所用的版本:4.2.0.博客的时间比较早,11年的,学习的是Spring3 MVC.不知道版本上有没有变 ...

- 大数据体系概览Spark、Spark核心原理、架构原理、Spark特点

大数据体系概览Spark.Spark核心原理.架构原理.Spark特点 大数据体系概览(Spark的地位) 什么是Spark? Spark整体架构 Spark的特点 Spark核心原理 Spark架构 ...

- spark核心优化详解

大家好!转眼又到了经验分享的时间了.吼吼,我这里没有摘要也没有引言,只有单纯的经验分享,请见谅哦! 言归正传,目前在大数据领域能够提供的核心计算的工具,如离线计算hadoop生态圈的mr计算模型,以及 ...

随机推荐

- 用setTimeout实现动态时钟的效果

1.获取到系统时间 2.获取到当地时间字符串 3.开启延时器,每一秒刷新一次时间 <!DOCTYPE html> <html> <head> <meta ch ...

- 乘风破浪:LeetCode真题_012_Integer to Roman

乘风破浪:LeetCode真题_012_Integer to Roman 一.前言 经过了前面的思维训练,我们在某些方面有了一定的提高,但是对于实际的问题,要在短时间内得到答案,还是需要我们多多的练习 ...

- 乘风破浪:LeetCode真题_010_Regular Expression Matching

乘风破浪:LeetCode真题_010_Regular Expression Matching 一.前言 关于正则表达式我们使用得非常多,但是如果让我们自己写一个,却是有非常大的困难的,我们可能想到状 ...

- composer随笔

composer dump-autoload 生成autoload.php文件

- January 13 2017 Week 2 Friday

Those who turn back never reach the summit. 回头的人永远也到不了顶峰. I always turned back on my life road, so i ...

- jquery ui tabs(选项卡)插件

参考文档:http://www.css88.com/jquery-ui-api/tabs/ html代码: <div id="tabs"> <ul> < ...

- Python中根据提供的日期,返回是一年中的第几天

# coding = utf-8 import datetime dd = raw_input("Please enter date , format is YYYYMMDD:") ...

- 安卓原生与hml交互(WebView基础)

WebView加载页面 webView有两种加载方式, 加载网络地址 webView.loadUrl("www.xxx.com/index.html"); 加载本地资源 webVi ...

- JavaScript的事件的处理函数(鼠标,键盘,HTML)

事件处理函数概述 JavaScript 可以处理的事件类型为:鼠标事件.键盘事件.HTML 事件 所有的事件处理函数都会都有两个部分组成,on + 事件名称,例如 click 事件的事件处理函数就是: ...

- curl 抓取页面信息

<?php // 1. 初始化 $ch = curl_init(); // 2. 设置选项,包括URL curl_setopt($ch, CURLOPT_URL, "www" ...