莫烦pytorch学习笔记(一)——torch or numpy

Q1:什么是神经网络?

Q2:torch vs numpy

Q3:numpy和Torch的转换

Q3 torch中的数学运算

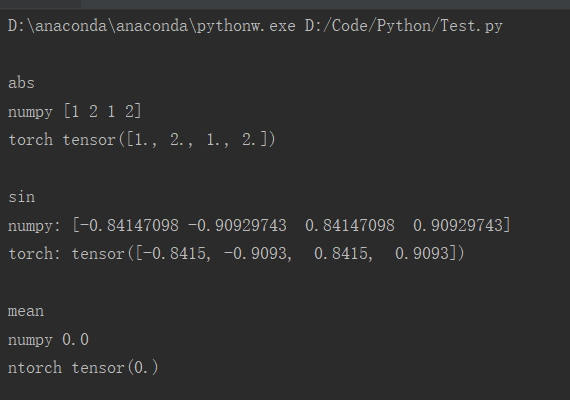

torch中的tensor运算和numpy的array运算很相似,具体参看下面的代码

import torch

import numpy as np data=[-,-,,]

tensor=torch.FloatTensor(data)# 转换成32位浮点 tensor

print(

'\nabs',

'\nnumpy',np.abs(data),# [ ]

'\ntorch',torch.abs(tensor) # torch tensor([., ., ., .])

)

print(

'\nsin',

'\nnumpy:',np.sin(data), # [-0.84147098 -0.90929743 0.84147098 0.90929743]

'\ntorch:',torch.sin(tensor)# [-0.8415 -0.9093 0.8415 0.9093]

)

print(

'\nmean',

'\nnumpy',np.mean(data),

'\ntorch',torch.mean(tensor)

)

当然还有其他各种运算,自己去尝试吧。

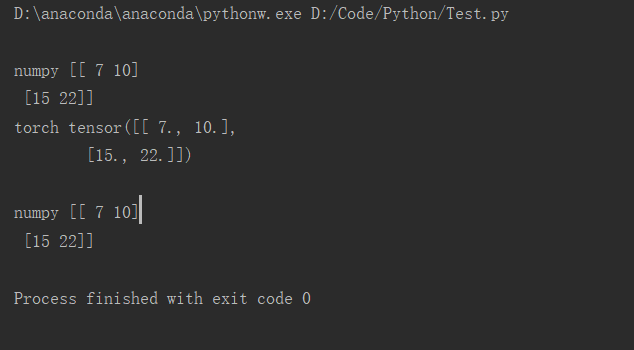

Q4:2.2 numpy和torch的矩阵乘法还是有点不同的,下面将对其区别进行展示:

import torch

import numpy as np

data=[[,],[,]]

tensor=torch.FloatTensor(data)

print(

'\nnumpy',np.matmul(data,data), # [[, ], [, ]]

'\ntorch',torch.mm(tensor,tensor)# [[, ], [, ]]

)

data=np.array(data)

print(

'\nnumpy',data.dot(data), # [[, ], [, ]] 在numpy 中可行,进行的是叉乘

#'\ntorch: ', tensor.dot(tensor) # 报错 )

莫烦pytorch学习笔记(一)——torch or numpy的更多相关文章

- 莫烦pytorch学习笔记(八)——卷积神经网络(手写数字识别实现)

莫烦视频网址 这个代码实现了预测和可视化 import os # third-party library import torch import torch.nn as nn import torch ...

- 莫烦pytorch学习笔记(七)——Optimizer优化器

各种优化器的比较 莫烦的对各种优化通俗理解的视频 import torch import torch.utils.data as Data import torch.nn.functional as ...

- 莫烦PyTorch学习笔记(五)——模型的存取

import torch from torch.autograd import Variable import matplotlib.pyplot as plt torch.manual_seed() ...

- 莫烦PyTorch学习笔记(六)——批处理

1.要点 Torch 中提供了一种帮你整理你的数据结构的好东西, 叫做 DataLoader, 我们能用它来包装自己的数据, 进行批训练. 而且批训练可以有很多种途径. 2.DataLoader Da ...

- 莫烦pytorch学习笔记(二)——variable

.简介 torch.autograd.Variable是Autograd的核心类,它封装了Tensor,并整合了反向传播的相关实现 Variable和tensor的区别和联系 Variable是篮子, ...

- 莫烦PyTorch学习笔记(五)——分类

import torch from torch.autograd import Variable import torch.nn.functional as F import matplotlib.p ...

- 莫烦PyTorch学习笔记(四)——回归

下面的代码说明个整个神经网络模拟回归的过程,代码含有详细注释,直接贴下来了 import torch from torch.autograd import Variable import torch. ...

- 莫烦PyTorch学习笔记(三)——激励函数

1. sigmod函数 函数公式和图表如下图 在sigmod函数中我们可以看到,其输出是在(0,1)这个开区间内,这点很有意思,可以联想到概率,但是严格意义上讲,不要当成概率.sigmod函数 ...

- 莫烦 - Pytorch学习笔记 [ 二 ] CNN ( 1 )

CNN原理和结构 观点提出 关于照片的三种观点引出了CNN的作用. 局部性:某一特征只出现在一张image的局部位置中. 相同性: 同一特征重复出现.例如鸟的羽毛. 不变性:subsampling下图 ...

随机推荐

- PAT_A1053#Path of Equal Weight

Source: PAT A1053 Path of Equal Weight (30 分) Description: Given a non-empty tree with root R, and w ...

- PAT_A1043#Is It a Binary Search Tree

Source: PAT A1043 Is It a Binary Search Tree (25 分) Description: A Binary Search Tree (BST) is recur ...

- org.apache.jasper.JasperException: Unable to compile class for JSP: Invalid character constant

这里不能用单引号,只能为双引号 request.setCharacterEncoding('gb2312'); String user = request.getParameter(" ...

- GenericServlet简介和使用

GenericServlet:抽象类 是Servlet接口的抽象类,为Servlet接口中的一些方法做了空实现,只将service()方法作为抽象方法 Servlet代码实现GenericServle ...

- java_函数式编程写法

package cn.aikang.Test; import org.junit.Test; import java.util.Scanner; import java.util.function.S ...

- Leetcode211. Add and Search Word - Data structure design 添加与搜索单词 - 数据结构设计

设计一个支持以下两种操作的数据结构: void addWord(word) bool search(word) search(word) 可以搜索文字或正则表达式字符串,字符串只包含字母 . 或 a- ...

- zepto(mark)

Zepto的设计目的是提供 jQuery 的类似的API,但并不是100%覆盖 jQuery .Zepto设计的目的是有一个5-10k的通用库.下载并快速执行.有一个熟悉通用的API,所以你能把你主要 ...

- Spring知识点整理

1.bean什么时候被实例化 第一:如果你使用BeanFactory作为Spring Bean的工厂类,则所有的bean都是在第一次使用该Bean的时候实例化第二:如果你使用ApplicationCo ...

- QT安装以及使用(QT支持linux和windows,也支持C/C++代码的编译运行,比vs简洁多)

Windows: 0. QT Versionqt-win-opensource-4.7.4-mingwqt-creator-win-opensource-2.4.1 1. 系统Windows 7 &a ...

- CSS W3C统一验证工具

CssStats 是一个在线的 CSS 代码分析工具 网址是: http://www.cssstats.com/ 如果你想要更全面的,这个神奇,你值得拥有: W3C 统一验证工具: http://v ...