MapReduce框架原理-OutputFormat工作原理

OutputFormat概述

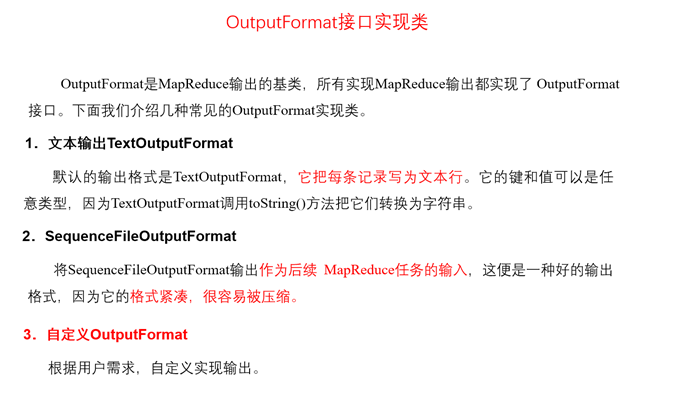

OutputFormat主要是用来指定MR程序的最终的输出数据格式 。

默认使用的是TextOutputFormat,默认是将数据一行写一条数据,并且把数据放到指定的输出目录下,以 part-r-xxxxx数字开头。并且默认情况下有几个ReduceTask就有几个结果文件产生

自定义OutputFormat

自定义OutputFormat的详细流程:

- 定义MyOutputFormat继承FileOutputFormat<T>,泛型传入的是Reducer的输出类型

- 重写里面的getRecordWriter()方法,这个方法需要返回一个RecordWriter对象。

这个方法里面定义了最终文件输出到什么地方

- 创建一个RecordWriter对象,继承RecordWriter<T>,重写里面的两个方法:write()、close()。其中write()方法中需要定义想要将文件输出到什么地方去,在这个方法中定义输出数据地址和输出数据格式

- 在Driver中通过job.setOutputFormatClass()指定我们使用的是哪个OutputFormat实现类

【注意】如果设置了分区,并且指定了ReduceTask的数量,那么根据以前所学的有多少个ReduceTask就会生成多少个结果文件,是因为默认使用的是TextOutputFormat实现类,这个实现类就是几个ReduceTask就有几个结果文件。但是如果我们自定义了OutputFormat,那么结果文件只有我们指明的地址,没有其他。

案例实操

案例一:存储数据到MySQL中

需求:将手机流量数据根据总流向升序输出到MySQL数据库中

代码:

- FlowOutputInformat.java

public class FlowOutputFormat extends FileOutputFormat<FlowBean, NullWritable> {

@Override

public RecordWriter<FlowBean, NullWritable> getRecordWriter(TaskAttemptContext taskAttemptContext) throws IOException, InterruptedException {

return new MyRecordWriter();

}

} - MyRecordWriter.java

public class MyRecordWriter extends RecordWriter<FlowBean, NullWritable> {

/**

* 需要在这个方法中定义输出格式、输出数据地址

* @param flowBean:Reduce阶段输出数据Key值

* @param nullWritable:Reduce阶段输出value值

*/

@SneakyThrows

@Override

public void write(FlowBean flowBean, NullWritable nullWritable) throws IOException, InterruptedException {

Connection connection = DriverManager.getConnection("jdbc:mysql://localhost:3306/sx_bigdata?serverTimezone=UTC", "root", "root");

PreparedStatement preparedStatement = connection.prepareStatement("insert into phone_flow values (?, ?, ?, ?)");

preparedStatement.setString(1, flowBean.getPhone());

preparedStatement.setInt(2, flowBean.getUpFlow());

preparedStatement.setInt(3, flowBean.getDownFlow());

preparedStatement.setInt(4, flowBean.getSumFlow());

int i = preparedStatement.executeUpdate();

if (i > 0) {

System.out.println("添加成功!");

} else {

System.out.println("添加失败!");

}

connection.close();

preparedStatement.close();

} @Override

public void close(TaskAttemptContext taskAttemptContext) throws IOException, InterruptedException { } - FlowDriver.java

job.setOutputFormatClass(FlowOutputFormat.class);

案例二:存储数据到HDFS本地指定文件夹中

需求:将单词计数案例结果输出到本地,其中首字母为大写字母存储在/upper.txt目录下,首字母为小写字母存储在/lower.txt目录下

代码:

- MyOutputFormat.java

public class MyOutputFormat extends FileOutputFormat<Text, LongWritable> {

@SneakyThrows

@Override

public RecordWriter getRecordWriter(TaskAttemptContext taskAttemptContext) throws IOException, InterruptedException {

return new MyRecordWriter(taskAttemptContext);

}

} - MyRecordWriter.java

public class MyRecordWriter extends RecordWriter<Text, LongWritable> {

FSDataOutputStream fsDataOutputStream1;

FSDataOutputStream fsDataOutputStream2;

public MyRecordWriter(TaskAttemptContext taskAttemptContext) throws Exception {

Configuration configuration = taskAttemptContext.getConfiguration();

FileSystem fs = FileSystem.get(new URI("hdfs://192.168.218.55:9000"), configuration, "root");

Path out1 = new Path("/test/school/upper.txt");

Path out2 = new Path("/test/school/lower.txt");

if (fs.exists(out1)) {

fs.delete(out1, true);

}

if (fs.exists(out2)) {

fs.delete(out2, true);

}

fsDataOutputStream1 = fs.create(out1);

fsDataOutputStream2 = fs.create(out2);

} @Override

public void write(Text text, LongWritable longWritable) throws IOException, InterruptedException {

char firstWord = text.toString().charAt(0);

String line = text + "\t" + longWritable.get() + "\r\n";

if (Character.isUpperCase(firstWord)) {

fsDataOutputStream1.write(line.getBytes());

} else {

fsDataOutputStream2.write(line.getBytes());

}

} @Override

public void close(TaskAttemptContext taskAttemptContext) throws IOException, InterruptedException {

if (fsDataOutputStream1 != null) {

fsDataOutputStream1.close();

}

if (fsDataOutputStream2 != null) {

fsDataOutputStream2.close();

}

}

} - FlowDriver.java

job.setOutputFormatClass(MyOutputFormat.class);

MapReduce框架原理-OutputFormat工作原理的更多相关文章

- MapReduce作业的工作原理

在Hadoop中,我们可以通过Job对象的submit()方法来运行MapReduce作业,也可以调用waitForCompletion()用于提交以前没有提交过的作业,并等待它的完成.其中,subm ...

- Hadoop(20)-MapReduce框架原理-OutputFormat

1.outputFormat接口实现类 2.自定义outputFormat 步骤: 1). 定义一个类继承FileOutputFormat 2). 定义一个类继承RecordWrite,重写write ...

- MapReduce框架原理-MapTask工作机制

MapReduce框架原理-MapTask工作机制 作者:尹正杰 版权声明:原创作品,谢绝转载!否则将追究法律责任. maptask的并行度决定map阶段的任务处理并发度,进而影响到整个job的处理速 ...

- MapReduce的工作原理

MapReduce简介 MapReduce是一种并行可扩展计算模型,并且有较好的容错性,主要解决海量离线数据的批处理.实现下面目标 ★ 易于编程 ★ 良好的扩展性 ★ 高容错性 MapReduce ...

- MapReduce 1工作原理图文详解

MapReduce工作原理图文详解 一 MapReduce程序执行流程 程序执行流程图如下: 流程分析:1.在客户端启动一个作业.2.向JobTracker请求一个Job ID.3.将运行作业所需要的 ...

- MapReduce工作原理详解

文章概览: 1.MapReduce简介 2.MapReduce有哪些角色?各自的作用是什么? 3.MapReduce程序执行流程 4.MapReduce工作原理 5.MapReduce中Shuffle ...

- MapReduce工作原理图文详解

目录:1.MapReduce作业运行流程2.Map.Reduce任务中Shuffle和排序的过程 1.MapReduce作业运行流程 流程示意图: 流程分析: 1.在客户端启动一个作业. 2.向Job ...

- MapReduce工作原理讲解

第一部分:MapReduce工作原理 MapReduce 角色•Client :作业提交发起者.•JobTracker: 初始化作业,分配作业,与TaskTracker通信,协调整个作业.•TaskT ...

- MapReduce工作原理

第一部分:MapReduce工作原理 MapReduce 角色•Client :作业提交发起者.•JobTracker: 初始化作业,分配作业,与TaskTracker通信,协调整个作业.•Tas ...

随机推荐

- SpringBoot缓存管理(一) 默认缓存管理

前言 Spring框架支持透明地向应用程序添加缓存对缓存进行管理,其管理缓存的核心是将缓存应用于操作数据的方法(包括增删查改等),从而减少操作数据的执行次数(主要是查询,直接从缓存中读取数据),同时不 ...

- 如何优雅地实现浏览器兼容与CSS规则回退

读完了<Visual Studio Code权威指南>,前端方面书籍不能停,于是捡起「CSS一姐」 Lea Verou 的<CSS魔法>. 我们没法控制用户使用新版本还是老版本 ...

- 33、jQuery介绍

33.1.jQuery是什么: (1)jQuery由John Resig创建,至今已吸引了来自世界各地的众多 javascript 高手加入其team. (2)jQuery是继prototype之后又 ...

- SpringCloud微服务(基于Eureka+Feign+Hystrix+Zuul)

一.搭建注册中心 1.1.创建一个cloud-service项目 1.2:POM文件依赖 1 <?xml version="1.0" encoding="UTF-8 ...

- 使用了gitlab管理pipeline,Jenkinsfile 中在出现克隆命令流水线执行会混乱

Jenkins_pipeline关闭默认检出 问题描述 在使用 Pipeline(流水线)过程中,如果使用了(Pipeline script from SCM)远程 Git 的 Jenkinsfile ...

- Mysql 中字符串的截取

一.从左开始截取字符串 用法:left(str, length),即:left(被截取字符串, 截取长度) mysql> SELECT LEFT('hello,world',3); +----- ...

- MySQL 中的转义字符`

` 是 MySQL 的转义符,用来避免列名或者表名和 mysql 本身的关键字冲突. 所有的数据库都有类似的设置,不过mysql用的是`而已.通常用来说明其中的内容是数据库名.表名.字段名,不是关键字 ...

- leetcode147对链表进行插入排序

题目: 对链表进行插入排序. 插入排序算法: 插入排序是迭代的,每次只移动一个元素,直到所有元素可以形成一个有序的输出列表. 每次迭代中,插入排序只从输入数据中移除一个待排序的元素,找到它在序列中适当 ...

- 入门Kubernetes-Service

一.前言 前一篇文章通过 Deployment 实现了Pod中服务实现滚动更新/回滚等操作:在真实应用场景中,需要将一组Pod提供给外部访问.而且Pod生命周期是短暂的,在 Pod 的生命周期过程中, ...

- Luogu P2754 星际转移问题

Luogu P2754 星际转移问题 思路 首先,对于地球能否到达月球的问题,考虑使用并查集维护. 对于每艘飞船能够到达的站点,放进一个集合里,若两艘飞船的集合有交集,那么就合并两个集合,最后只要地球 ...