Spark学习进度-Transformation算子

Transformation算子

intersection

交集

/*

交集

*/

@Test

def intersection(): Unit ={

val rdd1=sc.parallelize(Seq(1,2,3,4,5))

val rdd2=sc.parallelize(Seq(3,4,5,6,7))

rdd1.intersection(rdd2)

.collect()

.foreach(println(_))

}

union

并集

/*

并集

*/

@Test

def union(): Unit ={

val rdd1=sc.parallelize(Seq(1,2,3,4,5))

val rdd2=sc.parallelize(Seq(3,4,5,6,7))

rdd1.union(rdd2)

.collect()

.foreach(println(_))

}

subtract

差集

@Test

def subtract(): Unit ={

val rdd1=sc.parallelize(Seq(1,2,3,4,5))

val rdd2=sc.parallelize(Seq(3,4,5,6,7))

rdd1.subtract(rdd2)

.collect()

.foreach(println(_))

}

输出:

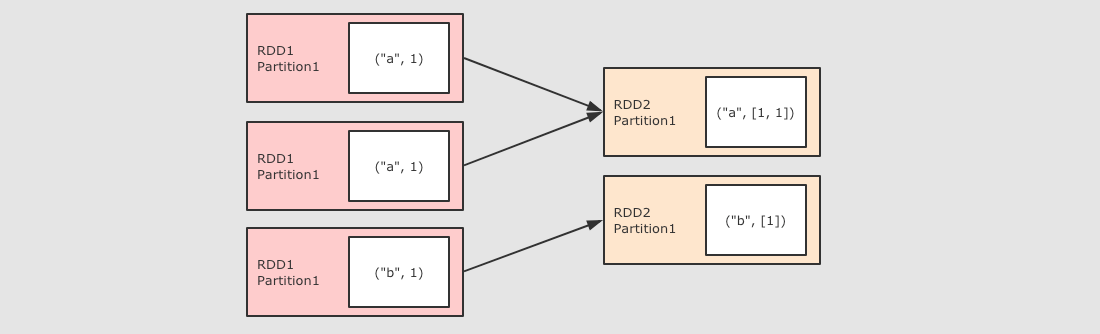

groupByKey

作用

GroupByKey 算子的主要作用是按照 Key 分组, 和 ReduceByKey 有点类似, 但是 GroupByKey 并不求聚合, 只是列举 Key 对应的所有 Value

/*

groupByKey 运算结果的格式:(K,(value1,value2))

reduceByKey 能否在Map端做Combiner

*/ @Test

def groupByKey(): Unit ={

sc.parallelize(Seq(("a",1),("a",1),("b",1)))

.groupByKey()

.collect()

.foreach(println(_))

}

distinct

作用:用于去重

@Test

def distinct(): Unit ={

sc.parallelize(Seq(1,1,2,2,3))

.distinct()

.collect()

.foreach(println(_))

}

输出:1,2,3

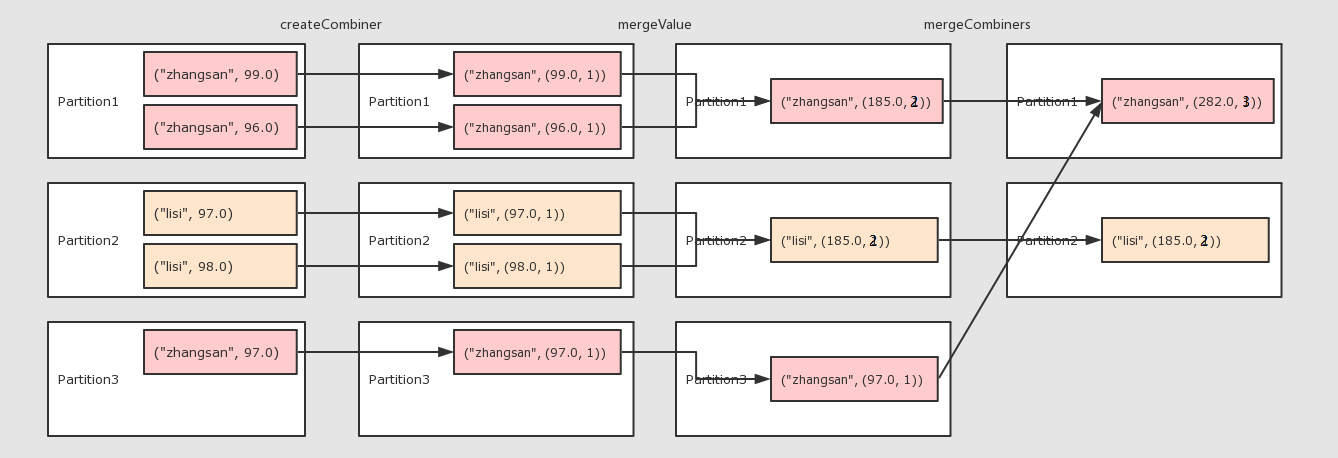

combineByKey

作用

对数据集按照 Key 进行聚合

调用

combineByKey(createCombiner, mergeValue, mergeCombiners, [partitioner], [mapSideCombiner], [serializer])

参数

createCombiner将 Value 进行初步转换mergeValue在每个分区把上一步转换的结果聚合mergeCombiners在所有分区上把每个分区的聚合结果聚合partitioner可选, 分区函数mapSideCombiner可选, 是否在 Map 端 Combineserializer序列化器

例子:算个人得分的平均值

@Test

def combineByKey(): Unit ={

var rdd=sc.parallelize(Seq(

("zhangsan", 99.0),

("zhangsan", 96.0),

("lisi", 97.0),

("lisi", 98.0),

("zhangsan", 97.0)

)) //2.算子运算

// 2.1 createCombiner 转换数据

// 2.2 mergeValue 分区上的聚合

// 2.3 mergeCombiners 把所有分区上的结果再次聚合,生成最终结果

val combineResult = rdd.combineByKey(

createCombiner = (curr: Double) => (curr, 1),

mergeValue = (curr: (Double, Int), nextValue: Double) => (curr._1 + nextValue, curr._2 + 1),

mergeCombiners = (curr: (Double, Int), agg: (Double, Int)) => (curr._1 + agg._1, curr._2 + agg._2)

) val resultRDD = combineResult.map(item => (item._1, item._2._1 / item._2._2)) resultRDD.collect().foreach(print(_))

}

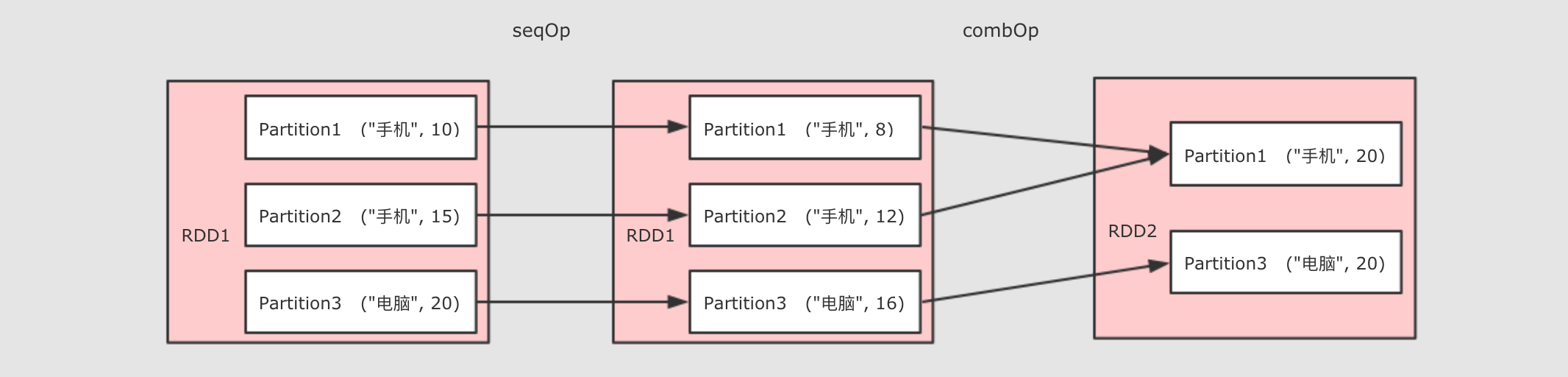

aggregateByKey

作用

聚合所有 Key 相同的 Value, 换句话说, 按照 Key 聚合 Value

调用

rdd.aggregateByKey(zeroValue)(seqOp, combOp)

参数

zeroValue初始值seqOp转换每一个值的函数comboOp将转换过的值聚合的函数

/*

rdd.aggregateByKey(zeroValue)(seqOp, combOp)

zeroValue 初始值

seqOp 转换每一个值的函数

comboOp 将转换过的值聚合的函数

*/ @Test

def aggregateByKey(): Unit ={

val rdd=sc.parallelize(Seq(("手机",10.0),("手机",15.0),("电脑",20.0)))

rdd.aggregateByKey(0.8)(( zeroValue,item) =>item * zeroValue,(curr,agg) => curr+agg)

.collect()

.foreach(println(_))

// (手机,20.0)

// (电脑,16.0)

}

foldByKey

作用

和 ReduceByKey 是一样的, 都是按照 Key 做分组去求聚合, 但是 FoldByKey 的不同点在于可以指定初始值

/*

foldByKey可以指定初始值

*/

@Test

def foldByKey(): Unit ={

sc.parallelize(Seq(("a",1),("a",1),("b",1)))

.foldByKey(zeroValue = 10)( (curr,agg) => curr + agg )

.collect()

.foreach(println(_))

}

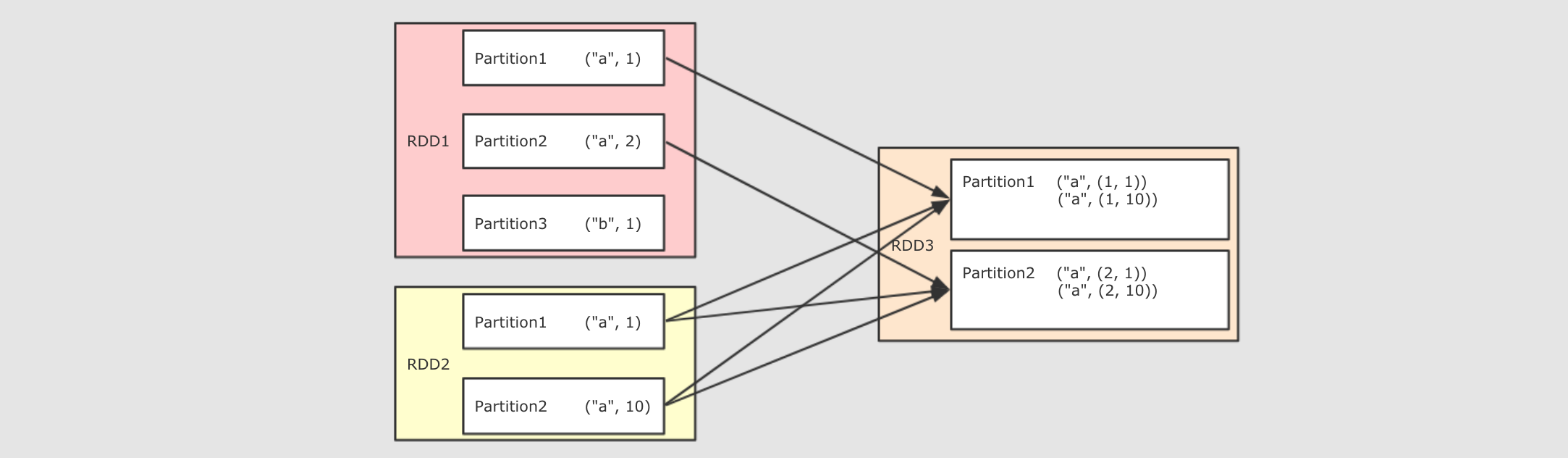

join

作用

将两个 RDD 按照相同的 Key 进行连接

@Test

def join(): Unit ={

val rdd1 = sc.parallelize(Seq(("a", 1), ("a", 2), ("b", 1)))

val rdd2 = sc.parallelize(Seq(("a", 10), ("a", 11), ("a", 12))) rdd1.join(rdd2).collect().foreach(println(_))

// (a,(1,10))

// (a,(1,11))

// (a,(1,12))

// (a,(2,10))

// (a,(2,11))

// (a,(2,12))

}

sortBy

sortBy`可以指定按照哪个字段来排序, `sortByKey`直接按照 Key 来排序

@Test

def sortBy(): Unit ={

val rdd=sc.parallelize(Seq(8,4,5,6,2,1,1,9))

val rdd2=sc.parallelize(Seq(("a",1),("b",3),("c",2)))

//rdd.sortBy(item =>item).collect().foreach(println(_))

rdd2.sortBy(item => item._2).collect().foreach(println(_))

rdd2.sortByKey().collect().foreach(println(_))

}

repartition

重新进行分区

@Test

def partitioning(): Unit ={

val rdd=sc.parallelize(Seq(1,2,3,4,5),2)

//println((rdd.repartition(5)).partitions.size) println(rdd.coalesce(5,true).partitions.size)

}

Spark学习进度-Transformation算子的更多相关文章

- Spark学习笔记--Transformation 和 action

转自:http://my.oschina.net/hanzhankang/blog/200275 附:各种操作的逻辑执行图 https://github.com/JerryLead/SparkInte ...

- Spark学习进度10-DS&DF基础操作

有类型操作 flatMap 通过 flatMap 可以将一条数据转为一个数组, 后再展开这个数组放入 Dataset val ds1=Seq("hello spark"," ...

- Spark学习进度11-Spark Streaming&Structured Streaming

Spark Streaming Spark Streaming 介绍 批量计算 流计算 Spark Streaming 入门 Netcat 的使用 项目实例 目标:使用 Spark Streaming ...

- Spark学习进度-Spark环境搭建&Spark shell

Spark环境搭建 下载包 所需Spark包:我选择的是2.2.0的对应Hadoop2.7版本的,下载地址:https://archive.apache.org/dist/spark/spark-2. ...

- Spark学习进度-RDD

RDD RDD 是什么 定义 RDD, 全称为 Resilient Distributed Datasets, 是一个容错的, 并行的数据结构, 可以让用户显式地将数据存储到磁盘和内存中, 并能控制数 ...

- Spark学习进度-实战测试

spark-shell 交互式编程 题目:该数据集包含了某大学计算机系的成绩,数据格式如下所示: Tom,DataBase,80 Tom,Algorithm,50 Tom,DataStructure ...

- Spark学习之常用算子介绍

1. reduceByKey reduceByKey的作用对像是(key, value)形式的rdd,而reduce有减少.压缩之意,reduceByKey的作用就是对相同key的数据进行处理,最终每 ...

- Spark学习进度7-综合案例

综合案例 文件排序 解法: 1.读取数据 2.数据清洗,变换数据格式 3.从新分区成一个分区 4.按照key排序,返还带有位次的元组 5.输出 @Test def filesort(): Unit = ...

- Spark学习之路(四)—— RDD常用算子详解

一.Transformation spark常用的Transformation算子如下表: Transformation算子 Meaning(含义) map(func) 对原RDD中每个元素运用 fu ...

随机推荐

- PyQt(Python+Qt)学习随笔:toolButton的autoRaise和arrowType属性

autoRaise属性 autoRaise属性表示toolButton按钮是否自动凸出,类型为布尔类型.默认值为False,可以通过autoRaise().setAutoRaise(bool enab ...

- JAVA课堂作业(2019.10.21)

1. 代码: package class20191021; class Grandparent { public Grandparent() { System.out.println("Gr ...

- 百度前端技术学院-基础-day17-18

JavaScript小练习 task 1 基于上一个任务中,关于加减乘除的任务,加上对于特殊情况的判断,比如判断两个输入框是否都是正常输入了数字类型的内容,比如除法的时候除数是否为0,当判断到输入有异 ...

- this作为构造函数时注意点

在 JS 中,为了实现类,我们需要定义一些构造函数,在调用一个构造函数的时候加上 new 这个关键字: function Person(name) { this.name = name; consol ...

- POJ3565

题目大意: 给定\(n\)个蚂蚁和\(n\)颗苹果树的坐标,要求每个蚂蚁爬到一颗苹果树旁,使得每个蚂蚁路线不相交且路线总长度最小,求每个蚂蚁爬到哪个苹果树旁? 首先假设有两只蚂蚁路径相交,那么这两个蚂 ...

- 纯css 实现文本换行

业务场景:dialog中嵌套的表单,实现信息展示,由于存储路径过长并且在一行显示,导致多出的文字出现在弹出框外面了,页面极丑,所以需要将存储路径实现自动换行. 技术点:<p style=&quo ...

- 【UnitTest】使用方法

UnitTest安装 pip install unittest 详细教程: https://www.cnblogs.com/yufeihlf/p/5707929.html断言: DDT数据驱动: c ...

- 多个HDFS集群的fs.defaultFS配置一样,造成应用一直连接同一个集群的问题分析

背景 应用需要对两个集群中的同一目录下的HDFS文件个数和文件总大小进行比对,在测试环境中发现,即使两边HDFS目录下的数据不一样,应用日志显示两边始终比对一致,分下下来发现,应用连的一直是同一个集群 ...

- 手写开源ORM框架介绍

手写开源ORM框架介绍 简介 前段时间利用空闲时间,参照mybatis的基本思路手写了一个ORM框架.一直没有时间去补充相应的文档,现在正好抽时间去整理下.通过思路历程和代码注释,一方面重温下知识,另 ...

- Flink相对于Spark的优点

Flink相对于Spark的优点 容错 Flink 基于两阶段提交实现了精确的一次处理语义. Spark Streaming 只能做到不丢数据,但是有重复. 反压 Flink 在数据传输过程中使用了分 ...