python简单爬虫(爬取pornhub特定关键词的items图片集)

请提前搭好梯子,如果没有梯子的话直接403。

1.所用到的包

requests: 和服务器建立连接,请求和接收数据(当然也可以用其他的包,socket之类的,不过requests是最简单好用的)

BeautifulSoup:解析从服务器接收到的数据

urllib: 将网页图片下载到本地

import requests

from bs4 import BeautifulSoup

import urllib

2.获取指定页面的html内容并解析

我这里选取"blowjob"作为关键字

key_word='blowjob'

url = 'https://www.pornhub.com/video/search?search='+key_word

html=requests.get(url) soup=BeautifulSoup(html.content,'html.parser')

3.从html中筛到全部image并进行遍历

使用find_all函数,将所有img区块中包含属性'width':"150"的存储到jpg_data列表中,并对jpg_data列表进行遍历

jpg_data=soup.find_all('img',attrs={'width':"" })

for cur in jpg_data:

pic_src=cur['src']

4.进一步筛选,并找到图片地址进行下载操作

cur['src']为当前图片地址,cur['alt']为当前图片标题,urllib.requests.urlretrieve操作将图片保存到当地,默认地址为本py文件所在目录,如有需要也可自定义保存目录。

for cur in jpg_data:

pic_src=cur['src']

if(".jpg" in pic_src):

filename=cur['alt']+'.jpg'

with open(filename,'wb') as f:

f.write(bytes(pic_src,encoding='utf-8'))

print(filename)

f.close()

完整代码:

import requests

from bs4 import BeautifulSoup

headers = {'User-Agent': 'User-Agent:Mozilla/5.0 (Macintosh; Intel Mac OS X 10_12_3) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/56.0.2924.87 Safari/537.36'} url = 'https://www.pornhub.com/video/search?search=blowjob'

html=requests.get(url,headers=headers) soup=BeautifulSoup(html.content,'html.parser')

jpg_data=soup.find_all('img',attrs={'width':"" })

for cur in jpg_data:

pic_src=cur['src']

if(".jpg" in pic_src):

filename=cur['alt']+'.jpg'

with open(filename,'wb') as f:

f.write(bytes(pic_src,encoding='utf-8'))

print(filename)

f.close()

以上所作示例仅爬取了keyword关键词搜索下第一页的图片内容,如需要爬取多页,

可在url后加'&page=xx'并进行遍历

for i in range(0,10):

url = 'https://www.pornhub.com/video/search?search=blowjob'+'&page='+str(i)

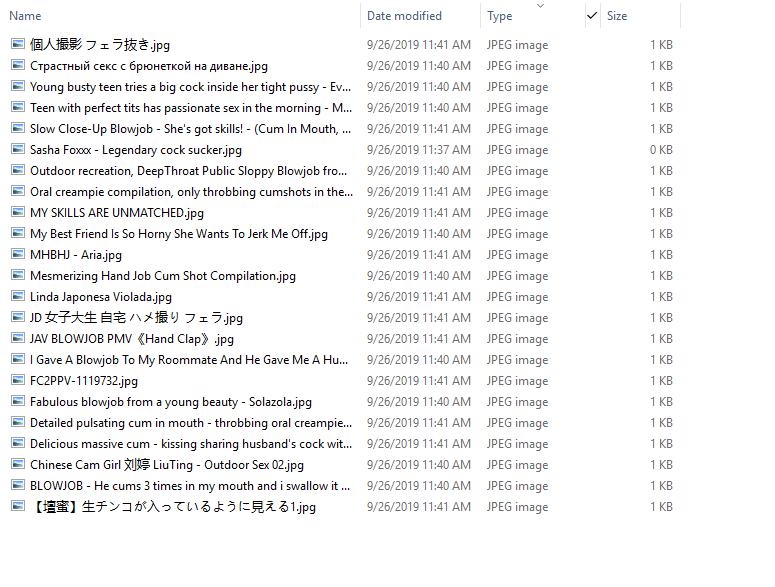

程序运行结果:

python简单爬虫(爬取pornhub特定关键词的items图片集)的更多相关文章

- python简单爬虫爬取百度百科python词条网页

目标分析:目标:百度百科python词条相关词条网页 - 标题和简介 入口页:https://baike.baidu.com/item/Python/407313 URL格式: - 词条页面URL:/ ...

- 如何利用Python网络爬虫爬取微信朋友圈动态--附代码(下)

前天给大家分享了如何利用Python网络爬虫爬取微信朋友圈数据的上篇(理论篇),今天给大家分享一下代码实现(实战篇),接着上篇往下继续深入. 一.代码实现 1.修改Scrapy项目中的items.py ...

- 利用Python网络爬虫爬取学校官网十条标题

利用Python网络爬虫爬取学校官网十条标题 案例代码: # __author : "J" # date : 2018-03-06 # 导入需要用到的库文件 import urll ...

- 【Python数据分析】简单爬虫 爬取知乎神回复

看知乎的时候发现了一个 “如何正确地吐槽” 收藏夹,里面的一些神回复实在很搞笑,但是一页一页地看又有点麻烦,而且每次都要打开网页,于是想如果全部爬下来到一个文件里面,是不是看起来很爽,并且随时可以看到 ...

- python制作爬虫爬取京东商品评论教程

作者:蓝鲸 类型:转载 本文是继前2篇Python爬虫系列文章的后续篇,给大家介绍的是如何使用Python爬取京东商品评论信息的方法,并根据数据绘制成各种统计图表,非常的细致,有需要的小伙伴可以参考下 ...

- Python多线程爬虫爬取电影天堂资源

最近花些时间学习了一下Python,并写了一个多线程的爬虫程序来获取电影天堂上资源的迅雷下载地址,代码已经上传到GitHub上了,需要的同学可以自行下载.刚开始学习python希望可以获得宝贵的意见. ...

- Python简易爬虫爬取百度贴吧图片

通过python 来实现这样一个简单的爬虫功能,把我们想要的图片爬取到本地.(Python版本为3.6.0) 一.获取整个页面数据 def getHtml(url): page=urllib.requ ...

- 【Python】Python简易爬虫爬取百度贴吧图片

通过python 来实现这样一个简单的爬虫功能,把我们想要的图片爬取到本地.(Python版本为3.6.0) 一.获取整个页面数据 def getHtml(url): page=urllib.requ ...

- 04 Python网络爬虫 <<爬取get/post请求的页面数据>>之requests模块

一. urllib库 urllib是Python自带的一个用于爬虫的库,其主要作用就是可以通过代码模拟浏览器发送请求.其常被用到的子模块在Python3中的为urllib.request和urllib ...

随机推荐

- springboot-vue前后端分离session过期重新登录

springboot-vue前后端分离session过期重新登录 简单回顾cookie和session cookie和session都是回话管理的方式 Cookie cookie是浏览器端存储信息的一 ...

- javascript简单实现深浅拷贝

深浅拷贝知识在我们的日常开发中还算是用的比较多,但是之前的状态一直都是只曾听闻,未曾使用(其实用了只是自己没有意识到),所以今天来跟大家聊一聊js的深浅拷贝: 首先我们来了解一下javascript的 ...

- POJ 1797-Heavy Transportation-dijkstra小变形和POJ2253类似

传送门:http://poj.org/problem?id=1797 题意: 在起点和终点间找到一条路,使得经过的边的最小值是最大的: 和POJ2253类似,传送门:http://www.cnblog ...

- hdu6437 Problem L.Videos(网络流)

Problem L.Videos Problem Description: C-bacteria takes charge of two kinds of videos: ’The Collectio ...

- POJ 1390 Blocks (区间DP) 题解

题意 t组数据,每组数据有n个方块,给出它们的颜色,每次消去的得分为相同颜色块个数的平方(要求连续),求最大得分. 首先看到这题我们发现我们要把大块尽可能放在一起才会有最大收益,我们要将相同颜色块合在 ...

- myslq5.7安装以及root密码找回

一.mysql安装 创建用户和用户组: groupadd mysqluseradd -g mysql mysql -s /sbin/nologin 解压压缩文件并创建软链接 tar -xvf mysq ...

- Storm 系列(一)—— Storm和流处理简介

一.Storm 1.1 简介 Storm 是一个开源的分布式实时计算框架,可以以简单.可靠的方式进行大数据流的处理.通常用于实时分析,在线机器学习.持续计算.分布式 RPC.ETL 等场景.Storm ...

- JAVA MAP转实体

public static <T> T map2Object(Map<String, Object> map, Class<T> clazz) { SimpleDa ...

- NGUI_基础入门学习

目录 1. Control Widgets 控制部件2. Anchors 锚3. Interaction 交互4. Menu 菜单5. Controller Input 控制器的输入6. Lights ...

- 记一次Mysql数据库Kill完之后启动不起来的解决方案

在Mysql运行的时候,有时候会stop不了,这时候我们就会想直接把他的进程kill掉. 但是,有时候kill完了之后,在去start它就会直接抛异常了... ERROR! The server qu ...