爬虫---Beautiful Soup 爬取图片

上一篇简单的介绍Beautiful Soup 的基本用法,这一篇写下如何爬取网站上的图片,并保存下来

爬取图片

1.找到一个福利网站:http://www.xiaohuar.com/list-1-1.html

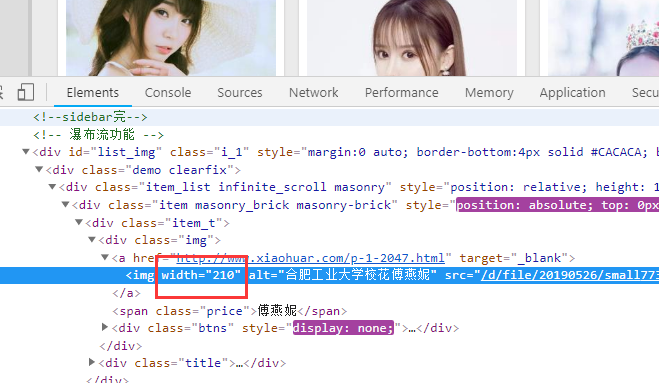

2.通过F12进行定位图片

3.通过下图可以看到标签为img,然后通过width="210"的属性

爬取方法

1.通过find_all()的方法进行查找图片位置

2.筛选出图片的URL和图片名称

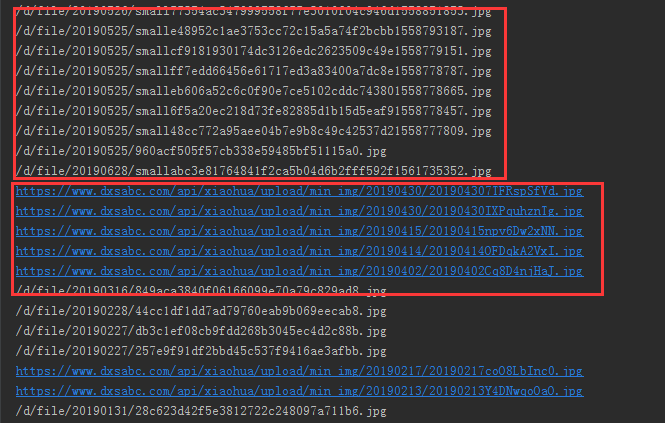

3.筛选后会发现其中有一些图片URL不完整

4.这个时候需要在代码中加一个判断,如何URL不完整 我们就给他补充完整

import requests

from bs4 import BeautifulSoup

import os

# 请求地址

url = 'http://www.xiaohuar.com/list-1-1.html'

html = requests.get(url).content

# BeautifulSoup 实例化

soup = BeautifulSoup(html,'html.parser')

jpg_data = soup.find_all('img',width="")

for i in jpg_data:

data = i['src']

name = i['alt']

# 判断URL是否完整

if "https://www.dxsabc.com/" not in data:

data = 'http://www.xiaohuar.com'+ data

保存图片

1.判断一个文件夹是否存在,不存在就重新创建

2.request模块请求图片的URL

3.通过content返回图片二进制,进行写入文件夹中

# coding:utf-8

import requests

from bs4 import BeautifulSoup

import os

# 创建一个文件夹名称

FileName = 'tupian'

if not os.path.exists(os.path.join(os.getcwd(), FileName)): # 新建文件夹

print(u'建了一个名字叫做', FileName, u'的文件夹!')

os.mkdir(os.path.join(os.getcwd(),'tupian'))

else:

print(u'名字叫做', FileName, u'的文件夹已经存在了!')

url = 'http://www.xiaohuar.com/list-1-1.html'

html = requests.get(url).content # 返回html

soup = BeautifulSoup(html,'html.parser') # BeautifulSoup对象

jpg_data = soup.find_all('img',width="") # 找到图片信息

for i in jpg_data:

data = i['src'] # 图片的URL

name = i['alt'] # 图片的名称

if "https://www.dxsabc.com/" not in data:

data = 'http://www.xiaohuar.com'+data

r2 = requests.get(data)

fpath = os.path.join(FileName,name)

with open(fpath+'.jpg','wb+')as f : # 循环写入图片

f.write(r2.content)

print('保存成功,快去查看图片吧!!')

图片就不贴了,喜欢的可以自己动手写一写。

爬虫---Beautiful Soup 爬取图片的更多相关文章

- 一起学爬虫——使用Beautiful Soup爬取网页

要想学好爬虫,必须把基础打扎实,之前发布了两篇文章,分别是使用XPATH和requests爬取网页,今天的文章是学习Beautiful Soup并通过一个例子来实现如何使用Beautiful Soup ...

- 使用Beautiful Soup爬取猫眼TOP100的电影信息

使用Beautiful Soup爬取猫眼TOP100的电影信息,将排名.图片.电影名称.演员.时间.评分等信息,提取的结果以文件形式保存下来. import time import json impo ...

- 爬虫---Beautiful Soup 初始

我们在工作中,都会听说过爬虫,那么什么是爬虫呢? 什么是网络爬虫 爬虫基本原理 所谓网络爬虫就是一个自动化数据采集工具,你只要告诉它要采集哪些数据,丢给它一个 URL,就能自动地抓取数据了.其背后的基 ...

- 爬虫---Beautiful Soup 通过添加不同的IP请求

上一篇爬虫写了如何应付反爬的一些策略也简单的举了根据UA的例子,今天写一篇如何根据不同IP进行访问豆瓣网获取排行版 requests添加IP代理 如果使用代理的话可以通过requests中的方法pro ...

- 爬虫---Beautiful Soup 反反爬虫事例

前两章简单的讲了Beautiful Soup的用法,在爬虫的过程中相信都遇到过一些反爬虫,如何跳过这些反爬虫呢?今天通过知乎网写一个简单的反爬中 什么是反爬虫 简单的说就是使用任何技术手段,阻止别人批 ...

- scrapy爬虫系列之三--爬取图片保存到本地

功能点:如何爬取图片,并保存到本地 爬取网站:斗鱼主播 完整代码:https://files.cnblogs.com/files/bookwed/Douyu.zip 主要代码: douyu.py im ...

- 爬虫-Beautiful Soup模块

阅读目录 一 介绍 二 基本使用 三 遍历文档树 四 搜索文档树 五 修改文档树 六 总结 一 介绍 Beautiful Soup 是一个可以从HTML或XML文件中提取数据的Python库.它能够通 ...

- python3爬虫-快速入门-爬取图片和标题

直接上代码,先来个爬取豆瓣图片的,大致思路就是发送请求-得到响应数据-储存数据,原理的话可以先看看这个 https://www.cnblogs.com/sss4/p/7809821.html impo ...

- Python爬虫学习 - day1 - 爬取图片

利用Python完成简单的图片爬取 最近学习到了爬虫,瞬时觉得很高大上,想取什么就取什么,感觉要上天.这里分享一个简单的爬取汽车之家文章列表的图片教程,供大家学习. 需要的知识点储备 本次爬虫脚本依赖 ...

随机推荐

- No implementation for org.apache.maven.model.path.PathTranslator was bound.

2019-12-17 10:19:19,884 [ 688476] INFO - #org.jetbrains.idea.maven - org.apache.maven.model.resoluti ...

- vue高频面试题(面试路上踩过的坑)

### Vue 双向绑定原理 mvvm 双向绑定,采用**数据劫持结合发布者-订阅者模式**的方式,通过 `Object.defineProperty()` 来劫持各个属性的 setter.gette ...

- ResultMap(还没细看)

前言 MyBatis是基于“数据库结构不可控”的思想建立的,也就是我们希望数据库遵循第三范式或BCNF,但实际事与愿违,那么结果集映射就是MyBatis为我们提供这种理想与现实间转换的手段了,而res ...

- ajax技术初识与应用

一.ajax技术初识 AJAX即“Asynchronous Javascript And XML”(异步JavaScript和XML),是指一种创建交互式网页应用的网页开发技术.Ajax不是一种新的编 ...

- 使用threaddump-analyzer 快速查看jvm thread 状态信息

日常开发中,我们可以需要通过thread dump 查看线程信息,比如锁,spotify 团队提供了一个web 界面,很方便 以下是简单使用,同时添加了docker 支持 添加docker 支持 cl ...

- Forethought Future Cup - Elimination Round C 二分 + 交互(求树的直径)

https://codeforces.com/contest/1146/problem/C 题意 一颗大小为n的树,每次可以询问两个集合,返回两个集合中的点的最大距离,9次询问之内得出树的直径 题解 ...

- Python 中的时间处理包datetime和arrow

Python 中的时间处理包datetime和arrow 在获取贝壳分的时候用到了时间处理函数,想要获取上个月时间包括年.月.日等 # 方法一: today = datetime.date.today ...

- [NewLife.XCode]分表分库(百亿级大数据存储)

NewLife.XCode是一个有15年历史的开源数据中间件,支持netcore/net45/net40,由新生命团队(2002~2019)开发完成并维护至今,以下简称XCode. 整个系列教程会大量 ...

- vs中 Stack around the variable 'XXX' was corrupted.

https://blog.csdn.net/hou09tian/article/details/75042206 把 project->配置属性->c/c++->代码生成->基 ...

- linux软链接

这是linux中一个非常重要的命令,他的功能是为某一个文件在另一个位置建立一个同步的链接,这个命令最常用的参数是-s, 具体用法是: ln -s 源文件 目标文件 当我们需要在不同的目录,用到相同的文 ...