Scrapy框架 之某网站产品采集案例

一、创建项目

第一步:scrapy startproject boyuan

第二步:cd boyuan

scrapy genspider product -t crawl boyuan.com

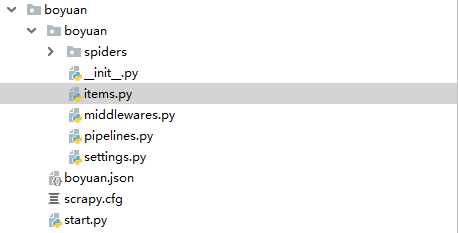

如图:

二、代码编写

1、item.py

# -*- coding: utf-8 -*- # Define here the models for your scraped items

#

# See documentation in:

# https://doc.scrapy.org/en/latest/topics/items.html import scrapy class BoyuanItem(scrapy.Item):

# define the fields for your item here like:

# name = scrapy.Field()

name = scrapy.Field()

address = scrapy.Field()

company = scrapy.Field()

img = scrapy.Field()

time = scrapy.Field()

2、product.py爬虫文件

# -*- coding: utf-8 -*-

import scrapy

from scrapy.spiders import Rule, CrawlSpider

from scrapy.linkextractors import LinkExtractor

from ..items import BoyuanItem class ProductSpider(CrawlSpider):

name = 'product'

allowed_domains = ['boyuan.com']

offset = 1

url = "http://www.boyuan.com/sell/?page={0}"

start_urls = [url.format(str(offset))] page_link = LinkExtractor(allow=("\?page=\d+")) rules = [

Rule(page_link, callback="parse_content", follow=True)

] def parse_content(self, response):

for each in response.xpath("//div[@class='list']//tr"):

item = BoyuanItem()

item['name'] = each.xpath("./td[4]//strong/text()").extract()[0]

item['company'] = each.xpath("./td[4]//li[4]/a/text()").extract()[0]

address = each.xpath("./td[4]//li[3]/text()").extract()[0]

item['address'] = str(address).strip("[").strip("]")

time = each.xpath("./td[4]//li[3]/span/text()").extract()[0]

item['time'] = str(time).strip()

item['img'] = each.xpath("./td[2]//img/@original").extract()[0]

yield item

3、pipelines.py 管道文件

# -*- coding: utf-8 -*- # Define your item pipelines here

#

# Don't forget to add your pipeline to the ITEM_PIPELINES setting

# See: https://doc.scrapy.org/en/latest/topics/item-pipeline.html

import json

import pymongo

from scrapy.conf import settings class BoyuanPipeline(object): def __init__(self):

host = settings.get("MONGO_HOST")

port = settings.get("MONGO_PORT")

db_name = settings.get("MONGO_DB")

collection = settings.get("MONGO_COLLECTION")

self.client = pymongo.MongoClient(host=host, port=int(port))

db = self.client.get_database(db_name)

if collection not in db.list_collection_names():

db.create_collection(collection)

self.col = db[collection] def process_item(self, item, spider):

# 保存到mongodb中

self.col.insert(dict(item))

return item def close_spider(self, spider):

self.client.close()

3、settings.py 配置文件

# mongodb数据库参数

MONGO_HOST = "localhost"

MONGO_PORT = ""

MONGO_DB = "boyuan"

MONGO_COLLECTION = "product"

4、start.py 启动文件

from scrapy import cmdline if __name__ == '__main__':

cmdline.execute("scrapy crawl product".split())

采集结果如图:

Scrapy框架 之某网站产品采集案例的更多相关文章

- Python 之scrapy框架58同城招聘爬取案例

一.项目目录结构: 代码如下: # -*- coding: utf-8 -*- # Define here the models for your scraped items # # See docu ...

- scrapy框架的解析

1,scrapy框架的官网:https://scrapy.org/ 什么是scrapy框架: scrapy 是一个为了爬取网站数据,提取结构性数据而编写的应用内框架,非常出名,所谓框架就是一个已经继承 ...

- Scrapy框架——CrawlSpider类爬虫案例

Scrapy--CrawlSpider Scrapy框架中分两类爬虫,Spider类和CrawlSpider类. 此案例采用的是CrawlSpider类实现爬虫. 它是Spider的派生类,Spide ...

- Scrapy框架——CrawlSpider爬取某招聘信息网站

CrawlSpider Scrapy框架中分两类爬虫,Spider类和CrawlSpider类. 它是Spider的派生类,Spider类的设计原则是只爬取start_url列表中的网页, 而Craw ...

- 爬虫(十四):Scrapy框架(一) 初识Scrapy、第一个案例

1. Scrapy框架 Scrapy功能非常强大,爬取效率高,相关扩展组件多,可配置和可扩展程度非常高,它几乎可以应对所有反爬网站,是目前Python中使用最广泛的爬虫框架. 1.1 Scrapy介绍 ...

- scrapy框架爬取糗妹妹网站妹子图分类的所有图片

爬取所有图片,一个页面的图片建一个文件夹.难点,图片中有不少.gif图片,需要重写下载规则, 创建scrapy项目 scrapy startproject qiumeimei 创建爬虫应用 cd qi ...

- Python爬虫开发【第1篇】【Scrapy框架】

Scrapy 框架介绍 Scrapy是用纯Python实现一个为了爬取网站数据.提取结构性数据而编写的应用框架. Srapy框架,用户只需要定制开发几个模块就可以轻松的实现一个爬虫,用来抓取网页内容以 ...

- python爬虫scrapy框架

Scrapy 框架 关注公众号"轻松学编程"了解更多. 一.简介 Scrapy是用纯Python实现一个为了爬取网站数据.提取结构性数据而编写的应用框架,用途非常广泛. 框架的力量 ...

- selenium模块使用详解、打码平台使用、xpath使用、使用selenium爬取京东商品信息、scrapy框架介绍与安装

今日内容概要 selenium的使用 打码平台使用 xpath使用 爬取京东商品信息 scrapy 介绍和安装 内容详细 1.selenium模块的使用 # 之前咱们学requests,可以发送htt ...

随机推荐

- android studio 0.8.1使用和遇到问题解决

谷歌6月底公布了五大系统,而且android studio同步升级到了android studio 0.8.1.升级了的android studio确实有一些新的变化.执行速度变快,而且还能够选择开发 ...

- Java学习笔记----容器

一.Java Collections框架是什么? Java Collections 框架中包括了大量集合接口以及这些接口的实现类和操作它们的算法(如:排序.查找.反转.替换.复制.取最小元素.取最大元 ...

- [DLX+bfs] hdu 4069 Squiggly Sudoku

题意: 给你9*9的矩阵.对于每一个数字.能减16代表上面有墙,能减32代表以下有墙. .. 最后剩下的数字是0代表这个位置数要求,不是0代表这个数已知了. 然后通过墙会被数字分成9块. 然后做数独, ...

- 李维对VCL理解的几个错误

研读深入浅出VCL一书的时候,有不少地方被网友提出疑问,而且似乎是网友们正确.但这丝毫不动摇李维在大中华Delphi界的江湖地位,因为高手应该是对整个系统理解的高手,而不是对某一个疑问的高手.能花巨量 ...

- html鼠标事件

jsp鼠标事件汇总 onclick 单击时触发的事件,这个比较常用 ondblclick 双击时触发的事件 onmoucedown 鼠标按下时触发的事件(个人觉得与onclick异曲同工) onmou ...

- mac ox终端显示 bogon的问题

mac终端显示如果正常应该是电脑名称(偏好设置-共享)的,但是细心的我们会发现,当电脑换了网络环境之后,可能就会出现终端上显示为主机名为:bogon,一查bogon这个单词是虚拟.虚伪的意思. ...

- go语言--time.After

go语言--time.After https://blog.csdn.net/cyk2396/article/details/78873396 1.源码分析: // After waits for t ...

- 2017阿里给Java开发者的两个福利

一.<Java开发规约> 无规矩不成方圆 无规范不能协作. 2017年开春之际,诚意献上重磅大礼:阿里巴巴Java开发手册,首次公开阿里官方Java代码规范标准.这套Java统一规范标准将 ...

- bzoj4869

http://www.lydsy.com/JudgeOnline/problem.php?id=4869 终于A了...参考了下dalao的代码... 拓展欧几里得定理,改了几次就不变了,但是用的时候 ...

- spring cloud config搭建说明例子(一)-简单示例

服务端 ConfigServer pom.xml添加config jar <dependency> <groupId>org.springframework.cloud< ...