Spark Streamming 基本输入流(二) :Socket

Spark Streamming 可以通过socket 进行数据监听。

socket的输入方可以通过nc 或者自己开发nc功能的程序。

1、系统自带的nc

su root

a

yum install -y nc 安装nc

nc -lk 22222 就代表nc对22222端口进行监听。

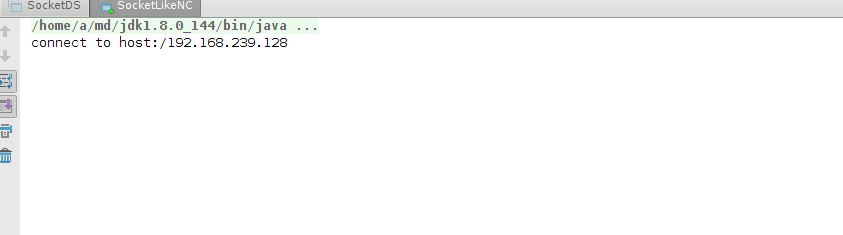

2、自己编写nc程序

下面程序是不停给master 22222 端口写入行数据。

val words = "hello spark storm hive java hadoop hbase hello money scala python".split(" ")

val n = words.size

val ra = new Random()

val hostname = "master"

val port = 22222

val ss = new ServerSocket(port)

val socket = ss.accept()

println("connect to host:" + socket.getInetAddress)

while(true){

val out = new PrintWriter(socket.getOutputStream)

out.println(words(ra.nextInt(n)) + " " + words(ra.nextInt(n)))

out.flush()

Thread.sleep(100)

3、编写spark streamming 处理程序。

object SocketDS {

def main(args: Array[String]): Unit = {

val conf = new SparkConf().setAppName("SocketDS").setMaster("local[2]")

val ssc = new StreamingContext(conf,Seconds(10))

ssc.sparkContext.setLogLevel("warn")

val hostname = "master"

val port = 22222

val lines = ssc.socketTextStream(hostname ,port)

val words = lines.flatMap(_.split("\\s+"))

words.transform(wRDD=>{

val wordCount = wRDD.map((_,1)).reduceByKey(_+_).sortBy(_._2,false)

wordCount

}).print()

ssc.start()

ssc.awaitTermination()

}

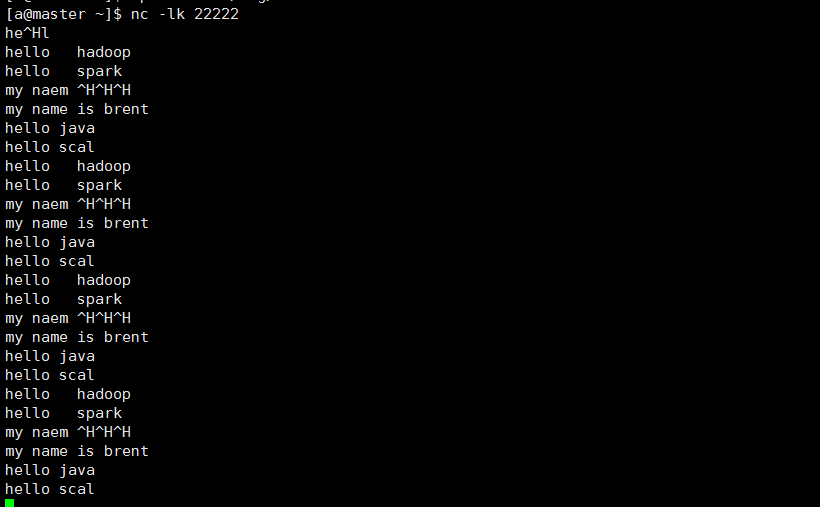

4、nc端 输入socket内容 进行监控

hello spark

hello hadoop

hello socket

hello java

hello scala

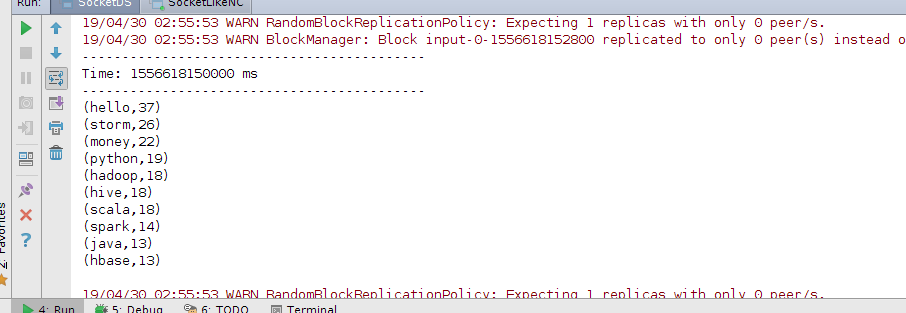

5、先开启spark Streamming处理程序,再开启nc或者ncsocket,运行结果如下。

nc -lk 22222给master 22222发送数据,

通过自己编写的nc socket程序,随机组合给master 22222发送行数据。

spark streamming 程序接收并处理后的结果。

Spark Streamming 基本输入流(二) :Socket的更多相关文章

- Spark Streamming 基本输入流I(-) :File/Hdfs

Spark Streamming 基本输入流I(-):从文件中进行读取 文件读取1:本地文件读取 这里我只给出实现代码及操作步骤 1.在本地目录下创建目录,这里我们创建目录为~/log/ 2.然后手动 ...

- Spark面试题(二)

首发于我的个人博客:Spark面试题(二) 1.Spark有哪两种算子? Transformation(转化)算子和Action(执行)算子. 2.Spark有哪些聚合类的算子,我们应该尽量避免什么类 ...

- linux内核中的文件描述符(二)--socket和文件描述符

http://blog.csdn.net/ce123_zhouwei/article/details/8459730 Linux内核中的文件描述符(二)--socket和文件描述符 Kernel ve ...

- 二. Socket用法

C/S通信架构中,客户端要主动与服务端建立连接,这个链接就是Socket套接字.服务端收到连接请求后,也会开启Socket记录与客户端的链接.C/S两端都要建路Socket才能正常收发数据. 一.构造 ...

- Spark读写Hbase的二种方式对比

作者:Syn良子 出处:http://www.cnblogs.com/cssdongl 转载请注明出处 一.传统方式 这种方式就是常用的TableInputFormat和TableOutputForm ...

- Spark SQL概念学习系列之为什么使用 Spark SQL?(二)

简单地说,Shark 的下一代技术 是Spark SQL. 由于 Shark 底层依赖于 Hive,这个架构的优势是对传统 Hive 用户可以将 Shark 无缝集成进现有系统运行查询负载. 但是也看 ...

- 【Spark篇】---Spark中transformations算子二

一.前述 今天继续整理几个Transformation算子如下: mapPartitionWithIndex repartition coalesce groupByKey zip zipWithIn ...

- spark streaming 整合kafka(二)

转载:https://www.iteblog.com/archives/1326.html 和基于Receiver接收数据不一样,这种方式定期地从Kafka的topic+partition中查询最新的 ...

- Spark 系列(十二)—— Spark SQL JOIN 操作

一. 数据准备 本文主要介绍 Spark SQL 的多表连接,需要预先准备测试数据.分别创建员工和部门的 Datafame,并注册为临时视图,代码如下: val spark = SparkSessio ...

随机推荐

- jquery 使用整理机制

短路表达式 与 多重短路表达式 短路表达式这个应该人所皆知了.在 jQuery 中,大量的使用了短路表达式与多重短路表达式. 短路表达式:作为"&&"和" ...

- Apache2.4+PHP7.3 安装及整合教程[Windows]

系统环境:Win10 64位 Apache版本:2.4.37 64位 PHP版本:7.3.1 64位 下载 安装的第一步肯定是下载了,可以直接到我的网盘(密码:18tp)下载,下载完成后将文件解压到你 ...

- Java 方法重载和多态

先来看看什么是方法重载? 方法重载的要求是:方法名相同,参数列表不同(不同的参数类型或者参数顺序或者参数个数).至于方法的其他部分,如方法返回值类型和修饰符,与方法重载没有任何关系.最好加上@Over ...

- python之from 和import执行过程分析

原文链接:http://blog.csdn.net/lis_12/article/details/52883729 问题1 同一个目录下,有两个Python文件,A.py,B.py #A.py fro ...

- vim命令“=”、“d”、“y”的用法(结合光标移动命令,一些场合会非常方便)

vim有许多命令,网上搜有一堆贴子.文章列举出各种功能的命令. 对于“=”.“d”.“y”,我在无意中发现了它们所具有的相同的一些用法,先举以下三个例子: =nG dnG ynG 其中,n为行号.注意 ...

- Effective C++ .44 typename和class的不同

在C++模板中的类型参数一般可以使用typename和class,两者没有什么不同.但是typename比class多项功能: “任何时候当你想要在template中指涉一个嵌套从属类型名称,就必须在 ...

- js-原始类型和声明变量

** Java的基本数据类型:byte.short.int.long.float.double.char.boolean ** 定义变量 都是用关键字 var(ES6中可以使用const和let来定义 ...

- Django 模型层之多表操作

一.创建模型 实例: 作者表: 拥有字段:姓名(name),性别(sex),该表与书籍表之间为多对多的关系 作者详情表: 拥有字段:地址(addr),手机号(phone),该表与作者表之间为一对一的关 ...

- JavaScript有限状态机实现方式

阮一峰博客 http://www.ruanyifeng.com/blog/2013/09/finite-state_machine_for_javascript.html 开源实现库(javascri ...

- javascript实现SHA1算法

web里面密码直接传到后台是不安全的,有时候需要进行加密,找到一个不错的javascript SHA1算法: <!DOCTYPE html> <html lang="en& ...