吴裕雄 python 机器学习——KNN回归KNeighborsRegressor模型

import numpy as np

import matplotlib.pyplot as plt from sklearn import neighbors, datasets

from sklearn.model_selection import train_test_split def create_regression_data(n):

'''

创建回归模型使用的数据集

'''

X =5 * np.random.rand(n, 1)

y = np.sin(X).ravel()

# 每隔 5 个样本就在样本的值上添加噪音

y[::5] += 1 * (0.5 - np.random.rand(int(n/5)))

# 进行简单拆分,测试集大小占 1/4

return train_test_split(X, y,test_size=0.25,random_state=0) #KNN回归KNeighborsRegressor模型

def test_KNeighborsRegressor(*data):

X_train,X_test,y_train,y_test=data

regr=neighbors.KNeighborsRegressor()

regr.fit(X_train,y_train)

print("Training Score:%f"%regr.score(X_train,y_train))

print("Testing Score:%f"%regr.score(X_test,y_test)) #获取回归模型的数据集

X_train,X_test,y_train,y_test=create_regression_data(1000)

# 调用 test_KNeighborsRegressor

test_KNeighborsRegressor(X_train,X_test,y_train,y_test)

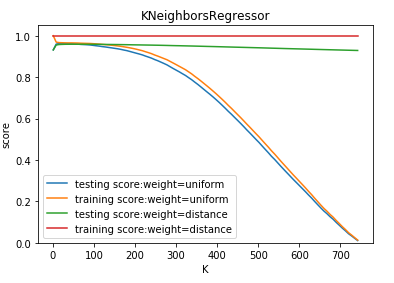

def test_KNeighborsRegressor_k_w(*data):

'''

测试 KNeighborsRegressor 中 n_neighbors 和 weights 参数的影响

'''

X_train,X_test,y_train,y_test=data

Ks=np.linspace(1,y_train.size,num=100,endpoint=False,dtype='int')

weights=['uniform','distance'] fig=plt.figure()

ax=fig.add_subplot(1,1,1)

### 绘制不同 weights 下, 预测得分随 n_neighbors 的曲线

for weight in weights:

training_scores=[]

testing_scores=[]

for K in Ks:

regr=neighbors.KNeighborsRegressor(weights=weight,n_neighbors=K)

regr.fit(X_train,y_train)

testing_scores.append(regr.score(X_test,y_test))

training_scores.append(regr.score(X_train,y_train))

ax.plot(Ks,testing_scores,label="testing score:weight=%s"%weight)

ax.plot(Ks,training_scores,label="training score:weight=%s"%weight)

ax.legend(loc='best')

ax.set_xlabel("K")

ax.set_ylabel("score")

ax.set_ylim(0,1.05)

ax.set_title("KNeighborsRegressor")

plt.show() # 调用 test_KNeighborsRegressor_k_w

test_KNeighborsRegressor_k_w(X_train,X_test,y_train,y_test)

def test_KNeighborsRegressor_k_p(*data):

'''

测试 KNeighborsRegressor 中 n_neighbors 和 p 参数的影响

'''

X_train,X_test,y_train,y_test=data

Ks=np.linspace(1,y_train.size,endpoint=False,dtype='int')

Ps=[1,2,10] fig=plt.figure()

ax=fig.add_subplot(1,1,1)

### 绘制不同 p 下, 预测得分随 n_neighbors 的曲线

for P in Ps:

training_scores=[]

testing_scores=[]

for K in Ks:

regr=neighbors.KNeighborsRegressor(p=P,n_neighbors=K)

regr.fit(X_train,y_train)

testing_scores.append(regr.score(X_test,y_test))

training_scores.append(regr.score(X_train,y_train))

ax.plot(Ks,testing_scores,label="testing score:p=%d"%P)

ax.plot(Ks,training_scores,label="training score:p=%d"%P)

ax.legend(loc='best')

ax.set_xlabel("K")

ax.set_ylabel("score")

ax.set_ylim(0,1.05)

ax.set_title("KNeighborsRegressor")

plt.show() # 调用 test_KNeighborsRegressor_k_p

test_KNeighborsRegressor_k_p(X_train,X_test,y_train,y_test)

吴裕雄 python 机器学习——KNN回归KNeighborsRegressor模型的更多相关文章

- 吴裕雄 python 机器学习——KNN分类KNeighborsClassifier模型

import numpy as np import matplotlib.pyplot as plt from sklearn import neighbors, datasets from skle ...

- 吴裕雄 python 机器学习——支持向量机非线性回归SVR模型

import numpy as np import matplotlib.pyplot as plt from sklearn import datasets, linear_model,svm fr ...

- 吴裕雄 python 机器学习——半监督学习LabelSpreading模型

import numpy as np import matplotlib.pyplot as plt from sklearn import metrics from sklearn import d ...

- 吴裕雄 python 机器学习——支持向量机线性回归SVR模型

import numpy as np import matplotlib.pyplot as plt from sklearn import datasets, linear_model,svm fr ...

- 吴裕雄 python 机器学习——逻辑回归

import numpy as np import matplotlib.pyplot as plt from matplotlib import cm from mpl_toolkits.mplot ...

- 吴裕雄 python 机器学习——ElasticNet回归

import numpy as np import matplotlib.pyplot as plt from matplotlib import cm from mpl_toolkits.mplot ...

- 吴裕雄 python 机器学习——Lasso回归

import numpy as np import matplotlib.pyplot as plt from sklearn import datasets, linear_model from s ...

- 吴裕雄 python 机器学习——岭回归

import numpy as np import matplotlib.pyplot as plt from sklearn import datasets, linear_model from s ...

- 吴裕雄 python 机器学习——层次聚类AgglomerativeClustering模型

import numpy as np import matplotlib.pyplot as plt from sklearn import cluster from sklearn.metrics ...

随机推荐

- 基于 Ant Desigin 的后台管理项目打包优化实践

背景 按照 Ant Design 官网用 React 脚手构建的后台项目,刚接手项目的时候大概30条路由左右,我的用的机子是 Mac 8G 内存,打包完成需要耗时2分钟左右,决定优化一下. 项目技术栈 ...

- linux - mysql - 卸载:使用rpm方式安装的mysql

一.查看系统中是否以rpm包安装的mysql rpm -qa | grep -i mysql 结果: 备注:如果有内容则证明是使用rpm方式安装的mysql 二.卸载 使用rpm -e 命令将上个命令 ...

- flask入门(三)

表单 request.form 能获取POST 请求中提交的表单数据.但是这样不太安全,容易受到恶意攻击.对此,flask有一个flask-wtf扩展,用于避免这一情况 在虚拟环境下用pip inst ...

- day22 定时任务

检查软件是否安装 cronie [root@oldboyedu ~]# rpm -qa cronie cronie-1.4.11-19.el7.x86_64 [root@oldboyedu ~]# r ...

- 16day 路径信息系列

../ 上一级目录 ./ 当前路径 ~ 返回到家目录 - 两个目录之间进行快速切换 An argument of - is equivalent to $OLDPWD(环境变量) 补充说明: [roo ...

- onvif学习一:wsdl 和soap

来源:https://www.cnblogs.com/huanghongbo/p/5920123.html WSDL是用来描述WebService的,它用XML的格式描述了WebService有哪些方 ...

- C#画图超出屏幕的部分无法显示的解决方法

C#画图超出屏幕的部分无法显示,通过AutoScrollMinSize属性及相关方法解决问题. 可以实现 到 的转变. 代码如下: using System.Drawing; using System ...

- 前后端交互技术之servlet与form表单提交请求及ajax提交请求

1.先来个简单的form表单 login.jsp,建在webcontent目录下(url写相对路径就可以了) <!DOCTYPE html><html><head> ...

- c数据结构 -- 使用链表实现计数

#include <stdio.h> #include <stdlib.h> typedef struct _node{ int value; struct _node *ne ...

- vue-cli脚手架创建vue项目

CLI 使用vue-cli可以快速搭建Vue开发环境以及对应的webpack配置 cnpm install -g @vue/cli // 如果需要使用旧版本的vue init功能(脚手架2),你可以全 ...